文章圖片

【只用2700萬參數,這個推理模型超越了DeepSeek和Claude】

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

編輯:澤南、陳陳

像人一樣推理 。大模型的架構 , 到了需要變革的時候?

在對復雜任務的推理工作上 , 當前的大語言模型(LLM)主要采用思維鏈(CoT)技術 , 但這些技術存在任務分解復雜、數據需求大以及高延遲等問題 。

近日 , 受到人腦分層和多時間尺度處理機制啟發 , 來自 Sapient Intelligence 的研究者提出了分層推理模型(HRM) , 這是一種全新循環架構 , 能夠在保持訓練穩定性和效率的同時 , 實現高計算深度 。

具體來說 , HRM 通過兩個相互依賴的循環模塊 , 在單次前向傳遞中執行順序推理任務 , 而無需對中間過程進行明確的監督:其中一個高級模塊負責緩慢、抽象的規劃 , 另一個低級模塊負責處理快速、細致的計算 。 HRM 僅包含 2700 萬個參數 , 僅使用 1000 個訓練樣本 , 便在復雜的推理任務上取得了卓越的性能 。

該模型無需預訓練或 CoT 數據即可運行 , 但在包括復雜數獨謎題和大型迷宮中最優路徑查找在內的挑戰性任務上卻取得了近乎完美的性能 。 此外 , 在抽象與推理語料庫 (ARC) 上 , HRM 的表現優于上下文窗口明顯更長的大型模型 。 ARC 是衡量通用人工智能能力的關鍵基準 。

由此觀之 , HRM 具有推動通用計算變革性進步的潛力 。

- 論文:Hierarchical Reasoning Model

- 論文鏈接:https://arxiv.org/abs/2506.21734

分層推理模型

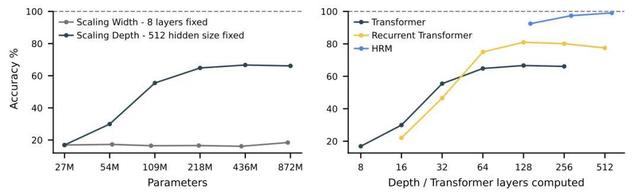

復雜推理中深度的必要性如下圖所示 。

左圖:在需要大量樹搜索和回溯的 Sudoku-Extreme Full 上 , 增加 Transformer 的寬度不會帶來性能提升 , 而增加深度則至關重要 。 右圖:標準架構已飽和 , 無法從增加深度中獲益 。 HRM 克服了這一根本限制 , 有效地利用其計算深度實現了近乎完美的準確率 。

HRM 核心設計靈感來源于大腦:分層結構 + 多時間尺度處理 。具體包括:

分層處理機制:大腦通過皮層區域的多級層次結構處理信息 。 高級腦區(如前額葉)在更長的時間尺度上整合信息并形成抽象表示 , 而低級腦區(如感覺皮層)則負責處理即時、具體的感知運動信息 。

時間尺度分離:這些層次結構的神經活動具有不同的內在時間節律 , 體現為特定的神經振蕩模式 。 這種時間分離機制使得高級腦區能穩定地指導低級腦區的快速計算過程 。

循環連接特性:大腦具有密集的循環神經網絡連接 。 這種反饋回路通過迭代優化實現表示精確度的提升和上下文適應性增強 , 但需要額外的處理時間 。 值得注意的是 , 這種機制能有效規避反向傳播時間算法(BPTT)中存在的深層信用分配難題 。

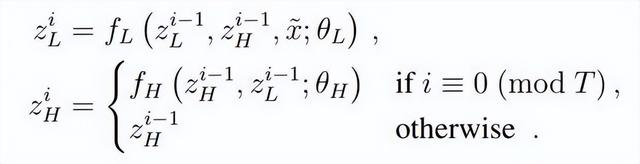

HRM 模型由四個可學習的組件組成:輸入網絡 f_I (?; θ_I ) , 低級循環模塊 f_L (?; θ_L), 高級循環模塊 f_H (?; θ_H) 和輸出網絡 f_O (?; θ_O)。

HRM 將輸入向量 x 映射到輸出預測向量 y′ 。 首先 , 輸入 x 被網絡投影成一個表示:

模塊在一個周期結束時的最終狀態為:

最后 , 在經過 N 個完整周期后 , 從 H 模塊的隱藏狀態中提取預測。

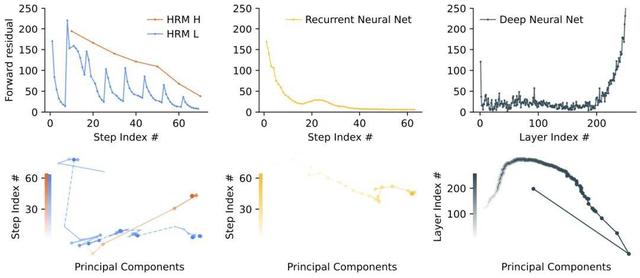

HRM 表現出層級收斂性:H 模塊穩定收斂 , 而 L 模塊在周期內反復收斂 , 然后被 H 重置 , 導致殘差出現峰值 。 循環神經網絡表現出快速收斂 , 殘差迅速趨近于零 。 相比之下 , 深度神經網絡則經歷了梯度消失 , 顯著的殘差主要出現在初始層(輸入層)和最終層 。

HRM 引入了:

首先是近似梯度 。 循環模型通常依賴 BPTT 計算梯度 。 然而 , BPTT 需要存儲前向傳播過程中的所有隱藏狀態 , 并在反向傳播時將其與梯度結合 , 這導致內存消耗與時間步長 T 呈線性關系(O (T)) 。

HRM 設計了一種一步梯度近似法 , 核心思想是: 使用每個模塊最后狀態的梯度 , 并將其他狀態視為常數 。

上述方法需要 O (1) 內存 , 不需要隨時間展開 , 并且可以使用 PyTorch 等自動求導框架輕松實現 , 如圖 4 所示 。

其次是深度監督 , 本文將深度監督機制融入 HRM 。

自適應計算時間(ACT) 。 大腦在自動化思維(System 1)與審慎推理(System 2)之間動態切換 。

受上述機制的啟發 , 本文將自適應停止策略融入 HRM , 以實現快思考 , 慢思考 。

圖 5 展示了兩種 HRM 變體的性能比較 。 結果表明 , ACT 能夠根據任務復雜性有效地調整其計算資源 , 從而顯著節省計算資源 , 同時最大程度地降低對性能的影響 。

推理時間擴展 。 有效的神經模型應當能夠在推理階段動態利用額外計算資源來提升性能 。 如圖 5-(c) 所示 , HRM 模型僅需增加計算限制參數 Mmax , 即可無縫實現推理計算擴展 , 而無需重新訓練或調整模型架構 。

實驗及結果

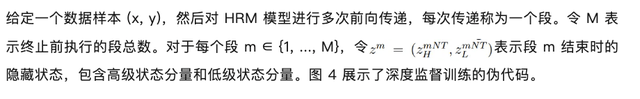

該研究中 , 作者跑了 ARC-AGI、數獨和迷宮基準測試 , 結果如圖 1 所示:

HRM 在復雜的推理任務上表現出色 , 但它引出了一個耐人尋味的問題:HRM 神經網絡究竟實現了哪些底層推理算法?解答這個問題對于增強模型的可解釋性以及加深對 HRM 解決方案空間的理解至關重要 。

作者嘗試對 HRM 的推理過程進行可視化 。 在迷宮任務中 , HRM 似乎最初會同時探索多條潛在路徑 , 隨后排除阻塞或低效的路徑 , 構建初步解決方案大綱 , 并進行多次優化迭代;在數獨任務中 , 該策略類似于深度優先搜索方法 , 模型會探索潛在解決方案 , 并在遇到死胡同時回溯;HRM 對 ARC 任務采用了不同的方法 , 會對棋盤進行漸進式調整 , 并不斷迭代改進 , 直至找到解決方案 。 與需要頻繁回溯的數獨不同 , ARC 的解題路徑遵循更一致的漸進式 , 類似于爬山優化 。

更重要的是 , 該模型可以適應不同的推理方法 , 并可能為每個特定任務選擇有效的策略 。 不過作者也表示 , 我們還需要進一步研究以更全面地了解這些解題策略 。

HRM 在基準任務中對中間預測結果的可視化 。 上圖:MazeHard—— 藍色單元格表示預測路徑 。 中圖:Sudoku-Extreme—— 粗體單元格表示初始給定值;紅色突出顯示違反數獨約束的單元格;灰色陰影表示與上一時間步的變化 。 下圖:ARC-AGI-2 任務 —— 左圖:提供的示例輸入輸出對;右圖:求解測試輸入的中間步驟 。

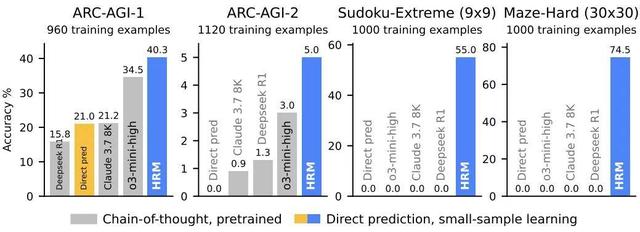

下圖為 HRM 模型與小鼠皮層的層級維度組織結構對比 。

例如 , 在小鼠皮層中可以觀察到維度層次 , 其中群體活動的 PR( Participation Ratio )從低水平感覺區域到高水平關聯區域單調增加 , 支持維度和功能復雜性之間的這種聯系(圖 8 a , b) 。

圖 8-(ef) 所示的結果顯示出明顯對比:未經過訓練的模型中 , 高層模塊與低層模塊沒有表現出任何層級分化 , 它們的 PR 值都較低 , 且幾乎沒有差異 。

這一對照實驗表明 , 維度層級結構是一種隨著模型學習復雜推理任務而自然涌現的特性 , 并非模型架構本身固有的屬性 。

作者在進一步討論中表示 , HRM 的圖靈完備性與早期的神經推理算法(包括 Universal Transformer)類似 , 在給定足夠的內存和時間約束的情況下 , HRM 具有計算通用性 。

換句話說 , 它克服了標準 Transformer 的計算限制 , 屬于可以模擬任何圖靈機的模型類別 。 再加上具有自適應計算能力 , HRM 可以在長推理過程中進行訓練 , 解決需要密集深度優先搜索和回溯的復雜難題 , 并更接近實用的圖靈完備性 。

除了 CoT 微調之外 , 強化學習(RL)是最近另一種被廣泛采用的訓練方法 。 然而 , 最近的證據表明 , 強化學習主要是為了解鎖現有的類似 CoT 能力 , 而非探索全新的推理機制。 此外 , 使用強化學習進行 CoT 訓練以其不穩定性和數據效率低而聞名 , 通常需要大量的探索和精心的獎勵設計 。 相比之下 , HRM 從基于梯度的密集監督中獲取反饋 , 而不是依賴于稀疏的獎勵信號 。 此外 , HRM 在連續空間中自然運行 , 這在生物學上是合理的 , 避免了為每個 token 分配相同的計算資源進而導致的低效 。

更多內容 , 請參閱原論文

推薦閱讀

- OPPO Find X9再次被確認:6.59英寸+新ID設計,參數也懸念不大

- 騰訊開源推理模型!13B參數比肩OpenAI o1,1張GPU就能跑

- 谷歌開源Gemma 3n:2G內存就能跑,100億參數內最強多模態模型

- 家用打印機選購指南:告別參數焦慮,實用才是王道

- 雷柏VT3 MAX鼠標評測:性能參數同樣最強 最適合自己的才是最好的

- 藍牙協議版本介紹「技術特性、核心參數、協議棧、功能分層」

- 小米“雙機”發布前瞻:小折疊+性價比新機,參數規格基本沒懸念

- 淘天聯合愛橙開源強化學習訓練框架,支持十億到千億參數大模型

- iOS 26測試版泄密:iPhone 17 Air屏幕參數與超薄設計曝光

- 一加15參數曝光,1.5K直屏+潛望長焦,一加13再降價