不同于一般的卷積,空洞卷積的卷積核更加“蓬松”,也就是在卷積核中加入空洞,以此來擴大感受野 。路徑A具有三個卷積,其卷積核大小分別為1×1、3×3和1×1 。這里所謂的卷積并不是數學意義上的,神經網絡的卷積運算實際上可以看做一種比較特殊的矩陣計算,即將圖中的局部像素矩陣和卷積核進行運算(符號是和直積一樣,但不是直積,公式網上很多),所以可以將其視為空間泛函,每次運算所得到是對應位置的實數(這里是一次,不是一趟),使用一個卷積核′卷'一趟所得到的輸出一般是一個規模小一些的矩陣,不同卷積核(內容不同)自然可以得到不同的輸出,故形成圖像不同的特征(所以這里也可以把這里的卷積理解為一種空間間映照算子);在網絡反饋時,需注意對于卷積的逆運算,即需旋轉卷積核180度(當然不用真的旋轉,可以inplace,即從后向前運算,就能達到相同效果) 。

如何理解空洞卷積?

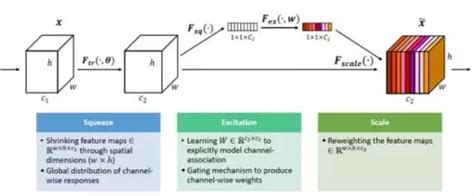

CNN網絡中在對圖像進行下采樣時,常常使用pooling操作,包括average pooling和max pooling 。其作用在仿照人的視覺系統進行降維,同時擴大了感受野(perceptual field) 。對卷積層提取的特征進行降采樣,從而能夠獲取到更高級的特征 。此外pooling層也可以保證特征位置和旋轉不變形 。

最后引入pooling還能起到降少網絡參數,防止過擬合的問題 。但是采用pooling也有其缺點,在降采樣的同時也會丟失一部分特征信息,損失了原始圖像中的信息 。空洞卷積(diluted convolution)就是為解決pooling層的缺點而提出的 。它首先是針對圖像語義分割而產生的一種卷積方法 。不同于一般的卷積,空洞卷積的卷積核更加“蓬松”,也就是在卷積核中加入空洞,以此來擴大感受野 。

引入了一個新的參數空洞率(dilation rate),即卷積核的間隔數目,正常卷積核的空洞率等于1 。如下圖就是一個空洞率為2的3*3空洞卷積 。我們可以發現,空洞卷積不僅擴大了感受野降低了維度,同時沒有增加計算量 。但是由于引入了一個超參數,就需要權衡每次卷積時的參數,如果空洞率過大,那么就很有可能捕捉不到圖像中小物體的信息,因此再使用時需要設置好合適的空洞率 。

如何理解Graph上的卷積操作?

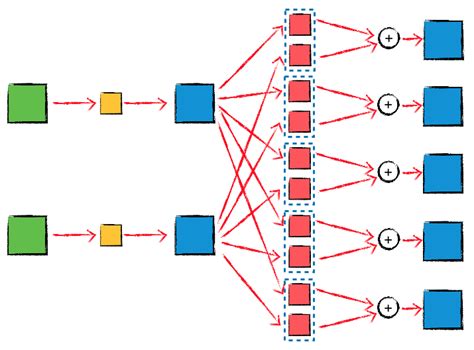

這里所謂的卷積并不是數學意義上的,神經網絡的卷積運算實際上可以看做一種比較特殊的矩陣計算,即將圖中的局部像素矩陣和卷積核進行運算(符號是和直積一樣,但不是直積,公式網上很多),所以可以將其視為空間泛函,每次運算所得到是對應位置的實數(這里是一次,不是一趟),使用一個卷積核′卷'一趟所得到的輸出一般是一個規模小一些的矩陣,不同卷積核(內容不同)自然可以得到不同的輸出,故形成圖像不同的特征(所以這里也可以把這里的卷積理解為一種空間間映照算子);在網絡反饋時,需注意對于卷積的逆運算,即需旋轉卷積核180度(當然不用真的旋轉,可以inplace,即從后向前運算,就能達到相同效果) 。

【圖像的卷積和池化操作,卷積操作】卷積神經網絡有哪些重要的技巧細節?

除了帶你動手學深度學習,李沐大神還帶你深挖卷積神經網絡的各種實踐「技藝」 。近日AWS的研究者研究了一系列訓練過程和模型架構的改進方法,他們在多個神經網絡架構和數據集上評估它們,并研究它們對最終模型準確率的影響 。自 2012 年 AlexNet 大展神威以來,研究者已經提出了各種卷積架構,包括 VGG、NiN、Inception、ResNet、DenseNet 和 NASNet 等,我們會發現模型的準確率正穩定提升 。

推薦閱讀

- 電腦的本地連接不見了怎么辦,網絡連接不上怎么辦

- 城市軌道交通車輛技術的就業方向

- 蒼蟲的學名

- 重慶專本貫通的政策

- 介詞的用法口訣

- 最薄的手機有哪些,比較薄的手機有哪些

- 買吸塵器怎么挑選,想買個好用的吸塵器

- 忘記你笨重的大光圈鏡頭,景深鏡頭

- 安卓手機哪個牌子好,現在什么安卓手機好

- 中國人形機器人,類人機器人