文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

編輯:冷貓

一覺起來世界已經進化成這樣了?

每個人都能懂點魔法 , 能夠隨意穿梭在各個平行時空和幻想世界里 。

讀者朋友們看到這說不定撇撇嘴 , 「這不就是 AI 視頻嗎?」

但如果加上兩個關鍵詞 , 這將成為 AI 視頻生成領域革命性的突破!

就在昨天 , Decart 發布了世界上首個「實時的」「無時長限制的」并且支持「任意視頻流」的擴散視頻模型 MirageLSD!

輸入任何視頻流 , 無論是相機或視頻聊天、電腦屏幕還是游戲 , MirageLSD 都能在 40 毫秒延遲以內將其轉化為你想要的任何世界 。

這一切都看上去不可思議 , AI 視頻已經能夠實現和濾鏡一樣的應用方式 , 實時智能調整畫面風格和畫面內容 , 并且能夠通過文本提示任意地進行控制 。

實時視頻魔法

解鎖全新應用可能

前特斯拉 AI 總監 , OpenAI 的創始團隊成員 Andrej Karpathy 為此技術展開了廣泛的想象:

- 將攝像頭畫面變為 “另一個世界” 。

- 自導自演實時電影:拿起道具、演繹場景 , AI 負責實時布景和風格化 , 秒看回放 , 邊演邊剪 。

- 游戲開發輕松起步:用簡單的球體 / 方塊編碼游戲機制 , 再用實時擴散模型為游戲生成精美貼圖 。

- 任意視頻流的風格遷移:例如:只需一句提示詞就能讓《上古卷軸》看起來 “更史詩” , 讓《毀滅戰士 2》擁有現代虛幻引擎畫質 。

- 視頻會議背景和實時虛擬試衣 。

- AR 眼鏡升級:實時將現實世界卡通化 。

- 哈利波特的「厄里斯魔鏡」:現實中看似普通的鏡子 , 實際上會顯示出 AI 根據你 “深層欲望” 生成的理想自己或世界 。

【世界首個「實時、無限」擴散視頻生成模型,Karpathy投資站臺】也許這些都只是開始 , 真正的 “殺手級應用” 還沒被發現 —— 這個領域值得無限想象!

這一切讓我想起了「刀劍神域」 , 似乎覆蓋現實世界的幻想畫面真的要實現了?

Decart 也展示了一些構想的演示 , 充分滿足了各種可能:

比如在沙漠里滑雪?

比如可以花上 30 分鐘寫個游戲代碼 , 然后讓 Mirage 處理圖形?

Decart 推文中笑稱 , 使用 Mirage「從提示詞制作 GTA VII , 比 GTA VI 發售還快 。 」

目前 Mirage 已正式上線 , 與其觀看屏幕上的魔法 , 不如親手創造魔法 。

Decart 將持續發布模型升級和新功能 , 包括面部一致性、語音控制和精確物體操控等 。 與此同時 , 平臺還將上線一系列新特性 —— 如流媒體支持(以任意角色進行直播)、游戲集成、視頻通話等功能 。

- 體驗鏈接:https://mirage.decart.ai/

MirageLSD技術原理

MirageLSD 主要在視頻生成的時長和延遲兩大角度產生了突破 , 基于定制的模型 —— 實時流擴散(Live Stream Diffusion , LSD) , 該模型能夠逐幀生成并保持時間連貫性 。

在視頻時長方面 , 先前的視頻模型在生成 20-30 秒后就會因錯誤累積而嚴重降低質量 。

在生成延時方面 , 它們往往需要幾分鐘的處理時間才能輸出幾秒鐘的視頻 。 即使是今天最接近實時速度的系統 , 通常也是分塊生成視頻 , 從而引入不可避免的延遲 , 完全無法實現交互應用 。

無限長視頻生成

MirageLSD 是第一個能夠生成無限長視頻的視頻生成模型 。

由于模型的自回歸特性 , 會導致誤差逐步累積 , 從而限制輸出的長度 。

為了實現無限自回歸生成:

- MirageLSD 基于 Diffusion Forcing 技術 , 實現逐幀去噪;

- 我們引入歷史增強方法 , 在訓練中對輸入歷史幀進行擾動 , 使模型學會預判并糾正輸入中的偽影 , 從而增強其對自回歸生成中常見偏移的魯棒性;

零延時視頻生成

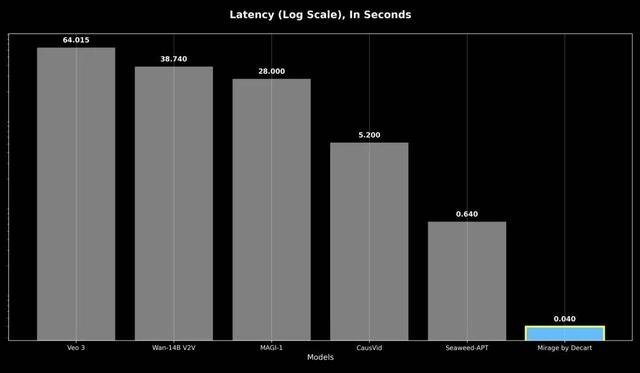

響應性是指最壞情況下的響應延遲 , 即使是之前的自回歸模型響應速度也比 MirageLSD 慢 16 倍以上 , 導致實時交互無法實現 。

實時生成要求每幀的生成時間控制在 40 毫秒以內 , 以避免被人眼察覺 。 我們通過以下方式實現這一目標:

- 設計定制的 CUDA mega kernels , 以最小化開銷并最大化吞吐;

- 基于 shortcut distillation 和模型剪枝技術 , 減少每幀所需的計算量;

- 優化模型架構 , 使其與 GPU 硬件高度對齊 , 實現效率最大化 。

擴散模型與 LSD

擴散模型通過一系列逐步去噪操作 , 將隨機噪聲逐漸還原為圖像或視頻 。 在視頻生成中 , 這通常意味著一次性生成固定長度的視頻片段 , 這有助于保持時間一致性 , 但會帶來延遲 。 一些系統嘗試通過所謂的 “自回歸生成” 方式 , 逐段順序生成幀片段 , 以提高靈活性 。 然而 , 這種方式仍需在每一段幀生成完畢后才能響應新的輸入 , 限制了交互性和實時應用的能力 。

LSD 采用了不同的方法 。 它一次生成一幀 , 使用因果性的自回歸結構 , 每一幀都依賴于此前生成的幀以及用戶提示 。 這種方式支持即時反饋、零延遲交互 , 并且可以持續生成視頻 , 無需預先設定終點 。

在每一個時間步 , 模型會接收一組過去生成的幀、當前輸入幀以及用戶定義的提示詞 , 然后預測下一幀輸出 , 該幀會立即作為輸入傳遞到下一輪生成中 。

這種因果反饋機制使 LSD 能夠保持時間上的一致性 , 持續適應畫面中的動作與內容變化 , 并在實時遵循用戶提示的同時 , 生成無限長度的視頻序列 。

此外 , 它還使 LSD 能夠對輸入作出即時響應 —— 無論是文本提示還是視頻內容的變化 —— 實現真正的零延遲 。 這正是實時編輯與轉換成為可能的關鍵 。

技術缺陷與改進方向

首先 , 當前系統依賴于有限的歷史幀窗口 。 引入更長期的記憶機制有望提升長序列中的連貫性 , 從而在角色身份、場景布局和長期動作等方面實現更一致的表現 。

此外 , 盡管 MirageLSD 支持基于文本的風格變換 , 但對于特定物體、空間區域或動作的精細控制仍較為有限 。 若能整合關鍵點或場景標注等結構化控制信號 , 將有助于在實時環境中實現更細粒度、用戶可控的編輯操作 。

在語義一致性和幾何穩定性方面 , 特別是在面對極端風格變換時 , 仍需進一步優化 。 MirageLSD 在極端風格變化下 , 可能會出現物體結構或布局被扭曲的情況 。

更多相關技術信息 , 請參閱 Decart 的技術介紹:

- 文章鏈接:https://about.decart.ai/publications/mirage

推薦閱讀

- 華為果斷放棄“高利潤”,麒麟9020新機上市僅一個月,跌價1050元

- 小米終于妥協,16GB+1TB+7550mAh,發布不到三個月跌至2612元

- 這個行業成時代機會!雷軍3天賣出近5萬件,科技巨頭250億投資公司

- 微星推出多款全新的B850主板,傳還有另外三個背插型號在準備當中

- 微信最新的一個隱藏新變化,又是非常實用!

- 美女產品經理離職!魅族22還沒發布,小米16再過2個月就要來了

- 網絡安全意識必修課:個人隱私保護,從 “我” 做起

- 12人小公司融資2億!這個AI“外星人”憑啥讓硅谷瘋狂買單?

- 手機圈又來新人,iKKO帶來一個新物種

- 我希望我的 AI,能將我帶向世界