文章圖片

文章圖片

文章圖片

本文作者團隊來自 Insta360 影石研究院及其合作高校 。 目前 , Insta360 正在面向世界模型、多模態大模型、生成式模型等前沿方向招聘實習生與全職算法工程師 , 歡迎有志于前沿 AI 研究與落地的同學加入!簡歷投遞郵箱:research@insta360.com

在虛擬現實、自動駕駛、具身智能等新興應用中 , 全景視覺正逐漸成為不可或缺的研究方向 。 相比于常規透視圖像(正常平面圖像 , 也是大部分 CV 任務使用的標準輸入) , 全景圖像捕捉的是 360°×180° 的完整球面視域(包含四周、頭頂天空與腳下地面) , 仿佛將站立點周圍的整個空間展開成一張“大照片” 。 正因兩者在幾何投影、空間采樣與邊界連續性上的本質差異 , 直接把基于透視視覺開發的算法遷移到全景視覺往往失效 。

本文基于 300+ 篇論文、覆蓋 20+ 代表性任務 , 首次以 “透視-全景 gap” 為主線 , 系統梳理了三大 gap、兩條核心技術路線與未來方向展望 , 既幫助研究者 “按任務選解法” , 也為工程團隊 “按場景落地” 提供清晰坐標 。

論文標題:One Flight Over the Gap: A Survey from Perspective to Panoramic Vision 項目地址:https://insta360-research-team.github.io/Survey-of-Panorama/ 綜述文章鏈接: https://arxiv.org/pdf/2509.04444 全景文章匯總鏈接:https://github.com/Insta360-Research-Team/panoramic-vision-survey

研究背景與動機

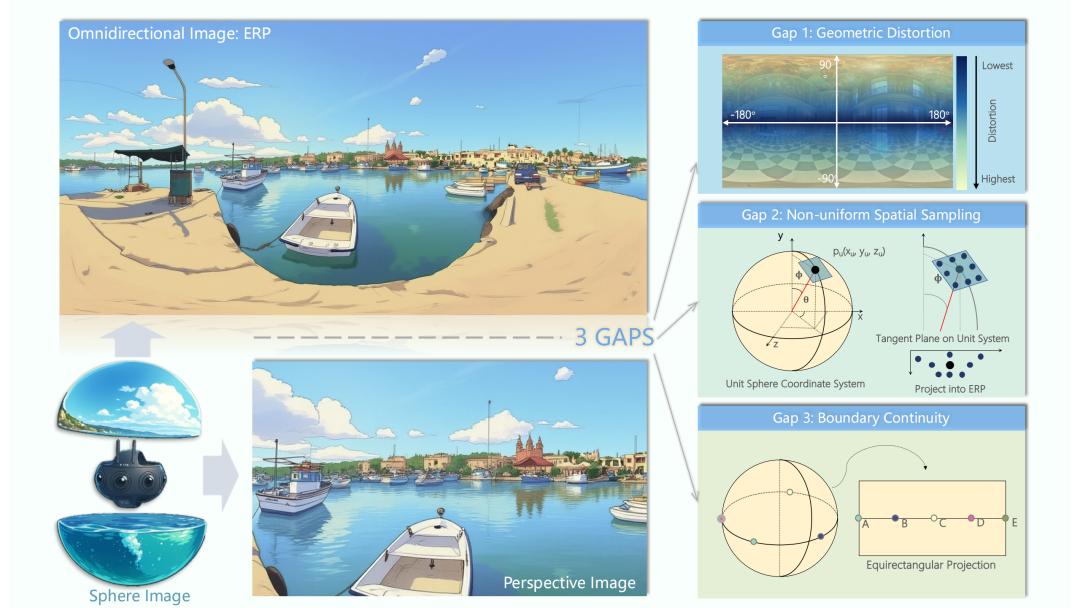

左側展示了由全景相機獲取的球面影像 , 經過投影后變成常見的等距矩形投影 (ERP) 全景圖像 。 相比下方的透視圖像 , 雖然能完整覆蓋 360° 場景 , 卻引入了三大核心挑戰:

幾何畸變:球面展開到平面時 , 兩極區域被嚴重拉伸 , 物體形狀被破壞 。非均勻采樣:赤道像素密集、極區像素稀疏 , 同一物體在不同緯度分辨率差異明顯 。邊界連續性:ERP 左右邊界實際上在球面上相鄰 , 但在二維圖像上卻被分割 , 導致模型學習時出現連續性問題 。

這三大 gap 正是透視方法難以直接適配全景場景的根源 , 也構成了后續研究創新的出發點 。 相較現有的全景視覺綜述多沿 “單一任務線” 縱向梳理 , 本文以 “透視→全景” 的 gap 為問題原點進行分類與分析 , 從數據、算法到應用層面揭示兩者差異及全景研究滯后的原因 , 這是一個更具動機張力、且現有綜述未充分展開的創新視角 。

策略速覽

四類方法、一張圖看懂任務適配

在全景視覺中 , 分割/修復等依賴全局語義一致性 , 而深度/光流等強調局部幾何精度 , 因此形成了不同策略譜系 。 圖(c)給出跨方法(cross-method)縱向對照:明確 Distortion-Aware / Projection-Driven / Physics-/Geometry-based 的適用分工 , 并與代表性任務逐一進行策略適配 。 其價值在于提供一個統一參考:研究者可從整體視角理解任務需求 , 快速選型或設計最合適的方法 , 也為多策略融合與后續創新奠定基礎 。

圖(a)和圖(b)分析了兩種典型的策略:

① Distortion-Aware(失真感知方法):直接在 ERP 全景格式上建模 , 通過畸變設計、畸變圖權重或自適應注意力來補償極區問題 。

優勢:保留全局像素級別的語義對應 , 不丟失信息;與主流架構高度兼容;端到端設計 , 簡潔易用 。 局限:極區殘余畸變依舊影響準確率;在幾何敏感任務(如深度、光流)上魯棒性不足 。

② Projection-Driven(投影驅動方法)

思路:通過立方體投影(Cubemap)、切平面投影(Tangent)、二十面體投影(Icosahedron)等 , 將球面轉換為多個畸變較小的子視圖 。 優勢:有效緩解極區畸變與接縫問題;能直接復用透視模型和大規模預訓練網絡;在幾何敏感任務中表現突出;可根據應用靈活選擇不同投影 。 局限:多視圖信息碎片化 , 需要額外融合機制;計算與存儲開銷更高;部分投影方式需定制網絡結構 。

③選型分析:

Distortion-Aware 適配:全局語義一致性與感知質量的任務(超分辨率、修復、補全、分割、檢測 。 Projection-Driven 適配:強調局部幾何精度的任務(深度估計、光流、關鍵點匹配、新視角合成;多模態融合任務 。

兩大策略的交叉適配:

超分辨率:視頻播放 / 沉浸顯示→ Distortion-Aware(強調整體一致性);結構 / 精細重建→Projection-Driven(強調幾何保真) 。文生圖 / 視頻生成:保證整體語義對齊→Distortion-Aware;提供更細粒度的局部幾何控制→Projection-Driven 。

Physics-driven 適配:一些特異性的任務依賴物理先驗(如光照估計、反射去除、布局檢測) 。

任務工具箱

20+ 任務一覽 , 按任務選策略

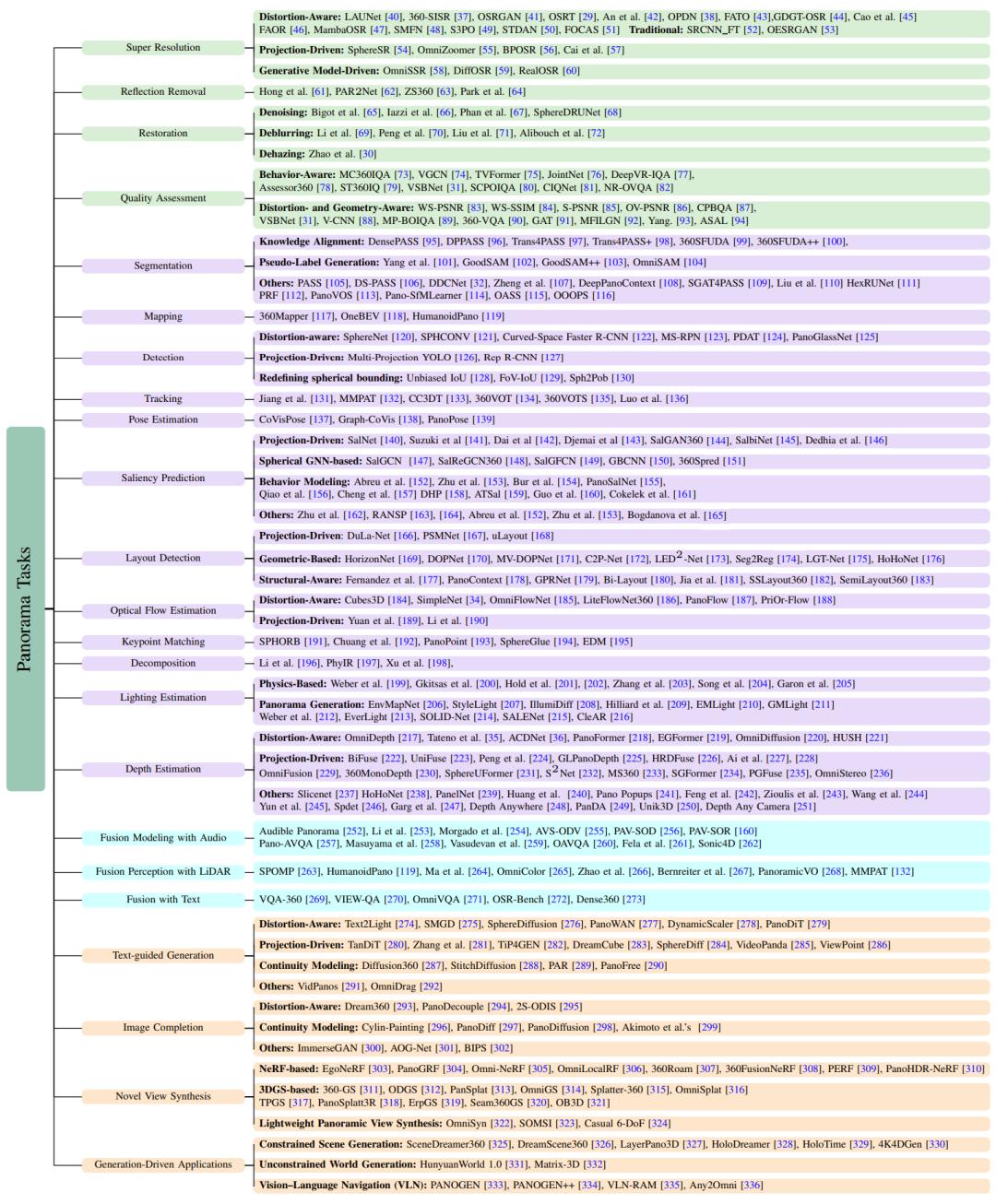

這是全文的橫向 cross-task 對照表:將全景視覺的 20+ 代表性任務按四大板塊歸類(增強與評估、理解、多模態、生成) , 并在每個任務下標注了具有代表性的方法路線與代表工作 。 它與前一張 “cross-method” 圖形成互補:前者 “縱向看方法→適配哪些任務” , 這張表 “橫向看任務→常用哪些策略 / 里程碑工作” 。

具體地 , 左側是任務清單 。 每一行右側列出該任務的主流路線及典型論文 。 這讓讀者可以反向索引:從任務入手 , 快速定位合適的技術路線與關鍵文獻 。 值得一提的是關于新范式加速滲透的整理:Diffusion / 生成式模型在 T2I/V、IC、NVS 與世界模型方向快速涌現 , 強調語義一致與可控性;3DGS:在 NVS / 場景重建中帶來高效高保真渲染;多模態對齊尤其是音頻 / 文本 / LiDAR 與全景的對齊成為新熱點 。

未來展望

關于全景視覺的未來 , 要想從 “可用” 走向 “好用” , 需要在數據—模型—應用三條主線上同步推進:

(1) 數據瓶頸(圖左上)

數量:缺少大規模、跨任務、跨場景的標準 360° 數據 , 限制通用訓練與可復現評測 。多樣性:過度集中于室內 / 城市場景 , 自然 / 空中 / 混合環境覆蓋不足 , 難以走向開放世界 。質量:高質量、細粒度標注(深度 / 分割 / 檢測 / 跟蹤 / 建圖)稀缺 , 真實場景標注成本高 。多模態:圖文、視音頻、LiDAR 等跨模態資源不足 , 制約 VQA、生成與對齊研究進程 。

(2) 模型范式(圖右上)

基礎模型:將對比 / 掩碼 / 自監督遷移到全景視覺;從大規模透視模型遷移到全景域 , 強調零樣本魯棒性 。專家模型:面向檢測 / 分割 / 深度 / 時序等 , 設計參數高效的全景專家模塊 , 與預訓練骨干解耦協同 。多模態:語言 - 音頻 - 全景的空間連續性與對齊仍是難點;亟需理解+生成一體化與世界模型式框架 。全景生成:評測指標缺失、極區一致性、真實畸變復現、曲線運動軌跡建模與全景視頻時空一致性是核心痛點 。

(3) 下游應用(圖下)

空間智能與自動系統:具身智能、自動駕駛、UAV 導航 , 依賴無盲區全局感知與穩健決策 。XR 與沉浸式交互:全景錄制與高分辨生成 + 空間音頻 / 觸覺等多感官 , 走向輕量化穿戴端 。三維重建與數字孿生:全景→完整重建 / 數字孿生 , 支撐智慧城市 / 文博修復等 。廣泛的社會應用:安防、教育、文娛、醫療等行業化場景 , 強調可部署性與合規性 。

結語

透視到全景并非一次簡單的 “投影轉換” , 而是一場貫穿數據、模型與應用的系統性升級 。 本綜述以 “透視—全景 gap” 為主線 , 梳理挑戰、方法與未來應用 , 為研究者與工程團隊提供按任務選型的 “路線圖” 。 我們也歡迎社區共同完善基準與數據 , 推動全景視覺在 XR、機器人系統與數字孿生等關鍵場景中真正 “好用、可用、可落地” 。

【Insta360最新全景綜述:全景視覺的挑戰、方法與未來】更多細節與完整方法清單 , 請查閱論文與項目主頁 。

推薦閱讀

- 任何游戲都能用!AMD AFMF 3幀生成現身最新驅動

- 直擊CoRL|跨越“Sim-to-Real”天塹 NVIDIA解鎖物理AI全景圖

- 小米未上榜,全球智能手機 AP-SoC 市場份額最新排名出爐!

- 郭明錤最新分析:小米17系列砍單20%,官方已迅速回應!

- 華為盤古718B模型最新成績:開源第二

- Flash Attention作者最新播客:英偉達GPU統治三年內將終結

- 黃仁勛最新訪談:沒人需要原子彈,但人人都需要人工智能!

- Meta最新研究RecoWorld,從「猜你喜歡」到「聽你指令」

- AMD最新專利:內存帶寬翻倍!

- 剛剛谷歌發布機器人最新大腦模型!思考能力SOTA,還能跨物種學習