文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

編輯:Panda

近來 , 世界模型(World Model)很火 。 多個 AI 實驗室紛紛展示出令人驚艷的 Demo:僅憑一張圖片甚至一段文字 , 就能生成一個可交互、可探索的 3D 世界 。 這些演示當然很是炫酷 , 它們展現了 AI 強大的生成能力 。

但一個關鍵問題隨之而來:這些由 AI 生成的世界中 , 絕大部分事物都是模型想象和虛構的 。

如果我們不滿足于「創造」一個虛擬世界 , 而是想把我們當下生活的這個真實世界(比如我們的家、辦公室、工廠和城市)完整地變成一個可交互、可計算的 3D 世界呢?

這正是如視(Realsee)想要解答的問題 。 11 月 13 日 , 如視 , 這家數字空間及空間智能綜合解決方案引領者 , 正式發布了其空間大模型 Argus 1.0 , 這也是全球首個(目前也是唯一一個)支持全景圖輸入 , 推測空間深度的大模型 。 它所代表的正是與虛擬生成截然不同的另一條路徑:真實復刻 。 而這背后 , 正是「空間智能」相關技術不斷演進的結果 。

Argus 1.0 的目標不是「虛構」世界 , 而是「還原」真實的世界 。 它能夠以毫秒級的速度 , 從一個場景下的單張或多張全景/普通圖像中 , 推理出所有圖像帶絕對尺度的相機位姿、深度圖和點圖 。

體驗地址:https://h5.realsee.cn/argus?UTM=articlejqzx

從想象到測量 , 從虛擬到真實 , Argus 1.0 的出現為 2D 圖像通向 3D 真實空間架起了一座高速橋梁 。 這一技術突破意味著什么?它背后是如視怎樣的技術積累與戰略布局?

帶著這些問題 , 我們與如視副總裁、首席科學家潘慈輝博士進行了深入對話 , 試圖解碼 Argus 模型的技術特性 , 及其在如視「空間智能」版圖中的關鍵角色 。

Argus 1.0 誕生的基石

如視的「數字空間-算法-行業應用」飛輪

任何強大模型的誕生都不是空中樓閣 , Argus 1.0 也不例外 。 它根植于如視自 2017 年成立以來 , 圍繞空間數字化所構建的深厚壁壘 。 在與潘慈輝博士的交流中 , 他提到了一個核心概念:「數字空間-算法-行業應用」的飛輪循環 。 而這個飛輪的核心驅動力 , 正是如視引以為傲的「真實空間數據庫」 。

核心資產:全球最大的三維空間數據庫

作為最初脫胎于貝殼找房的事業部 , 如視從房產交易這一剛需場景切入 , 開啟了大規模空間數字化的進程 。 截至 2025 年 9 月 , 如視已在全球范圍內積累了突破 5300 萬套的數字空間數據 , 覆蓋面積超過 44 億平方米 。

潘慈輝解釋道:「這個全球最大的真實空間數據庫 , 是如視算法能力迭代的驅動器 。 」

【如視發布空間大模型Argus1.0,支持全景圖等多元輸入,行業首創!】海量數據的積累 , 持續驅動著空間智能 AI 算法的提升;而更強的系統能力 , 又為房產租售、家裝家居、商業零售、工業園區等九大行業提供了高質量的解決方案;這些解決方案的落地 , 反過來又讓如視得以觸達更多元化的空間場景數據 。

高質量空間數據:高精度、完備且一致

如果說 5300 萬的量構筑了護城河的寬度 , 那么數據的質則決定了護城河的深度 。 潘慈輝強調 , Argus 1.0 最大的技術突破 , 正得益于如視堅持自研硬件與算法的技術路線 , 這為其帶來了「完備且一致」的高質量數據 。

潘慈輝說:「我們的數據最大的特色 , 是在硬件設計和標定階段就保證了最終采集的圖像數據和激光點云數據是完備的 , 并且做到了像素級精度的對齊 。 」

不同于業內一些只有圖像數據(缺乏絕對尺度)或只有激光數據(缺乏紋理)的方案 , 如視通過自研的伽羅華(Galois)系列 3D 激光掃描儀(其 P4 型號可直出 3 億像素超高清全景圖 , 圖像與點云平均匹配誤差小于 2 個像素) , 確保了每一份數據都是「所見即所得」的高精度數據對 。 這種在源頭就嚴格標定、高度一致的真實數據 , 是 Argus 1.0 能夠學習到準確深度和絕對尺度的前提 , 也是其遠超其他算法的養料 。

伽羅華 Galois P4 亮點概覽

應用導向的底層創新

強大的數據飛輪背后 , 是一支由如視副總裁、首席科學家潘慈輝博士帶領的研發團隊 。 據潘博士介紹 , 如視從創立之初就堅持應用導向的底層技術創新 , 平均每年的研發投入都在 2 億人民幣以上 。 這份堅決的技術投入 , 造就了如視的技術實力和底氣 。

持續的耕耘也為如視帶來了國際上的權威認可 。 在學術上 , 如視團隊的科研成果近年來多次入選 ICCV、CVPR 等國際頂會;在產品設計上 , 旗下的伽羅華 3D 激光掃描儀、REALSEE G1 手機云臺和龐加萊手持實景掃描儀接連斬獲 2021、2022 及 2023 年德國紅點產品設計大獎 。 如今 , 這些技術和產品已服務于 9 大行業超過 3000+ 品牌客戶 , 團隊也已積累了 600 余項國內外授權專利 。

正是這個由海量高質數據、軟硬一體化和持續研發投入共同驅動的飛輪 , 為 Argus 1.0 的誕生奠定了基礎 。

Argus 1.0

從「單眼」到「百眼」的空間智能突破

如視算法團隊喜歡用希臘神話人物為產品命名 。 潘慈輝在采訪中分享道 , 單目圖像深度估計算法 Cyclops(希臘神話中的獨眼巨人) , 寓意著從單張圖像、單一視角就能推測世界的深度 。

而此次發布的 Argus 1.0 , 名稱則源自希臘神話中的「百眼巨人」 。 這一命名極富象征意義 , 它預示著如視的重建技術正從「單視」推測跨越到「多視」全局一致性的新階段 。

具體技術上 , Argus 1.0 基于 Transformer 架構構建 , 是一個前饋式神經網絡模型 。 該模型基于如視累積的 近百萬套真實高清空間數據(包含對玻璃、鏡面等難題的處理)進行訓練 。 得益于 Transformer 架構的通用性及其與大規模 3D 數據訓練的協同效應 , Argus 1.0 實現了兼容性、實時性與生成質量三大維度的行業突破 。

兼容性:業界首個支持全景圖輸入的推測大模型

首先是輸入端的巨大突破 。 Argus 1.0 是目前業界已知首個、也是唯一一個支持全景圖作為輸入的深度推測大模型 。

Argus 1.0 甚至可以將 AI 生成的全景圖轉換成點云

同時 , 它還廣泛兼容單張 / 多張普通照片乃至 AI 生成的圖片 , 具備極強的多源適應能力 。

Argus 1.0 也支持普通圖轉點云

全景圖推測深度的能力之所以重要 , 在于它直指 VR 內容生產的核心痛點 。 潘慈輝表示 , Argus 1.0 能夠「顯著降低搭建全景圖到 VR 的處理流程的門檻 , 極大提高處理效率」 , 讓低成本、高效率的 3D 空間復刻成為可能 。

實時性與一致性:毫秒級的全局重建

如果說 Cyclops 時代還是兩步走 , 即先用算法推測單張全景圖的深度 , 再通過額外的算法模塊計算位姿、進行拼接;那么 Argus 1.0 則實現了一步到位 。

潘慈輝向我們揭示了 Argus 1.0 的核心架構創新:「此次 Argus 的能力 , 是將之前 Cyclops 的深度推測能力和后續的位姿計算能力 , 融合到了一個算法模塊中 。 」

通過將深度推測和位姿計算進行聯合訓練 , 模型得以更好地挖掘多視圖之間的關聯性 , 從而在全局尺度上實現更高的點云一致性和位姿精度 。 這一增量式到全局式的轉變 , 帶來了效率的質變 。 如視的官方報告顯示 , Argus 1.0 的推理效率達到毫秒級 , 是首個實時的全景圖全局重建系統 , 真正實現了「全流程無感知響應」 。

高質量:源自真實數據的穩健性

Argus 1.0 的高生成質量 , 則要歸功于前文提到的如視獨有的高精度、帶尺度、像素級對齊的真實數據庫 。

在 3D 重建領域 , 玻璃、鏡面、毛坯房、長走廊等場景一直是行業公認的難題 。 潘慈輝指出 , 其根源在于「一般的激光設備對玻璃鏡子的測距能力不足 , 導致大家在學習過程中沒有較好的監督數據」 。

而如視的解決方案是其多年技術的自然結果:「我們的業務場景中會有專門的工具對玻璃鏡子進行標注 , 根據這些標注 , 我們修正原始的有問題的激光點云 。 使用修正后的激光數據進行訓練就能很好地解決這一難題 。 」

正是得益于海量、多樣化且經過精細業務標注的養料 , Argus 1.0 充分學習并掌握了這些困難場景的特征 , 使其在面對傳統重建難題時依然表現穩定 , 生成的 3D 空間顯著優于其他缺乏真實尺度和對齊能力的方案 。

如視的版圖

空間智能「四層理論」與 AIGC 終局

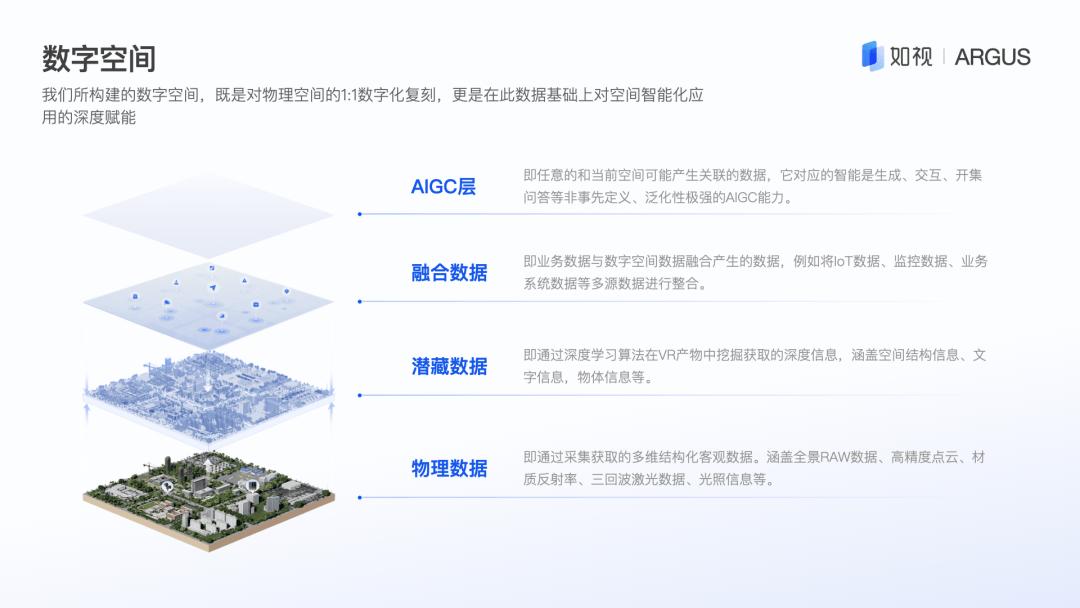

Argus 1.0 的發布 , 不僅是一款工具的升級 , 更是如視「空間智能」版圖中的一塊關鍵拼圖 。 潘慈輝在采訪中詳細闡述了團隊的研發脈絡:一個結合自身實踐總結出的「空間智能四層理論」 。

這四層理論清晰地定義了從數字化到智能化的演進路徑:

第一層:物理數據(重建):即 1:1 復刻; 第二層:潛藏數據(感知推理):理解空間結構、語義; 第三層:融合數據(業務):結合 CAD、IoT 等業務數據; 第四層:AIGC(生成交互):解決開集問題 , 實現泛化交互 。在這個框架下 , Argus 1.0 是第一層(重建)的集大成者 。 它打通的 2D 到 3D 能力已經可以賦能諸多應用場景 。 例如 , 它可以用于生成時下流行的動態鎖屏空間壁紙;潘慈輝在采訪中提到:「Argus 模型推測的深度精度更高 , 分辨率更高 , 且深度帶有絕對尺度信息」 , 效果優于蘋果披露使用的深度推測算法 。

更進一步 , 如視透露 , 預計于明年初發布的 Argus 2.0 及后續版本可進一步用于實時渲染的 3DGS 模型和精細 Mesh 模型 , 為空間漫游提供沉浸式數字基底 。 通過與如視自研的空間智能算法結合 , 它還能驅動空間 CAD 自動生成、高精度語義分割及白模構建等高階應用 , 實現從物理世界到數字空間 , 再賦能現實應用的閉環 。

潘慈輝也明確指出 , 團隊的下一個重點難題 , 正是攻克第四層:AIGC 層 。 他認為 , 許多應用的答案不在空間本身 , 而在于鏈接「空間之外的信息」 , 如行業規范、人類偏好等 。 他總結道:「我們希望當 AIGC 這一層實現后 , 利用其空間之外的信息能力 , 我們能更加快速、低成本地對接更多的行業 , 輸出解決方案 。 」

開放生態

為空間智能行業鋪路

在實現自身技術閉環的同時 , 如視也發揮自身優勢 , 為整個空間智能行業的基礎設施「鋪路」 。

長期以來 , 空間智能領域的研究與應用面臨著一個瓶頸問題:空間智能的「基石」—— 高質量的空間數據 , 存在巨大缺口 。 而如視一直以來的技術成果 , 恰好為解決這一問題打開了一扇窗 。

因此 , 為了加速整個空間智能應用領域的研究演進 , 如視計劃于今年年底開放 10000 套的室內房屋數據集(其中 1000 套新房數據、9000 套 AI 設計數據) , 這同時也是目前最大規模的空間三維數據集 。 這種開放生態 , 讓更多人能站在如視積累的真實數據之上進行創新 , 從而整個行業的發展 。

邁向空間智能的 AIGC 終局

從最初服務于房產交易的 VR 看房 , 到如今賦能九大行業的空間智能;從打磨軟硬一體的采集閉環 , 到發布毫秒級的深度推測大模型 Argus , 如視的路徑清晰地展現了其「數字空間 - 算法 - 行業應用」飛輪的強大勢能 。

Argus 1.0 的發布 , 不僅是如視的飛輪勢能的一次集中爆發 , 它也是一個空間信息解碼器 , 為 3D 視覺領域帶來了一個低門檻、高效率、高質量的基礎工具 。 它向行業證明了一條核心路徑:海量、高精度、高一致性的真實世界數據是訓練空間基礎大模型的決定性優勢 。

這標志著空間智能領域一個新紀元的開始:以真實數據為基石 , 從底層重建走向頂層 AIGC 應用的路徑被正式打通 。

隨著如視這樣的空間數據巨頭不斷推動技術演進和生態開放 , 一個萬物可計算、虛實深度融合的未來 , 正加速向我們走來 。

推薦閱讀

- 絢星智慧科技發布《AI驅動的組織與業務重構白皮書》

- 華為官宣MatePad Edge二合一平板 定檔11月25日發布

- 華為Mate X7四配色官圖發布:獨一無二新設計 最強辨識度

- 麒麟9030發布前,最強的華為手機處理器有哪些?一文看懂花系新U性能排名

- 華為Mate X7 11月25日發布:滿血麒麟9030 最強影像折疊屏

- 夸克全面接入千問對話助手,將發布全新AI瀏覽器

- 英偉達周四凌晨發布第三財季財報 預計營收將超過500億美元

- 榮耀新機官宣:小直屏+全新外觀,即將發布

- 華為新一代旗艦機官宣:11月25日,正式發布

- 賽昉科技發布首款基于RISC-V架構的數據中心管理芯片