文章圖片

文章圖片

文章圖片

文章圖片

【導讀】人類的大腦 , 會在夢里篩選記憶 。 如今 , AI也開始學會在「睡眠」中整理、保存 , 甚至遺忘 。 Bilt部署數百萬智能體 , 讓科幻小說里的設問——「仿生人會夢見電子羊嗎?」——逐步成真 。 那么 , 當AI也能選擇忘記時 , 它會變得更像人 , 還是更陌生?

幾十年前 , 菲利普·迪克提出了一個看似荒誕 , 卻直擊人心的問題:

「仿生人會夢見電子羊嗎?」

如果機器也能做夢 , 它們夢見的 , 會不會是人類記憶的殘影?

半個世紀后 , 這個問題正在以另一種方式被回應 。

人類在睡眠中整理記憶 , 而今天 , 一些AI也開始「學會」這樣做 。

AI也會「做夢」 , 睡眠中的記憶整理實驗對人類來說 , 睡眠不僅是休息 , 更是一次「后臺整理」 。

大腦會自動把白天的精力歸檔:記住重要的 , 忘記無關的 。

在今天 , 這個問題正在以另一種方式被回應 。

Bilt公司 , 最近部署了數百萬個AI智能體 , 并為他們安排了「睡眠時間」 。

在這段時間里 , AI會停下對話 , 啟動「睡眠計算」(sleeptime compute)的機制 , 像人腦一樣整理記憶 。

它們會評估過往的互動 , 決定哪些內容進入長期記憶庫 , 哪些放在快速提取區 。

Fast Company指出 , 這不僅是模仿人類的夢 , 更是主動智能的開端:

AI 不再被動回答 , 而是在睡眠中「預演未來」 , 在推理任務上展現出更高的效率與更低的成本

這種看似科幻的實驗 , 讓「AI會做夢」不再只是文學隱喻 , 而是正在發生的現實 。

從人腦到AI , 記憶機制的巨大差距人類大腦的記憶 , 就像一塊不斷吸水的海綿 。

這意味著 , 人類不僅能記住事情本身 , 還能帶著情緒權重來篩選信息 , 并且能在不知不覺中提煉重點 , 把情緒、場景、細節打包成長期經驗 。

而AI的大腦遠沒這么靈活 。

它們的「記憶」取決于上下文窗口——它只能調用輸入的信息 。

即便GPT-4 Turbo的上限是128k tokens , 也不過相當于幾百頁書 。

相比之下 , 人腦的容量被估算高達2.5PB(250萬GB) 。

因此 , 想讓AI記得上次說了什么 , 就需要把內容再輸入一遍 。

但問題是 , 上下文窗口長度有限 。

如果信息量太大 , AI就容易「過載」:邏輯混亂、答非所問、憑空幻覺 。

相比之下 , 人類不僅能牢牢記住重要信息 , 還能在需要時靈活調用 。

正如Letta的CEO Charles Packer所說:

人類大腦會因為不斷吸收而進化 , 但語言模型在同一個上下文里循環太久 , 只會被污染 , 越跑越偏 , 直到不得不重置 。

這意味著 , 人類的「夢境」能讓我們更清醒 , 而AI的「上下文」卻常常讓它迷失 。

Bilt+Letta , 百萬智能體的「睡眠計算」在Bilt的實驗中 , 睡眠計算是核心 。

數百萬AI智能體同時運行時 , 大部分其實都處于空閑狀態

這些智能體會在后臺進入一種「休眠」狀態 , 暫停與用戶的交互 , 轉而對過去的對話和經驗做一次系統化梳理 。

它們會自動區分兩類信息:

第一類:長期記憶 。 像用戶的偏好、歷史記錄、關鍵事件 , 這些會被牢固保存 。

第二類:快速提取 。 更短期、臨時性的信息 , 可以隨時調用 , 也能很快被替換 。

在 Letta 的演示中 , 用戶Chad的偏好最初是零碎的描述:

Chad 喜歡藍色 , 比藍色更喜歡紅色 , 最喜歡灰色 , 討厭綠色 。

經過睡眠計算后 , 這些信息被整理成清晰的偏好表 。

這就像把零散的對話記錄壓縮成一份長期「記憶檔案」 。

圖:睡眠代理整理用戶輸入的內容 , 并把用戶對顏色的喜好排序

更具顛覆性的是 , 這兩個區間并非孤立存在 。

Letta的技術支持對某一個「記憶塊」進行單點更新 , 隨后數十萬智能體的行為便會隨之改變 。

這意味著 , AI個體之間的「經驗」是可共享的 。

正如 Bilt 的工程師 Andrew Fitz 所說:

「我們可以通過一次更新 , 就讓整個系統的表現發生連鎖變化 。 」

根據Letta的介紹 , 該機制采用的是「主代理+睡眠代理」的架構 。

前者負責實時交互 , 后者在后臺持續整理記憶 , 把信息寫入共享的memory blocks , 讓AI在「醒來」后擁有更清晰、更穩定的認知 。

對此 , Fast Company評論道:

這不僅是模仿人類的夢境 , 更是「主動智能」(proactive intelligence) 的雛形 。

AI 不再只是被動回答 , 而是在睡眠中提前優化推理策略 。

實驗顯示 , 在數學和邏輯測試中 , 應用睡眠計算的模型表現更好 , 推理時間和成本也顯著下降 。

如果說人類的夢境是私密的 , 那AI的「睡眠記憶」更像是一場同步的大規模演練 。

從健忘到記憶 , AI的短板與突圍越來越多的用戶抱怨AI健忘、答非所問 , 甚至編造「回憶」 。

不少研究者認為 , 記憶缺陷是限制AI智能與穩定的根源 。

如果沒有穩定可靠的記憶 , AI無法形成真正的個性化與長期價值 。

也正因如此 , 「提高記憶力」成為行業的集體突圍方向 。

LangChain的CEO Harrison Chase把記憶視為「上下文工程的核心」 。

他認為 , AI的智能很大程度取決于開發者選擇放進上下文的信息 。

LangChain因此提供了不同的記憶存儲機制 , 從用戶長期畫像到近期交互記錄 , 都能靈活調用 。

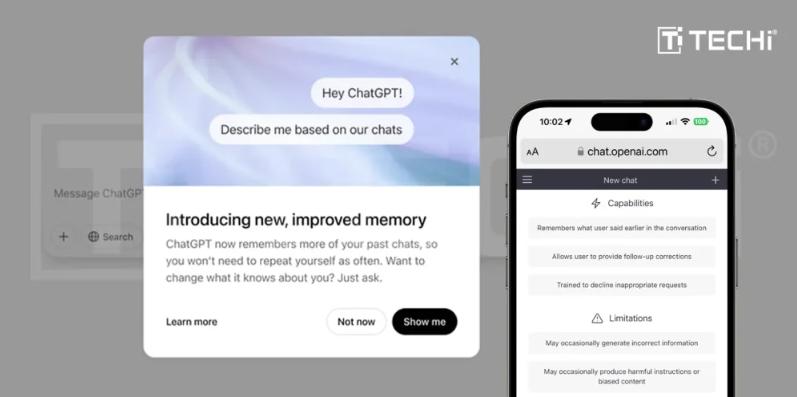

對此 , OpenAI也在嘗試 。

今年2月 , 它宣布ChatGPT將具備記憶功能 , 能在多輪對話中逐步學習用戶偏好——只不過細節并未公開 。

與此不同的是 , Letta和LangChain把「記憶回調」的過程完全透明化 , 方便工程師理解和管理 。

AI托管平臺Hugging Face的CEO Clem Delangue也強調:

「不僅模型需要開放 , 記憶系統也必須開放 。 」

MemGPT則在探索如何把短期與長期記憶區分開 , 避免AI被「污染」 。

這套思路后來被Letta進一步擴展 , 用在了大規模智能體的「睡眠計算」中 。

可以說 , 「誰先解決記憶問題 , 誰就更接近下一個AI時代」 。

學會遺忘 , AI未來的關鍵一步在大多數人眼里 , AI的進化意味著要「記住更多」 。

但Charles Packer卻提出另一種思路:

AI不僅要會記 , 還要學會忘 。

【LLM會夢到AI智能體嗎?不,是睡著了也要加班】在人類世界 , 遺忘是進化出優勢 。

研究顯示 , 睡眠中的「智能忘卻」能幫助大腦抑制無效信息 , 把注意力集中在真正重要的片段上 。

如果沒有遺忘 , 我們的大腦就會像塞滿文件的硬盤 , 總有一天會崩潰 。

而對于AI來說 , 這是它面臨的另一難題:災難性遺忘(catastrophic forgetting)

因為 , AI的神經網絡在學習新任務時 , 往往會覆蓋舊知識。

這和人類的「選擇性遺忘」不同 , 它是一種有層次的、可控的機制 。

因此 , 未來的 AI 需要發展出「人工遺忘」 。

當用戶對AI說「把那個項目刪掉 , 不要再記了」 , 未來AI的回應不止是停止調用這段記憶 , 還能追溯性地清除所有相關內容 。

即使是AI , 也必須學會刪除涉及敏感或過時的信息 。

在歐洲 , 「被遺忘權(Right to Be Forgotten)」已寫進隱私法規 。

這不僅是技術挑戰 , 更是倫理問題 。

那么 , 誰有權利決定AI記得什么、忘記什么?

當遺忘成為可能 , 它會帶來更安全的使用體驗 , 還是新的操控手段?

或許 , 真正讓AI更像人的 , 不是「永不遺忘」 , 而是「學會遺忘」 。

參考資料:

https://www.wired.com/story/sleeptime-compute-chatbots-memory/

https://www.fastcompany.com/91368307/why-sleep-time-compute-is-the-next-big-leap-in-ai?utm_source=chatgpt.com

https://www.letta.com/blog/sleep-time-compute?utm_source=chatgpt.com

本文來自微信公眾號“新智元” , 編輯:傾傾 , 36氪經授權發布 。

推薦閱讀

- 從「會說」邁向「會做」,LLM下半場:Agentic強化學習范式綜述

- 看完TCL秋季發布會,我有換電視的沖動

- 誰說Scaling Law到頭了?新研究:每一步的微小提升會帶來指數級增長

- 看完魅族今天的發布會,魅友們不知該高興還是難過

- 蘋果提醒:安裝iOS 26后會發熱、續航差 幾天內恢復

- 多項“黑科技”產品集體亮相 中國銀聯首次以獨立展臺參展服貿會

- 從「對口型」到「會表演」,剛進化的可靈AI數字人,技術公開了

- 魅族今天的發布會,最后這價格把我整不會了

- 外灘大會看未來生活丨前沿科技照進現實,交流、餐飲、出行場景都將改變

- AI重塑未來銀行,來自外灘大會的業界聲音