文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

大家一直在擔心:AI越來越燒錢 , ChatGPT的訂閱費會不會年年漲?

更讓人頭疼的 , 是用AI時越來越容易卡頓、掉鏈子 。

罪魁禍首 , 其實是芯片過熱 。 隨著新一代AI芯片瘋狂堆算力 , 傳統風冷和冷板都快壓不住了 。

就在剛剛 , 微軟CEO Satya Nadella在X上發聲:

我們正在重新想象芯片的冷卻方式 , 讓未來的 AI 基礎設施更高效、更可持續 。

這句話背后 , 是微軟剛剛公布的一項「黑科技」——把冷卻液直接送進芯片體內的微小通道 , 讓散熱效率最高提升三倍 。

它的出現 , 或許正是打破「熱瓶頸」的關鍵 。

芯片體內的冷卻液:微軟的液體血管方案AI正在變得越來越「燙」 。

模型規模膨脹 , 算力需求暴漲 , 背后的芯片像一臺臺發動機在高溫下狂奔 。

風冷、液冷、冷板 , 這些過去還能頂住的散熱方式 , 如今都快被逼到極限 。

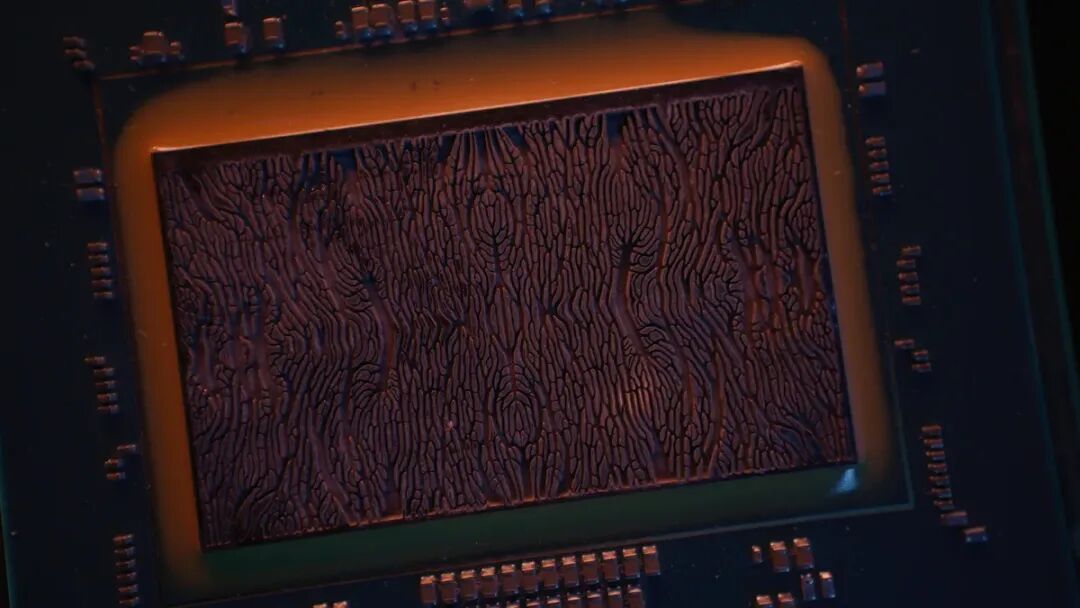

微軟在最近公布的一項實驗里 , 直接把冷卻液送進了芯片體內 , 在硅片背面蝕刻出比頭發絲還細的溝槽 , 讓液體像血管一樣流過 , 把熱量從源頭帶走 。

這種聽起來像科幻的「微流體冷卻」 , 實驗結果相當驚人 。

在微軟披露的數據里 , 它的散熱效率最高比冷板強三倍 , GPU內部的溫升能下降65% 。

對工程師來說 , 這意味著在同樣的硬件上 , 可以撐住更大的負載 , 而不會因為溫度過高被迫降頻甚至宕機 。

走到這一步并不容易 。

微軟團隊在一年里連續做了四輪迭代 , 才摸索出既不會堵塞又能保證芯片強度的微通道設計 。

微軟Cloud Operations and Innovation的系統技術總監Husam Alissa直言:

開發微流體冷卻 , 必須用系統思維來理解——硅片、冷卻液、服務器、整個數據中心的交互 。

Husam Alissa , 微軟云運營與創新系統技術總監 。

為了讓冷卻液更精準覆蓋芯片熱點 , 研究人員借助AI設計出仿生結構 , 像葉脈一樣分支 , 效率遠超直線通道 。

微軟還與瑞士初創公司Corintis合作 , 解決了蝕刻、封裝、防漏液等一系列工程難題 。

數據亮眼 , 但最終還要靠真實負載來驗證 。

微軟選擇了自家Teams作為測試場景 。

每到整點或半點 , 會議量暴增 , 服務器瞬間高負載 。 傳統散熱方案下 , 要么堆更多閑置硬件 , 要么冒險讓芯片持續高溫 。

微流體冷卻則讓另一種可能出現:在關鍵時刻安全地「超頻」 , 頂住需求高峰 。

【一年4次迭代,狂堆GPU成真,微軟AI冷液灌芯,散熱暴漲3倍】微軟技術研究員Jim Kleewein總結道:

微流體冷卻提升了成本、可靠性、速度、可持續性……幾乎所有關鍵指標 。

當冷卻液真正流進芯片「血管」 , AI的下一步擴展才有了新的底氣 。

芯片越來越燙 , AI還撐得住嗎?AI的「發燒」并不是比喻 , 而是真實的物理現象 。

每一代算力芯片都在推高功耗 , 從幾百瓦到上千瓦 , 熱量像滾雪球一樣堆積 。

過去數據中心還能用風冷、冷板頂住 , 但在今天的AI峰值負載下 , 這些技術逐漸捉襟見肘 。

正如微軟項目負責人Sashi Majety警告的那樣:

在五年之內 , 如果你還主要依賴冷板技術 , 你就被困住了 。

背后的原因不難理解 。

以數據中心整體能耗為例 , 國際能源署(IEA)在報告中預測:全球為滿足數據中心的用電需求 , 電力供給將從2024年的約460TWh增長 , 至2030年超過1000TWh 。

也就是說 , 數據中心整體的電力需求有可能在六年左右翻倍 。

再看美國本土的數據:據美國國會研究服務處(CRS)報告 , 2023年美國數據中心的用電量約為176TWh , 占當年美國電力總消耗的4.4% 。

若在未來幾年按趨勢繼續擴張 , 那么支撐如此龐大規模的冷卻系統 , 也將占據極大的基礎設施能耗預算 。

冷板散熱的問題在于熱阻與傳導損耗 。

芯片封裝層和界面材料存在熱阻 , 使得熱量向外傳遞時效率大打折扣 。

隨著芯片功率密度提升 , 這些「中間層」的阻礙越嚴重 , 熱量往往被困在芯片里 。

結果就是:為了避免芯片因溫度過高降頻或損傷 , 廠商不得不在設計里留足余量 , 或者限制性能輸出 。

更糟的是 , 為了讓冷板工作得更好 , 數據中心不得不把冷卻液溫度壓得更低 。

制冷所需的能耗自身就是一筆不能忽略的開銷 。 比如有些大型數據中心用于制冷系統的電力消耗就占了整體能耗的顯著比例 。

在這種規模下 , 效率的重要性被放大到了極致 。

微軟Azure數據中心部門硬件系統與基礎設施副總裁Rani Borkar在接受采訪時直言:

當你達到那種規模時 , 效率非常重要 。

這句話 , 道出了整個行業的心聲:誰能先把效率做上去 , 誰就能在下一個算力周期占據主動 。

從省錢到不卡頓:微軟降溫技術的真實影響聽起來 , 微流體冷卻像是工程師們的游戲 , 可它和我們每個人用AI的體驗 , 其實都有影響 。

省下的電費 , 可能就是會員費

訓練、運行大模型 , 本身就是一場燒錢的游戲 。

AI模型運行 , 尤其是在云端實時推理時 , 本質上是耗電的 。

一篇行業研究 , 就對比了不同規模大語言模型的推理能耗 , 揭示模型越大、推理越頻繁 , 消耗越顯著 。

如果散熱效率上不去 , 數據中心就只能增加冷卻系統或降頻運行 , 這些成本最終會壓到產品定價上 。

微軟內部新聞稿里也曾提到 , 微流體冷卻可讓芯片內部溫升下降65% , 散熱效率最高比冷板提高三倍 。

這意味著在同等環境下 , 可以用更低成本維持性能 。

不再做耗電怪獸 , AI也能更綠色

AI的推廣伴隨著巨大的電力需求 。

MIT在一篇報道中列出 , 生成式AI的普及 , 讓數據中心電力、用水等資源受到壓力 。

數據中心曾經被比作「能耗怪獸」 , 在某些區域 , 它們的電力需求可相當于成千上萬個家庭 。

如果冷卻技術更高效 , 就可能讓制冷系統的能耗不再占比那么大 , 從而減少總能耗和碳排放 。

更有意思的是 , 微軟實驗發現 , 即使冷卻液溫度高達70℃ , 微流體冷卻依然能保持高效工作 。

這意味著它不需要像傳統冷卻方案那樣把冷卻液降到極低溫 , 從源頭上就節省了大量能耗 。

這對企業是ESG標簽 , 對用戶來說 , 就是每一次AI使用 , 都可能少點環境負擔 。

從排隊到秒出圖:冷卻液背后的體驗升級

你肯定遇到過這樣情況:視頻會議突然卡頓 , AI圖像生成慢得像烏龜 , 或者模型推理慢半拍 。

這些問題部分來源正是因為芯片過熱后 , 被迫降頻或延遲處理 。

微軟在測試里 , 就選擇了自家的Teams作為實驗對象 。

有趣的是 , Teams的流量并不是平均分布的 。

大多數會議都在整點或半點開始 , 結果就是:在那前后幾分鐘 , 控制會議的服務器會被瞬間「擠爆」 , 負載陡然飆升 。

傳統散熱下 , 要么得額外堆很多硬件來對付短短幾分鐘的高峰 , 要么冒險讓芯片長時間高溫運行 。

微流體冷卻給了另一種可能:在這些高峰時段安全地「超頻」 , 讓同樣的硬件也能撐住需求暴漲 。

對用戶來說 , 最直觀的變化就是會議不卡了、響應快了 , 不必擔心在關鍵時刻掉鏈子 。

微軟的算盤:不只是降溫 , 而是搶跑未來讓「冷卻液流進芯片」這種聽起來科幻的技術落地 , 本身就足夠震撼 。

但對微軟來說 , 這不過是一場更大博弈中的第一招 。 微軟真正的目標 , 其實是搶占AI基礎設施的未來入口 。

從資本支出來看 , 它的野心毫不遮掩 。

微軟2025財年第四季度的財報顯示 , 單季資本支出就達到242億美元 , 其中大部分直接投向云和AI基礎設施 。

此外 , 有媒體報道微軟計劃在即將到來的季度投入超過300億美元用于擴容云與AI基礎設施 。

這已經不只是「砸錢」 , 而是在為未來二十年的算力格局修地基 。

到目前為止 , 微軟已經推出了Cobalt 100和Maia兩款自研芯片 , 分別用于通用計算和AI加速 。

如果說微流體冷卻是解決「熱」的手段 , 那么自研芯片就是把控制權牢牢抓在自己手里——既能減輕對英偉達的依賴 , 又能讓冷卻、架構和軟件層級深度耦合 。

在網絡層面 , 微軟也沒停下腳步 。

比如支持空心光纖 (hollow-core fiber) 的研究 , 讓光信號傳輸損耗降到歷史最低(約 0.091 dB/km) , 被視為光纖領域的一次突破 。

對普通用戶來說這聽起來抽象 , 但放在數據中心就是:服務器節點之間可以更快交流、更少能耗 , AI的反應也更及時 。

除了芯片和網絡 , 微軟還把目光放在了內存上 。

Borkar在采訪中提到 , 高帶寬內存(HBM)是當下AI計算的關鍵瓶頸之一 , 目前微軟的Maia芯片仍依賴商業化HBM , 但未來它們也在探索更多自研和優化的可能性 。

這說明微軟的棋局 , 遠不止散熱和芯片 , 還在悄悄補齊整個算力堆棧 。

把這些拼圖放在一起看 , 我們會發現微軟走的是「三線作戰」:散熱技術解決硬件的物理瓶頸 , 自研芯片降低外部依賴 , 網絡革新打通節點之間的傳輸效率 。

它要建的不僅是一個更冷靜的數據中心 , 而是一套能撐住下一代AI擴張的完整生態 。

放眼全行業 , 這是一場沒有硝煙的軍備競賽 。

谷歌用液浸式冷卻守住TPU , 亞馬遜靠Graviton和Trainium爭奪市場 , Meta在GPU堆砌上不惜血本 。

微軟選擇的切口 , 是在「熱」這個大家都頭疼的問題上先行一步 , 把優勢轉化為戰略籌碼 。

所以 , 當我們在前端用AI聊天、畫畫、開會時 , 其實背后是巨頭們在拼命加碼基礎設施 。

微軟這次的微流體冷卻 , 并不是終點 , 而是它為未來搶跑的一次「降溫起跑」 。

AI的未來 , 是一場與「熱」的賽跑 。

模型越大 , 芯片越熱 , 能耗越驚人 。

微軟這次把冷卻液送進芯片體內 , 不只是解決眼前的散熱難題 , 更是在給整個行業探路:如果熱量能被馴服 , 算力的天花板就能再抬高一層 。

從實驗室到數據中心 , 從資本開支到自研芯片 , 微軟已經把「冷靜」寫進了自己的基礎設施戰略 。

因為它很清楚——誰先跨過熱的瓶頸 , 誰就更可能主宰下一階段的算力格局 。

當AI越來越「發燒」 , 能讓它冷靜下來的 , 或許正是下一輪競賽的分水嶺 。

參考資料:

https://x.com/satyanadella/status/1970505474601820212

https://news.microsoft.com/source/features/innovation/microfluidics-liquid-cooling-ai-chips/

https://www.bloomberg.com/news/articles/2025-09-23/microsoft-msft-is-turning-to-the-field-of-microfluidics-to-cool-down-ai-chips?srnd=phx-technology

本文來自微信公眾號“新智元” , 作者:新智元 , 編輯:傾傾 , 36氪經授權發布 。

推薦閱讀

- 一年4次迭代,狂堆GPU成真!微軟AI冷液灌芯,散熱暴漲3倍

- ?一年賣出 10 個億,這是年輕人真正的「戶外神器」

- AI芯片獨角獸一年估值翻番,放話“三年超英偉達”,最新融資53億超預期

- 拿下超4億融資,一年營收增長10倍!英偉達投了這家AI代碼審查創企

- 量產半年即迭代,海信RGB-Mini LED直面全球競爭

- 對話聯想德國業務負責人:一年月200億營收背后的生意經

- 微信客服回應賬號回收政策:超一年未登錄賬號將被清空所有數據

- 4.7英寸的小屏手機,藍狐提前一年開啟預熱

- 一年就放棄!庫克在iPhone16上,“創新”了一個最無用的功能?

- 產品力炸裂?紅米Note15Pro+詳細匯總,縫縫補補又是一年