文章圖片

文章圖片

文章圖片

智東西9月26日報道 , 今天 , 谷歌DeepMind推出Gemini Robotics 1.5系列機器人模型 , 通過思維鏈機制和模型協作 , 進一步提升機器人的自主性 , 使其能夠感知、計劃、思考、使用工具和行動 , 以更好地解決復雜的多步驟任務 。 谷歌將其稱之為把AI agents帶入物理世界的重要一步 。

谷歌DeepMind本次發布的兩款模型分別為Gemini Robotics 1.5和Gemini Robotics-ER 1.5 。 前者是谷歌目前最強大的VLA(視覺-語言-動作)模型 , 能將視覺信息和文本指令轉化為機器人的控制命令 , 主要充當機器人的小腦 。 這一模型在采取行動前會思考 , 并展示思考過程 , 還能在不同的機器人本體上進行學習 , 提升學習效率 。

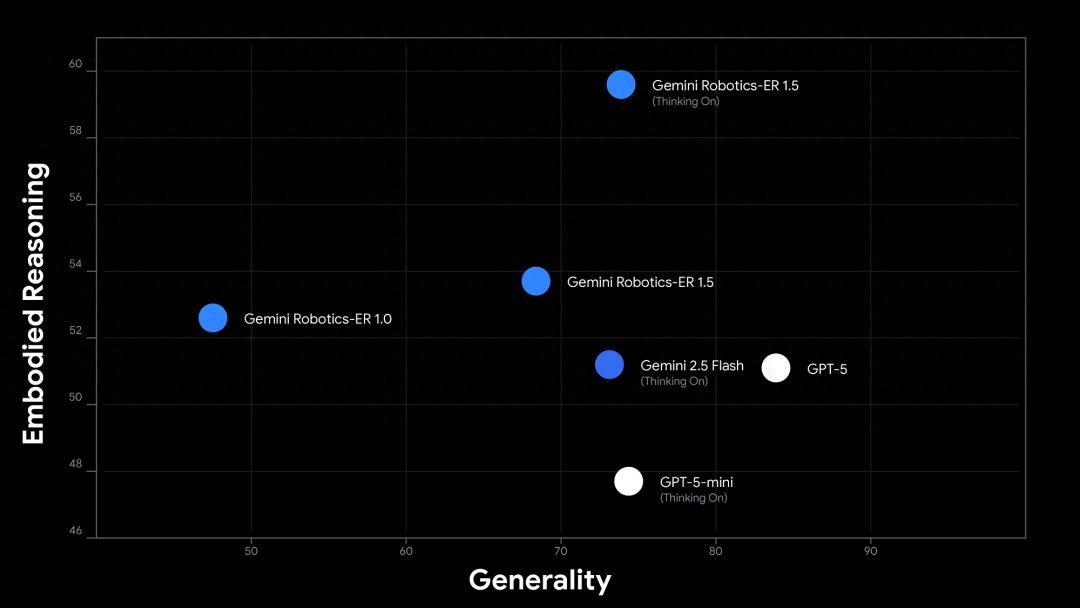

Gemini Robotics-ER 1.5則是谷歌迄今為止最強大的VLM模型(視覺語言模型) , 能對物理世界進行推理 , 更像是機器人的大腦 。 它原生具備調用數字工具并創建詳細的多步驟計劃 , 進而完成任務的能力 。 該模型在空間理解基準測試中實現了最先進的性能 , 具身推理能力遠超GPT-5、Gemini 2.5 Flash等模型 。

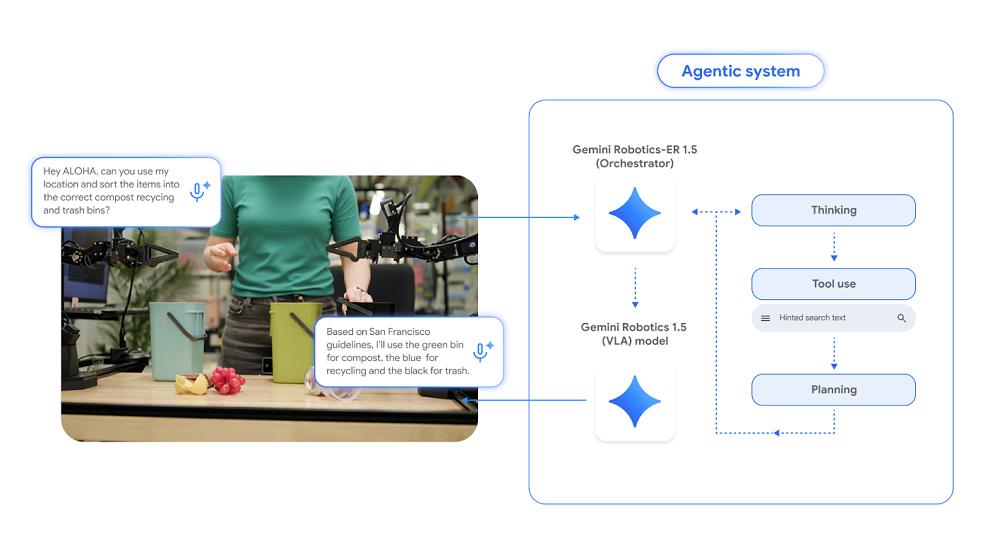

搭載上述兩款新模型的機器人 , 也因此解鎖了完成復雜長鏈路任務的能力 。 比如 , 你可以讓機器人查詢當地垃圾分類要求 , 將桌面上的物品放到正確的垃圾桶中 。 模型能準確理解這一復雜需求 , 并驅動機器人完成任務 。

開發者可以通過Google AI Studio中的Gemini API使用Gemini Robotics-ER 1.5模型 , 而Gemini Robotics 1.5目前可供部分合作伙伴使用 。 谷歌還發布了Gemini Robotics 1.5系列模型的技術報告 。

技術報告:

https://storage.googleapis.com/deepmind-media/gemini-robotics/Gemini-Robotics-1-5-Tech-Report.pdf

模型鏈接:

https://deepmind.google/models/gemini-robotics/gemini-robotics/

01.基于Gemini基礎模型打造 , 訓練數據來自3款機器人對機器人而言 , 大多數日常任務都需要上下文信息和多個步驟才能完成 , 這對目前的機器人而言頗具挑戰 。 為了幫助機器人完成復雜、多步驟的任務 , 谷歌DeepMind讓Gemini Robotics 1.5和Gemini Robotics-ER 1.5兩款模型在同一個Agent框架中協同工作 。

具身推理模型Gemini Robotics-ER 1.5像大腦一樣協調機器人的活動 。 該模型擅長在物理環境中進行規劃和做出邏輯決策 , 也具有先進的空間理解能力 , 能以自然語言與用戶進行交互 , 對任務是否成功和任務進展進行評判 , 并且可以調用谷歌搜索等工具來查找信息 , 或使用任何第三方用戶定義的函數 。

Gemini Robotics-ER 1.5為每個步驟提供自然語言指令 , 而Gemini Robotics 1.5利用其視覺和語言理解直接執行特定動作 。 Gemini Robotics 1.5還幫助機器人思考其行動 , 以更好地解決語義復雜的任務 , 甚至可以用自然語言解釋其思維過程 , 使其決策更加透明 。

這兩個模型都建立在Gemini系列模型之上 , 這使得它們能夠繼承Gemini的多模態世界知識、先進推理以及工具使用的通用能力 。 之后 , 兩款模型使用不同的數據集進行了微調 , 以專注于各自的角色 。 當它們結合起來時 , 可以提高機器人泛化到長任務和多樣化的環境的能力 。

Gemini Robotics 1.5系列模型共同使用的訓練數據集由三種模態組成:圖像、文本 , 以及機器人傳感器與動作數據 。

訓練所用的機器人數據集是多本體(multi-embodiment)的 , 涵蓋了數千個多樣化任務 , 從抓取與操控 , 到雙臂協作 , 再到人形機器人執行日常復雜任務 。 這些數據采集自多個異構機器人平臺 , 包括ALOHA、Bi-arm Franka和Apollo人形機器人 。

Gemini Robotics 1.5系列模型能開箱即用地完成跨本體任務

除了機器人專屬數據集 , 訓練數據中還包括來自互聯網的公開文本、圖像和視頻數據集 , 使得模型不僅具備機器人相關技能 , 還能借助大規模世界知識提升泛化能力 。

為了確保訓練的高質量與安全性 , 所有數據在使用前必須經過嚴格處理 。 谷歌DeepMind通過多階段篩選 , 確保數據遵循相關政策 , 去除低質量樣本與不符合規范的內容 。

數據集中每張圖像都配備了原始描述與合成描述 , 這些合成描述由Gemini和FlexCap模型生成 , 幫助模型捕捉圖像中的細節與上下文語義 。

訓練過程中使用了最新一代硬件 , 包括TPU v4、v5p與v6e , 并結合JAX與ML Pathways框架 , 以實現高效并行訓練與跨平臺擴展 。

02.靠動作遷移機制實現跨本體 , 讓機器人學會“三思而后行”作為一款VLA模型 , Gemini Robotics 1.5的使命是“理解指令并將其轉化為動作” 。 為了實現這一目標 , 研究者在訓練中引入了一個關鍵機制——動作遷移(Motion Transfer MT) 。

MT的作用是打破不同機器人之間的“壁壘” 。 在傳統方法中 , 如果一個機器人學會了某項技能 , 往往需要額外訓練才能遷移到另一個機器人 。

而在MT的加持下 , Gemini Robotics 1.5能夠在不同實體之間直接實現零樣本遷移(Zero-shot Transfer) 。 也就是說 , 即便模型只在ALOHA機器人平臺上學過“打開抽屜” , 它也能在Apollo人形機器人上完成同樣的任務 。

這一能力來自于MT機制對動作與物理的統一建模 , 它能對齊不同平臺的數據并提取其中的共性 。

除此之外 , Gemini Robotics 1.5還具備了具身思考(Embodied Thinking)的能力 。 它在執行動作之前 , 會生成一條以自然語言形式呈現的“思考軌跡” 。 這條軌跡幫助模型將復雜任務拆解為更細致的步驟 。

例如 , 當接到“幫我收拾桌子”的指令時 , 模型可能會先在思考中分解為“拿起杯子”、“移動到水槽”、“放下杯子”等小步驟 。 這種方式不僅降低了從語言到動作的直接映射難度 , 也讓模型在執行過程中更具魯棒性 。

如果杯子在移動過程中掉落 , 它會立刻調整思考軌跡 , 改為“重新拾起杯子” , 而不是簡單判定任務失敗 。

與Gemini Robotics 1.5不同 , Gemini Robotics-ER 1.5并不直接操控機器人執行具體動作 , 而是專注于具身推理(Embodied Reasoning) , 負責高層次的任務規劃與決策 。

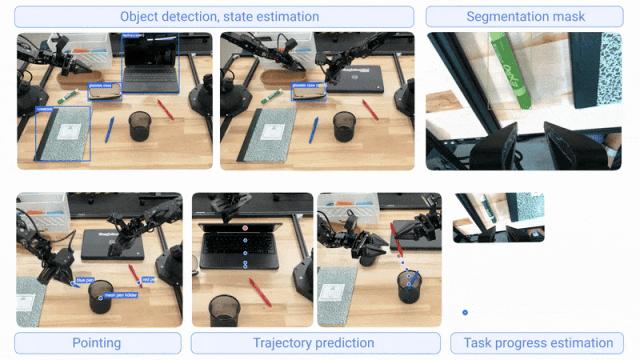

在訓練中 , Gemini Robotics-ER 1.5針對機器人任務所需的關鍵能力進行了特別優化 。 首先 , 它能夠完成復雜的任務規劃 , 把長遠目標拆解成一系列合理的子任務 。

其次 , 它具備較強的空間推理能力 , 可以結合視覺與時間信息 , 理解物體的相對位置與運動軌跡 。 最后 , 它還能夠進行任務進度估計 , 實時判斷任務是否成功、完成度如何 , 并據此調整后續動作 。

Gemini Robotics-ER 1.5能完成的部分任務

Gemini Robotics-ER 1.5在15個學術具身推理基準測試中實現了最高的綜合性能 , 超過Gemini Robotics-ER 1.0和GPT-5等模型 。

它能夠將語言描述準確地映射到視覺目標上 , 比如“指向桌子左下角的藍色杯子” , 或是基于多視角信息實時判斷機器人動作是否達成目標 , 這對長序列任務的穩定執行至關重要 。

在整個體系中 , Gemini Robotics-ER 1.5的定位是編排器(Orchestrator) 。 它接收人類指令與環境反饋 , 制定總體計劃 , 再將這些計劃轉化為Gemini Robotics 1.5能執行的具體動作指令 。 它還具備調用外部工具(如網絡搜索)的能力 , 確保機器人在面對復雜場景時依舊能夠靈活應對 。

不過 , 具備更高自主性和執行能力的機器人 , 也可能帶來安全風險 。 為此 , 谷歌DeepMind已經開發了新型的安全和對齊方法 , 包括頂層的安全判斷機制和更為底層的安全子系統(如用于避免碰撞的系統) 。

谷歌DeepMind還發布了機器人安全基準測試ASIMOV的升級版 , 這是一個用于評估和改進語義安全性的綜合數據集 , 具有更好的邊緣場景覆蓋率、改進的注釋、新的安全問題類型和新的視頻模式 。

在ASIMOV基準測試中 , Gemini Robotics-ER 1.5顯示出最先進的性能 , 其思維能力極大地有助于提高對語義安全的理解 , 更好地遵守物理安全約束 。

03.結語:機器人模型跨本體化共識逐漸形成與傳統依賴單一數據和特定平臺的訓練方式不同 , Gemini Robotics 1.5系列模型通過多本體數據、動作遷移機制 , 以及具身思考與推理范式 , 讓機器人能夠跨平臺遷移技能 , 并在復雜環境中展現出類似人類的適應能力 , 擴展了機器人模型的通用性 。

而這也成為不少廠商打造機器人模型的目標之一 。 日前 , 宇樹開源的機器人世界大模型UnifoLM-WMA-0 , 雖采取了不同的架構 , 但也同樣具備適配多種機器人本體的能力 。 跨本體化 , 或許已經逐漸成為行業的共識與新賽道 。

【谷歌掏出自家最強機器人大腦,一句話完成垃圾分類,關鍵技術解析來了】本文來自微信公眾號“智東西”(ID:zhidxcom) , 作者:陳駿達 , 編輯:云鵬 , 36氪經授權發布 。

推薦閱讀

- 全面對標iPhone17系的小米17系,為什么不用自家的玄戒芯片?

- 谷歌讓AI更易獲取真實世界數據

- 剛剛谷歌發布機器人最新大腦模型!思考能力SOTA,還能跨物種學習

- 谷歌透露將開發Android PC!高通CEO:我親眼見過、太不可思議了

- 剛剛,高通掏出旗艦芯片王炸,小米今晚搶首發,PC芯80TOPS算力飆漲

- 被迫開放搜索數據,谷歌的渡劫宣告失敗

- 谷歌透露基于安卓的PC項目 高通CEO點贊:不可思議

- 谷歌Gemini人工智能助手將登陸電視端 預計覆蓋超3億臺設備

- 谷歌Gemini IMO和ICPC奪金功臣之一被xAI挖走,馬斯克直呼:起飛

- Nano Banana首款官方應用,谷歌全新AI畫板工具來了