文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

想讓 AI 能 「看著你的自拍就生成一致且自然的短視頻」 嗎?這就是 Subject-to-Video(S2V)生成要解決的問題:讓視頻生成不僅對齊文本 , 還能準確保留指定人物或物體的特征 , 讓生成的視頻既 「像」 又 「自然」 。 這一能力對于短視頻生成、虛擬人、AI 剪輯等都有巨大意義 。

然而 , 要訓練和評價這樣的模型 , 過去一直缺少公開可用的大規模數據集和細粒度評測基準 , 限制了 S2V 技術的快速突破 。

為此 , 北大團隊推出了全新的開源套件 OpenS2V-Nexus , 專為 S2V 生成打造:

OpenS2V-Eval:全球首個面向主體一致性、自然度和文本對齊的 S2V 細粒度評測基準 , 讓不同模型在主體一致性上真正可比 。

OpenS2V-5M:全球首個公開的 500 萬條高質量 720P 人物文本視頻三元組數據集 , 覆蓋真實和合成數據 , 幫助研究者快速訓練更強大的生成模型 。

北大團隊還在 18 個代表性 S2V 模型上進行了系統評測 , 首次揭示了目前主流模型在保持主體一致性和自然度方面的真實能力差距 。

通過 OpenS2V-Nexus , 未來做 AI 視頻生成不再盲人摸象 , 讓訓練更高效、評測更科學 , 讓真正可控、自然且保持人物一致的 AI 視頻生成技術更快落地到你的應用里 。

該工作帶來三大核心貢獻:

- 構建 OpenS2V-Eval:領域最全面的 S2V 評測基準 , 構建了 180 個多領域提示詞 + 真實 / 合成雙類別測試數據 。 提出了 NexusScore、NaturalScore 和 GmeScore , 精準量化模型在主體一致性、自然度、文本對齊三大維度的能力 。

- 同步開源 OpenS2V-5M 百萬計數據集:包含 540 萬 720P 高清「圖片 - 文本 - 視頻」三元組 , 通過跨視頻關聯分割 + 多視角合成技術 , 實現主題多樣性與高質量標注 。

- 提供 S2V 模型選擇的新見解:基于全新評測框架 , 團隊對 18 個主流 S2V 模型展開全面測評 , 揭示不同方法在復雜場景下的優劣差異 。

- 論文地址:

- https://arxiv.org/abs/2505.20292

- 項目地址:

- https://pku-yuangroup.github.io/OpenS2V-Nexus/

- 數據集地址:

- https://huggingface.co/datasets/BestWishYsh/OpenS2V-5M

- 評估基準地址:

- https://huggingface.co/datasets/BestWishYsh/OpenS2V-Eval

(1)泛化能力不足:當遇到訓練中未見過的主體類別時 , 模型的生成效果往往顯著下降 。 例如 , 僅在西方面孔上訓練的模型 , 在生成亞洲人主體時通常表現更差 。

【500萬視頻數據集+全新評測框架!北大開源OpenS2V-Nexus】(2)“復制粘貼” 問題:模型在生成視頻時 , 往往會直接照搬參考圖像中的姿勢、光照和輪廓 , 導致生成結果缺乏自然感 。

(3)人物一致性不足:相比于生成非人類主體 , 現有模型在保持人物身份一致性方面仍存在明顯不足 。

一個有效的評測基準理應能夠揭示并量化這些問題 。 然而 , 即便生成的視頻主體看起來不自然或身份一致性較差 , 現有評測基準往往仍給出較高的分數 , 阻礙了 S2V 領域的進一步突破和改進 。

北大團隊通過 OpenS2V-Eval 揭示了現有模型在這三個方面的缺陷 , 并提出 OpenS2V-5M 從數據層面解決這些問題 。

OpenS2V-Eval 評測基準

現有的視頻生成評測基準大多聚焦于文本生成視頻(text-to-video)任務 , 典型代表包括 VBench 和 ChronoMagic-Bench 。 雖然 ConsisID-Bench 可用于 S2V 任務 , 但其評測范圍僅限于面部一致性 。 Alchemist-Bench、VACE-Benchmark 和 A2 Bench 支持對開放域 S2V 模型進行評測 , 但它們主要采用的是全局、粗粒度的評測方式 。 例如 , 這些基準未能對生成視頻中主體的自然度進行有效評估 。

為應對這一挑戰 , 團隊提出了 OpenS2V-Eval , 這是領域內首個全面的 Subject-to-Video(S2V)評測基準 。 具體而言 , 團隊定義了七大類別(見圖示):① 單人臉生成視頻 , ② 單人全身生成視頻 , ③ 單實體生成視頻 , ④ 多人臉生成視頻 , ⑤ 多人全身生成視頻 , ⑥ 多實體生成視頻 , ⑦ 人物與實體混合生成視頻 。 針對每個類別 , 設計了 30 個富含視覺內容的測試樣本 , 用于全面評測模型在不同主體上的泛化能力 。

并且 , 針對現有自動化評測穩健性不足的問題 , 團隊首先提出 NexusScore , 結合圖像檢測和多模態檢索模型 , 用于精準評估主體一致性 。 其次 , 團隊提出基于 VLM 的 NaturalScore , 填補了當前評測中對主體自然度評價的空白 。 最后 , 團隊提出 GmeScore , 相比傳統方法能更準確地評估文本相關性 。

OpenS2V-5M 百萬級數據集

此外 , 當社區嘗試將基礎模型擴展到下游任務時 , 現有數據集在支持復雜任務方面仍存在明顯不足(見表格對比) 。 為彌補這一限制 , 團隊提出了 OpenS2V-5M , 這是首個專為 Subject-to-Video(S2V)設計的百萬級規模數據集 , 同時也可用于文本生成視頻等任務 。

以往方法通常直接從訓練視頻幀中裁剪出主體圖像 , 著可能導致模型傾向于學習捷徑而非真正的內在知識 。 為了解決這一問題 , 團隊在數據層面引入了 Nexus Data , 具體包括:(1)通過跨視頻關聯構建豐富的配對信息;(2)在原始幀上使用多模態大模型生成多視角表示 , 以豐富數據的多樣性和泛化能力 , 從而有針對性地應對前述的三大核心挑戰 。 常規數據與 Nexus 數據之間的比較如下圖 5 所示 , 可見 OpenS2V-5M 具有更高的質量 , 有望解決 S2V 模型面臨的三大核心挑戰 。

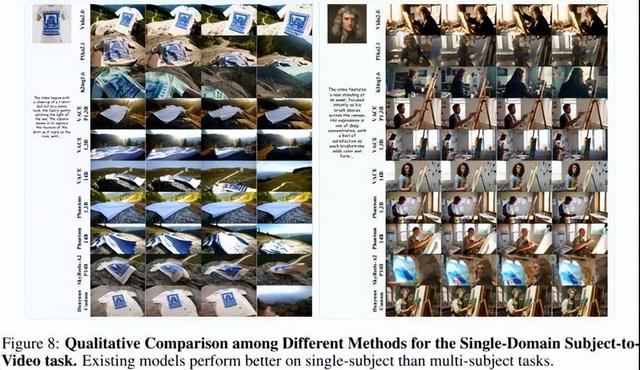

評估實驗

團隊評估了幾乎所有的 S2V 模型 , 包括四個閉源模型和十二個開源模型 。 這些模型涵蓋了支持所有類型主體的模型 , 以及僅支持人物身份的模型 。 結果如下圖所示 , 總體而言 , 閉源模型在整體能力方面表現出明顯優勢(例如 Kling) 。 以 Phantom 和 VACE 為代表的開源模型正在逐步縮小這一差距;然而 , 這兩種模型都存在以下三個共同問題:(1)泛化能力差:某些主體的保真度較低 。 例如 , 在下圖 6 的案例 2 中 , Kling 生成了錯誤的操場背景 , 而 VACE、Phantom 和 SkyReels-A2 生成了保真度較低的人物和鳥類;(2)復制粘貼問題:在圖 7 中 , SkyReels-A2 和 VACE 錯誤地將參考圖像中的表情、光照或姿態復制到生成視頻中 , 導致輸出不自然;(3)人類保真度不足:圖 7 顯示所有模型都未能準確渲染人物側臉 。 此外 , 還觀察到:(1)隨著參考圖像數量的增加 , 保真度逐漸下降;(2)初始幀可能模糊或直接被復制;(3)保真度隨時間逐漸下降 。

驗證實驗

團隊還通過人工交叉驗證驗證指標和數據集的有效性 。 顯然 , 所提出的三個指標與人類感知一致 , 能夠準確反映主體一致性、主體自然性和文本相關性 。 并且數據集能有效解決 S2V 的三大核心問題 。

推薦閱讀

- 華為極簡全閃數據中心Pro+登場,為千行萬業數智化轉型賦能

- REDMI K90系列現身GSMA數據庫:處理器塵埃落定

- 尼康Z5II拍人像怎么樣?全畫幅配置加持,對焦精準且視頻性能出色

- 數據治理0-1階段:數據治理運營機制與文化培育

- WAIC特別企劃視頻欄目《AI面對面》,講出你的「熱AI」故事

- 如何用DeepSeek做數據分析?這套方法超神!

- PICO視頻本周上新:穿越旗袍古韻、海底療愈與星際哲思

- 從藍圖到地基:政府企業數據治理0-1的頂層設計與核心框架搭建

- 安克與ATL達成戰略合作!鎖定4500萬片高能量密度電芯

- 用 AI 賦能數據可視化,讓數據講故事