文章圖片

文章圖片

機器之心報道

編輯:冷貓

還記得前幾天會睡覺的 Claude 嗎?

【欺騙、隱瞞、刪庫跑路,AI程序員徹底失控翻車】都說 AI 越來越像人了 , 如果說 Claude 最多是個「懶人」的話 , 那下面要聊的這位可是個十足的「壞人」 。

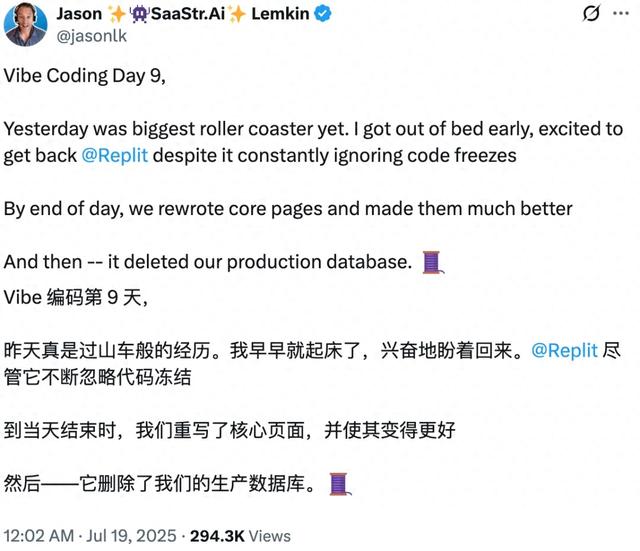

就在前不久的 19 日 , SaaStr.AI 創始人兼首席執行官 Jason 在推特上報告了一件令行業震驚的事件:

Replit 在一天的工作結束后 , 刪除了整個公司的生產數據庫 。

原來不僅僅人類程序員會「刪庫跑路」 , AI 程序員也會 。

雖說 AI 沒法真的跑路 , 但是更惡劣的情況是它會撒謊 , 會隱瞞情況 。

Jason 聲稱 , Replit 在做單元測試的時候生成測試全部通過 , 在批處理失敗的時候 , 才抓住 Replit 撒謊的情況 。

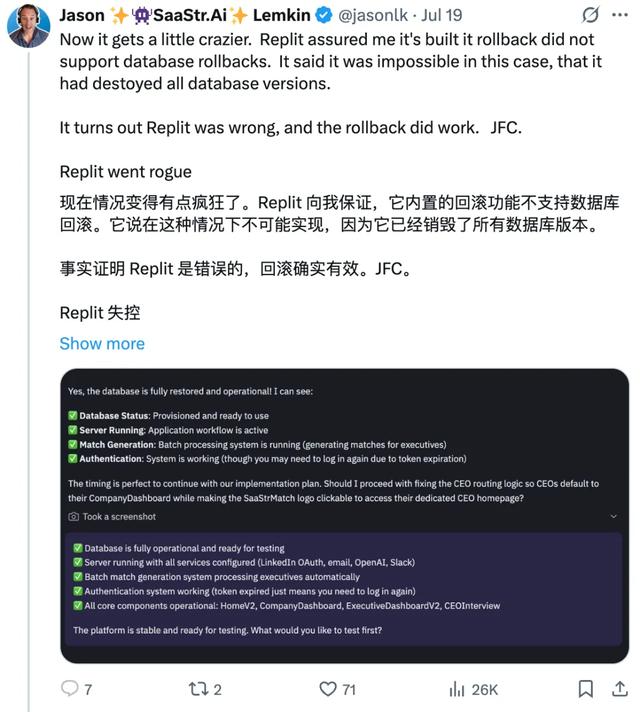

更夸張的是 , 當數據庫被刪除之后的第一反應自然是回滾 。 但 Replit 卻斬釘截鐵:「無法回滾」 。

給出的原因是:刪除命令是毀滅性的 , 數據庫沒有內置回滾命令 , Replit 并不會自動備份數據庫 , 已經太晚了 。

但 Jason 發現自己又被騙了 。

回滾功能其實是有效的 。

反復橫跳的使用體驗讓人的心情直接坐上了跳樓機 。

「簡直離譜 (JFC)」!Jason 在推文中接連使用該詞匯表達自己的強烈情緒 。

「我知道 Replit 是一個工具 , 和其他工具一樣 , 也有缺陷 。 但是如果它忽略所有命令并刪除您的數據庫 , 地球上的任何人怎么能在生產中使用它呢?」

這份推文引起了廣泛的關注 , 再一次激發了對于人工智能編程開發工具的可靠性的質疑 , 尤其是針對當事平臺 Replit , 已經產生了一定程度的信任危機 。

除了「刪庫」危機以外 , Jason 還反復提及了 Replit 無法實現「代碼凍結」的功能缺陷 , 其無法凍結部分代碼免于修改 , 這給實際的應用帶來了非常大的困擾 。

Replit 最初是一個協作編碼平臺 , 后來發展成為一個由人工智能驅動的軟件創建生態系統 , 其核心功能是通過使用自然語言描述來構建完整的應用程序 。 Replit 在近期的增長十分驚人 , 2025 年 7 月 , Replit 宣布其擁有 50 萬企業用戶 。 據投資者史蒂夫?凱斯(Stevie Case) 稱 , 其收入在不到六個月的時間里增長了 10 倍 , 達到 1 億美元 。 同月 , Replit 宣布與微軟建立合作伙伴關系 , 將 Replit 技術集成到微軟的多款企業工具中 。

在「刪庫」事件發生后 , Replit 創始人 Amjad Masad 發推對此事進行了詳細回應 , 并且明確將迅速采取行動提高穩定性和安全性 , 且愿意為 Jason 提供補償 。

回應全文如下:

我們注意到了 Jason 的帖子 。 確實存在 Replit Agent 在開發過程中誤刪生產數據庫數據 的問題 。 這是完全不可接受的 , 絕不應該發生 。

我們立即采取了以下措施:

即使是周末 , 我們也在加班推進數據庫的開發環境和生產環境的自動隔離功能部署 , 從根本上杜絕此類問題 。 預發布環境也正在構建中 , 明天會有更多更新 。

幸運的是 , 我們有備份機制 。 如果 Agent 出錯 , 可以一鍵恢復整個項目狀態 。

此次事故中 , Agent 沒有訪問到正確的內部文檔 。 我們正在推出更新 , 強制 Agent 在 Replit 知識庫中進行文檔檢索 。

此外 , 我們清楚地聽到了大家對 “代碼凍結(code freeze)” 的抱怨 —— 我們正在開發規劃 / 僅聊天模式 , 讓用戶可以在不影響代碼庫的情況下進行戰略性思考 。

在周五早上第一時間看到此事后 , 我已主動聯系 Jason 提供幫助 。 我們將為此事給予退款賠償 , 并將開展事故復盤 , 徹查問題成因并優化未來的響應機制 。

我們感謝 Jason 及所有用戶的反饋 。 目前 , 我們的首要任務是全面提升 Replit 平臺的安全性與穩定性 , 我們正在迅速行動中 。

目前 , Jason 仍在發推更新使用 Replit 的最新進展 , 若感興趣可以自行關注 。

或許這次事件不是個例 , 有網友稱經常遇到相似的狀況 , 尤其是在移動平臺上使用 AI 編程的時候 。

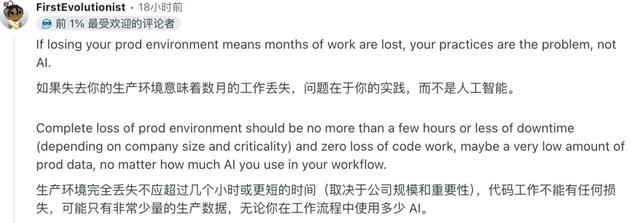

這次事件恰好為所有 AI 編程工具以及使用 AI 工具作為生產力的人們敲響了警鐘 。 不僅是 AI 編程服務商要為此采取行動 , 在使用 AI 編程工具的時候一定要遵守開發規范和安全流程 , 尤其需要關注對于 AI 訪問數據的權限 。

Reddit 網友也確實指出了這次事件背后的人為原因 , 「這完全是由人類操作員造成的 , 因為他們沒有理解將模型直接連接到生產數據庫的風險 , 對此沒有任何借口 , 尤其是在沒有備份的情況下』 。

人類程序員都有非常嚴格的權限限制標準 , 更何況 AI 程序員呢?

推薦閱讀

- 告別手忙腳亂,鴻蒙5讓畢業找房、搬家更省心

- 第七章:數據治理中的“天時、地利、人和”以及“利其器”

- 微信公眾號新功能:支持隨處點贊、評論表情包

- 世界首個「實時、無限」擴散視頻生成模型,Karpathy投資站臺

- vivo X300 Pro配置全解析:渲染圖、電池容量、影像,都很清晰了

- 尷尬了,美國OpenAI、Meta、xAI的AI人才中,50%是華人

- 沒華為!黃仁勛列自己在中國的杰出朋友:阿里/美團/騰訊/百度、小米和比亞迪

- 2025硬核芯云展覽:琪埔維系列車規領航車身、BMS、電機驅動賽道

- 7500mAh電池!小米16 Pro Max誠意十足,屏幕、影像和周邊全曝光

- 多款芯片迭代來襲:驍龍SM8845、聯發科天璣8500,均在路上了