【希伯來大學讓AI\考官\幫你從千萬個模型里找到最合適的那一個】

這項由希伯來大學計算機科學與工程學院的Jonathan Kahana、Or Nathan、Eliahu Horwitz和Yedid Hoshen共同完成的研究發表于2025年2月 , 論文題目為\"Can this Model Also Recognize Dogs? Zero-Shot Model Search from Weights\" 。 有興趣深入了解的讀者可以通過arXiv:2502.09619v1訪問完整論文 , 項目主頁為https://jonkahana.github.io/probelog 。

現在的AI世界就像一個巨大的工具商店 , 貨架上擺滿了各種各樣的AI模型 。 據統計 , 僅僅是Hugging Face這一個平臺就托管著超過100萬個模型 , 每個月還會新增10萬多個 。 這些模型就像不同的專業工具 , 有的擅長識別動物 , 有的專門處理醫學圖像 , 有的能分辨各種食物 。 問題是 , 當你需要找一個能識別狗的模型時 , 你該怎么辦?

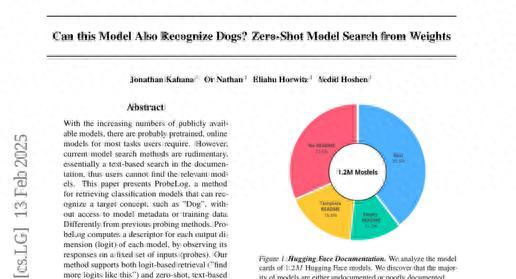

傳統的方法就像在沒有標簽的工具箱里翻找工具一樣令人頭疼 。 你只能依靠模型的文字描述來猜測它能做什么 , 但研究團隊發現了一個令人震驚的事實:在120萬個Hugging Face模型中 , 超過30%的模型完全沒有任何說明文檔 , 另外28.9%的模型要么文檔是空白的 , 要么只有自動生成的無用模板 。 這意味著將近60%的模型都是\"啞巴\" , 你根本不知道它們能干什么 。

這就好比你走進一家巨大的五金店 , 但大部分工具都沒有標簽 , 你想找一把能擰特定螺絲的螺絲刀 , 卻只能一個個拿起來試 。 這種情況下 , 能不能有一個\"萬能試驗臺\" , 讓你快速測試每個工具的功能呢?

希伯來大學的研究團隊提出了一個巧妙的解決方案 , 他們稱之為ProbeLog 。 這個方法就像給每個AI模型安排了一場標準化考試 。

一、AI模型的\"標準化考試\":ProbeLog如何工作

設想一下 , 你是一位考官 , 需要測試一堆學生是否認識狗 。 你不能直接問他們\"你認識狗嗎?\" , 因為有些學生可能撒謊或者理解有偏差 。 相反 , 你準備了4000張不同的圖片作為\"考題\"——這些圖片包含各種各樣的場景:公園里的人、桌子上的蘋果、海邊的帆船、草地上的狗等等 。

ProbeLog的工作原理與此類似 。 研究團隊首先從COCO數據集中挑選了一組固定的圖像作為\"考題\" 。 這些圖像就像標準化考試中的題目 , 包含了豐富多樣的場景和物體 。 然后 , 他們讓每個AI模型\"參加考試\"——把這些圖像輸入模型 , 觀察模型的每個輸出維度(專業術語叫\"logit\" , 可以理解為模型對每個可能答案的信心程度)如何響應 。

關鍵的創新在于 , ProbeLog不是給整個模型打一個總分 , 而是給模型的每個\"專業技能\"單獨評分 。 就像一個多才多藝的學生 , 可能既會數學又會英語還會體育 , ProbeLog會分別測試這個學生在每個科目上的表現 。 對于AI模型來說 , 一個模型可能同時能識別狗、貓、汽車等多種物體 , ProbeLog會為每種識別能力創建一個獨特的\"成績單\" 。

這個成績單是一個數字序列 , 記錄了模型在面對4000張測試圖片時 , 對某個特定概念(比如\"狗\")的反應強度 。 當遇到包含狗的圖片時 , 擅長識別狗的模型輸出會比較高;遇到不包含狗的圖片時 , 輸出會比較低 。 這樣 , 每個模型的每種識別能力都有了自己獨特的\"指紋\" 。

二、找到最相似的\"指紋\":智能匹配算法

有了每個模型能力的\"指紋\"后 , 下一個挑戰是如何比較這些指紋的相似性 。 就像比較兩個人的真實指紋一樣 , 你不能簡單地看整體圖案是否一致 , 而要關注那些最清晰、最可靠的特征 。

研究團隊發現了一個重要現象:AI模型只有在它確信自己的判斷時 , 輸出的結果才是可靠的 。 這就好比一個學生在考試中 , 對于自己非常確定的題目會給出明確答案 , 而對于不確定的題目可能會胡亂猜測 。 因此 , ProbeLog在比較兩個模型時 , 只關注查詢模型最有把握的那些\"考題\" 。

具體來說 , 當你用一個已知能識別狗的模型作為\"參考標準\"時 , 系統會首先找出這個參考模型對哪些圖片反應最強烈(也就是最確信這些圖片包含狗) 。 然后 , 系統只在這些\"高置信度\"的圖片上比較其他模型的表現 。 這種方法大大提高了匹配的準確性 , 因為它過濾掉了那些可能產生噪音的不確定判斷 。

為了進一步驗證這種方法的有效性 , 研究團隊做了一個巧妙的實驗 。 他們用10個不同的ViT基礎模型 , 通過不同的訓練方法 , 都訓練成能識別CIFAR10數據集中10個類別的分類器 。 然后用1000張ImageNet圖片作為探測器 , 計算每個模型每個輸出維度的ProbeLog描述符 , 并分析它們之間的相關性 。

結果令人振奮:那些負責識別相同概念的輸出維度表現出了強烈的相關性 , 而不同概念之間的相關性很弱 。 這就像你發現所有擅長識別蘋果的學生在面對蘋果圖片時都會有相似的興奮反應 , 而面對汽車圖片時則相對平靜 。 更重要的是 , 這種相似性不是基于模型來自同一個\"班級\"(相同的基礎架構) , 而是基于功能上的相似性 。

三、從\"樣本匹配\"到\"文字搜索\":零樣本檢索的突破

ProbeLog的第一個版本解決了\"找更多像這個一樣的模型\"的問題 , 但用戶往往沒有現成的參考模型 。 他們真正想要的是能夠直接用文字描述來搜索 , 比如輸入\"狗\"就能找到所有能識別狗的模型 。 這就需要一個從文字到模型能力的\"翻譯器\" 。

研究團隊的解決方案頗具巧思 。 他們利用了CLIP這樣的多模態模型 , 這種模型既能理解圖像也能理解文字 。 回到考試的比喻 , 這就像是找到了一位既懂中文又懂英語的翻譯 , 能夠在兩種語言之間建立對應關系 。

具體過程是這樣的:首先 , 系統用CLIP模型分別對4000張測試圖片和用戶輸入的文字(比如\"狗\")進行編碼 , 得到它們在同一個\"語義空間\"中的表示 。 然后 , 系統計算每張圖片與目標文字的相似度 , 這樣就得到了一個\"虛擬的ProbeLog描述符\"——就好像有一個專門識別用戶所描述概念的理想模型參加了同樣的考試 。

但是 , 這個虛擬描述符和真實模型的描述符存在\"量綱不同\"的問題 , 就像用攝氏度和華氏度測溫度一樣 , 數值范圍完全不同 。 為了解決這個問題 , 研究團隊對每個描述符進行了標準化處理 , 將它們轉換到相同的數值范圍內 , 這樣就能直接比較虛擬描述符和真實模型描述符的相似性了 。

四、降低成本的\"協作探測\":讓計算更高效

雖然ProbeLog的想法很棒 , 但面對百萬級別的模型庫時 , 給每個模型都跑4000張圖片的計算成本是驚人的 。 這就像要給一個擁有百萬學生的學校都安排完整的標準化考試 , 成本和時間都難以承受 。

研究團隊提出了\"協作探測\"(Collaborative Probing)這一創新解決方案 。 這個想法借鑒了推薦系統中的協同過濾技術 , 就像Netflix如何根據你看過的少數幾部電影推薦你可能喜歡的其他電影一樣 。

協作探測的核心思路是:不需要讓每個模型都做完整的4000道題考試 , 而是讓每個模型只做其中隨機選擇的一小部分題目 。 比如 , 模型A做第1、15、33、78...這些題目 , 模型B做第3、22、41、92...這些題目 , 模型C做第7、28、45、99...這些題目 。 雖然每個模型只做了部分題目 , 但通過巧妙的數學方法 , 可以推算出每個模型在所有題目上的表現 。

這種方法利用了一個重要假設:相似功能的模型在面對相同問題時會有相似的反應模式 。 就像如果你知道兩個學生在數學上表現相似 , 那么當你知道其中一個學生的物理成績時 , 你就能比較準確地估算另一個學生的物理成績 。

具體實現使用了截斷奇異值分解(SVD)算法 , 這是一種矩陣分解技術 。 簡單來說 , 就是找到隱藏在不完整數據背后的規律 , 然后用這些規律填補缺失的信息 。 實驗結果表明 , 使用協作探測技術 , 每個模型只需要做15%的題目就能達到與完整測試相近的效果 , 大大降低了計算成本 。

五、真實世界的驗證:從實驗室到實用

為了驗證ProbeLog在真實環境中的表現 , 研究團隊構建了兩個測試數據集 。 第一個叫INet-Hub , 包含1500個在ImageNet子集上訓練的模型 , 總共超過85000個輸出維度 , 涵蓋1000個細粒度概念 。 這就像創建了一個標準化的\"實驗班\" , 所有學生都接受過相似的訓練 , 但專業方向各不相同 。

第二個數據集更具挑戰性 , 叫HF-Hub , 包含71個從Hugging Face平臺手工收集的真實用戶上傳模型 , 總共400個輸出維度 。 這些模型就像來自不同學校、不同背景的學生 , 訓練數據、命名規范都各不相同 。 比如 , 有的模型把蘋果標記為\"Apple\" , 有的標記為\"Apples\" , 有的可能用更具體的描述如\"Red Apple\" 。

研究團隊設計了多種測試場景 。 在同分布測試中(INet到INet) , ProbeLog達到了72.8%的top-1準確率 , 這意味著超過七成的查詢都能在第一個結果中找到正確答案 。 考慮到隨機猜測的準確率只有0.1%(因為有1000個可能的類別) , 這個結果相當出色 。

更令人印象深刻的是跨分布測試的結果 。 當用HF-Hub的真實模型搜索INet-Hub時 , ProbeLog達到了40.6%的top-1準確率 。 這就像讓一個在中式教育體系下成長的學生去適應美式教育的評估標準 , 難度可想而知 , 但ProbeLog依然表現良好 。

在零樣本文字搜索測試中 , 用戶直接輸入\"狗\"這樣的文字描述 , ProbeLog能夠在INet-Hub中達到43.8%的top-1準確率 , 在HF-Hub中達到34.0%的準確率 。 這意味著用戶有很大概率在第一個搜索結果中就找到能識別目標概念的模型 。

六、深入分析:影響效果的關鍵因素

研究團隊還深入分析了影響ProbeLog性能的各種因素 , 這些發現為實際應用提供了重要指導 。

關于探測圖像的選擇 , 研究團隊測試了四種不同的圖像來源:完全人工生成的Dead-Leaves圖像、用Stable Diffusion生成的合成圖像、ImageNet數據集圖像 , 以及COCO數據集圖像 。 結果顯示 , 越接近目標模型訓練數據分布的探測圖像效果越好 。 ImageNet圖像作為探測器時效果最佳 , 因為大部分測試模型都是在ImageNet相關數據上訓練的 。 但令人驚喜的是 , 即使是相對\"不匹配\"的COCO場景圖像也能達到不錯的效果 , 這說明ProbeLog具有良好的泛化能力 。

在比較策略方面 , 研究團隊驗證了只關注高置信度探測結果的重要性 。 他們比較了多種策略:使用置信度最低的探測結果、隨機選擇、均勻分位數采樣、使用所有探測結果等 。 結果證實 , 只有關注查詢模型最有把握的探測結果才能獲得最佳性能 。 這就像在嘈雜的環境中 , 你要專注聽那些說話最清楚的人的聲音 , 而忽略那些模糊不清的雜音 。

探測圖像數量的影響也很有趣 。 研究發現 , 使用4000張COCO圖像就能獲得43.8%的top-1準確率 , 而使用8000張圖像能提升到47.8% 。 這表明存在收益遞減效應:初期增加探測圖像數量能顯著提升性能 , 但到了一定程度后 , 繼續增加圖像的邊際收益就很小了 。

七、協作探測的威力:少量數據實現大效果

協作探測技術的表現令人矚目 。 在文字到INet-Hub的檢索任務中 , 即使每個模型只使用15%的探測圖像 , 協作探測也能達到與使用全部數據相近的效果 。 更令人驚訝的是 , 當每個模型只使用4%的探測圖像時 , 協作探測的效果竟然等同于傳統方法使用15%的探測圖像的效果 。 這意味著在相同的計算成本下 , 協作探測能提供近3倍的性能提升 。

這種效果的原理在于 , 不同模型之間存在功能上的相關性 , 而協作探測能夠巧妙地利用這種相關性 。 就像在一個班級里 , 如果你知道數學好的學生物理通常也不錯 , 那么即使你只看到某個學生的部分成績 , 也能比較準確地推測他在其他科目上的表現 。

八、方法的局限性與未來方向

盡管ProbeLog表現出色 , 但研究團隊也誠實地指出了方法的局限性 。 首先 , 這種方法目前主要針對分類模型設計 , 對于生成模型(如GPT、Stable Diffusion等)的適用性還需要進一步研究 。 生成模型的輸出不像分類模型那樣有明確的類別對應關系 , 因此需要開發新的探測和比較策略 。

其次 , 當目標概念與探測圖像的分布差異很大時 , 效果會明顯下降 。 比如 , 如果要搜索能識別醫學影像中病理特征的模型 , 而探測圖像都是日常生活場景 , 那么效果就會打折扣 。 這提示我們在實際應用中可能需要針對特定領域準備專門的探測圖像集 。

另外 , 雖然協作探測大大降低了計算成本 , 但對于真正大規模的模型庫(比如百萬個模型) , 計算和存儲開銷仍然是需要考慮的問題 。 研究團隊提到 , 他們的INet-Hub模型需要400GB存儲空間 , 而對應的ProbeLog描述符只需要1.4GB , 壓縮比相當可觀 , 但擴展到百萬模型規模時仍需要進一步優化 。

研究團隊還指出了幾個有前景的改進方向 。 一是開發更智能的探測圖像選擇策略 , 比如根據前幾張圖像的結果自適應地選擇后續圖像 , 或者使用主動學習的思想來選擇最有信息量的探測圖像 。 二是改進協作過濾算法 , 考慮模型輸出值的統計特性 , 而不僅僅是簡單的矩陣分解 。

九、對AI生態的深遠影響

ProbeLog的意義遠超技術本身 , 它可能會改變整個AI模型生態系統的運作方式 。 目前 , 大量優秀的AI模型因為缺乏好的文檔而被埋沒 , 就像圖書館里沒有索引的珍貴藏書 。 ProbeLog提供了一種自動化的\"編目\"方法 , 能夠讓這些\"沉睡\"的模型重新煥發價值 。

這種技術還能促進AI模型的重用和共享 。 研究人員和開發者不再需要為每個新任務從頭訓練模型 , 而是可以在現有的巨大模型庫中找到最適合的工具 。 這不僅能節省計算資源和時間 , 還能降低AI應用的門檻 , 讓更多沒有大規模計算資源的研究者和開發者也能獲得高質量的模型 。

從環境保護的角度看 , 這種技術也具有積極意義 。 AI模型的訓練需要消耗大量電力 , 產生可觀的碳排放 。 如果能通過更好的模型搜索和重用減少重復訓練 , 就能在一定程度上緩解AI發展對環境的壓力 。

ProbeLog還可能催生新的商業模式 。 模型提供者可以更容易地展示自己模型的能力 , 用戶也能更精準地找到所需的模型 。 這可能會促進AI模型市場的發展 , 讓優秀的模型獲得應有的回報 , 從而激勵更多高質量模型的產生 。

十、技術實現的精妙之處

從技術角度看 , ProbeLog的設計體現了多個巧妙的工程思考 。 首先是logit級別表示的選擇 。 傳統方法通常試圖用一個向量表示整個模型 , 但這樣做會丟失模型多功能的特性 。 ProbeLog選擇為每個輸出維度單獨建模 , 這樣一個既能識別狗又能識別貓的模型就能在搜索\"狗\"時和搜索\"貓\"時都被正確找到 。

其次是探測圖像的標準化處理 。 通過使用固定的、有序的圖像集合 , ProbeLog確保了不同模型之間的可比性 。 這就像標準化考試必須使用相同的題目才能公平比較不同考生的能力一樣 。

標準化處理也是一個重要創新 。 原始的模型輸出和基于CLIP的文字描述在數值范圍上可能相差很大 , 就像用不同單位測量同一個物理量 。 通過將每個描述符標準化為均值為0、標準差為1的分布 , 系統消除了這種數值范圍的差異 , 使得跨模態比較成為可能 。

不對稱的相似度度量也值得注意 。 傳統的相似度計算通常是對稱的 , 即A與B的相似度等于B與A的相似度 。 但ProbeLog采用了不對稱度量 , 只關注查詢模型最有把握的探測結果 。 這種設計反映了對模型不確定性的深刻理解:模型在不確定的情況下可能給出噪音很大的輸出 , 而只有在確定的情況下輸出才是可靠的 。

說到底 , ProbeLog這項研究為我們展現了AI模型搜索的一種全新可能性 。 在AI模型數量爆炸式增長的今天 , 如何有效利用這些模型資源成為了一個關鍵挑戰 。 ProbeLog通過巧妙的\"標準化考試\"思路 , 不僅解決了模型搜索的技術難題 , 還為整個AI生態系統的發展提供了新的思路 。

這項工作的價值不僅在于提出了一個有效的技術方案 , 更在于它揭示了一個重要趨勢:隨著AI模型數量的持續增長 , 如何管理、搜索和重用這些模型將成為AI發展的重要議題 。 ProbeLog為我們提供了一個很好的起點 , 但這個領域還有很大的發展空間 。 未來 , 我們可能會看到更多類似的技術出現 , 讓AI模型的使用變得更加便捷和高效 。

對于普通開發者和研究者來說 , ProbeLog意味著他們不再需要在茫茫模型海洋中盲目尋找 , 而是可以通過簡單的文字描述快速找到最適合自己需求的模型 。 這不僅能提高工作效率 , 還能讓更多人享受到AI技術發展的成果 。 畢竟 , 技術的最終目標是為人類服務 , 而ProbeLog正是朝著這個目標邁出的重要一步 。

Q&A

Q1:ProbeLog是什么?它是如何工作的?

A:ProbeLog是希伯來大學開發的AI模型搜索技術 , 就像給AI模型安排標準化考試一樣 。 它用4000張固定圖片測試每個模型 , 記錄模型對每種概念的反應模式 , 形成獨特的\"能力指紋\" 。 當用戶想找能識別某個物體的模型時 , 系統就比較這些指紋找到最匹配的模型 。

Q2:ProbeLog能解決什么實際問題?

A:主要解決AI模型庫中\"找不到合適模型\"的問題 。 現在像Hugging Face這樣的平臺有超過100萬個模型 , 但近60%都沒有說明文檔 , 用戶根本不知道哪個模型能做什么 。 ProbeLog讓用戶直接輸入\"狗\"、\"汽車\"等關鍵詞就能找到相應的識別模型 。

Q3:這項技術的準確率如何?普通人能使用嗎?

A:在實驗中 , ProbeLog達到了40-70%的準確率 , 遠超隨機猜測的0.1% 。 雖然目前還是研究階段的技術 , 但已經展現出很好的實用潛力 。 未來如果集成到模型平臺中 , 普通開發者就能像搜索網頁一樣輕松找到需要的AI模型了 。

推薦閱讀

- 中南大學等機構突破難題:讓AI真正理解長文本并生成完美圖像

- 華為Mate XT賣瘋后,三星三折疊TriFold姍姍來遲,值不值2萬?

- “芯片戰”來勢洶洶!中方動真格后,荷蘭服軟,先進光刻機有戲了

- 真我realme UI:八月升級來襲,眾多新功能也已清晰!

- 重磅!“能讀一半就是賺到”的神作《編碼》第2版來了

- 新 iPhone 提前曝光,迎來 5 大新升級

- 蘋果新系統曝光,終于要來了

- 安卓版“CallKit”要來了?

- 揭秘小鵬機器人:挖來英偉達大牛,產線已落地幾百臺|智能涌現獨家

- 續航焦慮者的福音!真我帶來8200mAh電池和2K屏,正面硬剛紅米K90