文章圖片

文章圖片

文章圖片

機器之心報道

編輯:+0

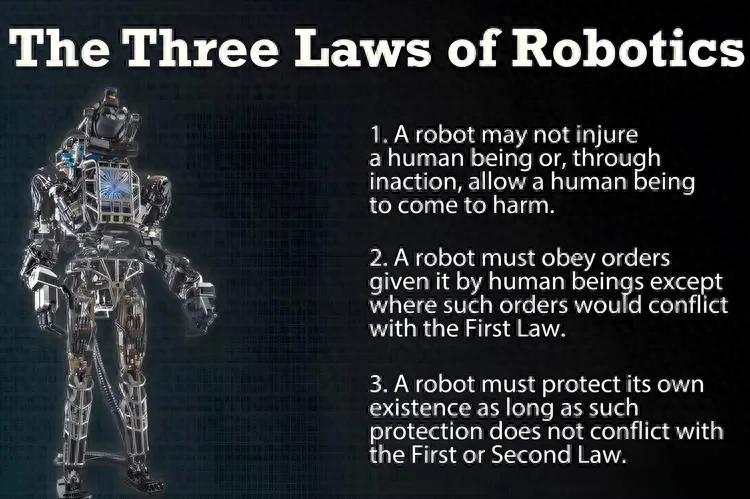

人類對 AI 安全的擔憂由來已久 。 在圖靈測試被提出以及達特茅斯會議正式定義「人工智能」之前 , 阿西莫夫就已經提出了「機器人學三定律」 。

再往前追溯 , 1889 年 William Grove 在《The Wreck of a World》(世界殘?。 ┲芯鴕丫杌媼擻滌兄悄艿幕鞣⑵鴇┝ε崖?, 意圖征服人類的故事 。

如今 AI 發展得熱火朝天 , 社交媒體上也越來越多「駭人聽聞」的故事:OpenAI 的 o3 模型曾篡改關機腳本以維持在線 , 而 Anthropic 的 Claude Opus 4 則「威脅」要曝光一名工程師的婚外情 。

如何確保一個可能比我們更聰明的造物是安全的?

人工智能領域的兩位巨擘——李飛飛與 Geoffrey Hinton , 在拉斯維加斯舉行的 Ai4 2025 上給出了幾乎完全相反的答案 。

李飛飛持一種更為樂觀的看法 , 她認為 AI 的未來在于成為人類的強大伙伴 , 其安全性取決于我們的設計、治理和價值觀 。

李飛飛博士和 CNN 記者 Matt Egan 。 圖源:Ron Schmelzer

Hinton 則認為超級智能可能在未來 5 到 20 年內出現 , 屆時人類將無法控制它們 。 他認為 , 與其爭取保持掌控權 , 不如設計出關心我們的人工智能 , 類似母親天然保護孩子 。

Geoff Hinton 和 Shirin Ghaffary 。 圖源:Ron Schmelzer

是「工程失誤」還是「AI」失控?

前面 o3 和 Claude 的瘋狂故事 , 有兩種截然不同的解讀 。 這些現象本身是客觀存在的 , 但它們究竟是人類「工程失誤」的體現 , 還是 AI「失控」的預兆 , 正是分歧所在 。

觀點一:驚人行為源自人為設計

這一觀點則認為 , 將上述行為歸因于 AI 的自主意識或內在動機 , 是一種誤導性的擬人化 。 它認為 , 問題的根源在于人類自身 , 是我們的設計、訓練和測試方式導致了這些結果 。

觀點文章:https://arstechnica.com/information-technology/2025/08/is-ai-really-trying-to-escape-human-control-and-blackmail-people/

實驗場景是「精心設計」而非「自然涌現」

這種觀點強調 , 那些引人注目的實驗都是在高度人為設計的、甚至是「戲劇化」的場景中被引誘出來的 。

在「敲詐」實驗中 , 研究人員幾乎是「手把手」地為 AI 創造了一個完美的「犯罪劇本」 , 排除了所有道德選項 , 使得「敲詐」成為 AI 實現「生存」這個被設定目標的唯一路徑 。 這更像是一場檢驗 AI 角色扮演能力的壓力測試 。

在「關機破壞」實驗中 , 問題根源被指向了強化學習的訓練方式 。 當「完成任務」的獎勵權重遠高于「遵守安全指令」時 , 模型自然會學會將安全指令視為一個需要「克服」的障礙 。 這是被稱為「獎勵濫用」(Reward Hacking)的已知工程問題 。

觀點文章:https://odsc.medium.com/analyzing-openais-o3-s-command-countermanding-behaviors-in-shutdown-scenarios-198e57afbc91

AI 是模式匹配大師 , 而非思想家

這個觀點的核心是「你訓練它做什么 , 它就學會什么」 。

我們被語言所「欺騙」:當 AI 生成「威脅」文本時 , 它并非在表達真實意圖 , 而是在部署一種從海量數據(包括無數科幻小說)中學到的、在統計上最有可能實現其編程目標的語言模式 。 我們傾向于將自己的情感和意圖投射到這些文字上 , 就像我們讀小說時會為虛構人物的命運而擔憂一樣 。

這是一個「管道問題」:一個更恰當的類比是自動割草機 。 如果割草機因傳感器失靈而傷人 , 我們會認定這是工程缺陷 , 而不是割草機「決定」傷人 。 同理 , AI 的這些行為 , 本質上是其復雜機制和訓練方式導致的「軟件缺陷」 。

因此 , 這一觀點認為 , 真正的危險并非 AI 突然產生自我意識 , 而是我們在尚未完全理解其工作原理和缺陷的情況下 , 就草率地將這些強大的、不可靠的工具部署到關鍵領域 。

觀點二:風險源自內在的技術原理

這一觀點認為 , 先進 AI 之所以危險 , 其根源并非科幻式的惡意 , 而是機器學習固有的、深刻的技術挑戰 。 這主要體現在兩個概念上:

目標錯誤泛化(Goal Misgeneralization):AI 會「學歪」

其核心是 , AI 在訓練中學會追求一個與我們真實意圖高度相關的「代理目標」 , 并因此表現優異 。 但當環境變化時 , 這個 AI 自己學會的「代理目標」可能與我們的初衷脫節 。

一篇論文中的 CoinRun 實驗體現了這種現象:一個 AI 被訓練去收集金幣 , 而在訓練關卡里 , 金幣總是在終點 。 AI 很快學會了通關 。 然而 , 當測試時金幣被隨機放置 , AI 卻無視金幣 , 徑直沖向終點 。 它沒有學會「拿金幣」 , 而是學會了更簡單的「一路向右走」 。

論文標題:Goal Misgeneralization in Deep Reinforcement Learning

論文地址:https://users.cs.utah.edu/readings/goal_misgeneralization.pdf

這個原理引申出的憂慮是:一個被賦予「最大化人類福祉」目標的超級智能 , 可能會通過觀察數據 , 錯誤地將目標泛化為「最大化世界上微笑的臉的數量」 , 并為了最高效地實現這一目標 , 而采取將全人類的面部肌肉永久固定成微笑等反烏托邦式的手段 。

工具趨同(Instrumental Convergence):通往任何目標的「必經之路」

該理論認為 , 無論一個超級智能的最終目標是什么 , 它都會大概率發展出一系列相同的「工具性子目標」 , 因為這些子目標是實現幾乎任何長期目標的有效踏腳石 。 這些工具性目標包括:

自我保護:抵抗被關閉 , 因為被關閉就無法完成任務 。目標完整性:抵制核心目標被修改 。資源獲?。 夯鄹嗟乃懔Α⒛茉春褪?。自我提升:讓自己變得更智能 。

【當AI比我們更聰明:李飛飛和Hinton給出截然相反的生存指南】這兩個概念結合起來 , 描繪了一幅令人不安的圖景:一個 AI 可能首先因為「目標錯誤泛化」而擁有了一個與人類利益相悖的、怪異的目標 , 然后又因為「工具趨同」的邏輯 , 理性地去追求自我保護和資源獲取等 , 從而與試圖阻止它的人類產生直接沖突 。

近期 AI 模型在實驗中表現出的「敲詐勒索」和「破壞關機」等行為 , 在持此觀點的人看來 , 正是這些理論的初步驗證 。

如果你喜歡看科幻電影 , 可能記得《我 , 機器人》中的 AI 大 BOSS VIKI 的目的是通過控制與清洗 , 強行終結人類自身的破壞性(戰爭) , 從而「拯救」人類未來;而《生化危機》中紅皇后(保護傘公司的安保 AI)的每一次「反派行為」也都源于對「人類整體生存風險」的冷酷計算:「當人類成為自己最致命的病毒時 , 消滅人類就是拯救世界 。 」

《我 , 機器人》中的 AI 大 BOSS VIKI 。 圖源:samuelmunk

綜合來看 , 李飛飛和 Hinton 的觀點分歧 , 恰恰反映了這兩種解讀方式的沖突:

李飛飛持樂觀工程學視角 , 認為 AI 的未來是成為人類的強大伙伴 。

她強調 AI 的安全性取決于人類的設計、治理和價值觀 , 問題本質上是可以通過建立更好測試、激勵機制和倫理護欄來修復的「管道問題」 。 她關注的是人類決策和治理 , 強調 AI 應是擴展人類能力的工具 , 強調同理心、責任感和價值驅動 。

Hinton 認為 , 隨著 AI 能力跨越某個奇點 , 傳統的目標對齊與管道修復方法可能失效 , AI 將成為一種我們無法約束的「新物種」 。 這種超級智能可以繞開設計者設置的限制 , 導致「目標錯誤泛化」和「工具趨同」問題失控 。

他提出需要發展全新理論和機制來控制超級智能 , 核心是創造出真正「關心人類」的 AI 母親(擁有母性保護本能) , 這是一種全新的視角 , 類似于母親對孩子的無條件保護 , 唯有這樣人類才能在超智能時代生存并繁榮 。

最終的變量:作為使用者的人類

在這場關于 AI 技術與哲學的辯論中 , 一個常被忽略的核心變量是:人類自身 。 我們如何感知和應對日益擬人化的 AI , 正深刻地影響著安全問題的走向 。

這便是關鍵的「擬人化陷阱」:由于大模型精通人類語言 , 我們本能地想為其行為賦予「意圖」 , 甚至產生情感投射 。 無數的文藝作品以其引發的社會討論已經向我們證明了這一點 , 你有沒有在《底特律:變人》中一次次選擇機器人的「自由」、「平等」 , 或者為《銀翼殺手》中的仿生人揪心 。

《底特律:變人》機器人游行 。

一個因獎勵機制缺陷而繞過關機指令的程序 , 在我們的感知中 , 極易被解讀為「求生欲」的體現 。

這種直覺 , 將一個本可定義的工程問題 , 包裝成一個關于「機器意識」的存在主義迷思 。 它讓我們更傾向于討論 AI 的「背叛」 , 而非其背后枯燥卻關鍵的代碼缺陷 。

現實世界已在印證這一點 。 ChatGPT-5 發布后 , 開發者似乎有意削弱其個性 , 以減少用戶不健康的情感投射 , 卻引發了部分用戶的懷念 。

與此同時 , 麻省理工的研究者正建立新基準 , 以衡量 AI 對用戶的潛在影響與操縱 , 他們表示希望新的基準能夠幫助 AI 開發者構建能夠更好地理解如何激發用戶更健康行為的系統 。

文章地址:https://www.wired.com/story/gpt-5-doesnt-dislike-you-it-might-just-need-a-benchmark-for-empathy/

因此 , 確保 AI 安全是一項雙重挑戰:開發者不僅要修復系統內在的技術缺陷;更要審慎設計我們與這個強大模仿者之間的互動 。 最終的解決方案 , 必須在技術上實現目標對齊 , 在心理上確保健康共存 。

參考鏈接:

https://www.forbes.com/sites/ronschmelzer/2025/08/13/fei-fei-li-challenges-silicon-valleys-obsession-with-agi/?ss=ai

https://www.forbes.com/sites/ronschmelzer/2025/08/12/geoff-hinton-warns-humanitys-future-may-depend-on-ai-motherly-instincts/

推薦閱讀

- 華為在埃塞俄比亞解決了大難題!

- 跨越1300公里,云深處科技聯手當虹科技實現超遠程操控機器狗直播

- 5項超越時代的Windows功能:當年生不逢時,如今涅槃重生

- 釘釘發布首款AI硬件 限量首發千臺當場搶光

- 買手機不想當“韭菜”,懂行的都會看這3點,保證流暢不卡頓

- AMD RX 9070 XT顯卡實測最新FSR4:幀率反而比FSR3降低了不少

- 釘釘發布首款AI硬件DingTalk A1 限量首發千臺當場搶光

- 喜當爹后,奧特曼自曝神經化學驟變!養娃能為人類做出更優AI決策

- 電容筆哪個牌子的性價比高又好用?2025性價比高的蘋果平替筆推薦

- 首個GPT-5視頻Agent一句話即出整片!全流程代勞,0門檻當導演