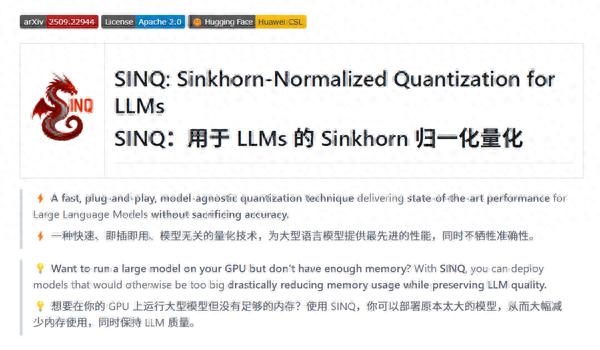

華為位于蘇黎世的研究團隊近日公布了一種新型開源量化技術 , 能夠在保持大語言模型輸出質量的同時顯著降低顯存占用 。 該方法命名為SINQ(Sinkhorn-Normalized Quantization) , 目前已通過GitHub與Hugging Face平臺向公眾開放 , 遵循Apache 2.0許可協議 , 支持個人、企業及科研機構自由使用、修改并用于商業場景 。

SINQ的主要特點在于無需依賴校準過程、執行效率高 , 并可便捷地融入現有的模型部署流程 。 通過創新的量化機制 , 該技術能將模型運行所需的顯存減少60%至70% , 具體壓縮效果因模型結構和量化位寬而異 。 這一優化使得原本需超過60GB顯存支持的大型模型 , 可在約20GB顯存的設備上順利運行 。

得益于顯存需求的大幅下降 , 原先只能在高端數據中心級GPU(如A100或H100)上部署的大模型 , 現可遷移至消費級硬件環境 , 例如單張RTX 4090顯卡即可承載 , 為更多研究者和開發者提供了低成本實驗與應用的可能性 。

該方法已在多個主流模型架構上完成驗證 , 涵蓋Qwen3系列、LLaMA以及DeepSeek等 , 在WikiText2和C4等標準評估基準中表現優異 , 有效降低了困惑度與權重翻轉率 。 同時 , SINQ支持非對稱量化格式(如NF4) , 也可與現有校準策略(如AWQ)協同使用 , 進一步縮小與全精度模型之間的性能差距 。

在量化速度方面 , SINQ相較HQQ提升約一倍 , 較AWQ提速超過30倍 , 展現出極高的處理效率 , 尤其適用于對時間成本敏感的實際研究和生產場景 。

【華為蘇黎世團隊發布開源SINQ量化技術,顯著降低大模型顯存占用】(10576024)

推薦閱讀

- 華為Mate80再確認:麒麟芯+大圓后攝,或成11月手機圈“頂流”!

- 華為開啟“清倉模式”,12GB+512GB跳水2135元,終于等到了

- iPhone 17銷量暴走,蘋果悶聲發大財,小米華為還要繼續努力!

- 華為目前“最值得撿漏”的一款手機,16+1TB降價4550,價格大跳水

- 疑似華為Mate80系列保護殼曝光:圓形鏡頭+大模組,但真假自辯!

- 華為新品官宣:10月14日,開始預售

- 華為增長53%,首次超過蘋果,成為全球第一大手表品牌

- 華為Mate80再次被確認:麒麟芯+大圓后攝,或成11月手機圈“頂流”!

- 華為宣布清倉,從3999元降至2464元,512GB高配版跌至“谷底價”

- 華為 Mate 80 Air 曝光,搭載全新麒麟 9030 芯片