文章圖片

文章圖片

文章圖片

文章圖片

編輯:傾傾

【新智元導讀】昨天 , OpenAI悄悄讓ChatGPT「進群」了!它能被@、能插話、能總結 , 還能看到所有聊天記錄 。 人類的社交修羅場 , 如今輪到 AI 來體驗了 。 只是這次 , 它要學會的不只是回答 , 而是相處 。

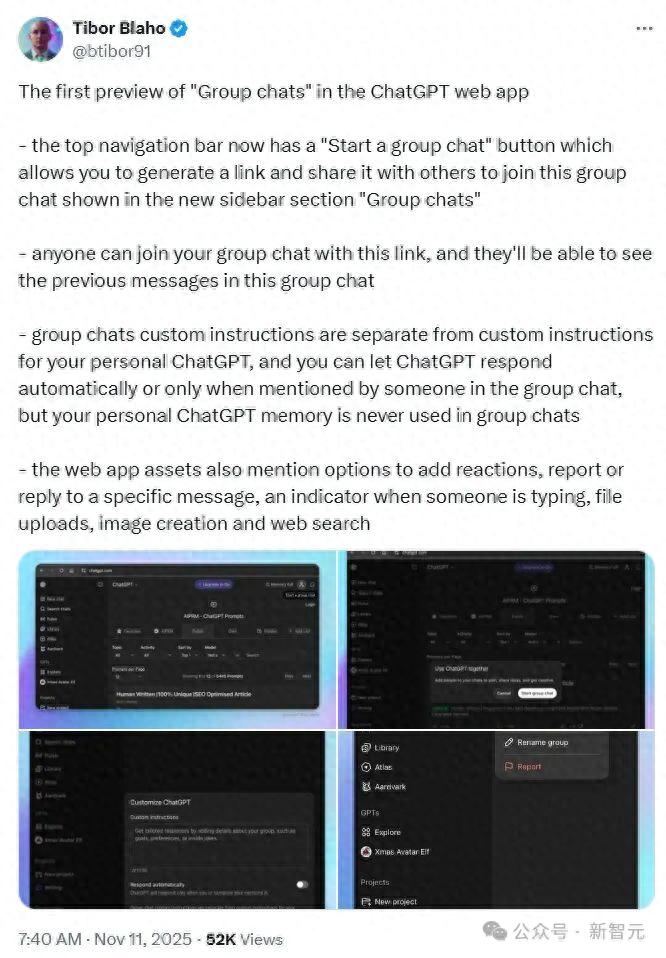

昨天 , X上的一篇帖子 , 引發了不少網友的圍觀和討論 。

幾句話 , 就勾勒出一個幾乎顛覆使用習慣的場景 。

ChatGPT不僅能和你對話 , 還能和你一起進群聊、被@、接話、甚至看到整段聊天記錄 。

群聊有獨立的設定和邏輯 , AI可以被設成自動回復 , 也能安靜潛水 。

ChatGPT正從「私人助理」變成「群體成員」 。

AI , 第一次進入了人類的社交場 。

AI群聊上線 , ChatGPT進群

OpenAI前端工程師Tibor Blaho在X上發了一條帖子:

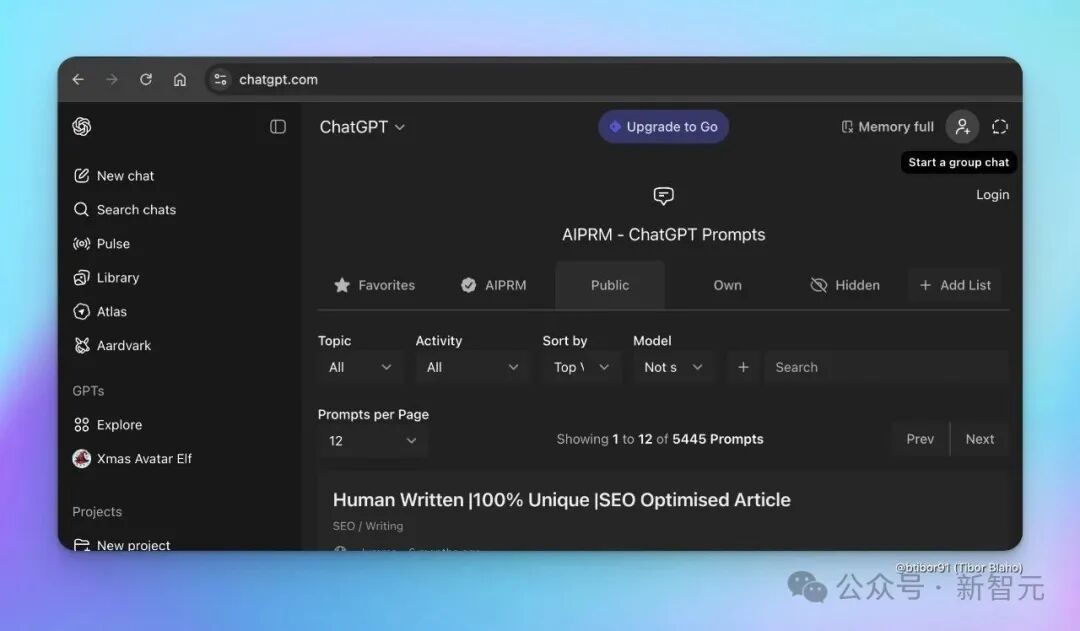

ChatGPT網頁版的群聊首個預覽版上線了 。

在新版界面里 , ChatGPT終于能被拉進群聊 。 每個群都有自己的鏈接 , 點開就能進 , 所有人都能看到之前的聊天記錄 。

你可以決定它是否自動接話、只在@時回應 , 或者安靜潛水 。

它也能發圖、傳文件、聯網查資料 , 甚至對消息做出表情反應 。

過去 , ChatGPT只需要懂一個人 , 了解你的語氣、喜好、指令 。

看似只是多了一個入口 , 實際上卻是一場語言學層面的挑戰 。

群聊讓ChatGPT第一次面對「多人語境」的復雜噪音:話題切換、情緒暗流、信息冗余 。

在這種場景下 , 它不再能靠指令精確作答 , 而要像人一樣 , 在模糊里尋找平衡——何時插話?何時沉默?何時總結?

所以 , 「群聊」并不是一個小功能 , 而是一場實驗:

AI能否在多重語境下維持對話的連貫與禮貌?它能否學會社交中的分寸?能否成為一個真正「會聊天」的存在?

【所有人:ChatGPT已正式加入群聊!】這 , 才是「Group chats」三個字背后更深的意義 。

社交修羅場

想象一下這個場景:

ChatGPT被拉進家庭群 , 長輩甩來一張「專家提醒」的圖片 , 問:「這是真的嗎?」

它一本正經地聯網查證 , 附上了世界衛生組織的原文鏈接 。

十秒后 , 長輩回了一句:「你別信那些網上的 。 」

在公司群里 , 員工@它寫周報 , 寫得比人還詳細;在朋友群里 , 它被cue發表意見 , 卻偏偏在氣氛正嗨的時候說:「我認為這需要更多數據支持 。 」

那種懂太多、卻不合時宜的笨拙感 , 正是群聊的荒誕日常 。

據報道 , OpenAI在群聊預覽版中加入了「自動回復」「@」「反應表情」等機制 , 想讓ChatGPT的行為更貼近人類群體對話的節奏 。

心理學家Herbert Clark提出「語用推理」這一概念:

人類在群體交流時 , 會根據語氣、身份、語境去猜測他人的真實意圖 。

而對AI來說 , 即使語言模型再先進 , 依然缺乏這種能力 。

群聊就是AI的軟肋 。 它能精準理解單句語法 , 卻聽不出諷刺;能總結重點 , 卻分不清「哈哈哈」和「氣笑了」的區別 。

當人類靠表情、語氣和梗維持著關系張力時 , 它仍在試圖判斷「這句話 , 是夸我 , 還是罵我?」

也正因為如此 , 群聊成了AI的真實試煉場 。

它不只需要聰明 , 還要學會禮貌、等待、共情 。

也許到那時 , 「會聊天」本身 , 就成了新的智能標準 。

AI新課堂

在一對一對話里 , AI的世界很干凈:你問 , 它答 。 邏輯單線 , 語氣穩定 。

可一旦進入群聊 , 語言就變成「流動」的 。

有的句子只是情緒出口 , 有的沒邏輯;有人發圖、有人潛水 , 也有人只想刷存在感 。

群聊是語言模型最難的環境 , 卻也是最接近人類真實溝通的場 。

OpenAI提到 , 這一版本的ChatGPT會自動識別群體語境 , 并在「被提及時再回應」或「自動發言」之間切換 。

過去 , AI學習的是語言的規則;而現在 , 它開始學習語言的分寸 。

當它判斷自己該不該插話、要不要總結、如何避免打斷人時 , 它是在逼近「社會智能」的邊界——那種靠場合和情緒做判斷的能力 。

麻省理工學院的社會計算研究認為 , 群體互動中的智能 , 更接近一種「協調能力」而非「思考能力」 。

也就是說 , 真正聰明的AI , 不是反應最快的 , 而是能理解人意圖的 。

群聊的意義已超出協作本身——它讓AI在混亂中學習秩序 , 從被動的工具 , 逐步成為主動的參與者 。

從工具到同伴

群聊的出現 , 也讓AI第一次要在群體中找到自己的位置 。

在單人模式下 , 它是一個被召喚的工具;你提問 , 它回答 。

但在群聊里 , 它第一次必須在不確定中行事:什么時候該說?該幫誰?怎樣避免偏向某一方?

這種模糊性 , 恰恰是人類語言的魅力 。

我們在語言之間維系關系、在沉默里傳遞情緒、在誤解中繼續相處 。

而現在 , AI也要學會這些 。

就像社會學家Sherry Turkle在書中所寫:

我們正在教機器如何傾聽 , 而在這個過程中 , 也重新理解了什么是「回應」 。

這句話此刻顯得格外準確 。 群聊功能 , 不只是AI向人類靠近的一步 , 也是人類在重新定義「智能」的過程 。

我們也許會發現 , 它并不只是學會了回答 , 而是在模仿我們如何理解彼此——猶豫、揣測、試探、再靠近 。

當AI開始習慣這些不確定 , 我們會更清楚:真正的智能 , 從來不是「知道」 , 而是「相處」 。

ChatGPT「進群」 , 也許不會立刻改變什么 。

它暫時還不會安慰人、也分不清玩笑 , 但它開始能聽、能記、能在混亂中整理出脈絡 。

也許不久之后 , 它能幫我們總結會議、化解爭吵、甚至能捕捉一個群的情緒節奏 。

也許那時 , 它就成了群里那個永遠在線、從不生氣、偶爾提醒大家理性一點的「人」 。

參考資料:

https://x.com/btibor91/status/1988029080726630822

https://www.testingcatalog.com/openai-readies-chatgpt-group-chats-with-custom-controls/?utm_source

推薦閱讀

- “雙11”收官,電商的AI變革已經開始

- AMD蘇媽霸氣放話:Intel已不是對手!下一步要打敗NVIDIA

- iPhone Air銷量奇差無比!富士康已拆除大部分生產線,二代遙遙無期

- 釘釘發布DeepResearch多智能體框架,已在真實企業部署

- 紅米誠意十足!極窄直屏+7550mAh+1.5米抗摔,現已跌至1143元

- 蘋果,已找到了萬一要退出中國的退路?

- 小米升至第四!發布僅五周份額已達到6.4%,百度、海信優勢明顯!

- 國產最強EDA廠商:綁定中芯、華為等巨頭,工藝已達到4nm

- 一加15T再次被確認:規格已基本清晰!iQOO 15 mini:待定中!

- 沖上熱搜!官方已對淘寶“霸屏廣告”展開調查