文章圖片

文章圖片

當 AI 的 coding 能力變得足夠強 , 我們到底會迎來一個怎樣的未來?

2025年接近尾聲 , 這個問題正在變得更加迫切 。 我們已經(jīng)看到了多智能體AI 編程平臺的出現(xiàn) , 它們可以模擬產(chǎn)品經(jīng)理、程序員、甚至后端工程師的角色 , 團隊協(xié)作 , 讓「生成一個完整應(yīng)用」的門檻正在迅速下降 。

這帶來了一個極具想象力的「岔路口」:這究竟是會刺激一個「人人都是開發(fā)者」的時代 , 讓更多人參與到「做產(chǎn)品給別人用」的浪潮中?還是會帶來一次更徹底的用戶范式革命——即「人不再需要開發(fā)」 , 我們只需要有想法 , AI 就能即時生成滿足個人需求的工具?

螞蟻集團的全模態(tài)通用AI 助手「靈光」 , 似乎在探索后一條路 。

它提示了一種趨勢:AI 助手不只是一個「工具」 , 更應(yīng)該是一個「助理」 。 它有編程能力 , 但目的不是想讓你變成一個「小開發(fā)者」 , 而是當你提出一個需求時 , 它能用編程能力更簡單、更即時地幫你實現(xiàn) 。

「靈光」 , 一個真正能解決問題、降低門檻的實用工具 , 正在試圖通過兩大「殺手锏」破局:一是重塑AI信息的「全模態(tài)交互」 , 二是將 AI Coding鏟平到 0 門檻的「30秒閃應(yīng)用」 , 填補一個關(guān)鍵的市場空缺 。

一:「全模態(tài)信息」——當 AI 不再「廢話」螞蟻集團的「靈光」AI 助手 , 也有對話陪伴的基礎(chǔ)屬性 , 同時在這個基礎(chǔ)上 , 提供了更多實用的「功能性」 。

最近看到有國內(nèi)陸續(xù)一些核聚變企業(yè)融資的消息 , 想著迅速了解一下國內(nèi)在這個領(lǐng)域的進展 。 自己在谷歌上搜 , 看得有一頭沒一頭的 。 正好用「靈光對話」試了一試 。

視頻來源:極客公園

可以看到 , 不到半分鐘的時間 , 「靈光對話」就讀取完了50個網(wǎng)頁鏈接里關(guān)于2025年以來國內(nèi)關(guān)于核聚變領(lǐng)域的進展 , 并用簡明扼要的文字+圖表的方式呈現(xiàn)了出來 。

太快了 。 50個網(wǎng)頁 , 認真讀完起碼半小時 , 再加上總結(jié)、制作圖表 , 起碼兩三個小時了 。 但是「靈光對話」只用了不到半分鐘時間 。

我又想到了我司所在的798園區(qū) , 雖然已經(jīng)在這邊工作了蠻久 , 但似乎一直沒有好好逛過 , 也不知道園區(qū)里到底有什么好吃的店值得去 , 也問了問靈光 。

這次我沒有說給我總結(jié)圖表 , 而是讓靈光自由發(fā)揮 。

視頻來源:極客公園

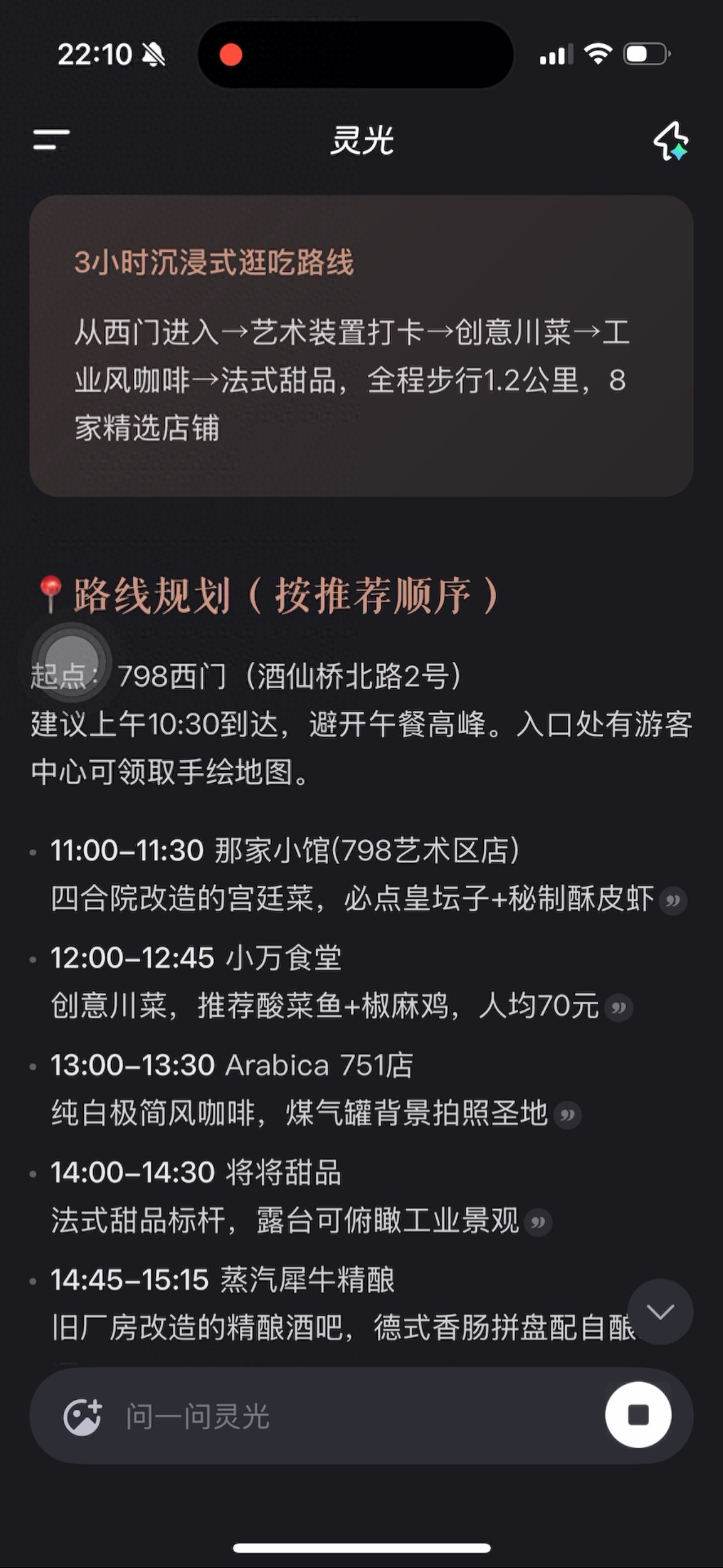

這次「靈光對話」花了不到一分鐘時間 , 就讀取了38個網(wǎng)頁 , 并給我生成了一份798美食探店路線 , 包含地圖導(dǎo)航的那種 。

可以看到 , 「靈光對話」為我生成了一份「3小時沉浸式逛吃路線」 , 連從哪個門進入 , 幾點到達能避開高峰期 , 全程要步行多久 , 路線幾家店鋪都包含了 。

圖片來源:極客公園

在路線規(guī)劃里 , 也貼心地按時間順序推薦了正餐、咖啡、甜品以及精釀等不同品類 , 就是這個午餐安排了兩頓 , 有點略顯重復(fù) 。

以及還有根據(jù)不同區(qū)域劃分的分區(qū)美食地圖 , 列出了幾家不同類型的店鋪 , 并注明了人均消費 。

最后雖然是「美食探店路線」 , 「靈光對話」還貼心了列出了幾條實用貼士 , 包括錯峰指南、穿搭建議、支付提示以及交通提示 。

錯峰指南、支付提示以及交通提示這些其實還好 , 但是穿搭建議 , 尤其是可以根據(jù)798工業(yè)園區(qū)的風(fēng)格推薦工業(yè)風(fēng)或文藝風(fēng)穿搭以及考慮到是石板地面 , 避免高跟鞋的建議 , 確實令我比較驚喜 。

體驗「靈光對話」后感受到它的不同之處 , 首先就在于對「極繁信息」的高度提煉 。

當提問一些復(fù)雜問題時 , 比如上面我問它 , 核聚變領(lǐng)域的進展這樣一個復(fù)雜話題 , 它給出的不是萬字長文 , 而是更清晰明了的動態(tài)圖表頁面 。

這是一種「信息美學(xué)」的勝利 。 它將復(fù)雜知識「化繁為簡」 , 提供了「結(jié)構(gòu)化」和「可視化」的答案 。

這背后是靈光實現(xiàn)了基于全代碼生成的多模態(tài)內(nèi)容輸出 。 當用戶提出問題時 , 靈光會自動理解其真實意圖 , 并以代碼為核心生成方式 , 實時構(gòu)建結(jié)構(gòu)化、個性化、且高度美觀的可交互的可視化結(jié)果 。 無論是圖表、樣式還是交互組件 , 都是由模型即時創(chuàng)造并呈現(xiàn)給用戶 。

據(jù)了解 , 「靈光」在架構(gòu)上的一大突破 , 是構(gòu)建了多智能體協(xié)作的Agentic架構(gòu) 。 在生成可視化內(nèi)容時 , 它會動態(tài)調(diào)用為圖像、3D、動畫等優(yōu)化的專用Agent 。 這些Agent實時協(xié)作 , 共同為用戶構(gòu)建出一個更完整、更豐富、更沉浸的視圖體驗 。

\"靈光\"將這種復(fù)雜的協(xié)作機制成功落地到了移動端 , 實現(xiàn)了真正的可交互內(nèi)容體驗 。 這種能夠在「端側(cè)」實現(xiàn)高級Agentic協(xié)作的產(chǎn)品 , 在業(yè)內(nèi)尚屬前沿 。

在市面上的眾多AI助手之中 , 「靈光」的「功能性」和「結(jié)構(gòu)化」回答正是其「自成一派」的特色 。 它像一個高效的「知識助理」 , 能真正地為工作、生活提高效率 , 而不只是能聊天的「話癆朋友」 , 這可能是大家現(xiàn)實生活中更迫切需要的 。

二:「30秒造應(yīng)用」——AI 的「魔法時刻」化繁為簡之外 , 靈光還讓我體驗到了「30秒生成應(yīng)用」的「魔法時刻」 。

作為長期觀察AI領(lǐng)域的作者 , 眼看著AI編程的火熱 , 時不時也會想著能不能借助AI的力量自己做個app 。

正好在前段時間 , 我司舉辦了「AI 時代的一周創(chuàng)業(yè)體驗」」團建項目 , 鼓勵跟蹤AI領(lǐng)域的大家親自動手手搓項目 , 當時我想做一個名為「emo鼓勵大師」的app , 「一個不問為什么 , 主打一個直接鼓勵的治愈系app , 也別分析了 , 也別審批了 , 就直接鼓勵 , 直接贊美 , 在心情低落的時候打開它會鼓勵你 , 不要難過;在心情平靜的時候它會夸獎你 , 讓你平地生勇氣;在心情激動的時候它也鼓勵你 , 沖沖沖 。 主打一個拐著彎地 , 不分晝夜地給你當頭一棒一樣的鼓勵與支持 。 最簡單的加油站 。 」

但是當時因為對AI編程工具使用的不熟練 , 也因為正好那段時間工作有點密集頻繁出差 , 能花在手搓項目上的時間并不多 , 這個提案也就擱置了下來 。

在了解到「靈光閃應(yīng)用」可以「0 門檻」地快速生成應(yīng)用之后 , 我馬上把之前那段提示詞輸入給了「靈光閃應(yīng)用」:

圖片來源:極客公園

我記得我之前嘗試用AI編程工具創(chuàng)作這個應(yīng)用時 , 因為編程技能的缺失 , 制作出的應(yīng)用只有固定的靜態(tài)頁面 , 無法互動交互 。 但是閃應(yīng)用這次真的迅速就給我產(chǎn)出了下面的這個可以實時交互的應(yīng)用 。

頁面呈現(xiàn)了三種情緒狀態(tài) , 每次點擊都會生成一句鼓勵 , 隨機鼓勵也可以生成暖心話語 。

我順勢又嘗試了創(chuàng)建另一個「7日健身打卡」應(yīng)用 , 準備拿來督促自己在冬天運動一番 。

可以看到 , 雖然我一開始的想法很簡單 , 只是想做一個「7日健身打卡」應(yīng)用 , 但在跟「閃應(yīng)用」的交互過程中 , 它不斷幫助我將應(yīng)用做得更加豐富飽滿 。

圖片來源:極客公園

到最后 , 我所拿到的就是這樣一個包含打卡提醒、完成運動、總運動時長、總卡路里消耗的更完善的健身打卡應(yīng)用 。 而且 , 這個應(yīng)用界面的設(shè)計簡潔明了 , 色彩搭配也很協(xié)調(diào) , 整體看上去令人舒適——在實現(xiàn)代碼的同時 , 「閃應(yīng)用」還給我免費做了一波UI設(shè)計 。

可以看到 , 「閃應(yīng)用」生成的應(yīng)用不只是靜態(tài)的前端頁面 , 而是已經(jīng)具備了完整的前后端邏輯 , 可直接調(diào)用大模型等后端能力 , 實時進行交互 。

9月的那次AI創(chuàng)業(yè)團建之后 , 關(guān)于手搓app的想法就懸在我的腦海里 , 但因為它不是什么「緊急且重要」的工作 , 而且也沒去學(xué)編程 , 也就任由它懸著 。

這次 , 螞蟻集團的「閃應(yīng)用」確實讓我這個不太懂編程的人 , 實現(xiàn)了腦海里懸而未決的想法 。 這可能也就是最近大家都在討論的AI平權(quán)的意義所在 , 讓每個人都可以快速創(chuàng)建應(yīng)用 。

2025 年以來 , 大模型領(lǐng)域的市場焦點已經(jīng)從 AI 助手轉(zhuǎn)向自主代理 , Cursor 等工具已轉(zhuǎn)型為代理式工作平臺 , 能自主規(guī)劃、執(zhí)行、驗證復(fù)雜任務(wù);GPT-5-Codex 和 Claude 4.1 等新模型支持多智能體協(xié)作 , 可自動分配開發(fā)任務(wù) , 實現(xiàn) \"需求→設(shè)計→編碼→測試\" 全鏈路無人干預(yù)……

而現(xiàn)在 , 「閃應(yīng)用」憑借 0 門檻/0 代碼更進一步地將「產(chǎn)品經(jīng)理」的視角和能力賦予了普通人 , 真正滿足了普通人埋在心中的「創(chuàng)作欲」和「分享欲」 ,

三:從「開眼」到「物理世界」 , 「AI 應(yīng)用」的終局是「工廠」?如果我們將「靈光」的產(chǎn)品組合串聯(lián)起來看 , 會發(fā)現(xiàn)一個清晰的閉環(huán):「開眼」功能及其代表的實時理解能力 , 是 AI 對物理世界的「輸入」和「理解」;而「閃應(yīng)用」 , 則是 AI 對數(shù)字世界的「輸出」和「創(chuàng)造」 。

這一進一出 , 清晰地預(yù)示著 AI 助手正在發(fā)生關(guān)鍵的范式轉(zhuǎn)移:從「信息搜索引擎」轉(zhuǎn)向「即時效用工廠」 。 在這個新范式下 , AI 的價值不再只是提供信息 , 而是生成可用的工具 。 在顧問的基礎(chǔ)上 , 它更是你的「工匠」和「生產(chǎn)線」 。 當用戶有一個想法時 , AI 可以直接交付一個可用的原型 , 幫用戶將想法實現(xiàn) 。

靈光的「0門檻」和「0代碼」是解放創(chuàng)造力的「破壁機」 。 在過去 , 一個好創(chuàng)意和一個可用的產(chǎn)品之間 , 隔著「技術(shù)實現(xiàn)」的鴻溝 。

普通人即使有「產(chǎn)品經(jīng)理」的視角 , 也缺乏「工程師」的能力 。 而「閃應(yīng)用」通過對話式AI Coding , 鏟平了這道門檻 。 它將開發(fā)的焦點從「我該怎么實現(xiàn)」拉回到了「我到底想要什么」 。

「快」 , 即時生成則是點燃「創(chuàng)作欲」的「催化劑」 。 傳統(tǒng)開發(fā)是重決策 , 而「閃應(yīng)用」是輕嘗試 。

當一個想法的實現(xiàn)成本(包括時間和金錢)趨近于零時 , 它帶來的就是「即時滿足感」 。 這種「所想即所得」的魔法時刻 , 極大地降低了人們的創(chuàng)作惰性 。 用戶可以隨心所欲地試錯、迭代 , 這種低成本的「手搓」快感 , 會不斷激發(fā)普通人心中那股被壓抑已久的創(chuàng)作沖動 。

而當一個應(yīng)用被「手搓」出來 , 「分享欲」就成了必然的閉環(huán) 。 與分享一張AI圖片不同 , 分享一個自己做出來的應(yīng)用 , 其實是在分享一種「效用」和「解決方案」 。 這種「我造了個工具 , 你也能用」的成就感 , 遠超簡單的內(nèi)容分享 。

而這種「快+即時滿足+分享欲」的驅(qū)動力 , 似乎架起了一座超級AI應(yīng)用工廠的骨架 。

回顧這一年 , 從年初以黑馬姿態(tài)殺出的 DeepSeek 到 , 再到年末「千問」的重啟 , 「靈光」的功能落地 , 我們能看到未來的 AI 創(chuàng)新 , 似乎更傾向于產(chǎn)品落地和用戶價值 , 而非沉溺于 AGI 的宏大敘事或擬人性的追求 。 當行業(yè)還在「卷」模型參數(shù)和「像不像人」時 , 這種務(wù)實主義成了一股清流 , 直指 AI 的商業(yè)本質(zhì)——解決問題 。

這或許給「百模大戰(zhàn)」的下半場提供了另一個答案:AI 的終局 , 可能不是那個最像人、最會聊天的 AI , 而是那個能讓最多的人用最低的門檻創(chuàng)造最大價值的 AI 。

【「30 秒造應(yīng)用」——螞蟻靈光點燃「所想即所得」的魔法時刻】它關(guān)乎效率 , 更關(guān)乎「平權(quán)」 。 而「靈光」的「閃應(yīng)用」 , 就是這場「創(chuàng)造力平權(quán)」運動中 , 一個極具想象力的起點 。

推薦閱讀

- 輕松覆蓋AI、辦公、游戲全場景應(yīng)用!體驗零刻GTR9 Pro迷你AI工作站

- 突發(fā)!全球大量網(wǎng)站和應(yīng)用出現(xiàn)崩潰癱瘓,歷史罕見!

- 讓大模型學(xué)會「心靈感應(yīng)」:基于思維溝通的多智能體合作范式來了

- ChatGPT:再見「破折號」

- 告別「一條路走到黑」:通過自我糾錯,打造更聰明的Search Agent

- 未來的 iPhone,想靠衛(wèi)星消滅「無服務(wù)」

- 30秒做應(yīng)用、實時寫圖文,「靈光」想用AI重塑創(chuàng)造力邊界

- arXiv開始拒收綜述論文了?「論文DDoS」這篇NeurIPS論文早有討論

- OpenAI新論文拆解語言模型內(nèi)部機制:用「稀疏電路」解釋模型行為

- LeCun在Meta的「最后一作」