文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

編輯:Aeneas KingHZ

【新智元導讀】超越DeepSeek-R1的英偉達開源新王Llama-Nemotron , 是怎么訓練出來的?剛剛放出的論文 , 把一切細節毫無保留地全部揭秘了!

現在 , 英偉達Llama-Nemotron系列模型 , 正式超越DeepSeek-R1!

而且 , 這些模型已經全部開源了 。

換句話說 , 在推理吞吐量和內存效率上顯著超越DeepSeek-R1的一系列推理模型 , 已經開源可用了 。

超越DeepSeek-R1的模型 , 究竟是怎么煉出的?

就在剛剛 , 英偉達發布了技術報告中 , 揭秘了模型訓練的關鍵——

· 利用合成數據監督微調+強化學習 , 全面提升模型的推理能力· 從頭構建完善的后訓練流程

論文鏈接:https://arxiv.org/abs/2505.00949

上個月 , 英偉達正式官宣了的Llama-Nemotron 253B , 一下子就讓發布3天的Llama 4變成了「陪襯」 。 (后者還陷入了刷榜等「誠信危機」)

發布之后 , 英偉達的這一系列模型在業界引起不小的轟動 。

根據人工分析智能指數 , 截至2025年4月 , Llama-Nemotron-Ultra被認為是目前「最智能」的開源模型 。

這次 , 英偉達一口氣推出了Llama-Nemotron系列三個模型——LN-Nano 8B , LN-Super 49B和LN-Ultra 253B 。

值得一提的是 , LN-Ultra不僅在性能上超越了DeepSeek-R1 , 還能在單個8xH100節點上運行 , 推理吞吐量更高 。

這些模型針對高吞吐量推理進行了優化 , 同時保持強大的推理能力和最多128K的上下文長度 。

LN-Ultra在各類推理任務中展現出領先的開源模型性能

并且 , 在全球AI開源屆 , 英偉達首次推出了推理開關功能 , 用戶只需通過系統提示詞「detailed thinking on/off」就可以動態切換標準聊天模式和推理模式 。

這種設計讓模型既能滿足日常通用需求 , 也能勝任復雜的多步驟推理 , 無需使用不同的模型或架構 。

揭秘構建過程

Llama-Nemotron模型的構建 , 分為五個階段 。

第一階段:利用神經架構搜索(NAS)在Llama 3系列模型基礎上優化推理效率 , 并引入前饋網絡融合(FFN Fusion) 。

第二階段:通過知識蒸餾和繼續預訓練來恢復模型性能 。

第三階段:進行有監督微調(SFT) , 結合標準指令數據和來自DeepSeek-R1等強大教師模型的推理過程 , 從而讓模型具備多步驟推理能力 。

第四階段:在復雜的數學和STEM數據集上進行大規模強化學習 , 這是學生模型能夠超越教師模型能力的關鍵一步 。 對于LN-Ultra , 這一階段在GPQA-D基準測試上帶來了顯著性能提升 , 確立其作為當前開源領域科學推理最強模型的地位 。

為了支持如此大規模的強化學習訓練 , 團隊專門開發了新的訓練框架 , 包含多項優化措施 , 其中最重要的是支持 FP8精度的生成能力 。

最后一個階段:簡短的對齊訓練 , 重點在于指令跟隨和符合人類偏好 。

全新架構設計:優化推理效率

借助神經架構搜索Puzzle框架 , LN-Super和LN-Ultra優化了模型推理效率 。

Puzzle能夠在實際部署限制下 , 將大語言模型轉化為更適配硬件運行的高效版本 , 如圖3所示 。

通過「逐塊局部蒸餾」的方式 , 開發者利用Llama 3 Instruct構建了替代Transformer模塊的庫 。

在這個過程中 , 每個模塊都會被獨立且并行地訓練 , 逼近原始模塊的功能 , 同時優化計算性能 。

這樣 , 每個替代模塊都具有特定的「精度-效率」權衡特性:有些模塊雖然更高效 , 但可能會帶來一定的質量下降 , 從而形成一種在計算成本與模型準確性之間的明確取舍 。

這些模塊的變體包括:

- 注意力機制移除:某些模塊完全省略了注意力機制 , 從而降低了計算量和KV緩存的內存消耗 。

- 可變的FFN維度:前饋網絡的中間維度被調整 , 能以不同粒度對模型進行壓縮 。

這個選擇過程由混合整數規劃(MIP)求解器控制 , 它會根據一系列約束條件(如硬件兼容性、最大允許延遲、內存預算或期望的推理吞吐量)來找出最優配置 。

Puzzle框架概覽

垂直壓縮與FFN融合

在LN-Ultra模型中 , 研究者引入了一項額外的壓縮技術 , 稱為FFN Fusion(前饋網絡融合) , 用于減少模型的序列深度并提升推理延遲效率 。

Puzzle在移除部分注意力層后 , 模型結構中出現的一種特性:模型中常會出現多個連續的FFN塊 。

FFN Fusion能識別出這些連續結構 , 并將其替換為更少但更寬、可并行執行的FFN層 。

這種替換方式在不犧牲模型表達能力的前提下 , 減少了順序計算的步驟 , 顯著提升了計算資源的利用率——特別是在多GPU環境中 , 跨層通信開銷不可忽視的情況下 , 效果尤為明顯 。

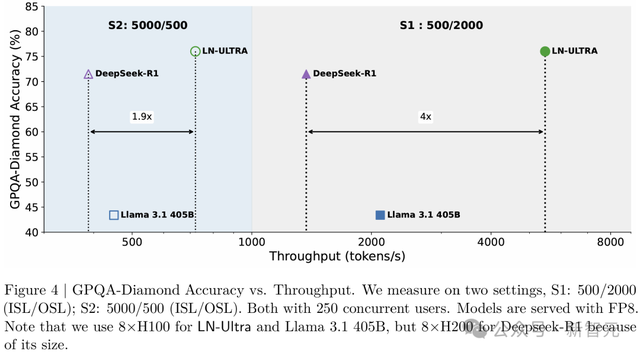

圖4展示了在GPQA-Diamond準確率(%)與處理吞吐量(token/秒)之間的權衡 。

值得注意的是 , LN-Ultra始終在準確性和效率上優于DeepSeek-R1和Llama-3.1-405B , 取得了準確性和效率的最佳平衡 。

GPQA-Diamond模型的精確度與吞吐量對比

NAS后訓練:知識蒸餾與持續預訓練

在神經架構搜索(NAS)階段之后 , LN-Super和LN-Ultra都進行了額外的訓練 , 以提升模塊之間的兼容性 , 并恢復在模塊替換過程中可能出現的質量損失 。

- LN-Super使用Distillation Mix數據集 , 在知識蒸餾目標下訓練了400億個token 。

- LN-Ultra首先使用相同的蒸餾數據集進行知識蒸餾訓練 , 訓練了650億個token;隨后又在Nemotron-H第四階段預訓練數據集上繼續訓練了880億個token 。

這就 , 表明通過簡短的蒸餾與預訓練 , 可以在激進的架構優化和高模型性能之間實現兼容 。

監督微調

想讓Llama-Nemotron模型擁有超厲害的推理能力?

監督微調(Supervised Fine-Tuning , SFT)這一步簡直就是「神助攻」 。

前面的開發階段 , 團隊主要在研究怎么讓模型架構更高效 , 怎么把海量知識塞進去 。

而SFT就像給模型請了一位「私人教練」 , 專門針對特定任務的推理步驟 , 帶著它從DeepSeek-R1這些「學霸」模型身上 , 偷師推理技巧 。

不過要想讓模型真正擁有扎實的推理功底 , 大規模、高質量的推理訓練數據必不可少 。

合成數據

研究者為監督微調精心整理了包含推理和非推理的數據樣本 。

對于推理樣本 , 他們在系統指令中加入「detailed thinking on」(開啟詳細思考) , 而對于非推理樣本 , 則使用「detailed thinking off」(關閉詳細思考) 。

這種設置 , 使模型能夠在推理階段根據提示內容切換推理行為 。

為推理 , 精心準備了數學、代碼等相關領域的合成數據 。

為了訓練模型遵循「推理開關」指令 , 研究者構建了成對的數據集 , 其中每個提示都對應一個帶推理的回復和一個不帶推理的回復 。

這種配對方式 , 使模型能夠根據系統指令學習調節其推理行為 。

隨后會依據標準答案或獎勵模型對這些回復進行篩選 。

微調流程

在指令微調數據上 , 所有模型的訓練 , 均采用token級交叉熵損失 。

在大多數訓練設置中 , 推理數據和非推理數據會被混合在一起 , 形成訓練批次 , 其中每個提示都會根據系統指令「detailed thinking on/off」的條件 , 與相應的響應配對 。

延長訓練至多輪周期能提升性能 , 對小模型尤為明顯 。

這次主要使用NeMo-Aligner來進行強化學習訓練 , 支持GRPO以及異構模型的訓練 。

論文鏈接:https://arxiv.org/abs/2405.01481

生成階段使用vLLM實現 , 訓練階段則使用Megatron-LM 。

訓練和推理階段共用同一批GPU , 在同一設備上完成 。

整個訓練過程中 , 他們共使用了72個節點 , 每個節點配備8張H100 GPU 。

生成階段采用FP8精度 , 訓練階段采用BF16精度 , 優化器狀態使用FP32 。

每個階段維護一份獨立的模型權重 , 并在每一步開始時進行同步 。

強化學習:超越R1推理能力的關鍵

監督微調(SFT)可以讓模型從強大的教師模型中提煉知識 , 從而獲得出色的能力 。

然而 , 知識蒸餾本質上為學生模型的性能設定了上限 , 特別是當學生模型的基礎模型能力不超過教師模型時 。

通過監督微調 , LN-Ultra的性能可以接近DeepSeek-R1 , 但無法超越它 。

為了使學生模型超越教師模型 , 大規模強化學習(RL)是一種可行的方法 , 因為它允許模型持續探索新的可能性并進行自我學習 。

由于資源限制 , 研究者僅對LN-Ultra應用推理RL , 結果得到超越教師模型的學生模型 。

在整個推理強化學習訓練過程中 , 在GPQA-Diamond數據集上 , LN-Ultra的準確性

訓練流程

對于LN-Ultra , 研究者通過大規模強化學習(RL)增強它的科學推理能力 , 采用DeepSeek-R1同款的分組相對策略優化(GRPO)算法 。

整個訓練過程大約需要14萬H100小時 , 持續訓練模型直至其在推理任務上實現收斂 。

圖5顯示了訓練過程中GPQA-Diamond的準確率得分 。

獎勵機制設計包含兩類:

- 準確性獎勵:基于標準答案(數值/句子/段落) , 調用Llama-3.3-70B-Instruct模型判斷預測結果匹配度

- 格式獎勵:遵循DeepSeek-AI的方案 , 強制模型在「詳細思考」模式下用<think>標簽包裹推理過程 , 非該模式時禁止出現此類標簽

- 數據篩?。 涸は仁褂肔N-Super對每個問題生成8條響應 , 剔除通過率≥75%的簡單樣本

- 課程訓練:采用基于通過率的漸進式批次分配(圖6驗證其有效性)

- 動態分布:以高斯函數建模批次難度 , 初期側重高通過率(簡單)樣本 , 后期轉向低通過率(困難)樣本

- 填充邏輯:優先按目標分布分配樣本 , 剩余容量從最大剩余樣本池補充

- 批內處理:同批次樣本隨機打亂以保持多樣性

用于偏好優化的強化學習

在完成科學推理訓練之后 , 研究者對LN-Super和LN-Ultra模型進行了一個簡短的強化學習階段 , 重點提升其指令跟隨能力 。

研究者還使用RLHF對模型的通用幫助能力和聊天表現進行優化 , 同時保留了模型在數學、科學等其他領域的能力 。

如表4所示 , LN-Super在Arena Hard測試中取得了88.3的高分 , 超越了專有模型如Claude 3.5 Sonnet和GPT-4o-2024-05-13 , 也優于體量更大的開源模型 。

為了實現這一結果 , 他們采用了「在線RPO」(OnLine Reward-Policy Optimization)方法 , 最大化模型在HelpSteer2數據集上的預測獎勵 , 獎勵模型使用的是Llama-3.1-Nemotron-70B-Reward 。

兩輪在線RPO訓練將Arena Hard得分從69.1提升到88.1 。

對于LN-Ultra , 他們使用類似流程 , 但采用了GRPO 。

對于LN-Nano , 他們進行了兩輪離線RPO訓練 , 使用基于策略生成的訓練數據 。

【超越DeepSeek-R1英偉達開源新王登頂!14萬H100小時訓練細節曝光】在第一輪中 , 結合推理類和非推理類數據 , 并配合適當的系統提示詞 , 以優化模型的推理控制能力 。 第二輪則專注于提升指令跟隨能力 。

評估結果

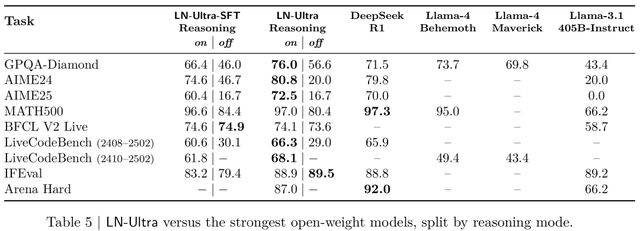

研究者在兩個基準類別上評估所有Llama-Nemotron模型的性能:推理任務和非推理任務 。

推理類基準包括:AIME24和AIME25、GPQA-Diamond、LiveCodeBench以及MATH500 。

非推理類基準包括:用于指令遵循評估的IFEval、用于函數調用工具使用評估的BFCL V2 Live以及用于評估對人類對話偏好對齊度的Arena-Hard 。

表3顯示 , 盡管模型體積較小 , LN-Nano在所有推理類基準測試中都取得了出色的表現 。

這表明 , 監督微調流程和精心策劃的推理數據集 , 在將結構化推理能力遷移至小型模型方面是有效的 。

表4將LN-Super與其參數規模相近的其他模型進行了對比 , 可見這個模型在推理任務和非推理任務中都表現出強勁的競爭力 。

在「推理關閉」模式下 , LN-Super的表現與其蒸餾來源模型Llama-3.3-70B相當;在「推理開啟」模式下 , 則超越了其他競品模型 , 例如DeepSeek-R1-Distilled-Llama-70B , 在保持良好指令遵循能力的同時展現出強大的推理能力 。

這些結果表明 , LN-Super是一個兼具推理優化模型和非推理模型優點的通用模型 , 適用于日常助手型任務和結構化推理任務 。

表5顯示 , LN-Ultra 在推理和非推理基準測試中 , 與所有現有的開源權重模型相比表現持平或更優 。 它在GPQA上達到了開源模型中的最先進水平 , 充分證明了英偉達研究者大規模強化學習訓練方法的有效性 。

與DeepSeek-R1需要使用8×H200的硬件配置不同 , LN-Ultra專門優化為可在單個8×H100節點上高效運行 , 從而提供更高的推理吞吐量和部署效率 。

從表5可見 , LN-Ultra的SFT階段已經在多個推理基準測試(包括GPQA和AIME)上接近或達到DeepSeek-R1的性能 。

除了模型原本接受訓練的推理和對話能力之外 , 他們還對模型在一個分布外任務 。

具體來說 , 模型在JudgeBench數據集上進行了測試 , 要求區分高質量與低質量的回答 。

如表6所示 , 新模型在該任務上表現優于當前頂尖的專有模型和開源模型 。

其中 , LN-Ultra成為表現最好的開源模型 , 明顯超過了 DeepSeek-R1 , 僅次于專有模型 o3-mini(high) 。

此外 , LN-Super 的表現也超過了o1-mini , 這說明新模型在各類任務中具備很強的泛化能力 。

參考資料:

https://arxiv.org/abs/2505.00949

推薦閱讀

- 消息稱英偉達RTX 5090 D顯卡確定禁售中國大陸市場,或成絕版!

- 英偉達已向中國三家企業通報:不觸犯規則,繼續向中國供應產品

- 曝英偉達計劃在華獨立運營 國產旗艦之王價格滑鐵盧

- 英偉達RTX 5060 Ti顯卡曝光 國產機皇低至百元網友直呼按打買

- 有必要買相機嗎?手機拍照真的可以媲美甚至超越相機拍照了嗎?

- 突發!小米開源MiMo大模型,性能超越OpenAI

- 200元!OPPO這外掛鏡頭有點意思,能超越“超大杯”?

- 泰晤士高等教育:2030年前中國將超越美國成為全球AI領導者

- 小米超越華為OPPO,重返中國手機市場第一

- 超越1英寸+6600mAh+屏下前攝,努比亞的影像旗艦新機,絕活真不少