文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

有一說一 , 最近國內的AI大模型圈 , 屬實有點安靜了 。

先不談大伙萬眾矚目的DeepSeek-R2了 , 這玩意除了半真半假的爆料以外 , 沒有一點動靜 。

去年打得你來我往的AI六小虎 , 今年好像也和小貓一樣蔫了 。

雖說也有發布 , 但總的來說 , 確實沒什么特別讓人驚艷的產品 , 也沒啥讓人使用的欲望 。。

但就在昨天凌晨 , 沉睡的小虎突然嚎了一聲:MiniMax宣布 , 開源他們的首個推理模型MiniMax-M1 。

從跑分圖來看 , 其他方面算是中規中矩 。 但MRCR這項測試 , 也就是上下文長度測試 , 似乎表現出了驚人的統治力 , 跟其他開源模型拉開了一大截 , 僅略遜于Gemini2.5Pro 。。

而且據Minimax團隊博客所說 , 強化學習階段的算力成本僅有50多萬美元 。

又來個以小博大嗎?有點意思 。

世超也去下載了他們的技術報告看了一眼 , 給大家說說里面的亮點吧 。

首先 , MiniMax采用了一種叫“閃電注意力”的機制 。 其實也不算什么新機制 , 算一種傳統注意力機制的優化版 。 簡單來說就是讓模型在處理數據時 , 需要讀寫的次數更少 , 因此大大提升了模型的效率 , “閃電“這名字當然也是這么來的 。

其次 , MiniMax-M1 的 RL 訓練框架上也進行了創新 。

我們經常在推理模型里看到“嗯”、“等等”、“啊哈”這樣的詞 , 咱感覺它們沒啥用 , 但其實它們對模型訓練來說非常重要 。

但 , 一些舊的算法在訓練過程中 , 也會覺得它們沒用 , 所以很容易忽略它們 。。

所以MiniMax提出了一種叫CISPO的新算法 , 解決方法是 , 稍微調低一點這些詞的“影響力” , 這樣既能讓 AI 學到關鍵的推理思路 , 又不會因為這些語氣詞而干擾整個訓練過程 。

從論文來看 , 這同樣提高了模型的訓練速度 , 打敗了傳統的GRPO、DAPO 。

世超也是上手體驗了一波 , 總的來說 , 體驗可以說還不錯 , 有值得說道的地方 。

先聊聊上下文吧 , 可能還有很多差友不知道跑分圖中的MRCR( 4-needle )是什么意思 。

之前 , 我們要測試模型的上下文長度 , 使用的招數叫“大海撈針” 。 也就是往一本書的文本里塞一條特殊的信息 , 比如“差評前沿部牛大了” 。

然后把這本書喂給AI , 再問他差評前沿部是不是牛大了 , 用它的回答來看它是不是記住了這條信息 。

但AI圈的內卷已經讓這個測試不夠用了 , 隨之而來的是全新升級版——MRCR(Multi-Round Co-reference Resolution) 。

如果說前面那個叫大海撈針 , 那MRCR(4-needle)就是撈4根針 , 并研究出4根針各自的聯系 。

所以 , 這測試不僅考驗它能不能在信息海洋里撈到針 , 還要看它能不能在撈針的時候不被冗余信息沖昏頭腦 , 可以說是非常難了 。

而MiniMax能把其它模型甩在身后 , 肯定也是有點東西的 。

世超也簡單做了個測試 。 我下載了個txt版本的電子書 , 赫爾曼·梅爾維爾的《白鯨記》 , 約20萬個單詞 。 然后在里面偷偷加了句話:世超吃了生蠔后掉進了泥里 。

生蠔掉進了泥土里 , 原來這就是蠔喜歡泥

然后我把書丟給MiniMax , 并詢問它我的問題 , 它的回答言簡意賅 。

不錯 , 有點水平 。

而Gemini , 則是精準說出了這句話所在的位置 , 第135章 , 而且速度也更快 , 甚至還識別出這句話是我自己加上去的 , 因為它說和上下文并無關聯 。。 只能說不愧是第一名 。

但 , 我丟給DeepSeek , 它說它根本讀不完 。。

只能說上下文長度這塊 , MiniMax確實能算頂級 。

當然 , 只有這個肯定不夠 。 世超還在Arxiv上隨便找了篇文章 , 專挑那種看不懂的、公式多的 , 差友有看得懂的也可以評論區交流 。

結果我發現 , MiniMax可以作為科研狗的搬磚利器 。

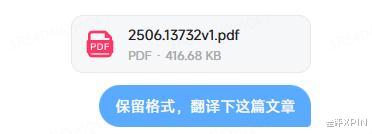

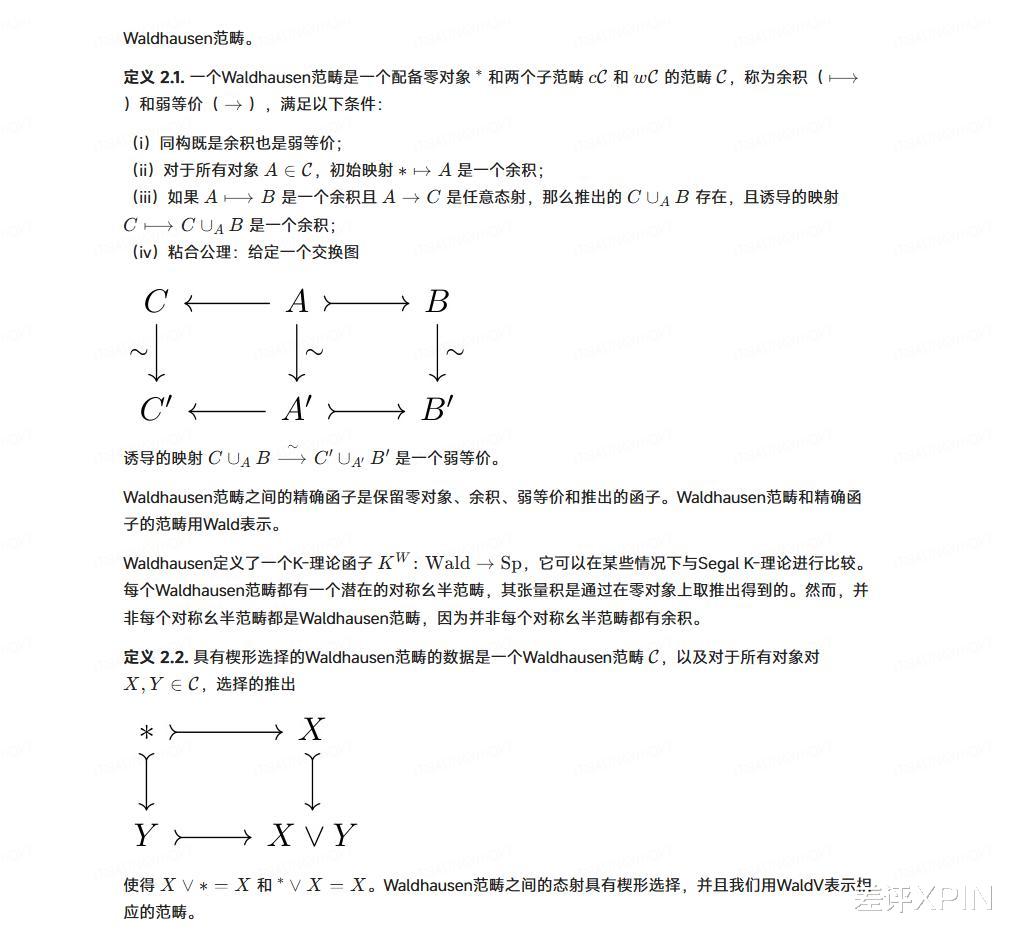

我把文獻分別丟給MiniMax、DeepSeek、Gemini , 讓它們保留格式翻譯文章 。

咱來看看MiniMax的結果:

別的不說 , 這排版看起來就很清爽 , 英文被翻譯成了中文 , 但公式的位置完全沒變 。 甚至 , 還能把圖附在翻譯里 。。

雖然內容不是100%正確 , 但看了就讓人心情愉悅 , 起碼看文獻的時候 , 窗口不用切來切去了 。

DeepSeek這邊 , 其實也還不錯 , 但正文里的圖片它就附不上來了 。

但Gemini這邊 , 排版甚至有點災難 。。

因此啊 , 以后大家讀文獻用MiniMax , 應該又能提升一波效率了 。

接著 , 咱來測下編程能力 , 我讓它們做了一個模擬多米諾骨牌的html文件 。 要求也很簡單:

點擊并拖動鼠標 可以在畫布上創建一排多米諾骨牌 。

松開鼠標 后 , 最后一枚骨牌會被推倒 , 引發連鎖反應 。

點擊屏幕底部的 \"RESET\" 按鈕可以清空畫布 , 重新開始 。

咱先來看優等生的 。 Gemini直接大手一揮 , 做出來一個完美的程序 。

DeepSeek這邊 , UI還挺看著酷炫的 。 就是感覺 , 代碼有點投機取巧了 。。 沒有感受到碰撞 , 純純是讓多米諾自己躺平的 。。

MiniMax這邊 , 就純粹不是多米諾了 , 這是給大哥大嫂磕了個響頭 。

只能說編程這一塊 , 還有進步空間啊 。

從這次發布來看 , MiniMax的確還在搞自己的新東西 , 前一陣還發了自己的聲音模型 , 效果也很不錯 , 有以假亂真之勢 , 感興趣的差友也可以去試試 。

最后提一句 , MiniMax在發布M1推理模型的同時 , 還宣布了為期五天的連更計劃 , 也就是說 , 這周每天晚上都能享受到一款新模型 。 不知道大的還在不在后面?還真讓人有點期待了 。

【用50萬刀追平世界第一,MiniMax的新模型是怎么做到的?】

推薦閱讀

- 驍龍8至尊+衛星通信,榮耀6月用力過猛,16G+1TB跌價1199元

- 618沒有買iPhone16?不用后悔,iPhone17更值得買

- 對話紅帽高層:如何用開源的方法將AI帶入企業

- 手機運存卷到24GB了,是用戶剛需還是營銷噱頭?

- 驍龍8至尊版+1TB存儲,售價均不貴,耐用性極強的兩款手機!

- GaN,商用大跨步

- Adobe發布Firefly手機應用,旨在整合多家大模型

- 壕無人性!華碩發布黃金版5080顯卡,使用6.5克真金

- ChatGPT被指誘導用戶陷入陰謀論

- 庫克終于妥協,iPhone16e提前跌至“清倉價”,一步到位用六年