文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心發布

機器之心編輯部

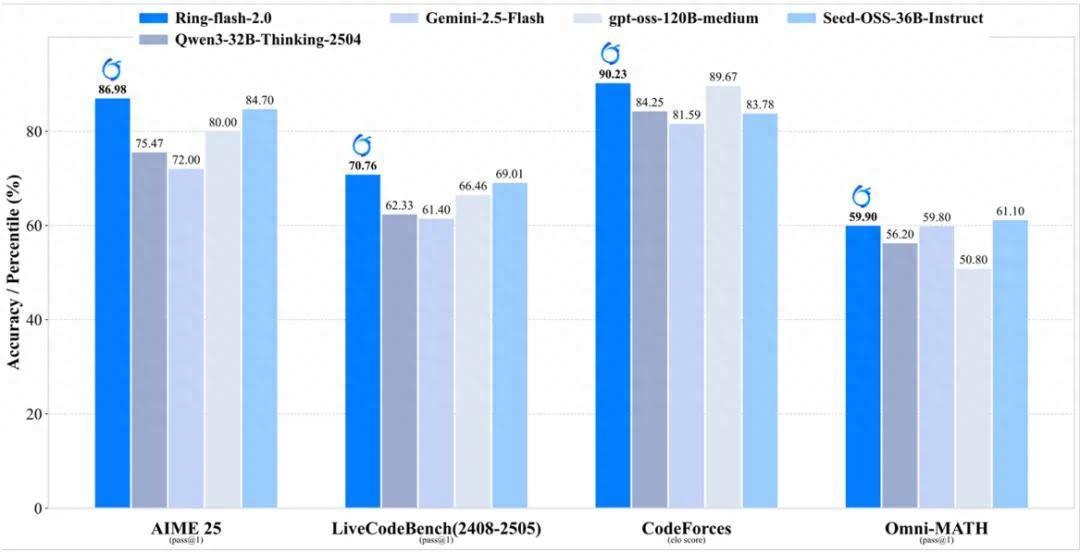

“MoE+Long-CoT(長思維鏈)+RL(強化學習)” 這條技術路線存在難以兼顧訓練穩定性和效果的難題 。 9 月 19 日 , 螞蟻百靈大模型團隊把 “難啃的骨頭” 直接做成開源禮包 ——Ring-flash-2.0 。 100B 總參、6.1B 激活 , 數學 AIME25 拿下 86.98 分 , CodeForces elo 分數 90.23 , 128K 上下文實測 200+token/s 。

更關鍵的是 , 他們通過獨創的棒冰(icepop)算法和長周期的 RL 訓練 , Ring-flash-2.0 在多項推理榜單上(數學、代碼和邏輯推理)取得了顯著突破 , 性能達到了 40B 以內 dense 模型的 SOTA 水平 , 甚至可與參數量更大的 MoE 模型相媲美 。

Ring-flash-2.0 性能表現

機器之心深度拆解 , 這一開源項目 , 為什么可能改寫下一階段大模型的競爭節奏 。

一、從 “不能用” 到 “敢開源”:MoE 長思考的臨界點

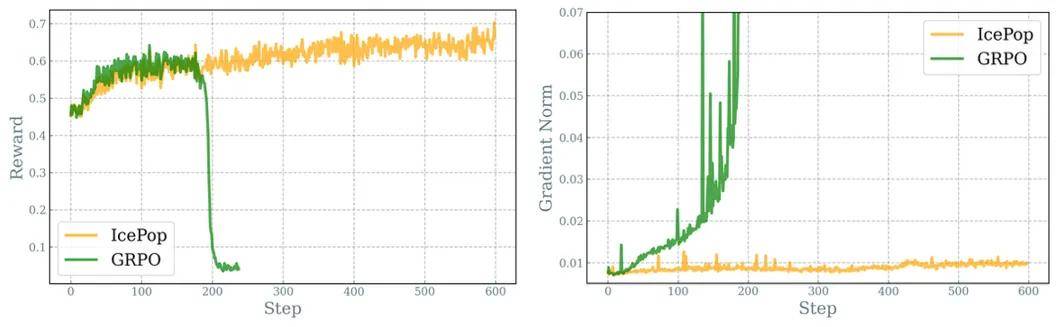

2025 年 , 業內流行一張 “死亡曲線”:在長思維鏈場景下 , MoE 模型 RL 訓練存在獎勵崩潰的問題 。 于是大家只能把學習率調小、任務提前終止 , 無法繼續訓練 。

棒冰(icepop)算法:讓 RL 進行長周期的穩定訓練

Ring-flash-2.0 的破冰點在于 “棒冰(icepop)”:雙向截斷 + 掩碼修正 , 一句話總結 ——“把訓推精度差異過大的 token 當場凍住 , 不讓它回傳梯度” 。

最終 , icepop 能夠保持穩定的強化學習訓練過程 , 避免了 GRPO 出現的訓練崩潰問題 。

左圖為 GRPO 訓練到 180-200 步開始崩潰 , icepop 能實現持續穩定提升; 右圖為 GRPO 訓練不久出現梯度爆炸 , icepop 能持續穩定在合理范圍 。

與 GRPO 相比 , icepop 還將訓推精度差異約束在合理范圍內 , 顯示出對于控制訓推精度差異有效性 。

左圖為 GRPO 訓推精度差異隨著訓練成指數上升 , icepop 較為平穩;右圖為訓推精度差異最大值 , GRPO 隨著訓練上升非常明顯 , icepop 維持在較低水位 。

效果肉眼可見:訓練再也不崩 , 百靈團隊內部笑稱 , “終于不用擔心訓練無法長跑的問題” 。

詳細的棒冰(icepop)算法介紹參考技術博客:https://ringtech.notion.site/icepop

Two-staged RL:先 “算對” , 再 “像人”

百靈大模型團隊首先采用 Long-CoT SFT , 采用包含數學、代碼、邏輯和科學四大領域為主體的多學科高質量推理數據集 , 讓模型 “學會思考”;第二步 , 通過可驗證獎勵的 RLVR(Reinforcement Learning with Verifiable Rewards) , 把推理逼到極限;隨后 , 加入 RLHF , 用高質量人類偏好數據 , 把格式、安全、可讀性拉回舒適區 。

百靈團隊驗證了直接融合 RLVR+RLHF 的聯合訓練和 Two-staged RL , 兩種方式在實驗中效果差異不大 。但由于 RLVR 和 RLHF 的問題難度不一致 , RLHF 的思維鏈長度相對較短 , 放在一起訓練會有較多等待長尾現象 , 從工程效率角度 , 使用了 Two-staged RL 方案 。

二、6.1B 激活打平 40B Dense , 成本曲線出現 “拐點”

大模型競爭進入 “第二幕” , 核心指標不再是 “誰參數多” , 而是 “誰性價比高” 。

Ring-flash-2.0 架構圖 。

繼承 Ling 2.0 系列的高效 MoE 設計 , 通過 1/32 專家激活比、MTP 層等架構優化 , Ring-flash-2.0 僅激活 6.1B (non-embedding 4.8B) 參數 , 即可等效撬動約 40B dense 模型的性能 。

得益于小激活、高稀疏度的設計 , Ring-flash-2.0 在 4 張 H20 部署下實現 200+ token/s 的吞吐 , 大幅降低高并發場景下 Thinking 模型的推理成本 。 同時 , Ring-flash 借助 YaRN 外推可支持 128K 長上下文 , 隨著輸出長度的增加 , 其相對加速比最高可達 7 倍以上 。

【攻克大模型訓推差異難題,螞蟻開源新一代推理模型Ring-flash-2.0】生成速度對比

競賽數學視頻

貪吃蛇case

arcprize case

冒泡排序可視化

粒子煙花模擬

生成搜索引擎首頁 query:請仿照 Perplexity , 設計并生成一個搜索引擎首頁 , 網站名稱為 “想搜” , slogan 為 “想搜 , 才會贏” 。 請實現基本的搜索界面、風格化 Banner 和搜索輸入區 。

生成搜索引擎首頁

結語:大模型競爭進入 “高性價比” 時代

從 2022 年 ChatGPT 點燃生成式 AI , 到 2024 年長思考成為新戰場 , 行業一直在等一個 “既聰明又便宜” 的推理模型 。 Ring-flash-2.0 用 100B 總參、6.1B 激活、200+token/s 的速度 , 把「Long-CoT + RL」做到工程可落地 , 還順手把訓練穩定性、推理成本、開源生態一次性打包 。

如果說 GPT-4 開啟了 “大模型可用時代” , 那 Ring-flash-2.0 或許正式拉開了 “MoE 長思考高性價比時代” 的帷幕 。 剩下的問題只有一個:你準備用它做什么?

開源地址:

HuggingFace:https://huggingface.co/inclusionAI/Ring-flash-2.0 ModelScope:https://modelscope.cn/models/inclusionAI/Ring-flash-2.0 GitHub: https://github.com/inclusionAI/Ring-V2 技術博客: https://ringtech.notion.site/icepop文中視頻鏈接:https://mp.weixin.qq.com/s/GP6SkIP0Pq1j08XL0XccoQ

推薦閱讀

- 海淀105款大模型背后:看這些AI玩家如何搶占內容生產制高點

- IDC:2025年上半年大模型公有云市場 火山引擎占比49.2%排名第一

- 梁文鋒在《自然》發表封面論文,DeepSeek成首個嚴格學術審查大模型

- iPhone18ProMax或迎來黑色回歸?蘋果終于攻克掉漆魔咒!

- 降低大模型幻覺、讓企業AI輸出更靠譜,亞馬遜云科技掏出10年家底

- MachineLearningLM給大模型上下文學習裝上「機器學習引擎」

- 大模型碰到真難題了,測了500道,o3 Pro僅通過15%

- KV Cache預算降至1.5%!他們用進化算法把大模型內存占用砍下來了

- 上海AI“北斗七星”矩陣再添成果,斑馬智行元神AI大模型完成備案

- 機器人交互、金融大模型輪番上陣 服貿會上銀行展出滿滿科技感