【通過“生逢其時”的Mini AI工作站,AMD正在開啟全民AI新時代】

文章圖片

文章圖片

文章圖片

文章圖片

近期 , AMD 舉辦 Mini AI 工作站創新分享沙龍 , 展示分享了AMD在推動AI創新方面的動態 , 表露出AMD在推動AI“最后一公里”落地的雄心壯志 。

打造AI時代“樹莓派” , 讓每個人玩轉大模型

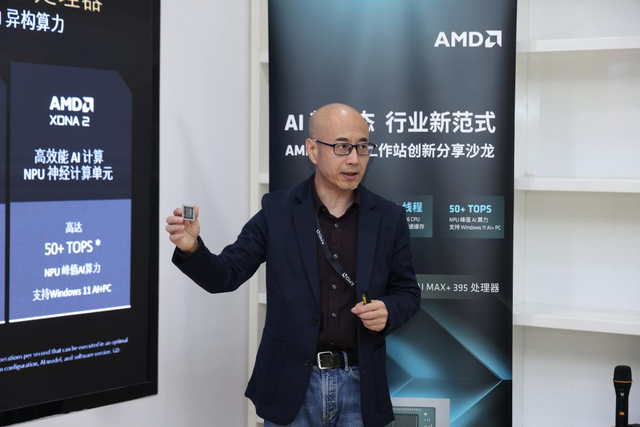

AMD大中華區市場營銷副總裁紀朝暉清晰地表達了AMD的愿景:“我們的目標是像互聯網時代的樹莓派那樣 , 把銳龍AI Max+ 395變成AI時代的普及者 。 ”能有這樣的雄心壯志 , 是因為“蘇媽”Lisa Su博士的判斷:“AI是50年以來最重要的技術變革 , 甚至超過了互聯網 。 ”

然而 , 強大的AI能力與普通開發者乃至中小型企業之間 , 始終隔著一道由高昂成本和專業門檻筑成的高墻 。 一方面是動輒數十萬、需要專業機房維護的AI服務器;另一方面是算力有限、難以承載百億參數大模型的個人電腦 。 市場中存在一個巨大的空白地帶:一個既能提供強大AI推理能力 , 又具備親民價格和友好工作環境的平臺 。

在這樣的背景下 , AMD基于銳龍AI Max+ 395的強勁實力 , 提出了AMD Mini AI工作站這個破局之道 。 “可以說它是生逢其時 , 需要這么一個工作組級的AI Agent的推理機 , 或者工作組級的AI工作站 。 ”AMD 對 Mini AI工作站信心滿滿 。

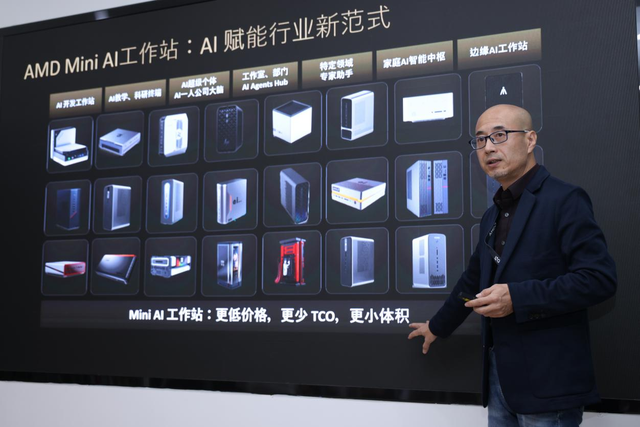

目前 , 搭載銳龍 AI Max+ 395 的 Mini AI 工作站已有超過 20 款產品 , 在這次沙龍活動現場展出了來自Abee、惠普、極摩客、銘凡、天鋇、六聯、零刻、希未等廠商搭載銳龍AI Max+ 395 Mini AI工作站的產品:

除了搭建Mini AI工作站這樣的硬件平臺 , AMD也在賦能開發者 。 紀朝暉表示 , AMD已經與RlPPLE AI合作上線了專屬于AI MAX+ 395 mini AI 工作站開發者的平臺 , 向開發者提供開箱即用的開發套件、詳盡的工具文檔、豐富的教程模板以及活躍的開發者社區 , 將AI開發的門檻降至最低 , 真正賦能每一位AI愛好者、開發者和超級個體 。

產品形態迅速壯大 , 高性能凸顯真正價值

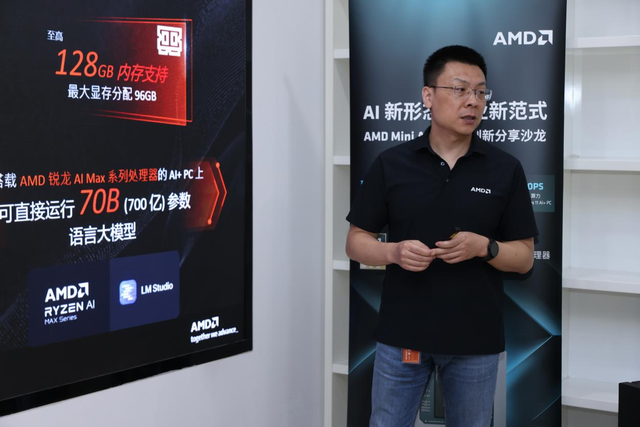

AMD大中華區家用產品市場總監廖金寧以翔實的技術細節與生動的產品故事 , 解讀了AMD在AI全民化的雄心壯志 。 他首先從CPU、GPU和AI軟硬件三個維度 , 清晰地剖析了銳龍 AI Max+ 395處理器的硬核實力 。

廖金寧強調 , 銳龍AI Max+ 395處理器不僅CPU性能強悍 , 其40 CU的GPU配置更是遠超傳統輕薄本的8-12 CU 。 而在迎接AI時代這方面 , 銳龍 AI Max+ 395處理器也做好了準備 。

首先 , 銳龍AI Max+ 395處理器內置的50 Tops算力NPU , 在Windows 11 AI+ PC的定義中 , 毫無疑問是頂級的配置 。 其次 , 憑借架構定義優勢 , 銳龍AI Max+ 395處理器可使用至高96GB的GPU專用顯存 。 這意味著搭載銳龍AI Max+ 395處理器的機型 , 不僅能有非常強大的端側和邊緣側的AI推理能力 , 而且可以加載更大容量的模型 , 實現更高精度的推理效果 。

符合AI發展趨勢 , 千行百業中釋放潛力

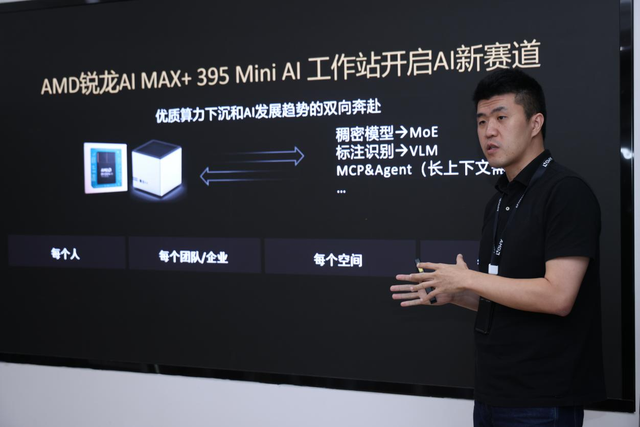

AMD 大中華區AI市場經理昝仲陽則是從AI技術演進的前沿視角 , 深刻揭示了AMD Mini AI工作站在當下節點和未來的價值 。

他指出 , 當前的AI模型正從稠密模型向MoE(混合專家)架構演進 , 這類模型參數量巨大 , 激活參數相對較小 , 這一其發展趨勢與銳龍AI Max+ 395的硬件特性形成了完美契合——既需要大顯存來裝載模型 , 又需要足夠的的GPU算力來保證推理速度 。

與此同時 , AI Agent和MCP(模型上下文協議)等應用的興起 , 使得對超長上下文的需求激增 , 同樣極大地消耗著顯存 。 昝仲陽分享了一個實際測試:“如果去做GPT-OSS-120B , 如果我不做任何上下文的配置 , 默認4096tokens , 加載模型的話可能只要60G的顯存就夠 。 但是如果要用到MCP , 我就要把我的上下文拉到最高132K(開啟flash attention和KV cache量化的情況下) , 顯存立馬飆到了80G 。 ”

在銳龍AI Max+ 395上 , 這個120B參數的大模型不僅能夠完整加載 , 還能達到30-40 Token/s的推理速度 。 與此同時 , 以AMD Mini AI工作站的售價來衡量 , 其本地部署對數據隱私的保護 , 以及Token費用的有效節省 , 能在個人、團隊、企業和智能空間等多個層級中 , 不僅保障了安全 , 還能帶來顯著的經濟效益 。

不止于此 , AMD還持續在推動全AI生態鏈的創新 。 依托AMD 全球和AMD中國AI應用創新聯盟超過百家優秀的ISV合作伙伴 , AMD正不遺余力地在硬件和軟件上共同推動 , 開發出面向具體行業的AI應用 , 推動AI“最后一公里”落地 , 將AI的潛力真正在千行百業中釋放出來 。

推薦閱讀

- 9月“值得撿漏”的驍龍8至尊手機,跌至2299元,用到2031年

- 外媒:英偉達遭遇了一場“滑鐵盧”!

- 小米豁出去了,16GB+1TB跳水2800元,頂配影像旗艦降至“清倉價”

- vivo果斷“發飆”,從3399元跌至2943元,小尺寸直屏旗艦還變相降價

- 榮耀誕生“新黑馬”,成為國產手機熱賣榜第一名,8300mAh+IP69K

- 1499元,是否符合“用成本交給朋友”,說一點接地氣的想法

- 市場開始對碳化硅“刮目相看”

- 微軟出了個“游戲搭子”,但勸你先別急著用

- 鴻蒙的“進擊”之道:一個系統如何決勝全場景,AI如何定義下一站?

- 榮耀開啟“清倉模式”,16GB+1TB跳水1310元,頂配旗艦跌至谷底價