文章圖片

文章圖片

文章圖片

文章圖片

智東西

編譯 | 程茜

編輯 | 李水青

智東西8月6日消息 , 昨夜 , 谷歌DeepMind宣布推出通用世界模型Genie 3 , 首個可實時交互世界模型來了 。

基于文本提示 , Genie 3可以允許用戶以每秒24幀的速度 , 以720p的分辨率生成長達數分鐘的交互式3D環境 , Genie 2僅能生成10到20秒 。

去年年底 , 谷歌DeepMind發布能生成各種可控制動作、可玩3D環境的大型基礎世界模型Genie 2 , 此次發布的Genie 3 , 是其第一個允許實時交互的世界模型 , 在一致性和真實感方面相較前代有提升 。 如下面的示例中 , Genie 3生成內容的機器人本體、周圍環境質感更佳:

博客文章中 , 谷歌DeepMind放出了數十個Genie 3的生成案例 , 展示其在模擬世界物理特性、模擬自然世界、生成動畫和小說建模、超越地理時間限制生成內容的能力 。 此外 , 研究人員還將其應用到具身Agent研究 , 如指示Agent向Genie 3發送導航操作 , 實現在花園里靠近軟管的任務:

谷歌DeepMind Genie 3與Genie 2、由神經模型驅動的游戲引擎GameNGen、視頻生成模型Veo對比 , 最突出的特點是其生成時長翻倍增長:

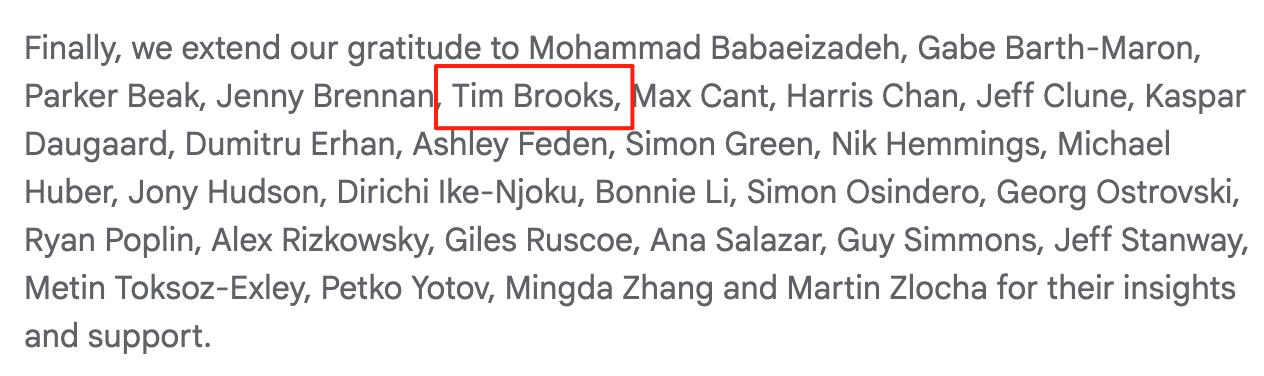

此次 , 谷歌DeepMind宣布以有限研究預覽版的形式發布Genie 3 , 為一小部分學者和創作者提供早期使用機會 。 在博客的致謝部分 , 還出現了被谷歌挖來的OpenAI視頻生成工具Sora的聯合負責人之一蒂姆·布魯克斯(Tim Brooks) 。

網友在谷歌DeepMind的X評論區瘋狂開啟夸夸夸模式 , 有網友將其的重要性與ChatGPT、Sora發布對標:

還有網友認為這是3A游戲大作的未來 , 還能在VR、電視互動節目中有很大應用場景:

一位Reddit上的開發者認為Genie 3的發布 , 意味著理論上而言“只要有足夠的計算能力和實時數據……就可以讓整個世界變得可玩” 。

本文動圖均只截取了Genie 3生成內容的部分片段 , 完整案例演示請查看原博客:

博客鏈接:https://deepmind.google/discover/blog/genie-3-a-new-frontier-for-world-models/?utm_source=xutm_medium=socialutm_campaign=genie3

一、模擬真實世界物理特性、動植物逼真 , 動畫小說建模畫面自然此前世界模型在很大程度上局限于建模狹窄的領域 。 Genie 1引入了一種生成各種2D世界的方法 , Genie 2進一步在通用性上取得進展 , 可以生成種類繁多的豐富3D世界 , 現在Genie 3不僅在生成3D世界的真實性、一致性上取得進展 , 還引入了實時互動能力 。

以下是Genie 3生成的實時互動內容:

1、模擬世界的物理特性:復雜環境沒有失真

下面的案例中 , 3D世界在表現水蔓延到馬路上、海平面、燈光映照在水面的光影變化等都沒有失真 。

2、模擬自然世界:動植物表現逼真

Genie 3可以創建從動物到植物等各種復雜且充滿活力的生態系統 , 如下面演示的庭院、湖泊、海底世界等 。

3、動畫和小說建模:動畫人物活靈活現

Genie 3還能創建動畫場景以及動畫人物 , 動畫人物的色彩、形象都符合整體環境 。

4、突破時空界限:探索未知地點和過去時刻

Genie 3創建的內容可以超越地理和時間界限 , 探索未知的地方或者過去的時代 , 如下面的翼裝飛行、山地騎車等場景 。

二、支持一個世界切換天氣、引入新角色 , 演示具身Agent應用潛力除了導航輸入之外 , Genie 3還支持基于文本的交互形式 , 谷歌DeepMind的博客將其稱為可提示的世界事件 。 也就是說 , 其可以改變已經生成的世界 , 如改變當前世界的天氣條件、引入新物體等 。

這種能力還擴展了模型對反事實或假設場景的學習 , Agent可以從經驗中學習這些場景來處理意外情況 。

如下面的演示中 , 在給定的“草原”場景中 , 案例演示可以看到棕熊、綠色拖拉機、騎馬的人分別進入畫面 。

此外 , 為了測試Genie 3創建的世界與未來Agent訓練的兼容性 , 研究人員為用于3D虛擬場景的通用Agent SIMA生成了世界 。

在每個世界中 , 其都指示Agent完成不同任務 , 并通過向Genie 3發送導航操作來實現這些目標 。 與其他環境一樣 , Genie 3并不知道代理的目標 , 而是根據代理的操作來模擬未來 。

下面的“面包店”場景中 , 演示出分別給出了走進攪拌機、前往冷卻架、走到玻璃柜前的任務:

在給定的“市場”環境中 , 案例分別演示了走進花攤、去面包師那里等任務:

在具身Agent的研究領域 , 研究人員就可以選擇一個世界設定 , 然后選擇希望Agent實現的目標并觀察它如何實現目標 。

基于Genie 3在保持一致性方面的優勢 , 現在其可以執行更長的操作序列 , 從而實現更復雜的目標 。

三、環境幾分鐘內可保持一致 , Genie 3仍有五大局限性Genie 3通過記憶已生成的內容并進行長期推理 , 自學世界中的物體如何移動、下落和互動 。 該模型是自回歸的 , 這意味著它一次只生成一幀 , 其必須回顧之前生成的內容 , 才能決定下一步要做什么 。 這是該架構的關鍵部分 。

為了實現Genie 3生成內容高度可控且能實時交互 , 在每一幀的自回歸生成過程中 , 模型必須考慮先前生成的軌跡 。 例如 , 如果用戶在一分鐘后再次訪問某個位置 , 模型必須參考一分鐘前的相關信息 。

同時為了實現實時交互性 , 這種計算必須每秒進行多次 , 以響應新的用戶輸入 。

想要使AI生成的世界具有沉浸感 , 生成內容必須在很長一段時間內保持物理一致性 。 然而 , 自回歸生成環境通常比生成完整視頻更難 , 因為誤差往往會隨著時間的推移而累積 。

Genie 3的環境在幾分鐘內仍能保持基本一致 , 視覺記憶可以追溯到一分鐘前 。 如下圖所示的“建筑物左側的樹木” , 在互動過程中始終保持一致:

其博客提到 , Genie 3的一致性是一項新興能力 。 NeRF和高斯分布等方法在實現一致的可導航3D環境同時 , 需要依賴于提供明確的3D表示 , 相比之下 , Genie 3生成的世界是根據世界描述和用戶操作逐幀創建的 , 因此生成內容更為豐富、真實 。

Genie 3通過記憶已生成的內容并進行長期推理 , 自學世界中的物體如何移動、下落和互動 。 該模型是自回歸的 , 這意味著它一次只生成一幀 , 其必須回顧之前生成的內容 , 才能決定下一步要做什么 。 這是該架構的關鍵部分 。

谷歌DeepMind的博客中也提到了Genie 3目前的局限性:

行動空間有限:盡管可觸發的世界事件允許進行廣泛的環境干預 , 但它們不一定由Agent本身執行 , Agent可直接執行的操作范圍目前受到限制;

與其他Agent的交互和模擬:準確建模共享環境中多個獨立Agent之間的復雜交互仍然是一個持續的研究挑戰;

準確表示真實世界的位置:Genie 3目前無法以完美的地理精度模擬真實世界的位置;

文本渲染:通常只有在輸入世界描述中提供時才會生成清晰易讀的文本;

交互時長有限:該模型目前支持幾分鐘的持續交互 , 無法支持長達數小時的交互 。

在此基礎上 , 谷歌DeepMind宣布Genie 3以有限研究預覽版的形式發布 , 使其能夠從其他學者處收集重要的反饋和提供跨學科視角 。

結語:谷歌DeepMind深耕模擬環境研究 , 或加速AI Agent訓練此前十多年來 , 谷歌DeepMind一直致力于模擬環境領域的開創性研究 , 從訓練Agent掌握實時戰略游戲 ,到開發用于開放式學習和機器人技術的模擬環境 , 再到開發世界模型 。

去年 , 其推出Genie 1和Genie 2兩大基礎世界模型 , 可以為Agent生成新的環境 , 并發布視頻生成模型Veo 2和Veo 3 。

可以看出 , 這些AI系統能夠利用自身對世界的理解來模擬世界的各個方面 , 使Agent能夠預測環境將如何演變以及其行為將如何影響環境 。 谷歌DeepMind的博客提到 , 世界模型是邁向通用人工智能(AGI)的關鍵基石 , 因為它們使得在豐富多樣的模擬環境中訓練AI Agent成為可能 。

【1句話生成可玩的3D世界!谷歌Genie3震圈登場,世界模型終于迎來ChatGPT時刻】從目前的應用場景來看 , Genie 3或許可以為機器人和自主系統等提供訓練空間并評估其表現 。 未來 , 這項技術或許能在我們邁向AGI的過程中發揮關鍵作用 。

推薦閱讀

- 新加坡國立大學:TPDiff讓AI視頻生成快兩倍

- 生成式AI迎來應用熱潮,快手可靈AI上線多款新功能丨最前線

- 國產視頻生成再突破!從影視級短片到遠洋親情連線,AI讓天涯變咫尺

- 全國產智能體MasterAgent:一句話造專屬AI團隊,專業協同交付

- 對話生數科技CEO駱怡航:參考生視頻讓創作回歸本質,下一步將推進實時生成

- Google將AI驅動的照片生成視頻功能擴展至更多應用

- 免費用 不限量!通義靈碼上線Qwen3-Coder:代碼生成能力大增

- 夸克、浙大開源OmniAvatar,一張圖+一段音,就能生成長視頻

- 百度視頻生成模型MuseSteamer開放H5體驗入口

- 世界首個「實時、無限」擴散視頻生成模型,Karpathy投資站臺