文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

谷歌開源Gemma 3 270M閃亮登?。 ?

只需幾分鐘即可完成微調 , 指令遵循和文本結構化能力更是驚艷 , 性能超越Qwen 2.5同級模型 。

發布當天 , 網友也懵了:以為是270B , 結果居然才0.27B 。

此模型小巧又高效 , 可以直接在瀏覽器里本地運行 , 不用聯網 , 也能生成有創意的內容 , 比如睡前故事 。

不僅如此 , 還有人使用這款迷你模型構建了自己的OCR應用程序 。 上傳一張圖片或PDF文件 , 即可用LLM即時將其轉換為結構化的Markdown格式 。

值得一提的是 , 新模型只有4個注意力頭 , 比Qwen 3 0.6B少12個 , 真是切實符合其輕量化的定位 。

下面讓我們一起看看這款迷你Gemma 3到底有哪些亮點?

Gemma 3 270M核心功能就像你不會用大錘來掛相框 , 同樣的原則也適用于利用人工智能 。

Gemma 3 270M充分體現了這種“為工作選擇合適工具” 的理念 。

作為一款基礎模型 , 它開箱即可精準遵循指令 , 而微調能徹底釋放其真正實力 。

經過專門優化 , 它在文本分類、數據提取等任務中 , 都能做到準確、快速且成本可控 。

簡單總結 , 新模型的核心功能可概括為以下4部分:

緊湊且高效的架構

這款新模型共包含2.7億參數 , 其中1.7億為嵌入層參數(由于龐大的詞匯量) , 另外1億為Transformer模塊參數 。

憑借25.6萬token的龐大詞匯量 , 該模型能夠處理特定及罕見詞匯 , 因此成為特定領域和語言中進一步微調的理想模型 。

極致的能源效率

不僅如此 , 該模型的參數規模在終端運行毫無壓力 。

內部測試表明 , 在Pixel 9 Pro手機(SoC芯片)上運行INT4量化版時 , 25輪對話僅消耗0.75%電量 , 堪稱能效最高的Gemma模型 。

指令遵循

此次發布包含一個經過指令微調的模型及對應的預訓練檢查點 , 開箱即可精準遵循常規指令 。

可用于生產的量化支持

此模型提供經過量化感知訓練(QAT)的檢查點 , 能讓模型以INT4精度運行 , 且性能損耗微乎其微——這一點對于在資源受限設備上部署而言至關重要 。

何時選擇迷你版Gemma 3輕量化模型的強大威力在現實應用中已經得到了充分體現 。

一個典型案例是2025年7月Adaptive ML與SK Telecom的合作 , 面對復雜的多語言內容審核挑戰 , 他們選擇了專門化策略:沒有使用龐大的通用模型 , 而是對Gemma 3 4B模型進行了針對性微調 。

結果令人驚艷 , 經過微調的專用Gemma模型不僅達到了目標任務的要求 , 甚至在特定任務上超越了許多體量更大的專有模型 。

Gemma 3 270M旨在讓開發者進一步采用這種方法 , 為明確界定的任務釋放更高的效率 。

那么 , 什么時候適合選擇這款迷你版Gemma 3呢?

1、批量處理專業任務:此模型尤其適合處理情感分析、實體提取、查詢路由、非結構化文本轉結構化、創意寫作及合規性檢查等 。

2、嚴格控制響應時間和成本:它能大幅降低甚至消除生產環境中的推理成本 , 同時為用戶提供更快速的響應 。

經過微調的270M模型可運行于輕量、低成本的基礎設施 , 甚至能直接部署在終端設備上 。

3、快速迭代和部署:Gemma 3 270M的小模型規模能夠實現快速的微調實驗 , 幫助你在數小時而非數天內找到適合你用例的完美配置 。

4、確保用戶隱私:該模型可以完全在設備上運行 , 而無需將數據發送到云端 。

5、多任務專業部署:這款迷你模型能幫你在預算范圍內 , 構建并部署多個定制模型 , 并且每個模型都針對特定任務進行了專業訓練 。

下面想要快速上手Gemma 3 270M?超簡單四步走起 。

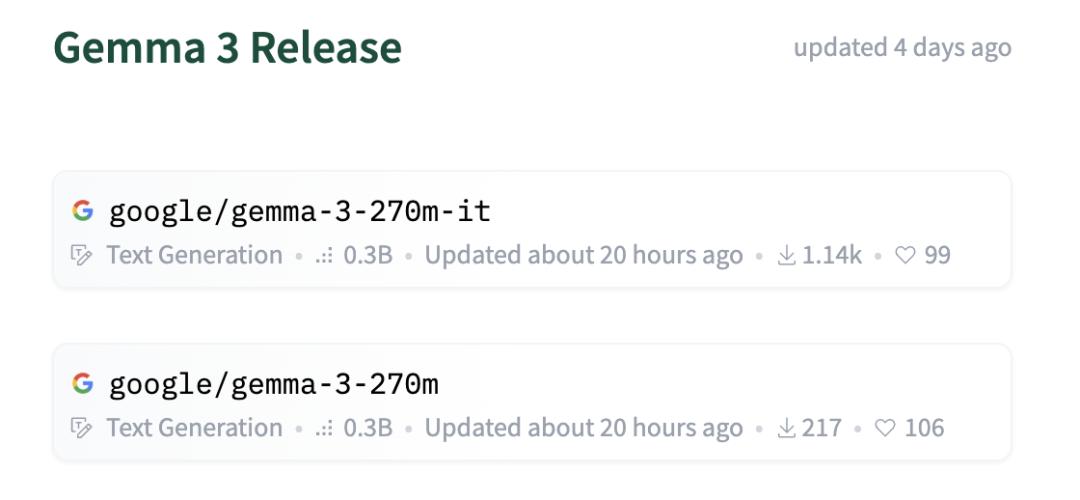

首先 , 你可以從Hugging Face、Ollama、Kaggle、LM Studio或Docker獲取該模型 。

接著用Vertex AI、llama.cpp、Gemma.cpp、LiteRT、Keras和MLX等工具進行測試 。

然后使用Hugging Face、UnSloth或JAX等工具進行個性化微調 。

最后 , 你可以將定制好的模型一鍵部署到本地環境或谷歌Cloud Run等任何環境 。

參考鏈接:

[1

https://x.com/rasbt/status/1956130338431713307

[2

https://x.com/osanseviero/status/1956024223773663291

【谷歌版小鋼炮開源,0.27B大模型,4個注意力頭,專為終端而生】[3

https://developers.googleblog.com/en/introducing-gemma-3-270m/

推薦閱讀

- 谷歌放大招:學生免費用一年Gemini Pro!終極學習外掛已上線

- 谷歌內部揭秘Genie 3:Sora后最強AI爆款,開啟世界模型新時代

- 既防水還防塵!全球首款IP68折疊屏手機,將由谷歌推出

- 谷歌開源Gemma 3 270M,性能超越Qwen 2.5同級模型

- 谷歌版小鋼炮開源!0.27B大模型,4個注意力頭,專為終端而生

- 谷歌Pixel 10系列手機支持IP68 防水、最高續航51小時

- 谷歌為Gemini添加有限聊天個性化功能

- vivo的“小鋼炮”,極窄直屏+6500mAh+百倍變焦,國補后2805元

- AI做了個“GTA5”?國產開源世界模型硬剛谷歌,實時交互、分鐘級生成

- 靠搞抽象沖進月活300萬!前谷歌華人團隊玩起“一鍵故事”,卷出vlog神作