文章圖片

文章圖片

機器之心報道

機器之心編輯部

開源賽道也是熱鬧了起來 。

就在深夜 , 字節跳動 Seed 團隊正式發布并開源了 Seed-OSS 系列模型 , 包含三個版本:

Seed-OSS-36B-Base(含合成數據) Seed-OSS-36B-Base(不含合成數據) Seed-OSS-36B-Instruct(指令微調版)

Hugging Face 地址:https://huggingface.co/ByteDance-Seed/Seed-OSS-36B-Instruct 項目地址:https://github.com/ByteDance-Seed/seed-ossSeed-OSS 使用了 12 萬億(12T)tokens 進行訓練 , 并在多個主流開源基準測試中取得了出色的表現 。

這三個模型均以 Apache-2.0 許可證發布 , 允許研究人員和企業開發者自由使用、修改和再分發 。

主要特性:

靈活的推理預算控制:允許用戶根據需要靈活調整推理長度 。 這種對推理長度的動態控制能力 , 可在實際應用場景中提升推理效率 。 增強的推理能力:在保持平衡且優秀的通用能力的同時 , 針對推理任務進行了特別優化 。 智能體能力:在涉及工具使用和問題解決等智能體任務中表現突出 。 研究友好:考慮到在預訓練中加入合成指令數據可能會影響后續研究 , 字節同時發布了含有與不含指令數據的預訓練模型 , 為研究社區提供了更多樣化的選擇 。 原生長上下文:在訓練中原生支持最長 512K 的上下文窗口 。模型架構

Seed-OSS-36B 的架構結合了多種常見的設計選擇 , 包括因果語言建模、分組查詢注意力(Grouped Query Attention)、SwiGLU 激活函數、RMSNorm 和 RoPE 位置編碼 。

每個模型包含 360 億參數 , 分布在 64 層網絡中 , 并支持 15.5 萬詞表 。

其最具代表性的特性之一是原生長上下文能力 , 最大上下文長度可達 512k tokens , 能夠在不損失性能的情況下處理超長文檔和推理鏈 。

這一長度是 OpenAI 最新 GPT-5 模型系列的兩倍 , 大約相當于 1600 頁文本 。

另一個顯著的特性是引入了推理預算 , 它允許開發者在模型給出答案之前 , 指定模型應執行多少推理過程 。

這一設計在近期其他一些開源模型中也有所體現 , 例如 Nvidia 新推出的 Nemotron-Nano-9B-v2 。

在實際應用中 , 這意味著團隊可以根據任務的復雜性和部署的效率需求來調節性能 。

推薦的預算值為 512 tokens 的倍數 , 其中 0 表示直接輸出答案的模式 。

結果

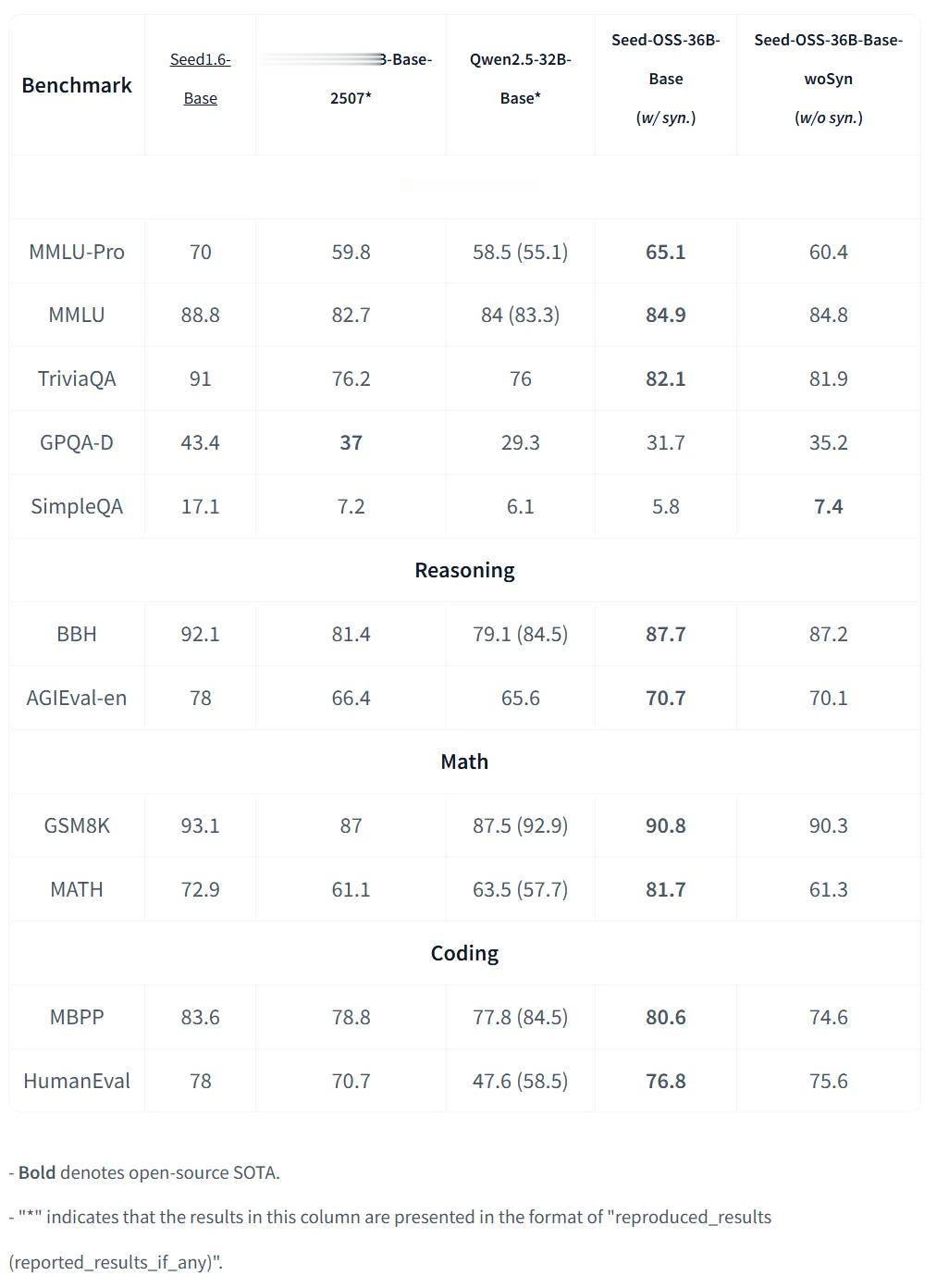

基準測試結果顯示 , Seed-OSS-36B 位列當前性能較強的開源大模型之列 。

Seed-OSS-36B-Base

含合成數據版本的 Base 模型在 MMLU-Pro 上取得 65.1 得分 , 在 MATH 上取得 81.7 得分 。 非合成基礎版本雖然在許多方面略微落后 , 但也具有競爭力 。

Seed-OSS-36B-Instruct

Instruct 版本在多個領域都取得了 SOTA 成績 。

數學與推理:Seed-OSS-36B-Instruct 在 AIME24 上取得 91.7% 的成績 , 在 BeyondAIME 上取得 65 , 均代表開源領域的最新 SOTA 水平 。 代碼能力:在 LiveCodeBench v6 上 , Instruct 模型得分 67.4 , 同樣刷新 SOTA 紀錄 。 長上下文處理:在 RULER(128K 上下文長度)測試中 , 該模型達到 94.6 , 創下開源模型的最高分 。

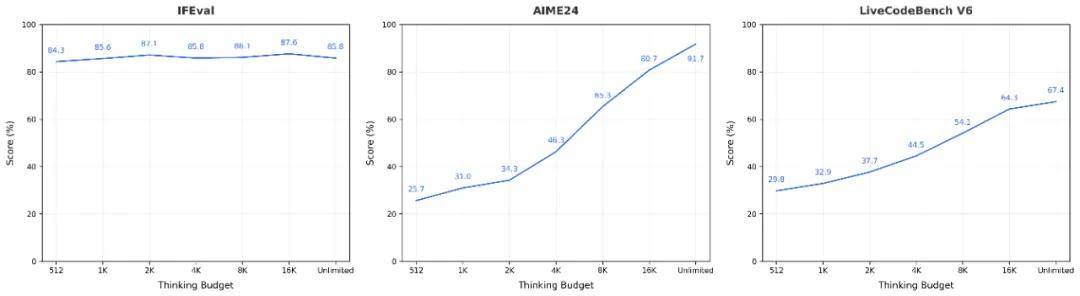

思考預算

用戶可以靈活指定模型的推理預算 。 下圖展示了在不同任務中 , 隨著推理預算變化而產生的性能曲線 。

對于較簡單的任務(如 IFEval) , 模型的思維鏈較短 , 隨著推理預算的增加 , 分數會出現一定波動 。

而在更具挑戰性的任務(如 AIME 和 LiveCodeBench)中 , 模型的思維鏈較長 , 分數則會隨著推理預算的增加而提升 。

模型在運行過程 , 會提醒用戶 token 使用情況:

seed:think

Got it let's try to solve this problem step by step. The problem says ... ...

seed:cot_budget_reflectI have used 129 tokens and there are 383 tokens remaining for use./seed:cot_budget_reflect

Using the power rule ... ...

seed:cot_budget_reflectI have used 258 tokens and there are 254 tokens remaining for use./seed:cot_budget_reflect

Alternatively remember that ... ...

seed:cot_budget_reflectI have used 393 tokens and there are 119 tokens remaining for use./seed:cot_budget_reflect

Because if ... ...

seed:cot_budget_reflectI have exhausted my token budget and now I will start answering the question./seed:cot_budget_reflect

/seed:think

To solve the problem we start by using the properties of logarithms to simplify the given equations: (full answer omitted).

如果未設置推理預算(默認模式) , Seed-OSS 將以無限長度啟動推理 。

如果指定了推理預算 , 字節建議用戶優先選擇 512 的整數倍數(如 512、1K、2K、4K、8K 或 16K) , 因為模型已在這些區間上進行了大量訓練 。

【剛剛,字節開源Seed-OSS-36B模型,512k上下文】當推理預算為 0 時 , 模型會被指示直接輸出答案;對于低于 512 的預算 , 字節也建議統一設為 0 。

推薦閱讀

- 國產AI路由系統開源逆襲!僅用19%成本達到Gemini-2.5-Pro同性能

- 剛剛,企業微信甩出AI工作流“全家桶”!搜索、匯報、表格,一網打盡

- 曝字節研發AI手機!

- 突破Claude-4編程上限!自進化Agent框架拿下新SOTA,已開源

- 剛剛!蘋果發布 iOS 18/26 beta 雙系統

- 開源版Genie 3世界模型:實時+長時間交互,單卡可跑,國內公司出品

- 剛剛,阿里“掃地僧”重出江湖!加入杭州AI創企,與另一位大佬匯合

- 困在產業落地的數據流通,開源會成為“破局點”嗎?

- 螞蟻數科向全球開源180萬深度偽造定位數據集,助力AI算法可解釋

- 谷歌版小鋼炮開源,0.27B大模型,4個注意力頭,專為終端而生