文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

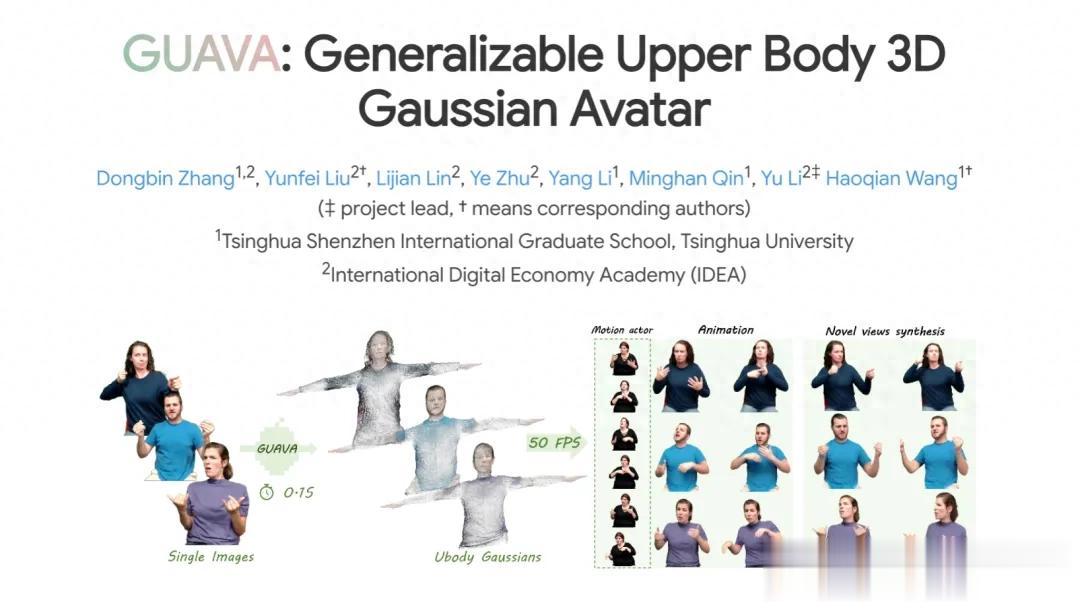

一張圖就能創建上半身動作視頻 , 方法還入選了ICCV 2025!

來自清華大學、IDEA(粵港澳大灣區數字經濟研究院)的研究人員提出新框架GUAVA , 不需要多視角視頻、不需要針對不同個體單人訓練 , 僅需0.1秒就能從單圖創建一個上半身3D化身 。

通常來說 , 創建逼真且富有表現力的上半身人體化身(如包含細致面部表情和豐富手勢) , 在電影、游戲和虛擬會議等領域具有重要價值 。

但截至目前 , 僅憑單張圖像實現這一目標仍然是一個重大挑戰 , 而且同時還需要易于創建和支持實時渲染 。

而GUAVA , 作為第一個從單張圖像創建可驅動上半身3D高斯化身的框架 , 與需要多視圖視頻或單人訓練的3D方法不同——可以在秒級時間內完成推理重建 , 并支持實時動畫和渲染 。

與基于擴散模型的2D方法相比 , GUAVA使用3D高斯來確保更好的ID一致性和實時渲染 。 而且還引入一種富有表現力的人體模型EHM , 解決了現有模型在捕捉細致面部表情方面的局限性 。

此外 , 它還利用逆紋理映射技術以準確地預測高斯紋理 , 并結合一個神經渲染器來提高渲染質量 。

實驗結果顯示 , GUAVA在渲染質量和效率方面優于現有2D和3D方法 。

下面詳細來看GUAVA所采用的方法 。

具體方法3DGS的興起催生了許多3D化身重建方法 , 然而這些方法仍然存在一些局限性:

逐ID練:每個個體都需要單獨訓練; 訓練復雜性:該過程耗時 , 需要標定的多視圖或單目視頻; 表現力有限:頭部重建方法缺乏身體動作表示 , 而全身方法則忽略了細致的面部表情 。另外 , 擴散模型在視頻生成方面取得了顯著成果 。 一些工作通過添加額外條件 , 如關鍵點或SMPLX渲染圖 , 來引導擴散模型的生成過程 , 擴展了模型在生成可控人體動畫視頻上的應用 。

但問題是 , 雖然這些方法實現了良好的視覺效果 , 其局限性卻依舊存在:

ID一致性:難以保持一致的ID , 尤其是在姿勢發生大變化時; 效率:高計算成本和多步去噪導致推理速度慢 , 阻礙了實時應用; 視點控制:2D方法無法輕松調整相機姿勢 , 從而限制了視點控制 。而GUAVA則通過以下舉措進行了改進 。

(1)EHM模型與精確跟蹤

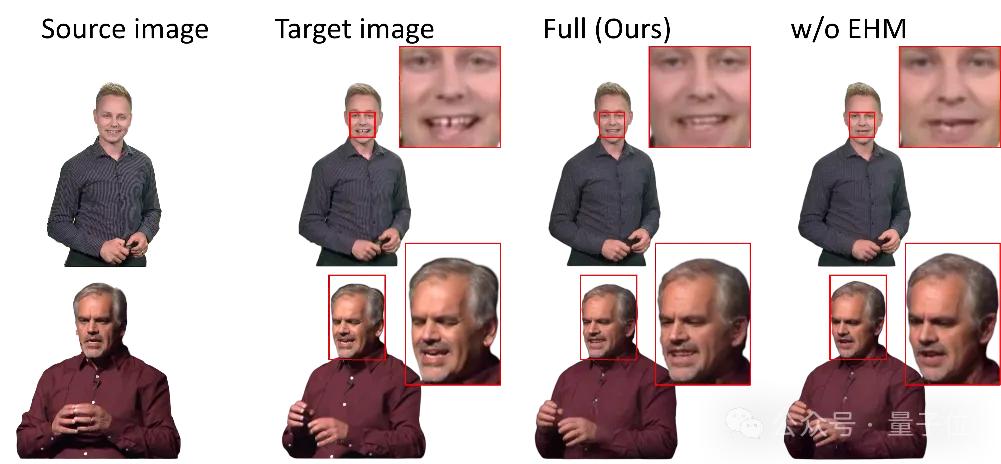

為了解決SMPLX模型在捕捉面部表情上的不足 , GUAVA引入了EHM(Expressive Human Model) 。

EHM結合了SMPLX和FLAME模型 , 能夠實現更準確的面部表情表示 。

同時 , 研究人員設計了對應的兩階段追蹤方法 , 實現從單張圖像到姿態的準確估計——首先利用預訓練模型進行粗略估計 , 然后使用2D關鍵點損失進行精細優化 , 從而為重建提供精確的姿勢和表情參數 。

(2)快速重建與雙分支模型

GUAVA基于追蹤后的圖像 , 通過單次前向推理方式完成化身的重建 。

它包含兩個分支:一個分支根據EHM頂點和投影特征預測粗略的“模板高斯” , 另一個分支則通過“逆紋理映射”技術 , 將屏幕特征映射到UV空間 , 生成捕捉精細細節的“UV高斯” 。

這兩種高斯組合成完整的Ubody高斯 , 從而在保持幾何結構的同時 , 捕捉豐富的紋理細節 。

(3)實時動畫與渲染

重建完成后 , Ubody高斯可以根據新的姿勢參數進行變形和動畫 。

最后 , 通過神經細化器對渲染的圖像進行優化 , 以增強細節和渲染質量 。

實驗環節實驗設置方面 , 研究人員從YouTube、OSX和HowToSign收集視頻數據集 , 主要關注人體上半身視頻 。

其中訓練集包含超過62萬幀 , 測試集包含58個ID 。

為確保評估的全面性 , 實驗采用了多種指標:

自重演(self-reenactment)場景下 , 通過PSNR、L1、SSIM和LPIPS評估動畫結果的圖像質量; 跨重演(cross-reenactment)場景下 , 使用ArcFace計算身份保留分數(IPS)以衡量ID一致性 。評估中與MagicPose、Champ、MimicMotion等2D方法以及GART、GaussianAvatar和ExAvatar 3D方法進行比較 。

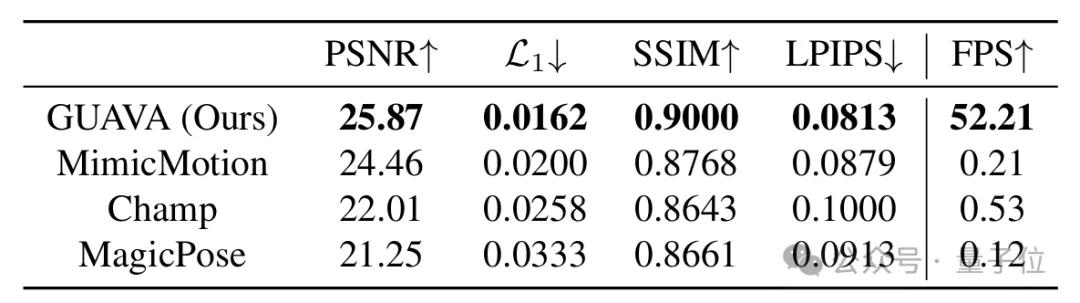

定量結果如下:

(1)Self-reenactment

與2D方法相比 , GUAVA在所有指標(PSNR L1 SSIM LPIPS)上均表現最佳 , 并在動畫和渲染速度上達到約50 FPS , 而其他方法僅為每秒幾幀 。

與3D方法相比 , GUAVA的重建時間僅為0.1秒左右 , 而其他方法需要數分鐘到數小時 。

(2)Cross-reenactment

GUAVA在身份保留分數(IPS)上顯著優于其他所有2D方法 , 證明了其在不同姿勢下保持ID一致性的能力 。

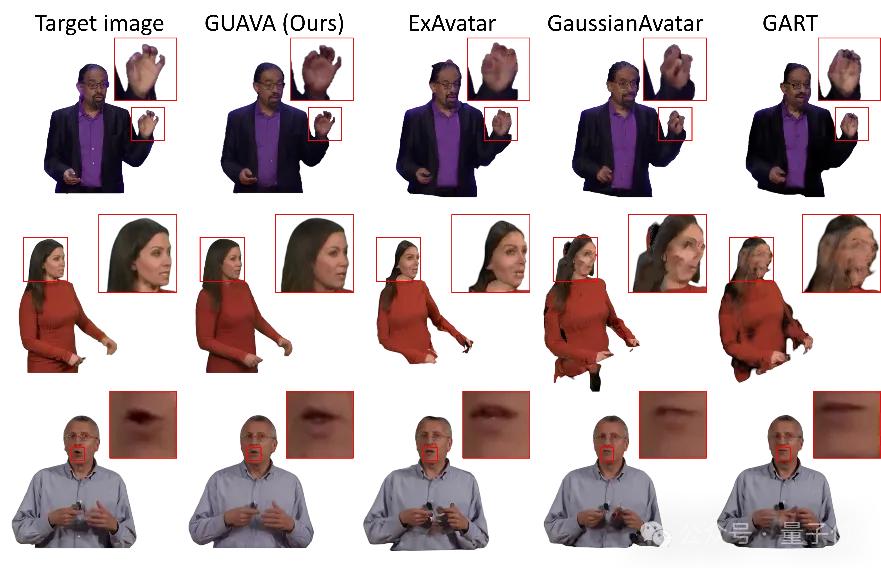

定性結果顯示 , 盡管2D方法能生成高質量圖像 , 但它們在保持ID一致性和準確恢復復雜手勢及面部表情方面存在不足 。

例如 , Champ的手部模糊, MagicPose存在失真, 而MimicMotion則無法保持ID一致性 。

3D方法在處理精細的手指和面部表情方面存在困難 , 也缺乏泛化能力 , 在未見區域或極端姿勢下會產生偽影 。

GUAVA則能對未見區域生成合理的結果 , 在極端姿勢下表現出更好的魯棒性 , 并提供更準確、更細致的手部和面部表情 。

為了驗證方法中各個部分的有效性 , 論文還進行了充分的消融實驗 。

小結一下 , 論文所提出的GUAVA , 是一個用于從單張圖像重建可動畫、具有細膩表現力上半身3D化身的快速框架 。

研究通過引入EHM模型及其精確跟蹤方法 , 增強了面部表情、形狀和姿勢的捕捉能力 , 并通過UV高斯和模板高斯的兩個推理分支共同構建一個上半身高斯 。

實驗結果表明 , GUAVA在渲染質量和效率方面均優于現有方法 。 它實現了約0.1秒的重建時間 , 并支持實時動畫和渲染 。

目前相關代碼已開源 , 感興趣可以進一步關注 。

論文地址: https://arxiv.org/pdf/2505.03351項目主頁:https://eastbeanzhang.github.io/GUAVA/開源代碼:https://github.com/Pixel-Talk/GUAVA視頻Demo: https://www.bilibili.com/video/BV1k45AzaEpW/

— 完 —

量子位 QbitAI

【一張圖0.1秒生成上半身3D化身!清華IDEA新框架入選ICCV 2025】關注我們 , 第一時間獲知前沿科技動態

推薦閱讀

- 28歲華人執掌1.85萬億科技巨頭AI大權,一覺醒來,圖靈獎得主也要向他匯報

- 從一張照片到26TB的宇宙:西部數據如何重新定義影像存儲

- 一位清華00后女生爆紅

- 華為鴻蒙 5.1 更新,官網再次降價!

- 微信更新,界面再次改版!

- 宇樹180芭蕾機器人,究竟啥水平?

- 虧錢的AI大廠們,養肥了吃播

- GPU王座動搖?ASIC改寫規則

- 金山辦公放不下協同夢

- 真我15系列再曝,搭載第四代驍龍7