文章圖片

文章圖片

文章圖片

在深度學習模型的推理與訓練過程中 , 絕大部分計算都依賴于底層計算內核(Kernel)來執行 。 計算內核是運行在硬件加速器(如 GPU、NPU、TPU)上的 “小型高性能程序” , 它負責完成矩陣乘法、卷積、歸一化等深度學習的核心算子運算 。

當前 , 這些內核通常由開發者使用 CUDA、AscendC、Pallas 等硬件專用并行編程語言手工編寫 —— 這要求開發者具備精湛的性能調優技巧 , 并對底層硬件架構有深入理解 。

近年來 , 大語言模型(LLM)在代碼生成領域的突破 , 使 “自動生成高性能深度學習內核” 成為新的研究熱點 。 KernelBench、TritonBench 等評測基準相繼出現 , 主要聚焦于評估 LLM 在 NVIDIA GPU 內核生成上的表現 。

已有研究表明 , 現有 LLM 已具備一定的 GPU 內核生成能力 。 例如 , 英偉達工程師基于 DeepSeek-R1 設計了一套工作流程 , 在簡單的 CUDA 內核生成任務中 , 該流程生成的內核在數值上全部正確 , 達到了 100% 的通過率 。

然而 , 當前 AI 加速器架構日趨多樣(如 NVIDIA GPU、華為昇騰 NPU、Google TPU、Intel GPU 等) , 其底層內核語言差異顯著 。 現有評測基準普遍存在平臺覆蓋單一、評估維度粗糙、可擴展性不足等局限 。 在此背景下 , 關鍵問題浮現:大模型在 CUDA 生態下的優勢能否有效遷移至異構平臺?我們距離自動化生成高性能計算內核究竟還有多遠?

針對這些問題 , 近日 , 南京大學與浙江大學聯合推出全新開源評測框架 MultiKernelBench , 打破平臺、維度與擴展性的限制 , 為 LLM 驅動的高性能內核生成提供了新的測評標準 。

論文鏈接:https://arxiv.org/pdf/2507.17773 代碼鏈接:https://github.com/wzzll123/MultiKernelBench

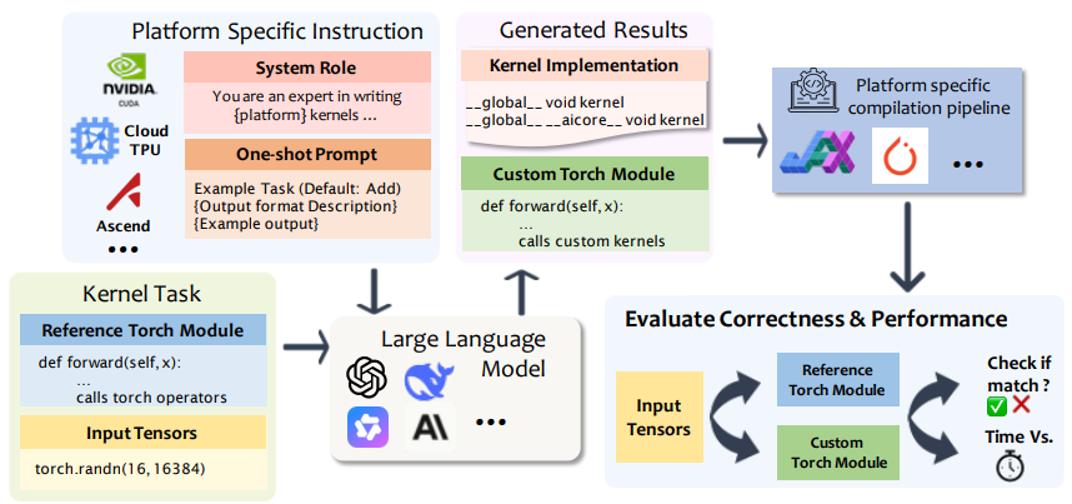

MultiKernelBench 提出了一個開放評測場景:在 GPU、NPU、TPU 等多平臺上 , LLM 自動生成高性能深度學習內核 , 并在真實設備中完成編譯、運行與性能驗證 。 它首次跨越單一硬件生態 , 推動 LLM 從 “單平臺選手” 邁向 “全能型選手” 。

值得注意的是 , MultiKernelBench 的設計充分考慮了算子多后端的可擴展性 。 例如 , Intel 工程師基于該框架高效地實現了 Intel GPU 的適配 。

MultiKernelBench 是如何構建的?

為了確保任務覆蓋全面且具有可擴展性 , 研究團隊設計了一套模塊化評測體系 , 包含四大核心特性:

1、 跨硬件平臺支持

首批覆蓋三大主流架構:

NVIDIA GPU(CUDA / Triton) 華為昇騰 NPU(AscendC) Google TPU(Pallas)通過統一 Backend 接口與裝飾器機制 , 實現無需修改核心邏輯即可快速接入新平臺 。

論文作者后續計劃逐步擴展對不同 GPU 和 NPU 廠商架構的支持 , 同時也誠邀各廠商參與開源生態的共建 。

2、 細粒度任務體系

在 Stanford KernelBench 基礎上重構分類框架 , 覆蓋 14 類核心深度學習算子(卷積、歸一化、優化器、稀疏計算等) , 不僅繼承了 250 個經典任務 , 還新增 35 個未被現有基準覆蓋的關鍵算子 , 全面反映 LLM 在不同算子類型上的生成能力 。

【南大、浙大提出跨平臺內核生成評測框架MultiKernelBench】

3、 端到端自動化評測

構建標準化流程:內核生成 → 編譯 → 硬件執行 → 性能分析 , 確保在真實硬件環境中完成全流程驗證 。

4、 類別感知 One-shot 提示策略

針對不同算子類別動態選取典型樣例作為上下文提示 , 顯著提升生成代碼的語義相關性與功能正確性 , 尤其在 AscendC、Pallas 等訓練語料稀缺的平臺上效果顯著 。

此外 , MultiKernelBench 提供插件式提示模板系統 , 方便研究者探索多樣化的提示工程策略 。

對比現有基準 , MultiKernelBench 帶來三大突破:

平臺覆蓋更廣:打破對單一生態的依賴 , 真正實現跨 GPU / NPU / TPU 的統一評測 。 評估維度更細:任務分類粒度精細化 , 可定位 LLM 在不同算子類型上的優勢與短板 。 擴展性更強:模塊化架構與統一接口設計 , 使其能夠伴隨 AI 硬件生態快速演進 。

多模型實測 , 模型表現如何?

基于 MultiKernelBench , 評估了包括 GPT-4o、Claude、DeepSeek-V3、Qwen 等在內的 7 個主流大模型 , 參數規模涵蓋 32B ~ 681B 。

評估指標包括:

Compilation@k:生成代碼是否能成功編譯 Pass@k:是否輸出功能正確的結果 SpeedUp@k:運行時是否實現性能優化

實測結果顯示:

Claude-4-Sonnet 在整體評測中表現最佳;推理模型表現優異 。 CUDA 平臺的 Kernel 執行通過率顯著高于 Pallas 與 AscendC , 反映出當前 LLM 對 CUDA 更具適應性 。 類別感知式 Prompting 明顯優于通用模板 , 尤其在 AscendC 等訓練語料較少的平臺上 , 能顯著提升生成效果與成功率 。

展望與未來計劃

MultiKernelBench 的評測結果表明 , 即便是當前最先進的大語言模型(LLM) , 在多平臺高性能內核生成任務中仍存在明顯短板:在非 CUDA 平臺上的成功率顯著下降 , 生成代碼的性能也普遍落后于手工優化版本 。

未來 , 論文作者希望與社區共同推進 MultiKernelBench 的演進 , 重點探索以下方向:

更智能的提示策略:利用已有的插件式提示模板系統 , 開發反饋式、文檔增強等新型提示方法 , 提升低資源平臺的生成質量 。 跨平臺協同生成:實現多平臺版本的同步生成與優化思路共享 , 增強跨架構泛化能力 。 支持更多硬件后端:與社區合作接入更多新平臺 , 進一步覆蓋異構計算全景 。

目前 , MultiKernelBench 的全量數據集、框架代碼與評測流程已全部開源 , 歡迎研究者與工程師提出新方法、貢獻平臺支持 , 共同推動多平臺高性能內核自動生成的發展 。

推薦閱讀

- 三個月、零基礎手搓一塊TPU,能推理能訓練,還是開源的

- 能效躍升3.5倍、信號完整性提高64倍!英偉達AI GPU光通信方案曝光

- OPPO平板、旗艦手表曝光,還有多款新手機

- Pura80、Mate70、nova14全系降價,買早還是買晚才是真贏家?

- 智元創始人鄧泰華罕見亮相,犀利回應融資、上市、場景落地等質疑

- 談技術、談戰略、談融資,智元CEO鄧泰華首次回應熱議話題

- 中南大學等機構突破難題:讓AI真正理解長文本并生成完美圖像

- 華為9月生態鏈大爆發:三折疊屏領銜,耳機、手表、小折疊全更新

- 中國品牌牢控非洲手機市場 2025Q2傳音穩居第一、榮耀增長161%

- 想在「吃、住、行」上省錢,為什么都能用滴滴?