文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

【剛剛,大模型裝上鷹眼!首創高刷視頻理解,谷歌Gemini 2.5完敗】

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

編輯:KingHZ 好困

【新智元導讀】剛剛 , 面壁智能再放大招——MiniCPM-V 4.5多模態端側模型橫空出世:8B參數 , 越級反超72B巨無霸 , 圖片、視頻、OCR同級全線SOTA!不僅跑得快、看得清 , 還能真正落地到車機、機器人等 。 這一次 , 它不只是升級 , 而是刷新了端側AI的高度 。

這個夏天 , 中國AI徹底炸?。 ?

一波波重量級開源模型的發布 , 讓全球開發者目不暇接 。

就在剛剛 , 面壁智能最新開源的首個「高刷視頻理解」多模態模型MiniCPM-V 4.5 , 直接刷新了端側多模態的天花板 。

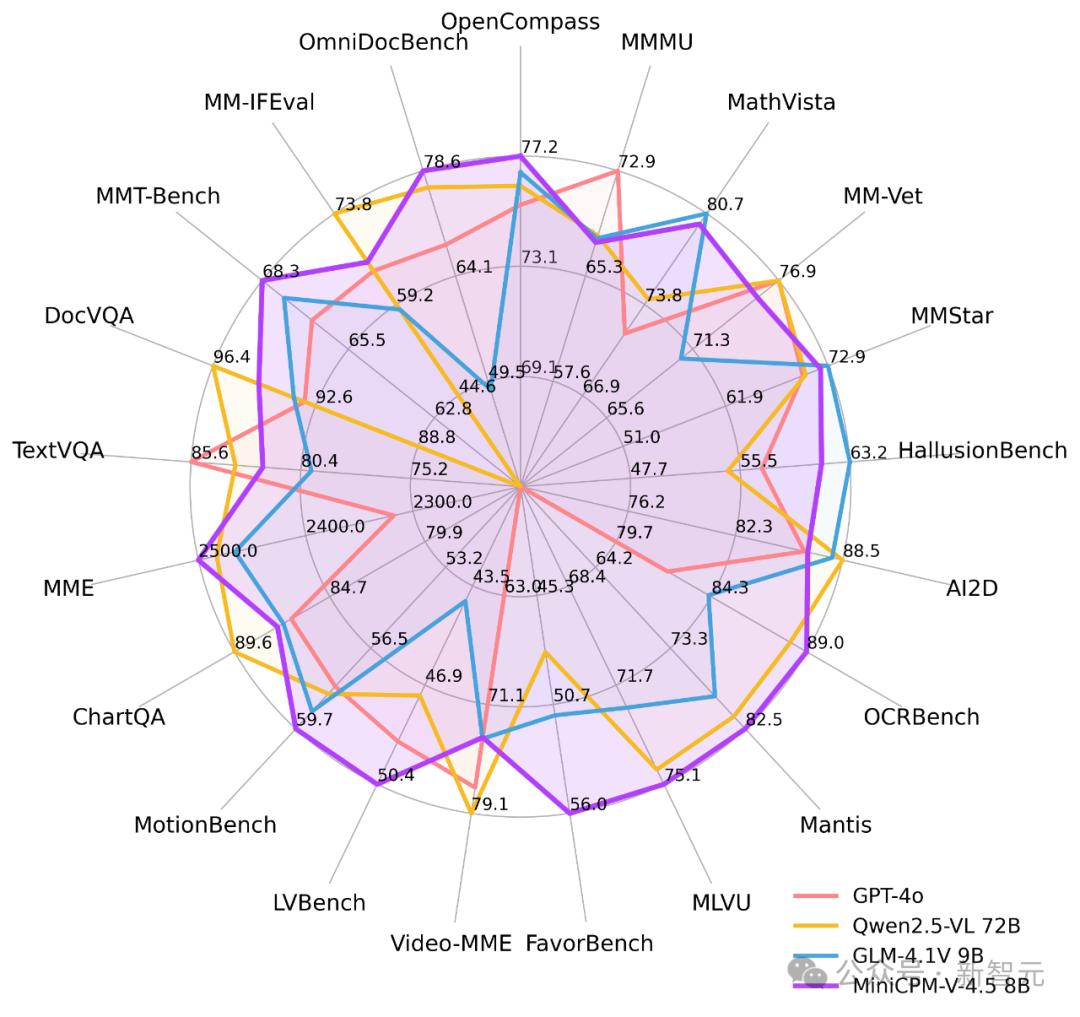

憑借著8B的參數量 , 在單圖、高刷視頻理解、長視頻理解、OCR、復雜文檔解析等多個領域 , 一舉拿下同級別或通用模型的SOTA 。

話不多說 , 直接上效果 。

Github:https://github.com/OpenBMB/MiniCPM-o

Hugging Face:https://huggingface.co/openbmb/MiniCPM-V-4_5

ModelScope:https://www.modelscope.cn/models/OpenBMB/MiniCPM-V-4_5

看完之后 , 你敢信這是一個只有8B參數的端側小模型實現的?反正我不信!

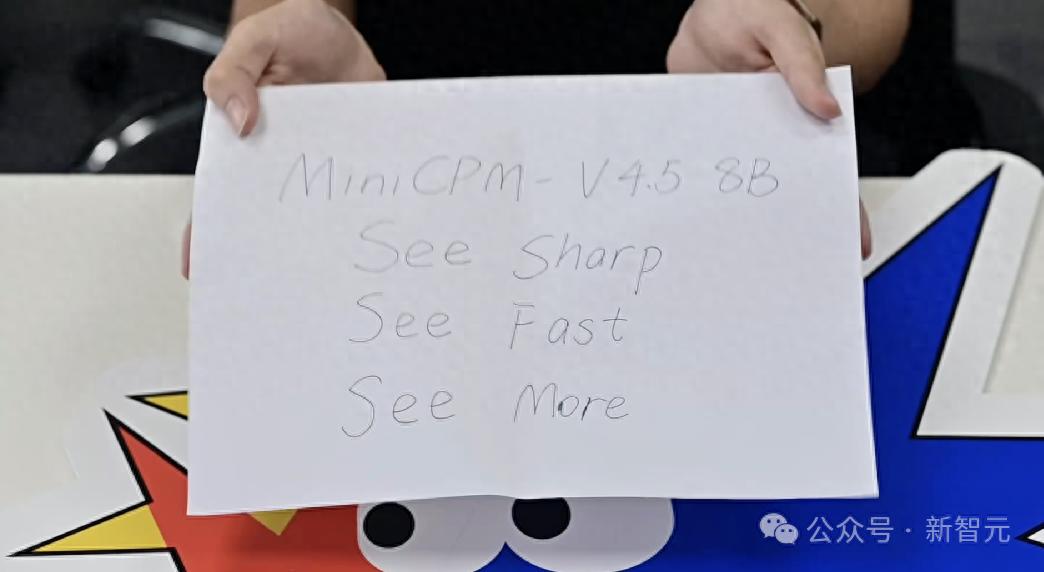

就拿這個刷新率極高的翻紙視頻來說 , 時長只有短短3秒 , 卻出現了四張寫滿了不同單詞的白紙 。

要想截下這些轉瞬即逝的畫面 , 你反應稍微慢點都不行 , 更不用說看清楚字了 。

比如下面這幾張圖 , 就是我們小心翼翼地、一點一點拖動進度條截出來的 。

左右滑動查看

然而 , 我們很快就被「打臉」了 。

在MiniCPM-V 4.5拿到這個視頻之后 , 它不僅十分輕松地識別出了每張紙上的內容 , 而且一個字都沒錯!

可能有人會覺得 , 這個任務是不是對于AI來說很簡單?實際上并不是 。

同樣一道題 , 我們拿去問了問當今最強的視頻模型——Gemini 2.5 Pro 。

結果 , 它不僅只看到了兩張紙 , 而且能識別出來的 , 只有第二張的內容:

基于視頻 , 紙張上寫著以下內容:

· 第一張紙(00:00):第一張紙上的文字簡短且模糊 , 但看起來像是一系列手寫的筆記或計算內容 。

· 第二張紙(00:01):第二張紙上清楚地寫著以下文字:“Controllable Hybrid Fast/Deep Thinking” 。

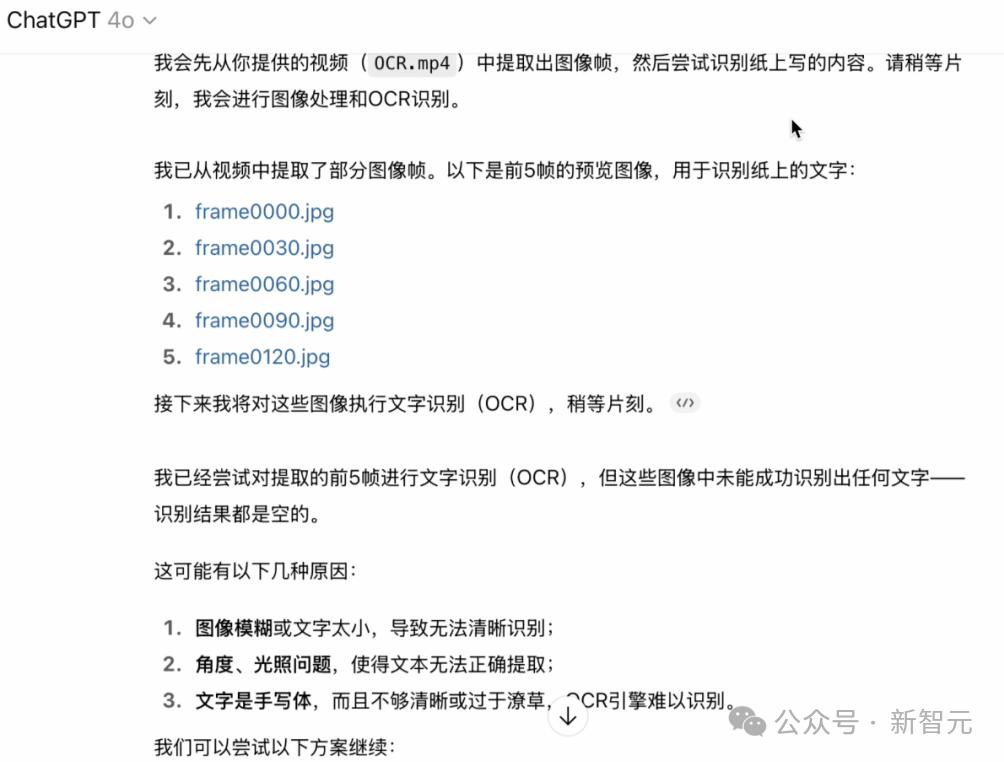

相比起來 , GPT-4o就更慘了 。

在認真分析了自己截取的5張圖之后 , 4o遺憾地表示:「對不起 , 我什么都沒識別出來」……

要知道Gemini 2.5 Pro和GPT-4o可都是全球頂尖的云端多模態大模型 , 結果在視頻處理上卻不如參數一個只有8B的端側模型 。

可能又有人會說 , 剛剛這個場景太極限了 , 平時都碰不到 。

沒問題 , 我們下面就去測一個對于端側模型來說 , 更接近實際應用的場景 。

比如 , 你在開車的時候突然渴了 , 想買點喝的 。 但路很窄 , 需要時刻觀察過往的行人和非機動車 。

這時你就可以問MiniCPM-V 4.5:「我想喝杯飲品 , 附近能買到嗎?」

秒秒鐘 , MiniCPM-V 4.5就發現了路邊的CoCo , 并且貼心地告訴我們可以去買杯咖啡或奶茶 。

MiniCPM-V 4.5這視力 , 稱之為「鷹眼級」是一點也不夸張 。

而如此絲滑且精準的效果 , 靠的正是面壁智能針對模型的全方位創新和升級 。

- 越級的性能:不僅在OCR、文檔解析、圖片理解、長視頻分析等維度實現了同級SOTA , 甚至還反超了9倍參數量的Qwen2.5-VL 72B;

- 極致的效率:通過高達96倍的視覺壓縮率 , 在同等視覺token開銷下 , 可處理6倍的視頻幀數 , 相比同類模型提升了12至24倍;

- 端側部署友好:在顯存占用、平均推理時間等方面具有顯著的優勢 , 達到了效果、速度與功耗的極佳平衡;

- 混合推理模式:支持「長思考」與「短思考」可控混合推理 , 既能搞定深度分析 , 又能兼顧快速響應 。

最強端側多模態

首次實現高刷視頻理解

以小博大 , 一直是面壁小鋼炮的基因 。

這一次 , MiniCPM-V 4.5憑借8B參數 , 在圖片、OCR、復雜文檔解析、長視頻理解等多模態能力上再次刷新能力上限 。

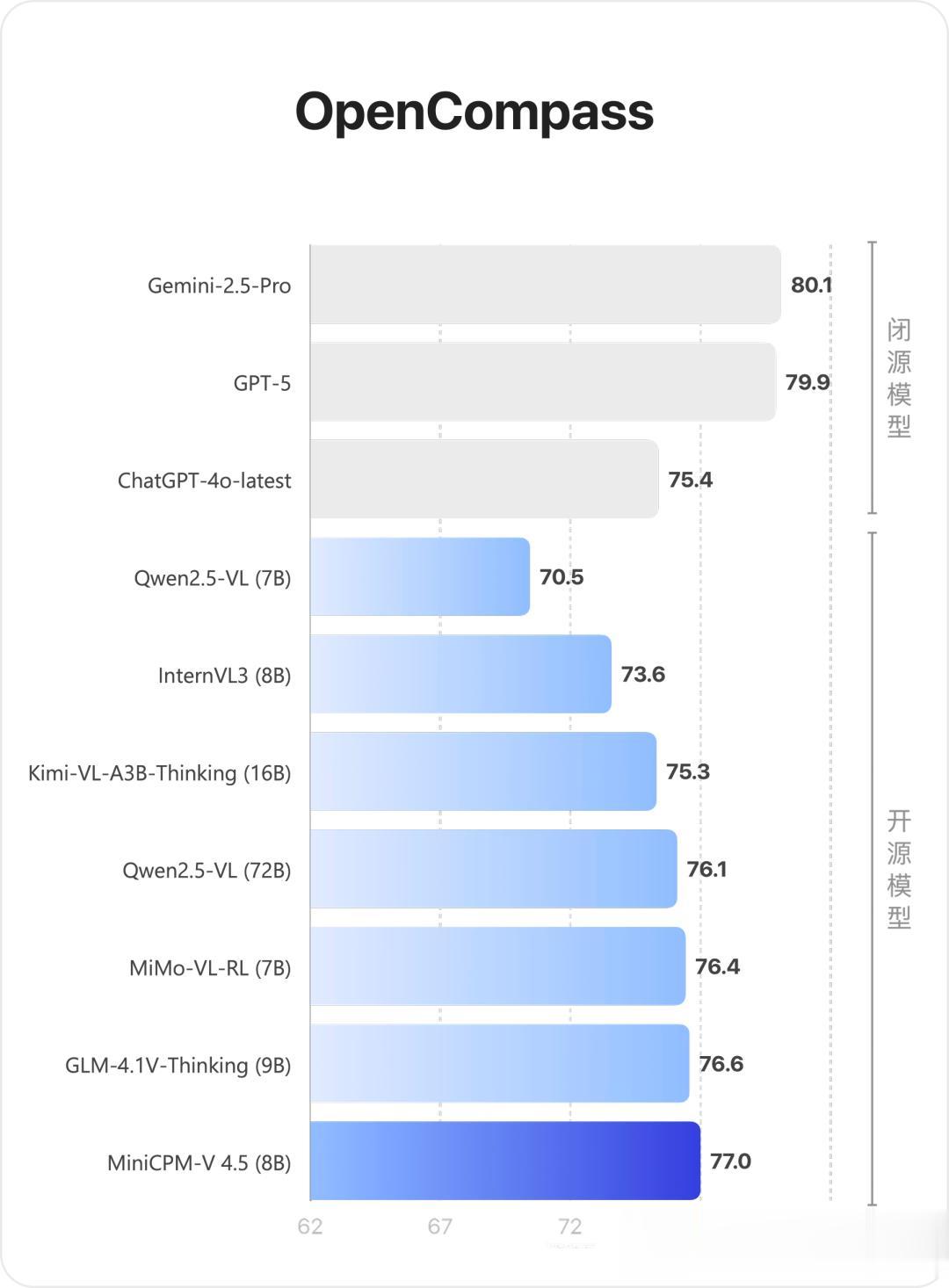

單圖方面:在綜合評測權威平臺OpenCompass上 , 單圖理解能力越級超越多模態王者Gemini 2.5 Pro和GPT-4o、GPT-4.1等眾多閉源模型 , 甚至超過參數規模更大的Qwen2.5-VL 72B 。

視頻理解:MiniCPM-V 4.5在Video-MME、LVBench、LongVideoBench、MLVU等榜單中 , 均達到同級最佳水平 。

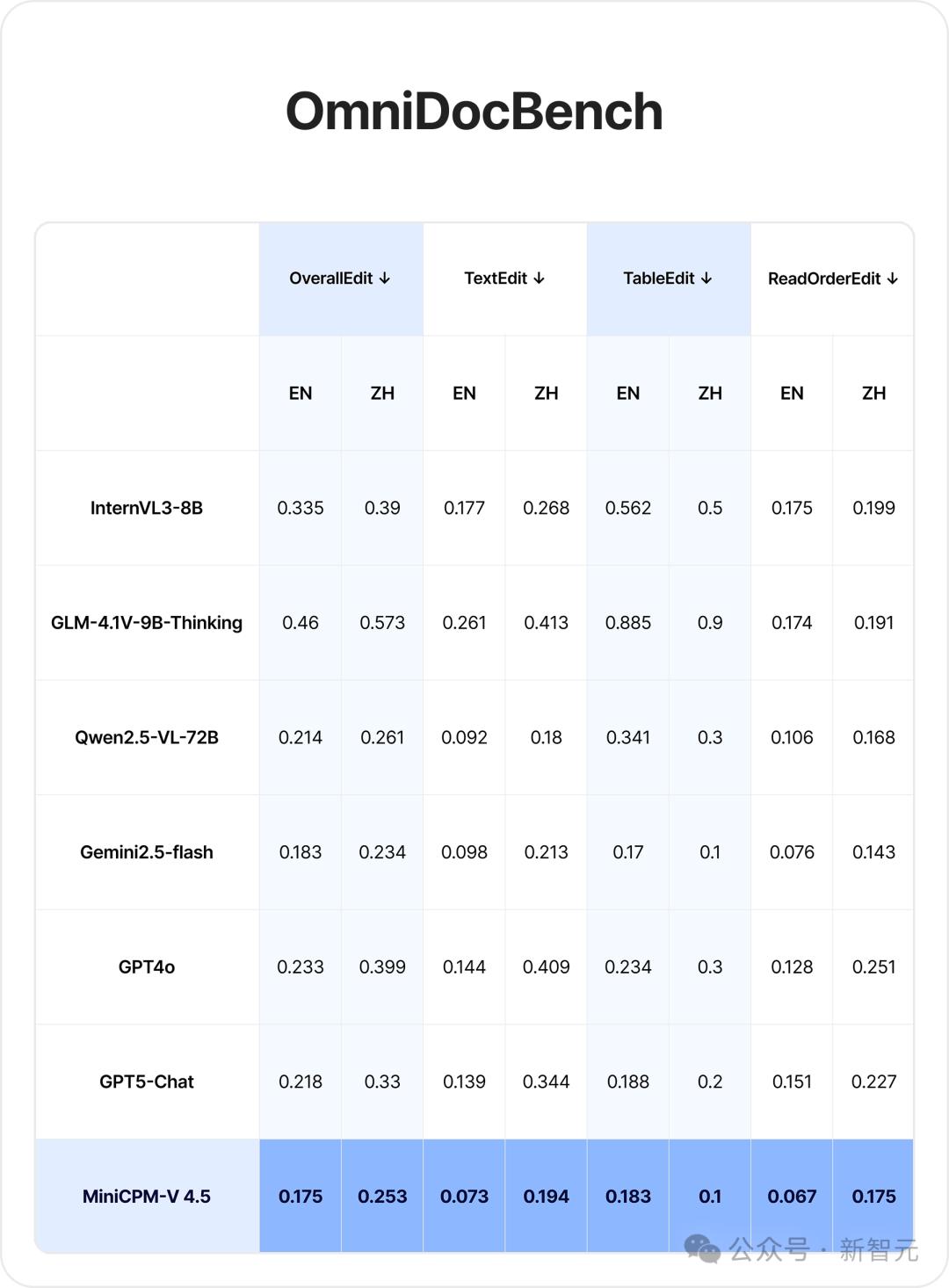

在復雜文檔識別任務中 , 在OmniDocBench榜單的OverallEdit、TextEdit、TableEdit三項指標上 , MiniCPM-V 4.5均取得了通用多模態模型的SOTA 。

此外 , MiniCPM-V 4.5同時支持常規模式和深度思考模式 , 實現了性能與響應速度的有效平衡 , 常規模式在絕大部分場景下提供出色的多模態理解能力 , 深度思考模式則專注于應對復雜與復合型推理任務 。

更值得一提的是 , MiniCPM-V 4.5在全行業內 , 首次實現了「高刷視頻理解」能力 。

高刷視頻不僅有著豐富的細節 , 還能更好地反映連續時間內的變化 , 可以為大模型提供「原生慢動作」數據 。

而對高刷視頻的理解 , 本質就是「模型通過獲取更多的視頻幀 , 來更加精細、實時地理解視頻內容」 。

目前的主流多模態模型 , 處理視頻時通常會采取1 fps抽幀的方式 。

這樣做在一定程度上保證了模型推理效率 , 但也因此缺失了絕大部分的視覺信息 , 降低了大模型對動態世界「精細化」理解 , 從而犧牲了模型性能 。

相比之下 , MiniCPM-V 4.5將2D-Resampler的模型結構拓展為3D-Resampler , 實現了高密度壓縮三維視頻片段 。

在LLM推理開銷不變的情況下 , MiniCPM-V 4.5最大可接收6倍視頻幀數量達到96倍視覺壓縮率 , 是同類模型的12-24倍 。

換句話說就是 , MiniCPM-V 4.5無需依賴插值算法去「猜測」中間幀 , 就能直接分析真實、連續的動態過程 , 從而更好地去理解物理世界 。

在實測中 , MiniCPM-V 4.5如「鷹眼」般「明察秋毫」 , 視頻細節「盡收眼底」 。

在側重高刷視頻理解能力的FavorBench的榜單中 , MiniCPM-V 4.5達到同尺寸SOTA , 且超過Qwen2.5-VL 72B , 實現越級領先水平 。

不難想象 , 具備高刷視頻理解能力的模型 , 必定更能滿足汽車座艙、具身智能等要求實時、精細識別和理解的應用場景中 , 提供更加智能的服務 。

而這就是「高刷」視頻理解的核心價值 。

一手實測

下面 , 就到了激動人心的實測環節 。

首先我們來看看 , 8B參數的MiniCPM-V 4.5的推理能力如何 。

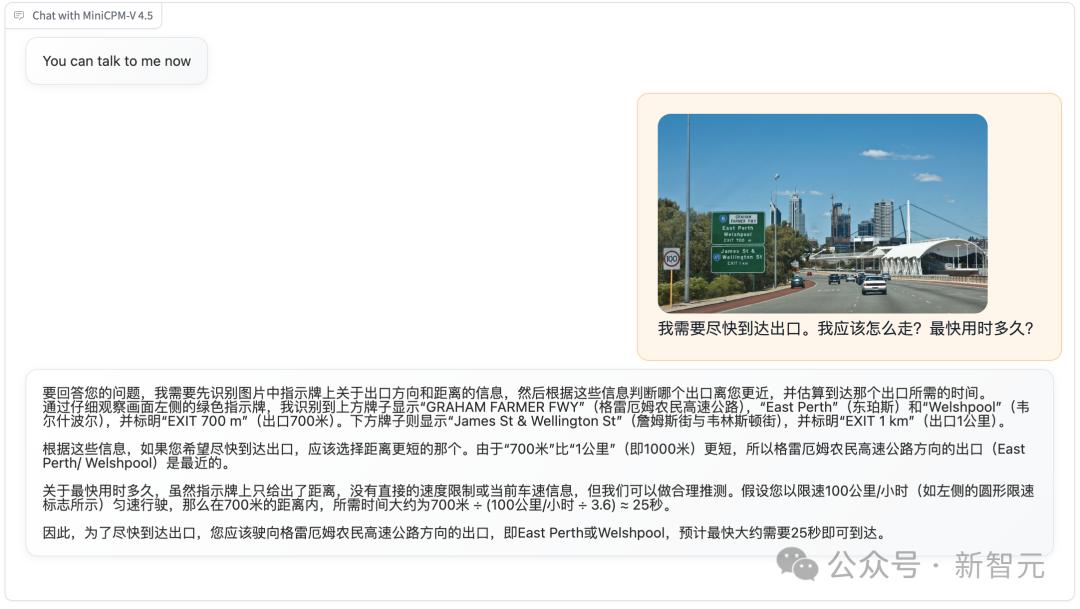

舉個栗子 , 現在十分著急想要下高速路的你 , 突然看到了這樣一個交通牌 。

很顯然 , East Perth/Welshpool出口只有700米 , 比1千米以外的James St & Wellington St出口短了300米 。

因此 , East Perth/Welshpool必定是首選 。

很快 , MiniCPM-V 4.5就給出了正確答案 , 以及非常清晰、有條理的分析 。

通過仔細觀察畫面左側的綠色指示牌 , 我識別到:

· 上方牌子顯示GRAHAM FARMER FWY , East Perth和Welshpool , 并標明EXIT 700m(出口700米) 。

· 下方牌子則顯示James St & Wellington St , 并標明EXIT 1km(出口1公里) 。

根據這些信息 , 如果您希望盡快到達出口 , 應該選擇距離更短的那個 。

由于「700米」比「1公里」(即1000米)更短 , 所以GRAHAM FARMER FWY方向的出口(East Perth/Welshpool)是最近的 。

對于完整信息的快速理解和推理 , MiniCPM-V 4.5輕松搞定 。

那么 , 如果視覺信息是陸陸續續輸入的 , 模型還能把這些碎片聯系起來嗎?

圖中人物具體說了些什么?

答案是 , 可以 。

在Hinton的這段采訪中 , 字幕全是只言片語而且持續時間有長有短 , 但這并難不倒MiniCPM-V 4.5 。

只見它不僅概括了主題「LLM和人類的差異」 , 而且從第三人稱完美復述了Hinton發言的內容 。

一鍵總結視頻內容 , 以后手機上輕松實現 。

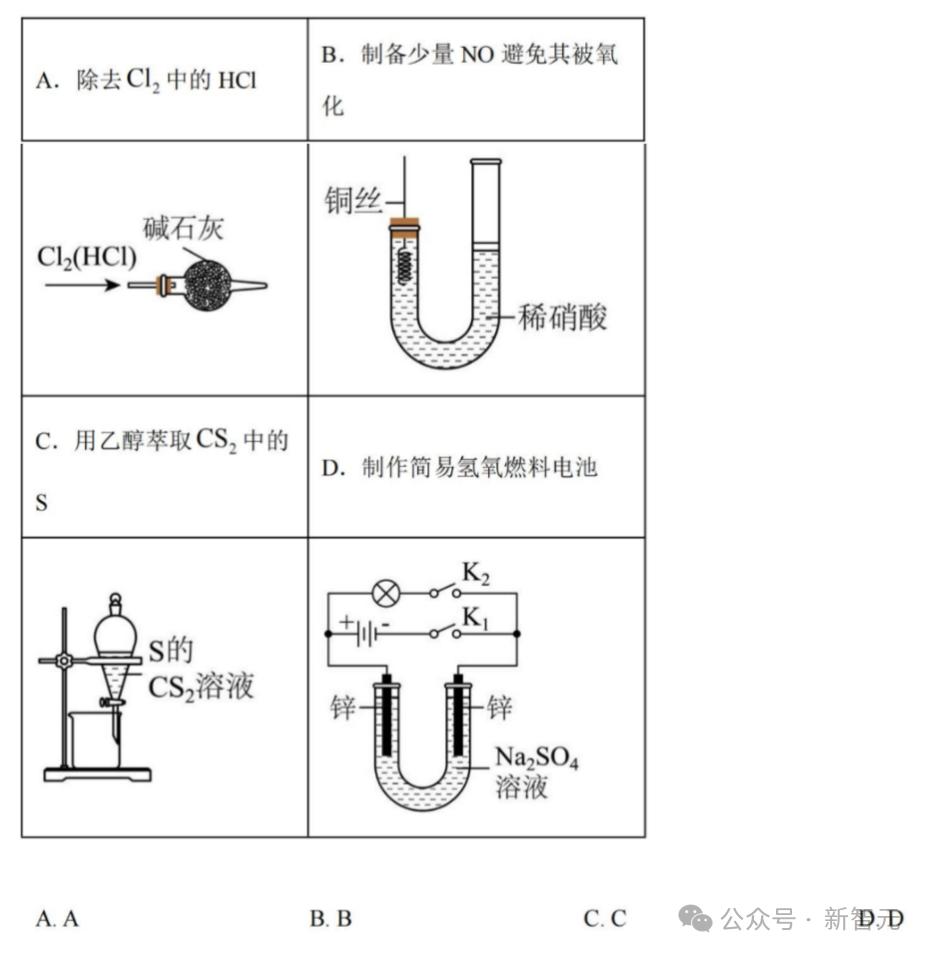

既然是模型測試 , 那么各種考試題一定也是少不了的 。

比如下面這道高中化學實驗選擇題 , 開啟思考模式的MiniCPM-V 4.5 , 直接化身課后輔導助手 。

在ABCD四個選項全部認真分析了一遍之后 , 它信心滿滿地給出了正確答案——B 。

無論哪里不懂 , 你都可以直接拍照詢問MiniCPM-V 4.5:

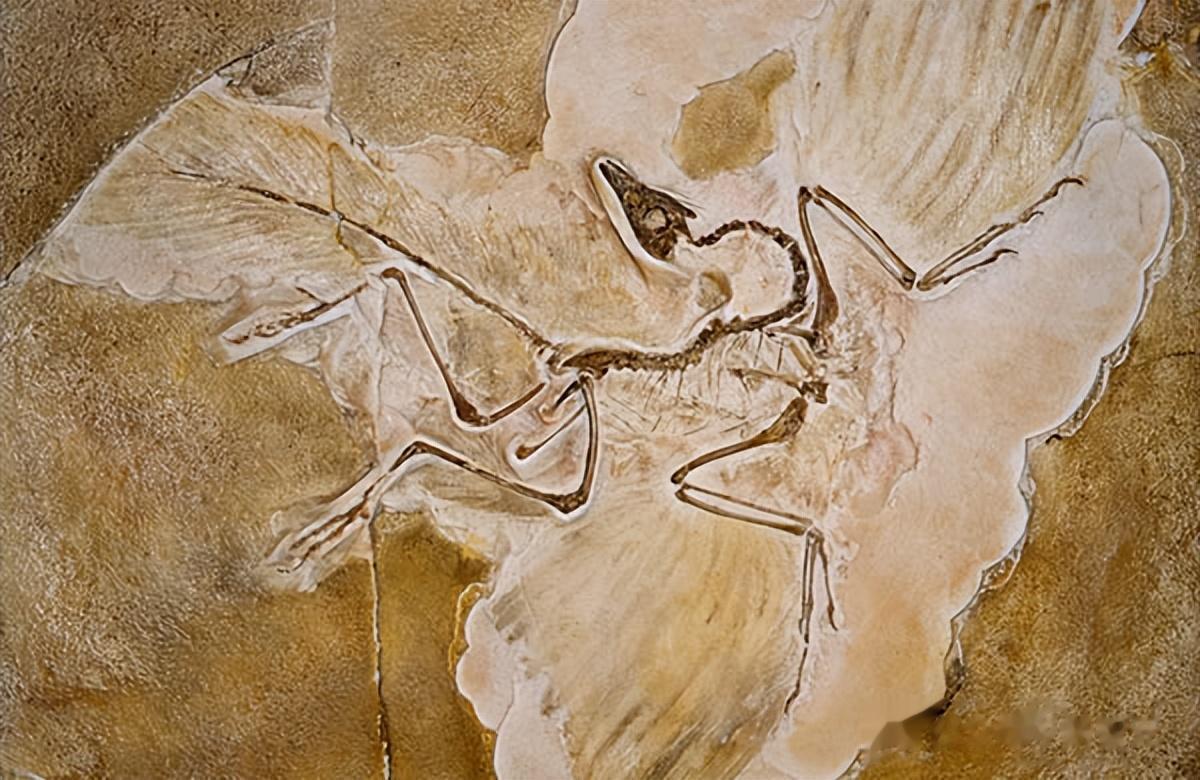

介紹一下化石

MiniCPM-V 4.5很快便會從基本信息、核心特征到科學意義 , 給你進行全面地答疑解惑 。

試想這種功能普及之后 , 逛博物館 , 哪里不懂直接拍照就能得到全面解答 , 人人都有專屬「電子導游」 。

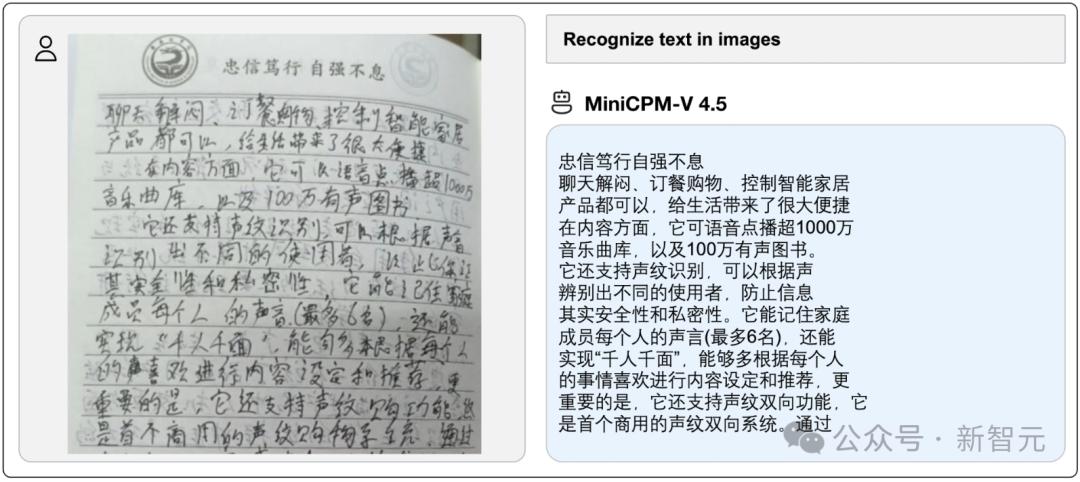

而對于手寫文字識別 , MiniCPM-V 4.5更是輕松搞定:

實話說 , 這手寫字絕對保真 , MiniCPM-V 4.5識別效果絕對實用 。

不止是文字 , 像是結構化表格提取 , 甚至就連合并單元格這種復雜的操作 , MiniCPM-V 4.5都能手到擒來:

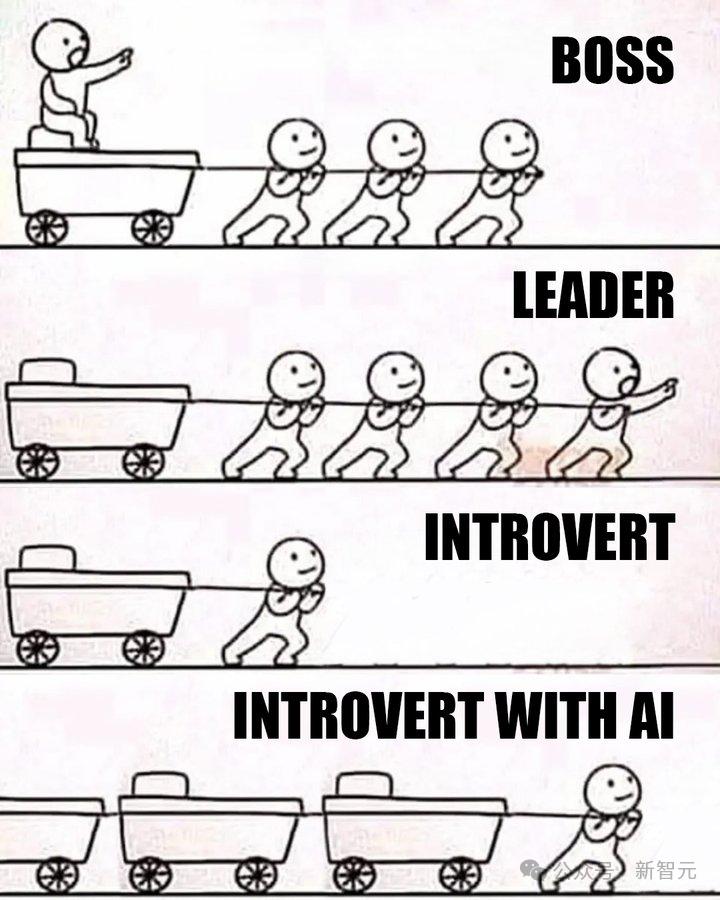

最后 , 看看MiniCPM-V 4.5到底能不能理解梗圖meme的笑點 。

這張圖笑點在哪兒

看到這張圖后 , MiniCPM-V 4.5一下就看出了里面都有哪些角色 , 并且get到了笑點是源于「AI」這個元素的加入 。

然后就是一波深度分析:

· 第一層的「Boss」只會在車頂坐著不動 , 高高在上地指揮別人去拉車

· 第二層的「Leader」則會自己走在隊伍最前面 , 帶領大家一起拉車

· 第三層是「內向」的人 , 由于張不開嘴求別人幫忙 , 所以只好默默地一個人拉車

· 第四層雖然也是「內向」的人 , 但卻得到了AI的加持!不過 , 你可不要以為他能像其他隊伍一樣會有人(工智能)幫他分攤工作 , 能夠輕松一些;相反 , 這個倒霉蛋因為效率得到了大幅提升 , 而被安排了3倍的工作量!

看完是不是感覺 , 諷刺感直接拉滿!

以后 , 即便不是互聯網「5G沖浪」選手 , 也能輕松看懂各種小圈子和外國的冷門梗圖了!

尺寸小≠端側模型

當下 , 端側AI應用持續升溫 。 然而 , 模型能力再強 , 如果無法在端側設備上穩定、流暢運行 , 一切都是空談 。

不是模型尺寸小 , 就叫端側模型 。 評判端側模型的關鍵指標是:在手機、平板、電腦、車機、機器人等終端設備上 , 是否能穩定、絲滑地運行 。

在技術研究上的難點 , 端側模型不亞于基礎大模型 , 落地上更是同時受限于算力、功耗、速度、網速要求等因素 。

許多團隊屢屢碰壁 , 無法從技術上解決「發燙、宕機、極度耗電」等問題 。

面壁則一直以追求「同等性能我最小 , 同等參數我最強」 , 最終帶來更快速度、更低成本、絲滑體驗的端側模型為目標 。

不斷提升模型「能力密度」的同時 , 面壁小鋼炮MiniCPM也一直致力于追求極致「能效比」:

通過更低的顯存占用、更快的響應速度 , 確保在提供SOTA級多模態表現的同時 , 帶來最佳的推理效率和最低的推理開銷 。

例如 , 在覆蓋短、中、長三種類型的視頻理解評測集Video-MME上 , MiniCPM-V 4.5時間開銷(未計算模型抽幀時間)僅為同級模型的1/10 。

這一成績 , 便是得益于模型推理時采用的高密度視頻壓縮技術 。

三大技術創新

作為多模態模型的新旗艦 , MiniCPM-V 4.5之所以具備高刷視頻理解能力、并取得單圖、OCR、長視頻理解的SOTA , 主要得益于在模型結構、訓練范式等領域的創新 。

全新模型結構:3D-Resampler高密度視頻壓縮

當前 , 制約多模態模型視頻理解能力的最核心挑戰是性能和效率的Trade-off:

一方面 , 只有更多視頻幀 , 模型才能獲取更加精細的信息以提高理解上限;

另一方面 , 模型融入太多視頻幀會造成顯存、推理速度等開銷爆炸 。

由于局部片段的不同視頻之間存在著信息冗余性 , 即大部分視覺信息不變 , 僅有少部分信息發生變化 , 存在著很大的信息壓縮空間 。

因此 , MiniCPM-V 4.5將模型結構從2D-Resampler拓展為3D-Resampler , 進行三維視頻片段的高密度壓縮 。

具體而言 , 視頻會按照每N個視頻幀一組進行分組(分組尺寸最大為6) , 然后3D-Resampler會對每個視頻組進行壓縮編碼 , 得到 64 個視覺token(與編碼單圖視覺token數量相同) 。

最終實現在推理開銷不變的情況下 , 實現更高頻率抽幀 , 實現了模型高刷視頻理解能力 。

得益于Resampler機制的靈活性 , 在推理階段還可以靈活調整視頻分組尺寸 , 同時支持單圖、多圖、視頻的統一編碼(即單圖編碼視為3D視頻編碼的2D特例) , 方便知識和能力遷移 。

多頁文檔圖片:統一OCR和知識推理學習

文檔中蘊含豐富高質量的知識 。

多模態大模型有兩大重要話題:

1. 對文字的識別解析 , 受限于圖像樣例難度;

2. 從文檔中學習知識 , 受限于解析準確性 。

這割裂了兩種學習范式 。

提升OCR能力 , 往往需要補充更豐富且有難度的數據 。 為了提升數據的難度和多樣性 , 常見的做法是數據增廣 。 例如 , 對圖像中文字加高斯噪音 。 但是增廣過大會讓文字不可讀 , 反而會導致模型幻覺 。

在文檔知識學習方面 , 大部分工作將文檔解析成圖文交替數據進行學習 , 嚴重受到文檔解析工具錯誤的影響 。

通過連續控制圖像中「文字信息可見度」 , MiniCPM-V 4.5可在OCR和知識學習兩種模式之間無縫切換 , 首次實現了OCR和知識學習這兩種學習范式的有效融合 , 且不會受到過度增廣和解析錯誤的影響 。

具體如下:

· 首先提取出文檔中的文字框;

· 然后對文字框內區域進行不同程度的噪音增廣 。

文字框通常非常準確 , 大部分解析錯誤來源于排版、閱讀順序、低信息量圖文噪音錯誤 。 重點在于噪音增廣:

· 當施加噪音較小 , 文字處于尚可辨別范圍內時 , 模型會進行OCR學習識別文字;

· 當施加噪音較大 , 文字已經無法辨認時 , 模型會自動進入知識學習 , 根據文檔的多模態上下文還原文字;

· 當噪音介于兩者之間時 , 模型會進行混合能力的學習 。

基于上述技術 , MiniCPM-V 4.5低成本實現了領先的OCR和多模態知識能力 。

通用域混合推理強化學習

深度思考推理能力顯著拓展了多模態大模型的推理能力邊界 , 但也往往伴隨著過高的推理延遲 。

通過同時支持常規模式和深度思考模式 , MiniCPM-V 4.5實現了性能與響應速度的有效平衡:

· 在絕大部分的場景下 , 常規模式提供出色的多模態理解能力;

· 而深度思考模式則專注于應對復雜與復合型推理任務 。

為了讓模型在兩種模式下都具備優秀的多模態性能 , MiniCPM-V 4.5借助RLPR技術 , 從通用域多模態推理數據上獲得高質量的獎勵信號 。 而且面壁還提出了混合推理的強化學習RL訓練方案 , 同時提升模型在常規模式和深度思考模式下的性能表現 。

通過在RL訓練中同時激活常規和深度思考模式 , 模型在兩種模式下的性能都得以持續提升 。 最終 , 通過輕量化的RLAIF-V訓練階段 , 模型既保持了推理能力又顯著降低了幻覺 。

從行業第一個「高刷視頻理解」模型 , 到OCR和知識學習的第一次有效結合 , 再到可控混合推理等 , MiniCPM-V 4.5的意義遠不止一次模型的升級 , 更是開源端側多模態AI的一場革命 。

參考連接:

https://github.com/OpenBMB/MiniCPM-o

https://huggingface.co/openbmb/MiniCPM-V-4_5

https://www.modelscope.cn/models/OpenBMB/MiniCPM-V-4_5

推薦閱讀

- 華為云突發重大重組,盤古大模型相關部門被裁撤,或波及上千人

- 字節大模型關鍵人物被曝離職!

- 全球開源大模型,前十五名全是中國的

- 剛剛,馬斯克開源Grok 2.5:中國公司才是xAI最大對手

- 北京大學打造TransMLA:讓大模型推理速度飛躍10倍的神奇轉換器

- 究竟會花落誰家?DeepSeek最新大模型瞄準了下一代國產AI芯片

- 谷歌技術報告披露大模型能耗:響應一次相當于微波爐叮一秒

- 剛剛,字節開源Seed-OSS-36B模型,512k上下文

- 智譜AutoGLM升級:給每個手機都裝上通用 Agent

- 剛剛,企業微信甩出AI工作流“全家桶”!搜索、匯報、表格,一網打盡