文章圖片

文章圖片

【Meta的肌電腕帶,可能會定義下一代人機交互范式】

文章圖片

要論2025年走紅的消費電子產品 , 可能就非智能眼鏡莫屬了 , 如今從新銳初創企業到老牌科技巨頭 , 似乎都瞄準了頭戴設備這片新興熱土 。 其中一手帶火了智能眼鏡的Meta自然也沒閑著 , 他們將在9月舉行的年度Connect大會上推出代號為Hypernova的智能眼鏡這件事 , 幾乎已經是板上釘釘 。

但Hypernova并非大名鼎鼎Ray-Ban Meta的后繼產品 , 而是Meta旗下首款帶有高端HUD(抬頭顯示)功能的智能眼鏡 。 并且有消息稱 , 這次Meta并沒有帶上合作伙伴依視路陸遜梯卡(EssilorLuxottica) , 而是會將Hypernova作為自有品牌的產品推出 。

除了HUD所帶來的信息呈現能力躍升 , Hypernova在功能層面并沒有比Ray-Ban Meta更豐富 , 依然是拍攝照片和視頻、Meta AI交互 , 以及藍牙音頻流媒體等功能 。 事實上 , Hypernova最為核心的看點 , 在于Meta為其配備的sEMG(表面肌電圖)腕帶 , 這也是該公司為VR頭顯、智能眼鏡打磨了多年的“秘密武器” 。

為什么Meta會推出一個智能眼鏡+肌電腕帶的組合呢?如今同時擁有Quest頭顯和Ray-Ban Meta眼鏡的Meta , 無疑算得上是目前科技圈對于頭戴式設備最有話語權的廠商之一 , 所以他們搞肌電腕帶自然是有原因的 。 這個問題的答案 , 其實是肌電腕帶極有可能是腦機接口技術商業化之前 , 能滿足頭戴式設備交互需求的最優解 。

一直以來 , 無論VR頭顯、還是智能眼鏡 , 幾乎一切頭戴式設備都有同一個痛點 , 那就是交互體驗糟糕 。 目前頭戴式設備的交互方式通常有兩種 , 分別是語音和手勢 。

先來說說從智能眼鏡鼻祖Google Glass就開始使用的語音交互 , 其能夠沿用至今的原因很簡單 , 因為聲音是人類最原始、最基本的交流方式 , 所以使用它與機器交互也更符合人類的直覺 。

只可惜語音交互的缺陷過于突出 , 早期聲控系統面臨的問題 , 就在于無法實現在復雜聲學條件下準確識別用戶的指令 。 比如當年在錘子科技的鳥巢發布會上 , 羅永浩在展示號稱“重新定義下一個十年的個人電腦”TNT工作站時頻頻翻車 , 最后只能喊出“理解萬歲”來緩解尷尬 , 以至于還誕生了“安靜!別吵到我用TNT”這樣的梗畫 , 其實這一切就都是源自于語音識別的翻車 。

即使到了當下 , 大語言模型的出現使得AI可以讓機器準確識別用戶語音中的信息 , 但從復雜聲學環境中準確識別出目標用戶聲音的遠場拾音技術依然存在缺陷 , 還不能從環境中的本底噪聲、混響中100%捕捉到用戶的特定聲音 。

當然 , 語音交互真正的痛點 , 在于不是所有人都能克服在公共場合大聲說話帶來的羞恥感 , 許多人做不到在大庭廣眾之下自說自話 。 所以盡管語音交互足夠便捷、也很高效 , 但對使用場景的要求使得它始終只能是一個備選 。

相比優缺點都極為明顯的語音交互 , 手勢交互的特點則是中庸 。 常規智能眼鏡使用的鏡腿觸控模式其實是延續了智能手機的邏輯 , 用戶不需要付出額外的學習成本就可使用 , 但在眼鏡腿上進行觸控交互顯然不符合人體工程學 , 缺陷就在于需要用戶將手舉到頭部與眼鏡對齊 , 頻繁使用會疲憊 , 且鏡腿觸控的精度過低 , 只能執行拍照、接打電話、調整音量等簡單操作 。

雖然蘋果Vision Pro的手勢識別精度更高 , 但也對傳感器、也就是攝像頭有了更高的要求 , 所以只能用在頭顯而非眼鏡上 。 這時候 , 肌電腕帶就成為了當前技術條件下的最優解 。 在佩戴肌電腕帶后 , 用戶就可以通過旋轉手部來滾動瀏覽應用和照片 , 并通過拇指與食指的輕捏動作來完成選擇這一操作 , 從而大幅提升智能眼鏡的操控便捷性 。

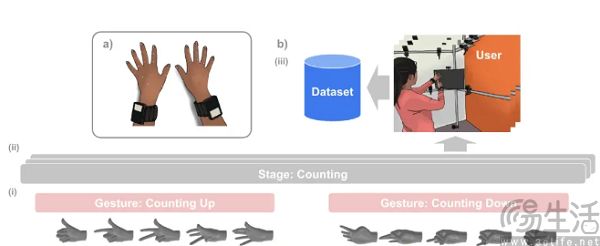

事實上 , 肌電腕帶是卡內基梅隆大學(CMU)與Meta合作的產物 , 在去年的Connect 2024上Meta方面就展示了這款“黑科技” 。 其原理是監測是在皮膚表面測量到、由肌肉產生的電勢 , 并檢測由單個運動神經元引起的活動 , 再通過算法來解碼用戶的動作 , 最終預測相關動作所代表的意圖 。

為了解決肌電信號與手部動作之間的映射問題 , Meta通過數千名志愿者的幫助 , 建立了emg2qwerty、emg2pose等多個反映用戶意圖與sEMG(表面肌電信號)、手部姿態關聯性的數據集 , 再通過類似AI大模型Scaling Law的泛化思維 , 來實現對手部細微運動反映人類意圖的洞察 。 根據離線評估數據顯示 , Meta在手寫和手勢檢測任務中 , 對未參與訓練的測試者實現了超過90%的分類準確率 。

簡而言之 ,Meta通過AI大模型與神經科學結合 , 實現了用戶只需通過手部的細微動作 , 即可精準操控設備的效果 。 盡管肌電腕帶在精度上不如鍵鼠以及手指觸控 , 用它來操作電腦和手機的效率不佳 , 可放在智能眼鏡上卻恰到好處 。

畢竟肌電腕帶可以不用再依賴屏幕觸摸或鍵盤輸入 , 僅通過簡單的手部肌肉活動就能完成文字輸入、指令下達等操作 , 正好滿足了無法觸摸屏幕 , 也不能接入鍵盤的智能眼鏡 。 并且隨著Meta相關研究的深入 , 肌電腕帶甚至可以利用手腕的尺側/橈側偏離來控制垂直方向 , 從而實現多自由度的聯合控制 。

既沒有語音交互的低效和道德壓力 , 也沒有手勢交互低精度缺陷的情況下 , Meta的肌電腕帶或許就會是下一代人機交互范式最有力的候選者 。

推薦閱讀

- 榮耀Magic V Flip2評測:行業唯一2億像素照亮你的顏值

- 沖上熱搜的蘋果20周年iPhone,小米在6年前就造出來了?

- dynabook高端輕薄筆電Portégé X40-M:商務辦公的智能伙伴

- 平板的筆有必要買嗎?2025年精選10款性價比最高的電容筆推薦!

- 當AI比我們更聰明:李飛飛和Hinton給出截然相反的生存指南

- 用「錄音機」切入AI硬件賽道,釘釘要做的是協同閉環

- 魅族22延期上熱搜,官方回應“心痛的很”

- 基于 NVIDIA Blackwell 的 Jetson Thor 現已發售

- 用于RICOH GR IV的小型閃光燈 「RICOH GF-2」新上市

- 掘金AI時代計算產業紅利的商業伙伴,為什么跟華為組隊?