文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

目前AI技術日益成熟 , 網絡上已經鋪天蓋地出現了AI生成的各種內容 , 包括文章、圖片、視頻等等 。 此前我們簡單科普過本地大語言模型DeepSeek以及StableDiffusion的部署和應用 。

不過除了文章和圖片 , 現在正有越來越多的AI視頻出現在短視頻平臺 , 如面向年輕人的“橘貓系列” , 面向中老年人的“嬰兒系列” 。 今天我們就通過本地部署ComfyUI工作流 , 來看看如何生成那些好玩的AI短視頻 。

前期準備工作 , 前往B站下載 @秋葉aaaki 大佬的【ComfyUI】繪世啟動器 。

本次我們將使用【通義萬相 Wan 2.1】的模型來進行簡單的圖生視頻制作 , 通過科學上網下載Wan 2.1模型

列表中有大量模型 , 主要包含【i2v】與【t2v】 , 分別為圖生視頻與文生視頻 。

如果你的顯卡顯存低于10GB , 建議選擇t2v 1.3B FP16精度的模型;但不建議選擇i2v的圖生視頻模型 , 因為基本無法生成視頻 。

如果顯卡顯存高于12GB , 可選模型就較多了 , 如i2v 480p FP8或者t2v 14B FP8 。

本次我們使用的顯卡為iGame GeForce RTX 5070 Ti Advanced OC 16GB , 可以選擇i2v 720p FP16或t2v 14B FP8精度的模型 。

iGame GeForce RTX 5070 Ti Advanced OC 16GB擁有8960個CUDA , 采用16GB GDDR7顯存 , 位寬256bit , 帶寬896 GB/s 。 算力方面 , FP16與FP32精度浮點運算為 43.94 TFLOPS , 280個第五代Tensor Core可以帶來1406 AI TOPS算力 。

本代RTX 5070 Ti相較上一代最大的變化就是顯存與算力方面的提升 , 16GB大顯存不僅在游戲方面可以無壓力4K , 在AI創作方面 , 更可以解鎖眾多高精度大模型 , 畢竟無論是語言、圖片或是視頻模型 , 顯存是最重要的“鑰匙” 。

回到上面的模型選擇 , 雖然擁有16GB的RTX 5070 Ti可以選擇i2v 720p FP16模型 , 不過FP16與FP8精度的模型實際生成視頻差別并不大 , 但FP8精度生成的速度要快很多 , 反而是分辨率比較重要 。

下載好模型后放到:根目錄-models-diffusion_models下 , 以我們的測試平臺為例:

【ComfyUI-aki-v1.6\\ComfyUI\\models\\diffusion_models\\i2v】

按照以上步驟 , 再下載好Clip Vision、Text encoder、VAE模型(同一個網址分別在不同目錄下) , 分別放到對應的根目錄下即可 。

使用繪世ComfyUI啟動器 , 一鍵啟動 。 即可看到ComfyUI的初始界面 , 先選擇【Manager】 , 將紅框中原本的Stable Version切換為Nightly Version , 然后更新全部 。

等待更新好 , 界面會跳出重啟的提示 , 退出所有界面 , 包括啟動器 , 再次進入后會安裝更新 。 更新完成后再次進入ComfyUI的初始界面即可開始創作 。 在左側工作流中 , 選擇Wan2.1 圖生視頻 。

即可看到完整的Wan2.1 圖生視頻工作流界面 , 下面我們分別講解 。

最左上角UNet加載器為加載模型的地方 , 現在我們使用的為圖生視頻工作流 , 所以要選擇剛剛下載的i2v , 如果是t2v則會報錯 。 我們選擇了720P_14B_FP8模型 , 分辨率較高 , 生成速度會比較慢 。

下面的為剪枝類型 , 可以使用默認的 , 也可以選擇對應的FP8_e4m3fn 。

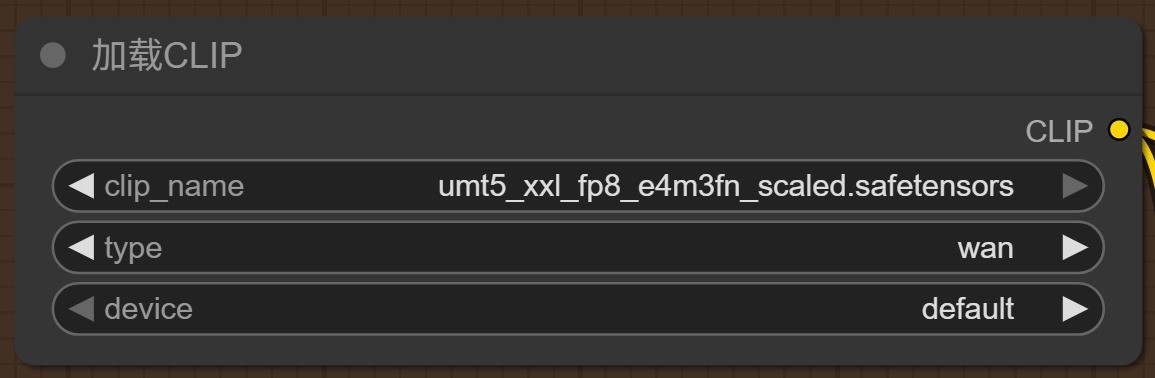

CLIP模型選擇umt5_xxl_fp8 , 與上面的模型做對應 , 類型選擇wan 。 因為這里面還有fp16或者bf16的模型 , 如果選錯了 , 同樣會報錯 。

CLIP視覺選擇下載好的clip_vision_h , 這里只有一個模型 , 應該不會出錯 。

在頁面偏右側的加載VAE模型中 , 選擇wan_2.1_vae 。

在圖像的尺寸調整中 , 可根據選擇的模型自定義 , 我們選擇了720p的模型 , 這里可以將寬度設置為1280×720 , 如果是豎圖則是720×1280 , 不過這個尺寸比較容易爆顯存 , 16GB以下的顯存建議可以適當調低尺寸 。 如果是480p的模型 , 則可以設置為640×480或480×640.

Wan圖像到視頻可控制生成視頻的總幀數 , 這里設置為45幀 。 所以可以簡單理解生成的視頻有多長 , 但幀數與時間并無直接關系 。

下面的批次大小直接設置為1 , 這里代表同時渲染多少幀 , 它不同于圖片渲染 , 高了會直接爆顯存 , 所以1即可 。

在視頻輸出節點中 , 可以調節視頻的每秒幀數 , 這里設置每秒16幀 , 所以視頻總幀率為45/16≈2.8秒 。

在format可以選擇輸出格式 , 主要為gif或mp4 , 視頻格式的話選擇h264-mp4即可 。

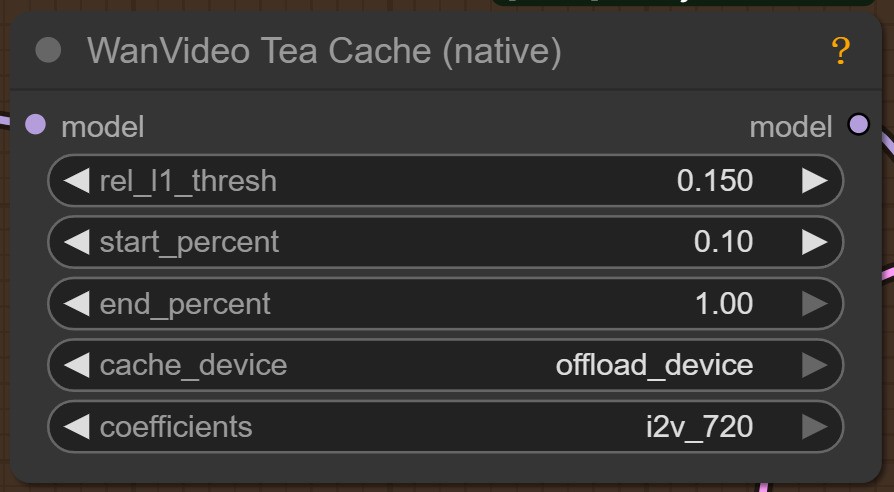

Tea Cach可以簡單理解為渲染抽幀給渲染提速 , 可以簡單理解為在一次渲染中 , 少渲染幾個不重要的幀 , 但前提是降低質量 。

第一項為抽幀的頻率 , 可控制在0.1-0.2之間 , 太高視頻質量會很差 。 第二三項分別為抽幀開始和截至時間 , 0.1為抽幀介入的時間在視頻10%的時間點 , 1為結束時間 。 最下方coefficients則要根據大模型選擇對應的 , 它不分FP8或者FP16精度 , 只選擇對應的分辨率即可 。

該節點可以在不增加現存壓力和時間消耗的基礎之上 , 讓視頻畫面添加更多細節 , 范圍值在0-10 , 大家可以從1或1.5這種幅度累加 。

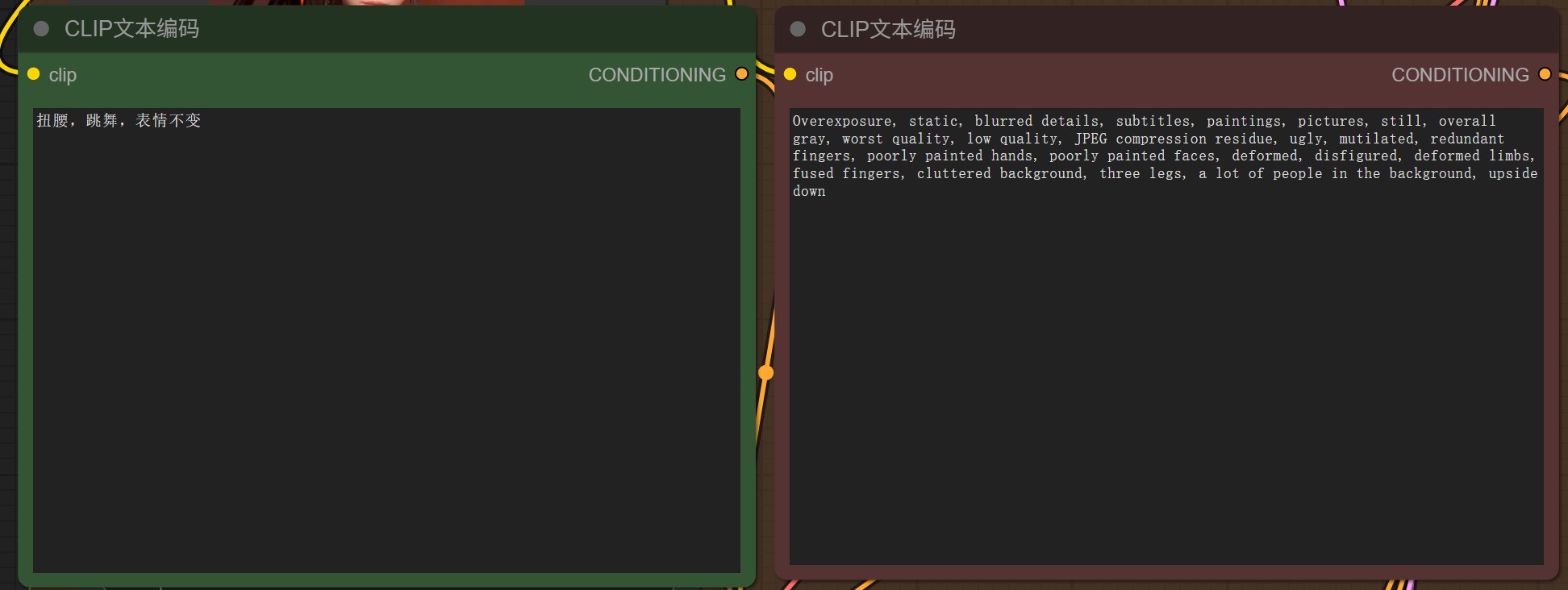

【新手上路 如何本地部署ComfyUI 用AI圖生視頻】提示詞框 , 綠色為正提示詞 , 紅色為反向提示詞 。 其實CLIP文本編碼并無正反之分 , 不過工作流在制作時 , 手動區分了不同框的提示定義 , 并用顏色作為區分 。 紅色的反向提示詞是官方提供的 , 默認即可 。

推薦閱讀

- OPPO Find X9 Pro體驗如何?8個問題看完就懂

- 從“手工作坊”變“現代工業” AI模型如何實現規模化量產?

- 墻體的AI革命,智能超表面如何讓建筑「聽懂」6G信號?

- 豆包是如何煉成的?字節放出自研萬卡訓練系統ByteRobust論文

- 教育AI應用:培生如何通過數字化學習推動增長

- 大漲300元!真我GT8系列發布,2899元起售,理光聯名含金量如何?

- 為硬核玩家而生:第五代驍龍8至尊版如何重塑旗艦游戲體驗?

- 老美持續打壓,技術壟斷陰影無處不在,國產如何打破技術壟斷?

- 百度AI榜,一場遲到的本地生活實驗

- 如何將“對話”變成商機?揭秘Plaud的成功秘訣