文章圖片

文章圖片

文章圖片

機(jī)器之心報道

機(jī)器之心編輯部

LLM在持續(xù)學(xué)習(xí)方面有了新突破 。

近日 , 谷歌推出了一種全新的用于持續(xù)學(xué)習(xí)的機(jī)器學(xué)習(xí)范式 —— 嵌套學(xué)習(xí) , 模型不再采用靜態(tài)的訓(xùn)練周期 , 而是以不同的更新速度在嵌套層中進(jìn)行學(xué)習(xí) , 即將模型視為一系列嵌套問題的堆疊 , 使其能夠不斷學(xué)習(xí)新技能 , 同時又不會遺忘舊技能 。

而這或?qū)?biāo)志著人工智能朝著「真正像大腦一樣進(jìn)化的方向」邁出了一大步 。

這種方法一經(jīng)發(fā)布 , 便引起網(wǎng)友的熱議 , 不少網(wǎng)友表示 , 「這很令人興奮 , 是邁向真正自適應(yīng)、自我改進(jìn)智能的重要一步 。 」

下面來詳細(xì)了解一下 。

在谷歌看來 , 過去十年 , 得益于強(qiáng)大的神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)和高效的訓(xùn)練算法 , 機(jī)器學(xué)習(xí)(ML)領(lǐng)域取得了令人驚嘆的進(jìn)展 , 可盡管大語言模型(LLMs)取得了巨大成功 , 一些根本性問題仍然存在 , 尤其是「持續(xù)學(xué)習(xí)(Continual Learning)」—— 即模型能否在不遺忘舊知識的前提下 , 不斷學(xué)習(xí)新知識與技能 。

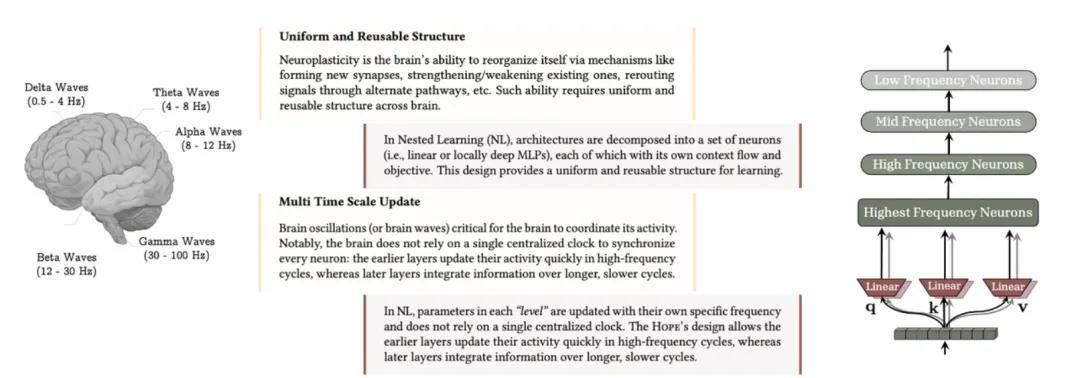

在人類學(xué)習(xí)和自我改進(jìn)方面 , 人腦是最完美的范例 , 它依靠神經(jīng)可塑性(neuroplasticity)不斷調(diào)整結(jié)構(gòu) , 以適應(yīng)新的經(jīng)驗(yàn)、記憶與學(xué)習(xí) 。 缺乏這種能力的人 , 就會像患有前向性遺忘癥(anterograde amnesia)一樣 , 只能理解眼前的信息 。

而當(dāng)前的 LLM 也面臨著類似的限制 , 「知識」僅限于輸入窗口的上下文 , 或是預(yù)訓(xùn)練階段學(xué)到的靜態(tài)信息 。

為了彌補(bǔ)這些缺點(diǎn) , 一個直覺式的做法是不斷用新數(shù)據(jù)更新模型參數(shù) , 但這往往導(dǎo)致所謂的「災(zāi)難性遺忘」(Catastrophic Forgetting , CF)—— 模型學(xué)了新任務(wù) , 卻失去了舊任務(wù)的能力 。 過去的研究嘗試通過改進(jìn)網(wǎng)絡(luò)結(jié)構(gòu)或優(yōu)化算法來緩解這一問題 。

然而 , 長期以來 , 大家總是把「模型結(jié)構(gòu)」與「優(yōu)化算法」當(dāng)作兩件事來看待 , 這種割裂的視角阻礙了統(tǒng)一高效學(xué)習(xí)系統(tǒng)的建立 。

谷歌發(fā)表于 NeurIPS 2025 的論文《Nested Learning:深度學(xué)習(xí)架構(gòu)的幻象》 中 , 提出了一個新的學(xué)習(xí)框架 —— 嵌套學(xué)習(xí)(Nested Learning) , 用以彌合架構(gòu)與優(yōu)化之間的鴻溝 。 其核心思想是:一個機(jī)器學(xué)習(xí)模型并非單一的學(xué)習(xí)過程 , 而是由多個相互關(guān)聯(lián)、層次分明的優(yōu)化子問題組成 。

谷歌認(rèn)為模型架構(gòu)與優(yōu)化算法本質(zhì)上是同一類事物;它們只是不同層級的「優(yōu)化層」(optimization levels) , 各自擁有獨(dú)立的信息流與更新頻率 。

【突破LLM遺忘瓶頸,谷歌「嵌套學(xué)習(xí)」讓AI像人腦一樣持續(xù)進(jìn)化】通過識別這種內(nèi)在結(jié)構(gòu) , 嵌套學(xué)習(xí)為 AI 設(shè)計(jì)揭示了一個此前被忽視的維度 , 讓我們能在不同時間尺度上構(gòu)建更具「深度」的學(xué)習(xí)組件 , 從而解決災(zāi)難性遺忘等問題 。

基于嵌套學(xué)習(xí)原理 , 谷歌設(shè)計(jì)了一個自我修改型架構(gòu) ——Hope , 實(shí)驗(yàn)表明:Hope 在語言建模任務(wù)中表現(xiàn)優(yōu)異 , 并且在長上下文記憶管理方面超越了當(dāng)前最先進(jìn)的模型 。

論文標(biāo)題:Nested Learning: The Illusion of Deep Learning Architectures 論文地址:https://abehrouz.github.io/files/NL.pdf嵌套學(xué)習(xí)范式(The Nested Learning Paradigm)

嵌套學(xué)習(xí)揭示出 , 復(fù)雜的機(jī)器學(xué)習(xí)模型其實(shí)是一組相互嵌套或并行運(yùn)行的優(yōu)化問題 , 每個子問題都有自己的上下文流(context flow) , 也就是其試圖從中學(xué)習(xí)的特定信息集 。

也就是說 , 傳統(tǒng)深度學(xué)習(xí)方法其實(shí)是在「壓縮」這些內(nèi)部信息流 , 而嵌套學(xué)習(xí)為我們提供了新的設(shè)計(jì)維度 , 從而可以構(gòu)建具有更深計(jì)算深度的學(xué)習(xí)組件 。

以聯(lián)想記憶(Associative Memory)為例 , 聯(lián)想記憶是指根據(jù)一個事物聯(lián)想到另一個事物的能力 , 像是大家看到一張臉就想起一個名字 。 基于此 , 谷歌發(fā)現(xiàn):訓(xùn)練過程本身 , 尤其是反向傳播(backpropagation)過程 , 可以被建模為一種聯(lián)想記憶機(jī)制 , 該模型學(xué)習(xí)將每個數(shù)據(jù)點(diǎn)映射到其局部誤差(local error)上 , 以衡量該數(shù)據(jù)點(diǎn)的「意外程度」 。

類似地 , 就像 Miras 之類研究所指出的那樣 , Transformer 的注意力機(jī)制也可以形式化為聯(lián)想記憶模塊 , 用于學(xué)習(xí)序列中 token 之間的映射關(guān)系 。

在人腦中 , 統(tǒng)一的結(jié)構(gòu)與可重復(fù)使用的模塊 , 以及多時間尺度更新(multi-time–scale update) , 是人類持續(xù)學(xué)習(xí)的關(guān)鍵 。 而嵌套學(xué)習(xí)使得模型的每個組件都能以不同的頻率進(jìn)行更新 , 這表明 , 常見架構(gòu)(如 Transformer、記憶模塊)其實(shí)都是具有不同更新頻率的線性層 。

通過定義更新頻率(update frequency rate) , 即每個組件的權(quán)重被調(diào)整的頻次 , 谷歌可以將這些優(yōu)化問題組織成有序的「層級」 , 這便構(gòu)成了嵌套學(xué)習(xí)范式的核心 。

嵌套學(xué)習(xí)的實(shí)際應(yīng)用

嵌套學(xué)習(xí)視角提供了改進(jìn)現(xiàn)有算法和架構(gòu)的原則性方法:

深度優(yōu)化器:嵌套學(xué)習(xí)將優(yōu)化器(如動量優(yōu)化器)視為聯(lián)想記憶模塊 , 從而可以將聯(lián)想記憶的原理應(yīng)用于它們 , 觀察到 , 許多標(biāo)準(zhǔn)優(yōu)化器依賴簡單的點(diǎn)積相似度(dot-product similarity) , 而這并未考慮不同數(shù)據(jù)樣本之間的復(fù)雜關(guān)系 。

通過將優(yōu)化目標(biāo)改為更標(biāo)準(zhǔn)的損失指標(biāo) , 如 L2 回歸損失(L2 regression loss) , 可以推導(dǎo)出新的動量公式 , 使優(yōu)化器對噪聲數(shù)據(jù)更具魯棒性 。

連續(xù)體記憶系統(tǒng)(Continuum Memory Systems):在傳統(tǒng) Transformer 中:序列模型充當(dāng)短期記憶 , 保存即時上下文;前饋神經(jīng)網(wǎng)絡(luò)則充當(dāng)長期記憶 , 存儲預(yù)訓(xùn)練知識 。 嵌套學(xué)習(xí)范式將這一概念擴(kuò)展到一個稱之為「連續(xù)體記憶系統(tǒng)」(CMS)的結(jié)構(gòu)中 , 其中記憶被視為一系列模塊 , 每個模塊以不同的特定頻率更新 。

這為持續(xù)學(xué)習(xí)創(chuàng)建了一個更加豐富、高效的記憶系統(tǒng) 。

Hope:具備連續(xù)記憶的自我修改架構(gòu)

作為概念驗(yàn)證 , 谷歌基于嵌套學(xué)習(xí)原理設(shè)計(jì)了 Hope 架構(gòu) , 它是 Titans 架構(gòu)的一個變體 。

Titans 架構(gòu)是基于「驚訝度」優(yōu)先級的長期記憶系統(tǒng) , 但它僅有兩層參數(shù)更新機(jī)制 , 屬于一階上下文學(xué)習(xí) 。

Hope 則是一個自我修改的循環(huán)架構(gòu)(self-modifying recurrent architecture) , 能夠執(zhí)行無限層次的上下文學(xué)習(xí) , 并通過 CMS 模塊擴(kuò)展上下文窗口 。 它能夠通過自我引用過程優(yōu)化自身記憶 , 形成具有無限循環(huán)學(xué)習(xí)層次的結(jié)構(gòu) 。

實(shí)驗(yàn)與結(jié)果

谷歌評估了嵌套學(xué)習(xí)框架下:新型深度優(yōu)化器的有效性 , 以及 Hope 在語言建模、長上下文推理、持續(xù)學(xué)習(xí)與知識整合任務(wù)上的表現(xiàn) 。

結(jié)果顯示:

Hope 在多項(xiàng)語言建模與常識推理任務(wù)上表現(xiàn)出更低的困惑度(perplexity)與更高的準(zhǔn)確率;

不同架構(gòu)在語言建模任務(wù)(困惑度 , 左)和常識推理任務(wù)(準(zhǔn)確率 , 右)上的性能對比:包括 Hope、Titans、Samba 以及基線 Transformer 。

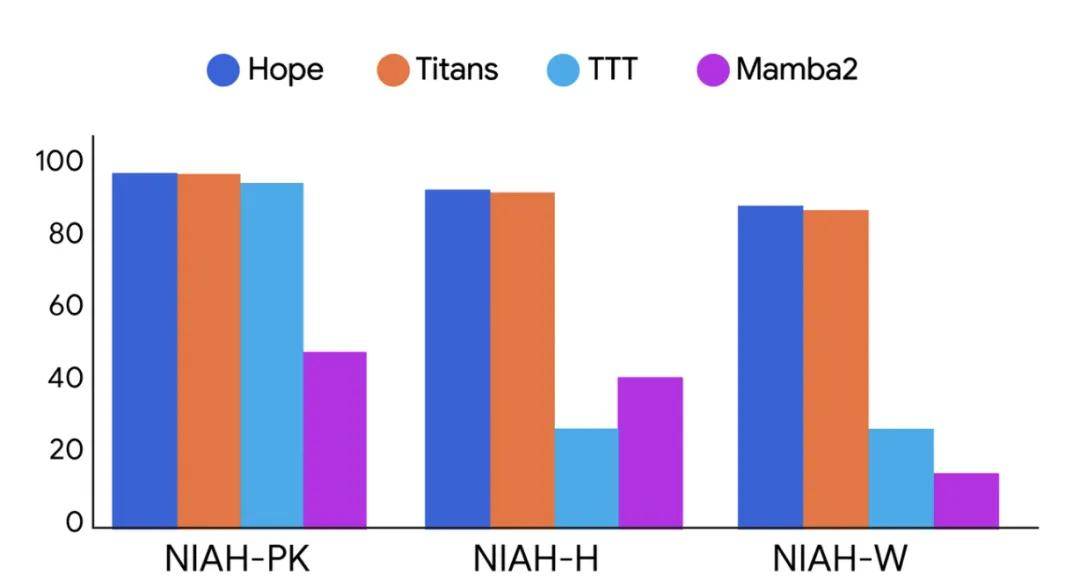

在長上下文大海撈針任務(wù)( NIAH)中 , Hope 展現(xiàn)出顯著更優(yōu)的記憶管理能力 。 這證明 CMS 提供了一種更高效、更有效的方法來處理擴(kuò)展的信息序列 。

不同架構(gòu)在長上下文任務(wù)中、不同難度等級下的性能對比:包括 Hope、Titans、TTT 和 Mamba2 。 其中 , NIAH-PK、NIAH-H 和 NIAH-W 分別表示大海撈針任務(wù)的三種類型:通行密鑰、數(shù)字和單詞 。

總的來看 , 嵌套學(xué)習(xí)代表了谷歌對深度學(xué)習(xí)理解邁進(jìn)了新階段 , 通過將架構(gòu)與優(yōu)化視為統(tǒng)一的、層次化的優(yōu)化系統(tǒng) , 打開了一個全新的設(shè)計(jì)維度 。 由此產(chǎn)生的模型(如 Hope)則表明 , 這種系統(tǒng)性整合方法能夠帶來更強(qiáng)的表達(dá)能力、更高的效率與持續(xù)學(xué)習(xí)能力 。

或許可以說 , 嵌套學(xué)習(xí)為彌合當(dāng)前 LLM「易遺忘」的局限與人腦卓越的持續(xù)學(xué)習(xí)能力之間的差距奠定了堅(jiān)實(shí)的理論與實(shí)踐基礎(chǔ) , 為構(gòu)建下一代可自我改進(jìn)的人工智能(self-improving AI)提供了新的可能性 。

參考鏈接:

https://research.google/blog/introducing-nested-learning-a-new-ml-paradigm-for-continual-learning/

https://x.com/behrouz_ali/status/1986875258935066946

https://x.com/JeffDean/status/1986938111839129858

推薦閱讀

- AMD預(yù)計(jì)五年內(nèi)獲利將大漲3倍,數(shù)據(jù)中心業(yè)務(wù)營收將突破1000億美元

- 榮耀400系列全球發(fā)貨量突破600萬臺,銷售火爆背后見證強(qiáng)大產(chǎn)品力

- 榮耀 400 系列全球發(fā)貨量突破 600 萬臺

- 突破AI產(chǎn)業(yè)落地卡點(diǎn),螞蟻韋韜:數(shù)據(jù)是變革關(guān)鍵

- 終結(jié)Transformer統(tǒng)治!清華姚班校友出手,劍指AI「災(zāi)難性遺忘」

- 戴爾PowerFlex與Regatta數(shù)據(jù)庫組合突破傳統(tǒng)數(shù)據(jù)庫局限性

- LLM強(qiáng)化學(xué)習(xí)新框架!UCSD多智能體訓(xùn)練框架讓LLM工具調(diào)用能力暴增

- 裕太微車載以太網(wǎng)芯片出貨量突破千萬顆

- 業(yè)內(nèi)首個,釘釘AI表格單表容量突破1000萬熱行!

- 中關(guān)村學(xué)院新發(fā)現(xiàn):輕量級驗(yàn)證器可解鎖LLM推理最優(yōu)選擇

![Win10開機(jī)提示登錄組件錯誤[4] 請重新啟動電腦管家怎么解決?](http://img.yunnanlong.com/221026/0212452539-0-lp.jpg)