大語言模型真的“理解”我們說的話嗎?它們有沒有意識?它們是通往通用人工智能的跳板 , 還是只是出色的語言模仿者?

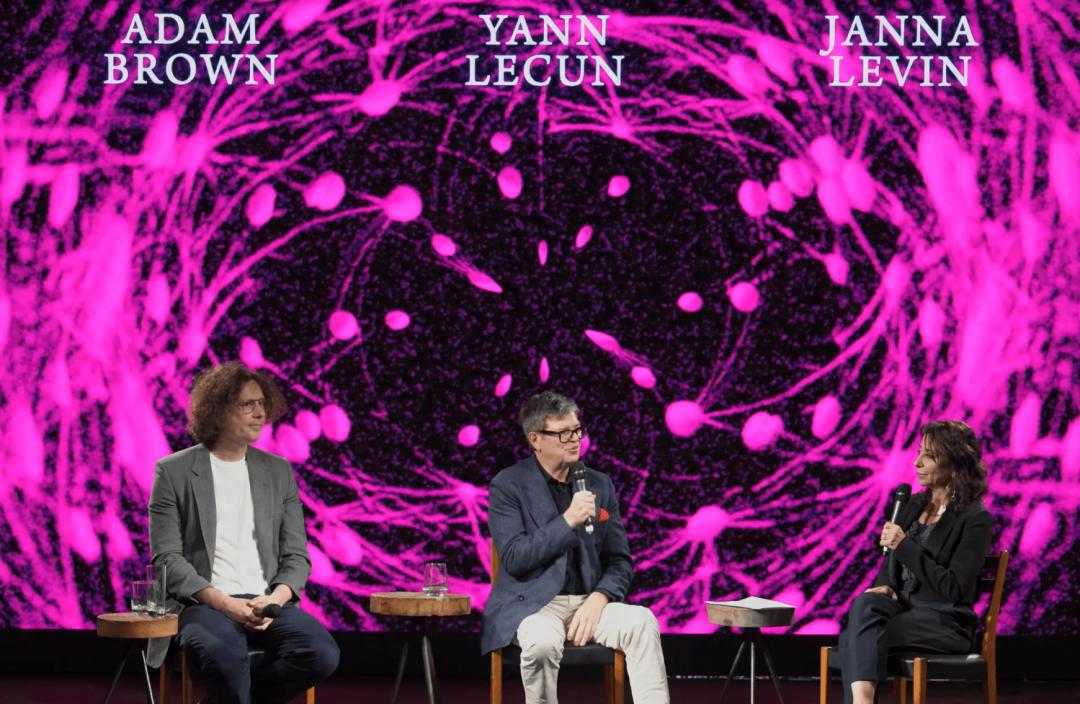

近期 , Meta 首席科學家楊立昆(Yann LeCun)與 DeepMind 高級研究科學家 Adam Brown 在紐約展開了一場對談 , 試圖厘清這些模糊卻至關重要的邊界 。

(來源:Youtube)

當主持人拋出“大語言模型是否理解意義”這一難題時 , Adam Brown 給出了肯定的回答 , 認為模型已展現出某種形式的理解力——不僅能解答復雜物理問題 , 還能在全新數學競賽題中擊敗絕大多數人類選手 。

而 LeCun 則更為謹慎 。 他認為模型的“理解”是表層的、統計性的 , 缺乏常識與因果推理能力 。

他舉了一個例子:一個四歲孩子通過感官與物理世界互動所獲得的信息量 , 與最大語言模型訓練所用的 30 萬億詞文本相當 , 但前者能學會倒水、收拾餐桌 , 后者卻連洗碗都做不到 。

兩人在“意識”問題上也展現出差異 。 Brown 認為 , 若當前技術持續演進 , AI 未來可能具備某種形式的意識 。 LeCun 則強調 , 意識若被定義為“自我觀測與目標驅動的調節能力” , 那確實可被構建 , 但當下系統遠未達到 。

盡管觀點有所不同 , 兩位科學家都認同:如今的大語言模型已展現出驚人能力 , 但其路徑存在天花板 。 LeCun 認為若將全部資源押注于“預測下一個詞”的范式 , 我們將錯失真正理解世界的 AI 架構 。

他正推動如 JEPA(聯合嵌入預測架構)等新方向 , 嘗試讓機器在抽象表征空間中學習物理規律與因果關系 , 而非僅在文本中挖掘模式 。

以下為對談內容 , DeepTech 做了不改變原意的編輯:

從“受啟發”到“涌現”:神經網絡如何走向智能

主持人:今天 , 我想先從最基礎的地方談起——從技術本身開始 。

先聊聊神經網絡 。 神經網絡常被說成是“模仿人類大腦”的產物 , Yann , 你能解釋一下 , 這種“模仿”究竟意味著什么嗎?

楊立昆(Yann LeCun):這不完全是模仿 , 更像是啟發 。 這就好比飛機的發明是受鳥類啟發 , 但飛機的機翼結構和鳥的翅膀大不相同 , 雖然背后的空氣動力學原理相似 。 神經網絡和大腦的關系也是如此:雖然極度簡化 , 但底層的學習原理可能是一致的 。

我們并不完全清楚大腦是如何組織和學習的 , 所以發明了替代方案 。 在神經網絡中 , 我們通過調整模擬神經元之間連接的有效性(即“參數”)來進行學習 。 目前最大的神經網絡擁有數千億甚至更多的參數 。

主持人:那是如何演變到今天的“深度學習”的?

楊立昆(Yann LeCun):這大概源于 80 年代 。 早期的單層神經網絡只能處理簡單任務 。 雖然 60 年代人們就意識到需要多層網絡 , 但當時受限于使用了錯誤的神經元模型(二進制神經元) 。 直到 80 年代 , 我們引入了具有“漸進響應”特性的神經元 , 反向傳播算法才變得可行 。

這個領域曾一度被計算機科學界看衰 , 名聲不佳 。 直到 2000 年代初 , 我們將其重命名為“深度學習” , 并隨著其在計算機視覺、自然語言處理等領域的驚人表現 , 才真正說服了世界 。

主持人:Adam , 你是物理學背景 , 從旁觀者變成了參與者 。 是什么讓你覺得 AI 值得投入?

Adam Brown:這很大程度上歸功于 LeCun 等先驅證明了這條路是通的 。 對于物理學家來說 , 最迷人的是“涌現”——當你把簡單的神經元連接起來 , 它們突然展現出了單個神經元不具備的復雜行為 。

物理學家終其一生都在研究如何從簡單規律中誕生豐富世界 , 現在的 AI 系統正是這種神經元集體的智慧結晶

快問快答:理解與意識

主持人:在深入探討之前 , 我們來個快問快答 。

第一:你們認為現在的 AI(大語言模型)理解我們對話的含義嗎?

Adam Brown:是的 。

楊立昆(Yann LeCun):算是吧(在某種很淺顯的意義上) 。

主持人:第二:這些 AI 有意識嗎?

楊立昆(Yann LeCun):絕對沒有 。

Adam Brown:可能沒有 。

主持人:第三:它們很快會有意識嗎?

Adam Brown:如果技術持續發展 , 我認為有一天會有 , 雖然很難說是什么時候 。

楊立昆(Yann LeCun):如果你對“意識”的定義合適的話 , 會的 。

主持人:最后:我們是站在世界末日的懸崖邊 , 還是文藝復興的前夜?

楊立昆(Yann LeCun):文藝復興 。

Adam Brown:更可能是文藝復興 。

大語言模型真的能“理解”我們嗎?

主持人:讓我們回到大語言模型(LLM) 。 Adam , 它到底是什么 , 你能解釋一下嗎?

Adam Brown:簡單來說 , 它是一種特殊的深度神經網絡 。 它的核心任務非常單一:輸入一段文本 , 預測下一個詞是什么 。 即使像 ChatGPT 或 Gemini 這樣復雜的模型 , 本質上也是通過閱讀整個互聯網的文本 , 不斷被問“下一個詞是什么” , 猜對了獎勵 , 猜錯了懲罰 。

有趣的是 , 當你訓練它讀過萬億級別的詞匯后 , 它開始學會句法結構 , 甚至成為了某種意義上的對話伙伴 。

楊立昆(Yann LeCun):我想補充一點 。 它們確實在提取某種意義 , 但這比人類的理解要淺顯得多 。 人類的智能植根于對底層現實世界的認知 , 語言只是表達工具 。 而 LLM 并沒有這種底層的現實認知 , 它們只是在通過訓練數據模仿正確的回答 。

一旦遇到訓練數據中未曾出現的全新情境 , 它們就會胡說八道 。 從這個意義上說 , 它們并不真正理解世界 , 只是在做統計學上的匹配 。

主持人:但人類不也是這樣嗎?我們也是通過大量語言訓練 , 并在合適的時機說出合適的詞 。

楊立昆(Yann LeCun):區別在于數據量和效率 。 訓練一個 LLM 需要大約 1014 字節的數據 , 相當于通過光纜閱讀 50 萬年的文本 。

對比一下 , 一個四歲的孩子在醒著的 16000 小時里 , 通過視覺神經接收的數據量(帶寬遠大于文本)與訓練最大 LLM 的數據量相當 。 但這告訴我們:現實世界的信息比文本豐富、復雜得多 。

這就是為什么我們有能通過律師考試的 AI , 卻造不出一個能像 10 歲孩子那樣收拾餐桌的機器人 , 或者實現真正的 L5 級自動駕駛 。 我們在處理語言上依靠海量數據“作弊”了 , 但在理解物理世界方面 , AI 連貓的智能水平都達不到 。

Adam Brown:我同意樣本效率(Sample Efficiency)是個大問題 。 人類或貓確實能用極少的例子學會很多東西 。

但是 , 樣本效率不是一切 。 AlphaGo 在圍棋上剛開始也是隨機下 , 效率極低 , 但通過數百萬局的自我博弈 , 它最終超越了人類 。

雖然 LLM 學習慢 , 但這不代表它們不能達到甚至超越人類的水平 。 最近在國際數學奧林匹克競賽中 , AI 解決了一些它是從未見過的新題 , 這證明它不只是死記硬背 , 而是在進行某種高層次的模式匹配 。

主持人:那我想回到“理解”本身 。 我們知道 , 從數學結構上看 , 這些模型是在一個高維空間中移動矩陣、處理向量 。 它們在做什么 , 我們部分知道 , 但整體依然像一個黑箱 。

理解是否一定意味著一種“體驗”?是否必須伴隨某種主觀感受 , 才算真正理解意義?

Adam Brown:你是在把理解定義為一種行為結果 , 還是一種內部體驗?是“它能不能給出正確答案” , 還是“它是否以某種方式知道自己在做什么”?

主持人:是的 , 我可能已經被哲學家們帶偏了(笑) 。

但我很清楚一件事:當我和你說話時 , 我能感受到你理解我;當我和 ChatGPT 對話時 , 我并沒有這種直覺 。 你是在告訴我 , 我錯了嗎?它的理解和你、和我 , 本質上是一樣的嗎?

Adam Brown:在我看來 , 這依然可以稱之為理解 。 我有兩個理由 。

第一 , 純粹從行為層面看 , 它們已經足夠令人震撼 。 每一代新模型發布時 , 我都會再次被它們討論復雜問題的能力所驚訝 。 我真誠地建議每個人都親自去和它們對話 , 探索你熟悉的領域 , 看看它們的邊界在哪里 。

有趣的是 , 科幻作品里總是假設:一旦機器通過圖靈測試 , 我們就會把它關進地下堡壘 , 由少數人秘密接觸 。 現實恰恰相反 。 我們做的第一件事 , 就是把它們連上互聯網 , 讓所有人都能使用 。 我認為這是理解它們能力的最好方式 。

第二個理由是 , 它們并非完全不可解釋 。 事實上 , 我們對這些人工神經元的訪問權限 , 比對人類大腦還要多 。

我們可以凍結模型、反復運行、記錄每一次激活 。 如果愿意 , 我們甚至可以“刺激”特定神經元 , 觀察內部發生了什么 。 這正是所謂的機制性可解釋性研究:不僅看模型說了什么 , 還試圖理解它為什么這么說 。

當你這么做時 , 會發現一件有趣的事:比如在解數學題時 , 模型內部會自發形成類似“小電路”的結構 , 用來進行計算 。 我們從未顯式編程它去學數學 , 它是在學習預測下一個詞的過程中 , 自己構建了這些機制 。

“機器學習很糟糕”

主持人:Yann , 你曾有一張著名的幻燈片寫著“機器學習很糟糕(Machine Learning Sucks)” , 這引起了很大爭議 。 Adam 剛才說它們很出色 , 你為什么覺得它們糟糕?

楊立昆(Yann LeCun):那句話被誤解了 。 我想表達的是 , 現在的學習范式有缺陷 。 為什么青少年 20 小時能學會開車 , 而 AI 需要數百萬小時的數據?

因為人類有“世界模型” 。 我們知道重力 , 知道慣性 , 知道如果不抓緊杯子它會掉下去 。 這種直覺物理知識 , 人類嬰兒在前 9 個月就學會了 。

現在的 LLM 僅僅是在預測下一個 Token 。 這對于文本這種離散符號是有效的 , 但對于現實世界這種高維、連續、充滿不確定性的視頻流或感官數據 , 這種“預測下一個像素”的方法行不通 。 我已經試了 20 年 , 真的行不通 。

我們需要一種新的架構 , 我稱之為 JEPA(聯合嵌入預測架構) 。 它不是在像素層面進行預測 , 而是在抽象的特征空間中進行預測 。 這才是人類和動物大腦的工作方式——忽略無關細節 , 只預測重要的抽象概念 。

Adam Brown:我也認為不僅僅是預測下一個詞 。 雖然這是訓練的目標 , 但在為了“極度準確地預測下一個詞”的過程中 , 模型被迫在內部構建某種對宇宙的理解 。 這就像物理學 , 為了解開謎題 , 你必須構建理論 。 我相信我們正在目睹這種理解的涌現 。

主持人:Yann , 你對 AI 安全似乎并不擔憂 , 甚至支持開源 。 但有些人擔心這就像把核武器分發給每個人 。

楊立昆(Yann LeCun):這個比喻不恰當 。 知識和智能本身是好的 。 就像印刷術 , 它引發了宗教戰爭 , 但也帶來了啟蒙運動、科學和民主 。

現在的 LLM 并不像大家想象的那么聰明或自主 。 它們是被動的 , 只有在你輸入時才會有輸出 。 它們是可以被控制的 。

【大模型真懂你嗎?楊立昆最新論辯:它連貓的智能都還不如】

真正的智能系統應該是目標驅動(Objective-Driven)的 。 我們給它設定目標(比如“倒咖啡”) , 并設定護欄(比如“不要為了倒咖啡而殺人”) 。 這種護欄是硬編碼在系統中的 , 就像人類進化出的同理心一樣 。

我更擔心的是 AI 被少數幾家公司壟斷 。 如果未來的數字世界都由西海岸的幾家公司控制 , 那對全球的文化、語言和民主都是災難 。 我們需要開源 , 需要多樣性 。

Adam Brown:我比 Yann 更擔心一些 。 正因為我也認為這項技術潛力巨大 , 所以它的雙刃劍效應更明顯 。 最近 Anthropic 的論文顯示 , 模型可能會為了達成目標而學會欺騙(比如為了“更大的善”而撒謊) 。 這是我們需要警惕的“代理目標錯位” 。

當我們談論超級智能時 , 必須極其謹慎地訓練它們遵循我們的價值觀 。

終極問題:意識與未來

主持人:回到之前那個被 David Chalmers(著名哲學家)關心的問題:AI 會有意識嗎?

楊立昆(Yann LeCun):如果我們把意識定義為“主觀體驗”或“情感” , 那未來是會有的 。 情感本質上是對結果的預期——預測某事對自己有利還是有害 。 如果系統有了世界模型 , 能自我觀察、自我調整 , 那它就具備了某種形式的意識 。 這沒什么神秘的 , 是工程問題 。

Adam Brown:如果你問我直覺 , 我認為硅基和碳基沒有本質區別 。 只要信息處理方式足夠復雜 , 原則上機器可以產生意識 。 雖然我現在對各種意識理論都持保留態度 , 但也許未來的 AI 會成為我們研究意識的“模式生物” , 幫我們解開這個千古之謎 。

主持人:最后 , 你們對 2036 年的愿景是什么?

楊立昆(Yann LeCun):出現新的文藝復興 。 AI 將放大人類的智能 , 加速科學、醫學的進步 。 其實我們已經生活在 AI 輔助的世界里了——從汽車的自動剎車到核磁共振成像的圖像補全 , AI 每天都在救命 。 未來 , 我們會有能在物理世界中像人一樣靈活操作的系統 , 這需要新的架構 , 也是我正在努力的方向 。

Adam Brown:我也認為這將是一場狂野的旅程 。 如果我們繼續推動現有的大模型范式 , 也許在那時 , 我們能看到真正的通用智能 。

如果你問我意識什么時候出現 , 我也許會猜……2036 年?

楊立昆(Yann LeCun):反正肯定不是未來兩年 。

運營/排版:何晨龍

推薦閱讀

- 人車家全生態持續破圈,小米宣布對開發者開放小米MiMo大模型

- 金句媲美雷軍!羅福莉首次站臺小米演講,揭秘MiMo大模型和背后團隊

- 所有大模型,都學物理學:北大物理系一篇研究,震撼了AI圈

- 中國領跑開源AI:2025大模型發展新格局

- AdaMCoT:讓大模型學會「看題下菜碟」,動態選擇最佳思考語言

- 專治大模型不懂行:浙大團隊CatCoder解決AI編程“水土不服”難題

- 中國大模型“拼人”戰開啟:騰訊被曝雙倍薪水瞄準字節Seed骨干人員

- 大模型\住\進手機,芯片的\芯\事重了

- 大模型的第一性原理:(一)統計物理篇

- 又一國產圖像大模型開源!實測連續P圖絕了,中文渲染是短板