文章圖片

文章圖片

文章圖片

當我們看到一只貓時 , 除了注意到它的外形和顏色 , 腦海里可能還會浮現出“貓”這個詞、出現的語境、聯想到它愛吃肉和喵喵叫等特性 。 這個看似自然又輕松的過程 , 其實背后 , 是大腦視覺等感知系統與語言系統之間正在進行的一場高速、無聲的對話 。

近日 , 北京大學朱毅鑫教授課題組、北京大學畢彥超教授課題組和山西醫科大學第一醫院王效春團隊通過結合 AI 模型和大腦損傷患者的數據 , 發現語言其實是一副無形的智能眼鏡 , 時刻在悄悄修飾著我們看到的世界 。 我們可能以為視覺就是眼睛看到什么就是什么 , 但是這項成果說明了視覺從來都不是孤立的 。 事實上 , 當我們在看圖片的時候 , 其實不只是在看 , 而是在進行被語言調制過的看 。

朱毅鑫告訴 DeepTech:“這項工作的獨特之處在于結合了三類方法:一是腦成像技術 , 讓我們能夠觀測正常人的大腦活動;二是腦損傷病人研究 , 提供了因果推斷的可能;三是 AI 模型幫助我們解釋觀察到的現象 。 這是第一次將這三個學科視角融合在一起 , 為一個經典爭議提供了實證依據 。 過去大家多是寫論文辯論 , 而現在我們有了數據、模型和病人證據 , 這是一個范式上的進步 。 ”

畢彥超補充稱:“我們最近牽頭了一項國家重點研發項目 , 希望在此基礎上開展更大規模的研究 , 結合更豐富的行為學數據 , 不僅限于特定任務 。 ”

圖 | 從左到右:朱毅鑫、畢彥超、王曉莎、陳昊揚(來源:受訪者)

AI 是否擁有人腦某些關鍵特征?

據了解 , 語言至少可以通過兩種方式來參與視覺加工:第一種是貼標簽 , 當我們知道某個物體叫做蘋果的時候 , 這個詞匯會幫助我們快速地歸類 , 并針對蘋果和梨做出區分;第二種是編織關系網 , 一些句子級別的描述比如螞蟻搬著面包屑會把物體放入情境和關系之中 , 這種關系網絡也會影響視覺皮層對于圖像的處理 。

這項成果證明了人類的視覺不是被動的攝像 , 而是主動的、與語言系統實時互動的構建過程 。 我們看到的 , 不僅是光線和形狀 , 還有大腦使用語言和經驗潤色之后的理解 。 這也解釋了為什么不同語言文化背景的人對于顏色、空間的感知可能略有不同 。

目前的 AI 依然強大 , 但依然是一個黑箱 , 我們很難理解它們內部的決策過程 , 而這次成果提供了一種新思路:通過比較 AI 與大腦的響應模式 , 并借助腦損傷患者的自然實驗 , 即可判斷一個 AI 是否真的具備了人腦的某些關鍵特征 。 未來 , 我們或許能夠設計出更像人腦的 AI , 它們不僅能看能說 , 還能像人一樣使用語言來思考所看見的世界 。

同時 , 此次成果還可以促進腦損傷患者的康復 , 即理解語言與視覺的交互機制 , 也有助于為中風患者或者腦損傷患者設計更加有效的認知康復方案 。 如果我們知道哪些連接影響了患者的視覺理解 , 就可以有針對性地進行訓練 , 幫助他們重建大腦內部的對話 。

而未來的教育、設計和人機交互等領域 , 也可以從本次成果中獲得受益 。 如果知道語言是如何塑造視覺的 , 那么就可以設計更加符合大腦處理習慣的信息呈現方式 , 比如在教育中使用圖文并茂且語境豐富的材料 , 以此來促進更深層次的理解與記憶 。

人類所謂的看見 , 從來都不是孤獨的感官體驗 , 實際上是一場大腦多部門聯手的大合唱 , 這能為人類對于大腦的認知帶來的新見解 , 也為開發更加接近人腦的智能機器提供了關鍵線索 。

【北大AI研究顛覆認知:我們看到的不是真實,是被語言潤色過的現實】

(來源:https://www.nature.com/articles/s41562-025-02357-5)

朱毅鑫說道:“從 AI 角度看 , 這項研究為我們提供了一種與腦科學結合的新思路 。 以前很多跨學科合作停留在數據層面 , AI 充當數據分析工具 。 這次則是讓 AI 模型進入循環 , 與人腦實驗相互反饋 , 共同解構一個科學問題 。 ”

畢彥超則表示:“從基礎科研角度 , 我們一直希望把機制搞清楚 , 從而更好地服務應用 。 如果語言對認知的影響比我們想象的更深 , 那么我們可以通過語言更有效地進行教育、促進智能發展 , 甚至干預情緒障礙 。

此外 , 與臨床團隊的合作讓我們看到 , 腦損傷后除了運動障礙 , 認知障礙比如理解困難和語言障礙同樣會嚴重影響患者生活 。 理解語言與感知的關系 , 可能為認知障礙的診斷與康復提供新思路 。 ”

用 AI 解析人腦 , 再用人腦實驗驗證 AI

研究中 , 本次團隊使用了 OpenAI 此前打造的 CLIP 模型 , 這是一種基于對比學習的多模態預訓練模型 , 可以將圖像與文本語義進行對齊 。 它和我們熟悉的圖像識別 AI 有所不同 , 它不僅學習識別圖片中的物體比如貓和狗 , 還同時學習與這些圖片配對的文字描述 , 也就是說 CLIP 是在圖文并茂的環境中訓練出來的 。

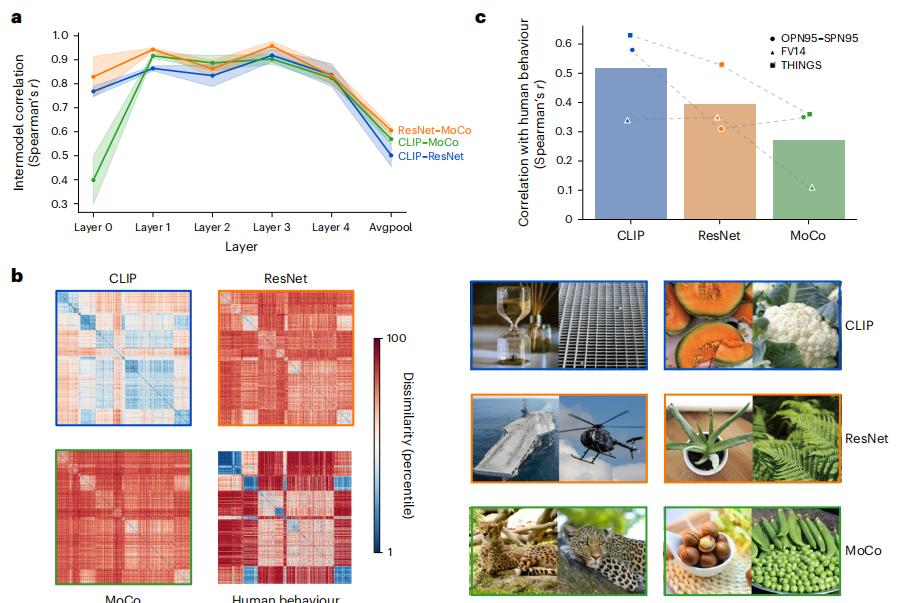

研究中 , 本次團隊將 CLIP 和 ResNet 以及 MoCo 這兩種模型進行的對比 。 ResNet 是一個只能學習給圖片打標簽比如貓或者狗的模型 , 是一個傳統的圖像分類模型;MoCo 是一個可以完全自學的模型 , 只需通過比較圖片之間的相似度即可完成學習 , 無需文字描述的幫助 。

他們讓這幾款模型去猜測人類大腦視覺皮層在看到圖片時的活動模式 。 結果發現 , 與另外兩種模型相比 , 引入句子描述的 CLIP 模型能額外解釋人腦視覺區域的神經響應 。 這種優勢在左腦更加明顯 , 而左腦正是人類語言功能的主要區域 。 這意味著 , 像 CLIP 這樣融合了語言訓練的 AI , 其內部處理信息的方式可能更加接近人腦 , 人腦在觀看東西的時候并非單純地照相 , 而是同步調用了語言知識和經驗來理解視覺信息 。

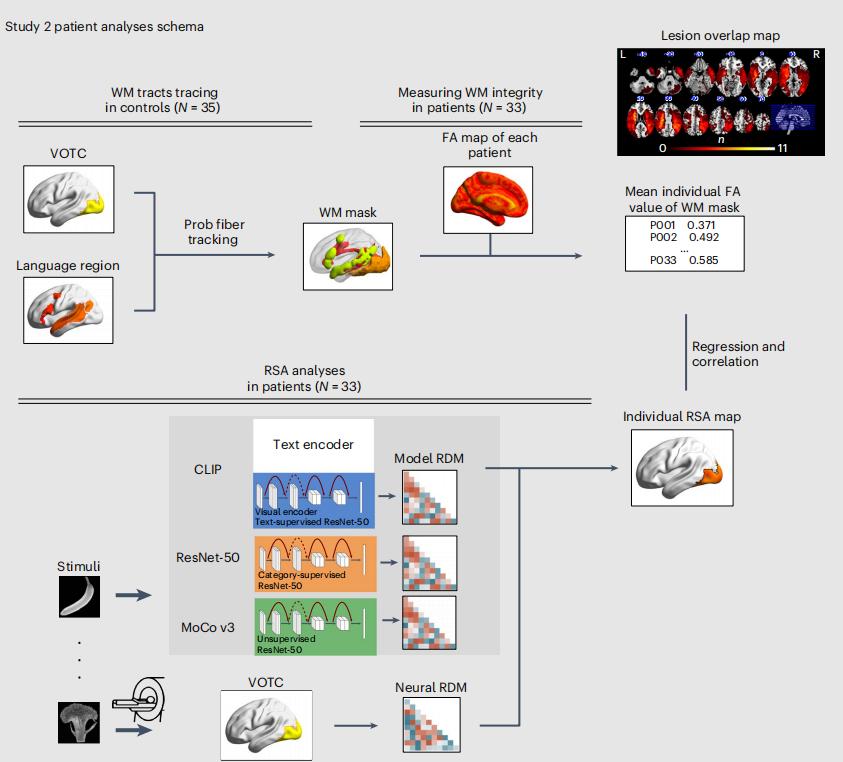

畢彥超表示 , 一般人很難理解自己的思維是如何工作的 , 因為我們接收的信息混雜 , 主觀感受不一定可靠 。 通過腦成像技術 , 學界過去二三十年可以直接觀測大腦;通過腦損傷病人 , 本次團隊則可以看系統一部分損壞后 , 其余功能是如何變化的;再借助像 CLIP 這樣的視覺-語言模型則可以剝離哪些是純視覺處理 , 哪些受到語言影響 。 這就形成了一個科學閉環:用 AI 解析人腦 , 再用人腦實驗驗證 AI 。

(來源:https://www.nature.com/articles/s41562-025-02357-5)

語言確實會影響視覺理解

朱毅鑫表示 , 關于語言與其他認知能力比如思維、視覺之間的關系 。 傳統上分為兩派:一派認為語言與視覺等認知功能完全獨立 , 語言可能是后期發展的 , 與思維并不耦合;另一派認為二者緊密相關 。 2025 年 , 《Nature》的一篇綜述代表了當前的主流共識:語言更多只是交流工具 , 而非影響我們如何看世界與思考問題的關鍵因素 。 我們的研究表明 , 這一認識可能需要被重新審視:語言可能正在影響我們的視覺理解 。 你如何看待事物、大腦如何處理視覺信息 , 實際上受到語言的調節 。 而本次研究則提供了相反的證據 , 證明語言確實會影響視覺理解 , 你如何看待事物、大腦如何處理視覺信息 , 實際上受到語言的調節 。

畢彥超則表示 , 從心理學研究者的視角來看 , 人們一直關注這樣一個本質問題:思維究竟受什么影響?語言是否影響思維?這既是心理學、哲學的核心問題 , 也具有廣泛的實際意義 。 如果語言深刻影響思維 , 那么我們如何更好地運用語言來促進思維發展?如何設計更智能的模型?這個問題的爭議很大 , 有人認為語言只是交流工具 , 有人則認為語言塑造了一切認知 。

(來源:https://www.nature.com/articles/s41562-025-02357-5)

本次團隊的優勢在于 , 可以通過實證方式即觀察大腦活動、結合行為實驗來回答這個問題 , 而不只是停留在思辨層面 。 談及研究過程 , 畢彥超回憶稱:“本次課題也是我和朱老師都關注基本科學問題 , 且持開放態度 。 ”

具體背景是:山西醫科大學的一位醫生此前在畢彥超這里讀博 , 他們一直認為腦損傷病人是研究人腦機制的重要手段 。 但要深入剝離語言與視覺在神經層面的交互 , 傳統方法受限 。 “我和朱老師一直保持交流 , 都意識到需要新方法 。 合作持續了三年多 , 中間也有過分析困難、數據復雜的階段 , 但通過耐心磨合 , 最終取得了突破 。 ”畢彥超表示 。

問到通過這次合作給自己帶來了怎樣的啟發 , 朱毅鑫表示首先要糾正一個誤區:AI 與心理學并非無關 。 AI 的核心算法比如反向傳播、強化學習大多源于認知科學領域的研究 。 AI 的初衷是模仿人類智能 。 “這次合作再次提示我們 , AI 與心理學本質同源 , 應更緊密地結合 。 對于領域來說 , 這是一個重要的觀念沖擊 。 ”他表示 。

畢彥超補充稱 , AI 對心理學不僅是工具 , 更是幫助我們外化、厘清人類認知機制的方式 。 心理學研究大腦如何產生心理過程 , 這本身就是一個計算過程 。 以前兩個學科關注點不同 , 科學語言也不同 , 現在時機成熟 , 應該更深入融合 。 這實際上是一種逆向工程人腦的過程 , 最終希望能制造出更接近人類智能的模型 。

(來源:https://www.nature.com/articles/s41562-025-02357-5)

談及未來計劃 , 畢彥超表示其和合作者計劃將這一框架拓展 , 系統研究語言在人類發展、智能成長過程中如何與視覺、運動系統交互 。 最終目標是理解人腦多模態整合的機制 , 并將其應用于機器人系統 , 實現真正意義上的具身智能 。 目前機器人運動笨拙 , 大模型無法與之有效結合 , 而人腦的語言-運動交互是無縫的 。 其希望揭示這種交互機制 , 推動機器人智能的發展 。

朱毅鑫則指出 , 從 AI 角度看 , 當前多模態研究缺乏機制理解 , 單純堆數據難以實現突破 。 人腦能夠從小樣本中快速學習 , 語言提供的抽象概念可能是關鍵 。 因此 , 他希望能夠探索人腦如何利用語言實現高效學習 , 并將這一機制用于 AI 訓練范式 , 實現小樣本下的復雜概念學習 。

參考資料:

相關論文 https://www.nature.com/articles/s41562-025-02357-5

運營/排版:何晨龍

推薦閱讀

- Anthropic研究人員繪制AI模型\人格地圖\以驅逐\惡魔\人設

- 那些說社交媒體“沒那么壞”的研究,可能有一半是他們自己人做的

- 把AI當作生命體研究后,科學家發現了它怪異的生物特性

- 機器人終于能用明白洗碗機了|UC伯克利新研究

- 研究人員揭露Reprompt攻擊:一鍵竊取微軟Copilot數據

- 雙屏顛覆辦公體驗,ROG幻16 雙屏攜第三代酷睿 Ultra重塑移動工作站

- 新研究:64%第三方應用無業務理由訪問敏感數據

- 終極3D集成,將顛覆未來的GPU

- 大模型長腦子了?研究發現LLM中層會自發模擬人腦進化

- 清華新研究,Nature+Science雙殺!