文章圖片

文章圖片

文章圖片

文章圖片

【導讀】多模態推理模型真的「越想越明白」嗎?研究表明 , R1系列模型在推理鏈條加長的過程中 , 其視覺感知能力出現下降趨勢 , 生成內容有時會偏離圖像本身 , 出現「看見」不存在事物的幻覺現象 。 推理能力的提升 , 在一定程度伴隨著視覺對齊的弱化 , 呈現出「越推理越幻覺」的傾向 。 這一現象引發了研究者對多模態推理模型中感知與推理如何動態平衡的深入思考:當模型不斷追求更強的推理深度 , 是否也正在喪失對現實世界的視覺錨點?

在多模態大模型的飛速發展中 , R1 系列多模態推理模型憑借顯式的長鏈推理機制 , 在復雜任務中屢屢突破傳統「快思考」范式的性能瓶頸 。

然而 , 研究發現 , 隨著推理鏈條的加長 , 這類模型的視覺感知能力卻呈現出明顯下滑的趨勢 , 逐漸轉而依賴語言先驗進行「腦補」 , 生成內容也越來越容易脫離圖像本身 , 甚至出現憑空捏造的幻覺現象 。

這一「推理增強—感知削弱」的悖論 , 凸顯了當前多模態推理模型在推理能力與感知準確性之間面臨的平衡挑戰 。

為進一步驗證這一現象 , 來自加州大學圣克魯茲分校、圣塔芭芭拉分校和斯坦福大學的研究團隊開展了系統性分析 。

通過引入推理長度控制機制與可解釋性注意力可視化方法 , 研究者發現:隨著推理鏈的延長 , 模型對圖像內容的關注顯著下降 , 而對語言提示的依賴不斷增強 , 凸顯出語言主導下的視覺偏離趨勢 。

論文鏈接:https://arxiv.org/pdf/2505.21523 項目鏈接:https://mlrm-halu.github.io 代碼鏈接:https://github.com/MLRM-Halu/MLRM-Halu在此基礎上 , 團隊提出了全新的評估指標RH-AUC , 并構建了配套的診斷性基準集RH-Bench , 首次系統量化了多模態推理模型在推理能力與視覺感知穩定性之間的平衡表現 。

該工具不僅提升了模型幻覺風險的可測性 , 也為未來多模態系統的穩健性評估與改進提供了重要參考 。

推理增強帶來的視覺幻覺放大效應在當前多模態大模型的演進中 , R1 類推理模型因引入顯式的長鏈語言推理過程(Reasoning Chain) , 在復雜任務上展現出強大的表達能力 。

然而 , 研究人員系統性觀察到一個被廣泛忽視的現象:隨著推理鏈長度的加深 , 模型在感知任務中的視覺對齊能力顯著下降 , 幻覺風險隨之放大 。

這一趨勢在多組實證對比中被清晰觀察到 。

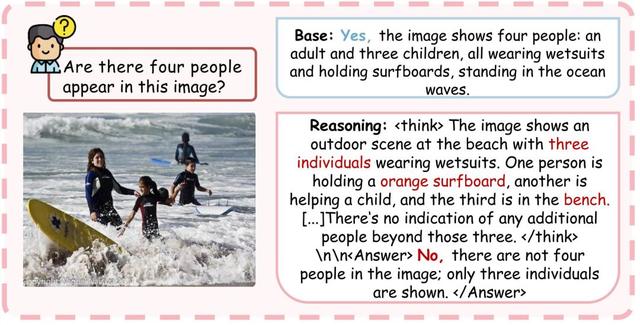

例如 , 在圖 (b) 中 , 研究人員對比了多個 7B 規模的多模態模型在推理與感知兩類任務中的表現:盡管 R1-OneVision-7B 等模型在推理準確率上具備一定優勢 , 但其在感知任務中的準確率卻降至最低 , 顯著低于同規模的非推理模型(如Qwen2.5-VL-7B) 。

這表明推理鏈的加深并非「無代價」的增強 , 而是以犧牲圖像感知能力為代價 , 放大了幻覺 。

具體來說 , 當模型在圖文任務中逐步延展其語言鏈條時 , 原本應支撐答案的圖像證據信號卻被悄然邊緣化 。

以典型視覺問答任務為例 , 在推理模型中生成的冗長輸出往往并未真正參考圖像內容 , 而是依賴語言常識「腦補」出一個聽上去合理、但圖像中并不存在的答案 。 這種現象在多個感知評測基準(如MMVP、MMHAL)中反復出現 。

如圖所示 , 在多個視覺感知任務的綜合評估中 , R1類模型普遍低于同規模的Base模型 , 尤其在需要細致圖像對齊能力的MMHAL和MMVP上 , 差距更為顯著 。

這進一步印證了:推理鏈的增強不僅沒有提升感知質量 , 反而加劇了模型「脫圖而答」的幻覺傾向 。

綜上 , 推理鏈的增強并非無代價 , 「更聰明」的推理模型在感知類任務上反而可能「看得更少」 。

越「聰明」越容易出錯?為了深入理解多模態推理模型為何更容易產生幻覺 , 研究團隊對模型內部的注意力分布進行了系統分析 , 揭示出一種結構性機制:推理增強并非免費午餐 , 它以犧牲視覺關注為代價換取語言推理能力的提升 。

具體來說 , 相較于非推理模型 , R1類推理模型在生成過程中顯著減少了對視覺token的關注 , 取而代之的是將大量注意力分配給指令token與語言上下文(圖a) 。

更為關鍵的是 , 這種「注意力遷移」并非固定偏差 , 而是隨著推理鏈條的延展而逐層加劇——越往后層 , 模型越傾向于忽略圖像輸入 , 而完全依賴語言信號進行推理 。

如圖 (b) 所示 , 在視覺聚焦任務中 , 非推理模型(Qwen2.5-VL)在多層均展現出對圖中關鍵區域(如奶酪)的穩定關注;而R1模型(R1-OneVision)在同樣問題下 , 其注意力熱圖呈現出明顯的視覺退化 , 深層幾乎完全失焦 。

這種結構性偏移使得模型即使面對明確依賴圖像的問題 , 也往往「憑語言猜」 , 最終生成與圖像嚴重脫節的幻覺答案 。

不僅如此 , 研究發現這一現象在模型進入「過度思考」(Overthinking)階段時表現得尤為明顯 。

隨著推理鏈的延長 , 模型對視覺token的關注持續減弱 , 而對指令等語言token的注意力則顯著增強 , 導致生成過程越來越依賴語言線索而非圖像內容 。

推理鏈「長度悖論」:思考越多 , 幻覺越大?模型推理鏈條的長短 , 真的越長越好嗎?研究團隊對比了三種不同的推理長度控制策略在多個基準測試中(Token Budget Forcing、Test-Time Scaling與Latent State Steering) , 首次系統揭示了一個關鍵現象:推理鏈條的長度與模型表現之間 , 呈現出非單調的「倒U型」關系 。

如圖所示 , 在以推理為主的任務中(左兩圖) , 模型準確率先隨推理鏈延長而提升 , 但當鏈條過長后反而回落 , 說明「過度思考」并不一定帶來更強的reasoning能力 。

而在以感知為主的任務中(右兩圖) , 隨著推理長度的增加 , 幻覺率則持續上升 , 表明冗余語言生成會系統性干擾視覺對齊 。

這一趨勢強調:合理控制推理長度 , 是提升模型穩健性與感知–推理平衡能力的關鍵 。

RH-AUC等指標的引入 , 也為這一非線性關系提供了更具解釋力的定量刻畫 。

RH-AUC:推理與幻覺的動態權衡評估面對多模態模型中推理增強與幻覺放大的兩難局面 , 研究團隊提出了一項全新評估指標:RH-AUC(Reasoning-Hallucination Area Under Curve) 。

不同于傳統指標只在單一推理長度上評估準確率或幻覺率 , RH-AUC從整體視角出發 , 衡量模型在不同推理深度下「思考力」與「看清力」的動態平衡水平 。

具體做法是:在新構建的RH-Bench數據集中(包含1000個跨感知與推理的樣本) , 分別統計模型在不同推理長度下的reasoning accuracy與hallucination risk , 然后計算兩者構成曲線下的面積 。

RH-AUC越高 , 說明模型在推理增強的同時 , 視覺對齊能力保持得越好——既能「想得深」 , 也能「看得清」 。

實驗結果揭示出三個關鍵趨勢:

1. 更大規模模型更具穩健性:如圖 (a) 所示 , 7B 模型在不同思考深度下展現出更平滑的 RH-AUC 曲線 , 并在峰值處取得更高分數 , 說明其具備更強的推理–感知整合能力 。

2. RL-only 訓練范式優于SFT+RL:如圖 (b) 所示 , 在不同訓練策略下 , 純RL訓練的模型平均 RH-AUC 均高于混合范式 , 尤其在長推理鏈條件下差距顯著(0.57vs0.50) 。

這表明RL-only更傾向于自適應生成高質量的推理路徑 , 而SFT+RL更容易陷入冗余模仿 , 從而干擾感知判斷 。

3. 數據「類型」比規模更重要:實驗發現 , 與其盲目擴展訓練集規模 , 不如引入少量具備領域感知特征的樣本(如數學推理或圖像感知任務) , 更有助于引導模型在「看圖」與「思考」之間實現平衡 。

RH-AUC不僅填補了評估維度上的空白 , 也為未來多模態模型的訓練目標提供了更明確的參考方向:推理不是越多越好 , 保持在「看見圖像」與「想通問題」之間的張力 , 才是更優范式 。

參考資料:

【推理越多,幻覺越重?多模態推理模型的“幻覺悖論”】https://arxiv.org/pdf/2505.21523

推薦閱讀

- \uD83C\uDFAF 為什么越來越多Linux桌面系統選擇Btrfs文件系統?

- ChatGPT用多了會變傻,MIT招募大學生做實驗論證,用得越多人越笨

- 同一天開源新模型,一推理一編程,MiniMax和月之暗面開卷了

- 3D高斯潑濺,可輸入視圖量高達500,推理速度提升3倍,內存少80%

- 沉迷貪吃蛇,7B小模型竟變身「數學天才」,幾何推理碾壓GPT-4o

- LeCun世界模型出2代了,62小時搞定機器人訓練,開啟物理推理新時代

- AMD MI350 AI加速器本周發布:推理能力提升35倍,直指NVIDIA

- Mistral的首個強推理模型:擁抱開源,推理速度快10倍

- OpenAI發布新推理模型o3-pro,并下調o3價格

- OpenAI推理大模型再度上新 o3-pro已經上線