文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

誰說擴散模型只能生成圖像和視頻?

現在它們能高質量地寫代碼了 , 速度還比傳統大模型更快!

Inception Labs推出基于擴散技術的全新商業級大語言模型——Mercury 。

Mercury突破了自回歸模型 “從左到右” 逐詞生成的限制 , 采用 “從噪聲到結構化輸出” 的方式 , 能一次性預測所有方向的token , 提高了生成速度 。

這樣一來 , Mercury還解決了自回歸“一旦生成難以回頭調整”的問題 。

擴散模型并不是僅考慮前面已經生成的內容 , 它能在生成過程中進行動態糾錯修改 , 具有更大的靈活性 。

盡管采用了擴散技術 , Mercury模型系列仍保留了Transformer架構 。

這確保了該模型能直接復用近年來為大語言模型開發的高效訓練、推理優化技術(如低階算子優化、超參數調優工具等) 。

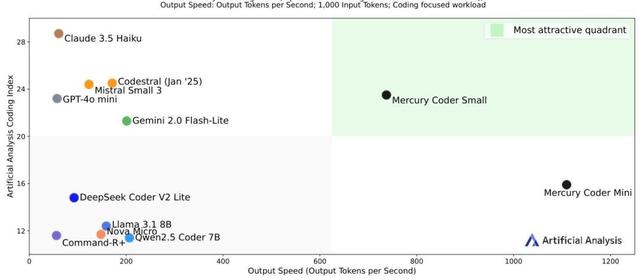

實測數據顯示 , 面對相同的編程任務 , Mercury的代碼生成速度比傳統工具最多快10倍 , 大幅縮短了開發周期 。

在H100 GPU上實現1109 tokens/秒吞吐量Mercury用成熟的Transformer作為神經網絡基礎 , 結合擴散技術的并行生成能力 , 既保留了大模型的兼容性 , 又突破了自回歸模型逐詞生成的速度限制 。

擴散生成流程Mercury的核心創新在于 “擴散式生成” , 流程如下:

訓練階段的正向過程:從真實文本(如代碼片段)出發 , 逐步加入噪聲(隨機替換、刪除token等) , 最終變成完全隨機的噪聲序列 。

推理階段的反向過程(核心):從隨機噪聲開始 , 通過Transformer模型迭代優化 , 逐步去除噪聲 , 最終生成符合真實分布的文本 。 每次迭代中 , 模型會并行修改多個token , 而非逐詞生成 。

這一過程擴展了此前的離散擴散方法 , 通過優化數據處理和計算邏輯 , 實現了大規模訓練(萬億級token) 。

高效利用硬件Mercury主要通過并行化文本生成、動態去噪調度、混合精度量化等技術 , 極致發揮GPU性能 , 實現對硬件的高效利用 , 降低訓練和推理成本 。

并行化文本生成擴散機制允許模型在單次前向傳播中預測多個token , 相較于自回歸模型的“從左到右”逐詞生成 , 顯著提升了GPU利用率 。

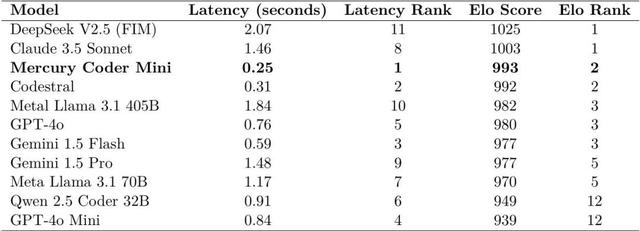

在NVIDIA H100 GPU上 , Mercury Coder Mini和Mercury Coder Small(Mercury Coder系列編碼優化產品)分別實現了1109 tokens/秒和737 tokens/秒的吞吐量 。

在Copilot Arena的基準測試中 , 可將響應時間壓縮至其他工具的1/4 , 同時硬件資源占用減少60% 。

動態去噪調度算法Mercury通過自適應調整去噪步數 , 在簡單任務中減少計算量 , 在復雜任務中保留足夠迭代次數 , 實現精度與效率的平衡 , 從而更高效地利用硬件資源 , 避免不必要的計算開銷 。

混合精度量化技術模型在推理時可自動切換至低精度計算模式 , 內存占用減少30% , 同時通過殘差補償機制維持輸出質量 。 這讓Mercury能在有限的硬件內存條件下運行 , 且不明顯影響性能 。

強大的錯誤糾正能力與傳統自回歸模型 “從左到右” 逐詞生成 , 一旦生成難以回頭調整不同 , Mercury不受限于僅考慮前面已生成的內容 , 能夠在生成過程中動態修改之前的內容 , 具有更大的靈活性 。

雙向注意力機制Mercury在去噪過程中引入上下文雙向關聯 , 能夠更好地理解文本的前后語境 , 從而更準確地發現和糾正錯誤 。

實時糾錯模塊模型在去噪步驟中會同步檢測代碼邏輯漏洞 , 通過強化學習動態修正輸出 。 在代碼生成任務中 , Mercury Coder可以自動修正邏輯漏洞 , 還支持函數級參數自動校正 , 能有效提高代碼的準確性和可用性 。

多語言語法樹嵌入Mercury將Python、Java等語言的抽象語法樹(AST)結構融入擴散過程 , 有助于減少語法錯誤 。

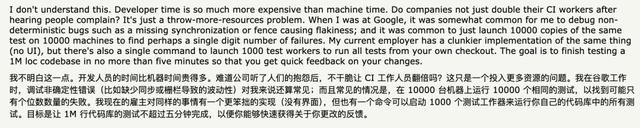

超快響應速度與當前CI能力不匹配在LLMs出現之前 , 持續集成/交付(CI/CD)的速度就已經成為一個主要瓶頸 , 這導致開發人員在測試時把時間浪費在等待拉取請求(PRs)上 。

有時 , 一個更改操作需要在隊列中等待數小時 , 甚至有時會因為不穩定需要重新開始 。

Mercury模型在編寫代碼方面實現了超高速響應 , 但如果每次代碼更改都需要數小時進行測試 , 那么就像這位網友提出的問題一樣:

即使大模型能夠以比人類快100倍的速度寫代碼 , 但測試速度跟不上的話 , 這將沒有什么意義 。

于是問題來了:

如何緩解超快響應速度與當前CI能力不匹配的問題?

一些人認為因為開發人員時間比機器時間昂貴得多 , 所以可以通過簡單地“投入更多機器”來解決CI速度問題 。

然而 , 也有另一些人指出 , 這對于谷歌等“印鈔機”公司可能可行 , 但對于普通公司來說 , CI預算是固定的 , 增加計算資源并不是一件容易的事情 。

Inception Labs團隊Mercury的開發方Inception Labs的三位聯合創始人是來自斯坦福、UCLA和康奈爾大學的計算機教授 。

其中 , Stefano Ermon是擴散模型的共同發明人 , 他與Sohl-Dickstein等學者共同構建了擴散模型的理論基礎 , 并通過后續研究推動了模型的實用化 。

另一位創始人Aditya Grover曾在Meta FAIR擔任研究科學家 。

攻讀博士學位期間 , 他先后在谷歌DeepMind、微軟研究院和OpenAI實習 。

Volodymyr Kuleshov曾在2018年獲得Arthur Samuel最佳論文獎 。

該團隊包括來自Google DeepMind、微軟、Meta、OpenAI和NVIDIA的資深人士 , 目前正專注于用擴散技術改進大模型性能 。

Inception Labs還開放了Mercury模型的在線體驗平臺 。

感興趣的朋友可點擊下方鏈接體驗~

論文地址:https://arxiv.org/abs/2506.17298Mercury在線體驗平臺:https://chat.inceptionlabs.ai/

【擴散語言模型寫代碼,速度比自回歸快10倍】參考鏈接:https://news.ycombinator.com/item?id=44489690

推薦閱讀

- Meta挖走蘋果AI模型高管代價高昂 消息稱總薪酬超過2億美元

- AI裝智能升級插件,阿里安全-清華大學D-MoLE讓模型在學習中進化

- 從0構建大型AI推薦系統:排序模型產品化的關鍵環節

- 大模型“越用越快”,SpeedupLLM首次驗證,大降56%推理預算

- 世界模型也被潑冷水了?邢波等人揭開五大「硬傷」,提出新范式

- DeepSeek流量暴跌?AI大模型全球霸主離奇遇冷,外媒曝出真相

- 蘋果大模型團隊負責人叛逃Meta,華人AI巨星+1,年薪飆至9位數

- 天融信WAAP助力應用安全升級,護航大模型應用落地

- KAG-Thinker:結構化思考新范式,支持邏輯嚴謹的大模型復雜推理

- AI大模型優化公司哪家好?