文章圖片

文章圖片

本文由半導體產業縱橫(ID:ICVIEWS)編譯自the next platform

【新舊GPU對決:Blackwell憑啥更能打?】

AWS Blackwell GPU性價比解析 。

本周 , 亞馬遜網絡服務宣布推出其首款基于Nvidia的“Grace”CG100 CPU和“Blackwell”B200 GPU的UltraServer預配置超級計算機 , 稱為GB200 NVL72共享GPU內存配置 。 這些機器被稱為U-P6e實例 , 實際上有全機架和半機架配置 , 它們補充了去年12月在re:Invent 2024會議上推出的現有P6-B200實例 。

在P6和P6e實例的情況下 , GPU和NVLink Switch 4 GPU內存共享交換機上的NVLink 5端口用于將GPU組整合到大型共享內存計算復合體中 , 類似于CPU服務器存在了25多年的NUMA集群 。 其他非NUMA共享內存架構比非統一內存訪問技術更古老 , 如對稱多處理或SMP , 但沒有像NUMA在CPU上的擴展 , 在單核處理器時代 , NUMA在共享內存集群中推到了128和256個CPU 。

基于Nvidia NVL72設計的P6e實例 , 我們在這里詳細介紹了這些設計 , GPU內存域橫跨72個GPU插槽 , Blackwell芯片每個插槽有兩個GPU芯片 , 因此內存域實際上是單個機架中的144個設備 。 AWS正在銷售具有72或36個Blackwell B200插槽的UltraServers作為內存域 , 估計這是虛擬完成的 , 而不是物理完成的 , 因此可以即時配置實例大小 。 這些機器每兩個Blackwell B200 GPU配對一個Grace CPU , 整個shebang是液冷的 , 這也是B200 GPU超頻11%的原因之一 , 并為人工智能工作負載提供更多的原始計算性能 。

P6實例使用更標準的HGX-B200服務器節點 , 這些節點沒有超頻 , 并創建了一個跨越八個套接字的GPU內存域 。 P6實例使用英特爾至強6處理器作為其主機計算引擎 , 每八個Blackwell B200 GPU有兩個CPU , 產生的計算復合體密度是GB200 NVL72系統的一半 , 因此仍然可以風冷 。

隨著這兩個Blackwell系統現在在AWS云上可用 , 并且價格信息可用 , 現在是對Blackwell實例進行一些價格/性能分析的最佳時機 , 與前幾代“Hopper”H100和H200 GPU以及基于“Ampere”A100和“Volta”V100 GPU的早期實例進行一些價格/性能分析 , 這些實例仍然可以在AWS云上租用 。

我們檢查的實例和UltraServer機架規模配置是在AWS所謂的EC2容量塊下出售的 , 顧名思義 , 這是預訂和購買預配置的UltraClusters的一種方式 , 其大小從一個實例或UltraServer到多達64個實例或機架 , 期限長達六個月 , 最多在您需要容量的八周前 。 這是一個預留實例的時髦版本 , 以更大的塊狀形式作為單個單元出售 。

只是為了好玩 , 我們采取了EC2容量塊配置 , 還找到了按需定價的設置 , 看看這些在成本上如何比較 , 一直到基于Nvidia Volta GPU的P2實例和基于Ampere GPU的P3實例 。

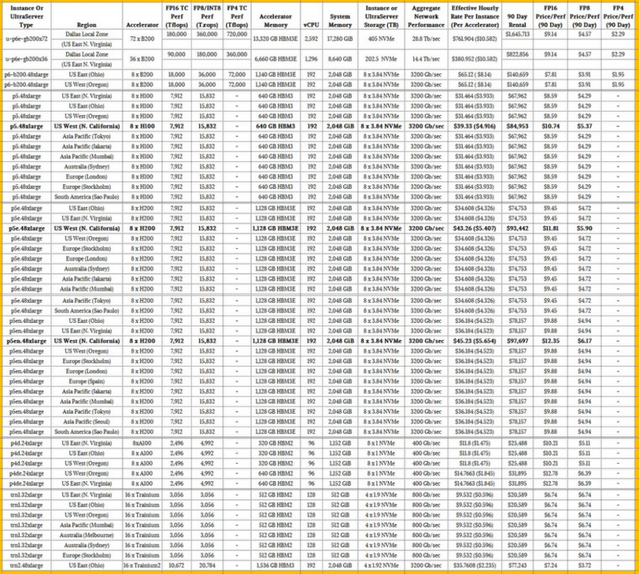

因此 , 未來不假說 , 這是EC2容量塊的所有電子表格的母體 , 價格顯示在全球可用的地區 , 包括Nvidia GPU實例以及AWS Trainium1和Trainium2實例:

那里有很多東西需要接受 。 為了了解價格/性能是如何疊加的 , 我們添加了FP16、FP8或INT8和FP4精度的峰值理論性能 。 為了進行比較 , 我們忽略了FP64和FP32精度 , 充分意識到有時更高的精度計算用于人工智能模型 , 當然也用于HPC模擬 。 這些性能評級適用于密集數學 , 而不是稀疏矩陣 , 這可以使設備的有效數值吞吐量翻倍 。

我們決定 , 90天的租賃代表了訓練一個相當大的模型需要什么 , 但沒什么瘋狂的 。 這種實例成本的規模產生了一個很好的紅利 , 其中除數將它切成太浮點運算的性能 。

很多東西都跳出這個怪物表 , 但我們看到的第一個 , 我們用粗體強調的是 , AWS對基于美國西北加州地區提供的Hopper H100和H200 GPU的GPU實例收取25%的溢價 。 在硅谷很難獲得電力和數據中心空間 , 這就是為什么你看到美國西部地區的俄勒岡州地區安裝了這么多新設備 。 美國東部地區錨定在弗吉尼亞州阿什本周圍 , 它仍然首先獲得許多好東西 , 包括基于GB200 NVL72設計的UltraServer P6e機架系統 。 正如你所看到的 , 俄亥俄州的美國東部地區也獲得了新東西的份額 , 包括Trainium1和Trainium2集群 。

我們認為FP16性能是人工智能加速器的基線 , 然后FP8和FP4精度是模型的重要進一步加速器 , 這些模型可以使用較低分辨率的數據進行訓練 , 并且仍然不會犧牲模型的準確性 。

如果你看一下機架式GB200 NVL72系統的FP16性能與HGX-B200系統相比 , 后者的擴展幅度沒有那么大 , 機架式機——需要液體冷卻 , 安裝有點像野獸——與AWS租用的方式相比 , 單位性能僅提高了17% 。 這其實并不是什么溢價 , 考慮到系統的密度以及GB200 NVL72的密度導致的電源和冷卻問題 , 這符合您的預期 。

您將看到的另一件事是 , H100和H200設備具有相同的峰值理論性能 , 但AWS安裝的H100是較早的 , 只有80 GB的HBM3容量 , 而H200具有141 GB的HBM3容量 。 AWS正在為該內存和附帶的更高帶寬收取10%的溢價 。 帶有80 GB HBM3的H100帶寬為3.35 TB/秒 , 而帶有141 GB HBM3E的H200提供4.8 TB/秒的帶寬 。 對于許多工作負載 , 這種額外的內存容量和帶寬幾乎可以使人工智能培訓的實際性能增加一倍 。 您可能期望AWS對H200實例收取比它更多的溢價 。

EC2容量塊仍然可以使用Ampere A100 GPU加速器獲得 , 有趣的是 , 按GPU計算 , H200比A100貴3.07倍 , 但它每個GPU的FP16性能高3.17倍 。 當你計算時 , 通過容量塊租用具有40GB HBM2內存的A100 90天 , 每兆浮點運算的成本為10.21美元 , 而H100的每兆浮點運算成本為9.88美元 。 只有當你無法獲得H100s、H200s或B200s時 , 你才會這樣做 。 帶有80GB HBM2內存的A100每TBflops售價為12.78美元 。 (所有這些價格都適用于北加州以外的地區 。 )

在FP16精度下 , P6e實例中的全尺寸NVL72機器 , 配有72個Blackwell B200 GPU , 以及帶有36個Blackwell B200的半機架 , 每兆浮點運算成本為9.14美元 , 租金為90天 , 這三個月將分別花費165萬美元和822856美元 。 具有較小內存域的P6-B200實例在FP16精度下 , 在90天內每兆浮點運算花費7.81美元 , 鑒于這些實例是空氣冷卻的 , 內存域較小 , 這是有道理的 。 神奇的是 , 液冷GB200 NVL72機器的價格并不高 。

如果你看一下FP8的性能 , 每太浮點運算的所有成本都減半了 , 而Blackwells , 以FP4格式計算的能力將一億浮點運算的成本再次減半 。 最終結果是 , 如果您更改模型以利用FP4性能 , 您可以租用四分之一的機器以四分之一的成本完成相同的工作 , 或者您可以花費相同的錢來訓練一個大四倍的模型 。

現在看看桌子的底部和Trainium 。 在原始FP16吞吐量方面 , 需要兩倍于AWS設計的Trainium1人工智能加速器才能擊敗Nvidia A100約22% 。 使用Trainium2 , FP16的性能提高了3.5倍 , FP8的性能提高了6.8倍 , 而HBM容量提高了3倍 , 但在FP16分辨率下 , 每兆浮點運算的成本僅提高了7.4% 。 增加FP8將FP8精度的太浮點運算的價格降低到僅3.72美元 , 這低于AWS租用的HGX-B200節點作為P6實例的每兆浮點運算3.91美元 , 甚至低于AWS為GB200 NVL72實例收取的每兆浮點運算4.57美元 。 Trainium2不支持FP4 , 這意味著在原始成本方面 , Nvidia對那些可以以FP4分辨率運行且不會失去準確性的人工智能應用程序具有優勢 。

現在 , 如果您查看AWS上的按需定價 , Trainium1芯片仍然可用 , 而且它們比按需租用的Blackwell B200實例要貴得多 。 看一看:

本表中顯而易見的是 , 基于K40、V100和A100 GPU的古代加速器實例成本非常低 , 因此資本支出非常低 , 這看起來很有吸引力 , 但如果你看一下FP16 ooph的太浮點運算成本 , 這些在經濟意義上是可怕的 , 并且與EC2容量塊計劃下出售的新鐵的差距要大得多 。 如果您將這些在FP16模式下運行的古老GPU與在FP4模式下運行的Blackwells進行比較 , 除了在絕對緊急情況下 , 否則考慮使用這種舊的熨斗是徹頭徹尾的愚蠢 。

顯然 , 如果您需要按需租用實例 , 請租用Blackwells并在FP4模式下運行 。 如果你這樣做 , FP16性能的成本會降低9% , 通過精密兩檔的降檔 , 你可以將性能提高4倍 , 將性價比提高4.4倍 。

摩爾定律只有在縮小精度的幌子下才真正存在 , 而不是在縮小晶體管的幌子上 。 FP2有人嗎?正如一些人所說 , FP1中沒有意義 。

*聲明:本文系原作者創作 。 文章內容系其個人觀點 , 我方轉載僅為分享與討論 , 不代表我方贊成或認同 , 如有異議 , 請聯系后臺 。

想要獲取半導體產業的前沿洞見、技術速遞、趨勢解析 , 關注我們!

推薦閱讀

- 英偉達慌不慌?華為AI芯片方案,要從ASIC轉向GPGPU了

- 華為Mate 80 GPU性能暴漲100% 影像系統再造「折疊光路」

- 小米15對決vivo X200 Pro mini,小屏旗艦誰更香?

- 藍牙音箱哪個牌子的好?西圣和雷登藍牙音箱雙強對決揭曉!

- 馬斯克20萬GPU訓出史上最聰明AI,Grok 4重返地球之巔,人類博士全線潰敗

- 從CPU,到GPU,到Soc,中國已有自主研發的高性能芯片了

- Imagination回應GPU部門被中芯收購:不實消息 純屬虛構

- 口碑又要崩了?小米回應路由器偷偷減配:新舊產品性能一致

- 藍牙音箱哪個牌子音質最好?10大藍牙音箱測評巔峰對決,新手必看

- 剛剛,Ilya官宣出任SSI CEO,送走“叛徒”聯創,豪言不缺GPU