文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

【模仿學習新范式,Chain-of-Action:軌跡自回歸實現動作推理】

- 論文標題:Chain-of-Action: Trajectory Autoregressive Modeling for Robotic Manipulation

- 主頁鏈接:https://chain-of-action.github.io/

- 文章鏈接:https://arxiv.org/pdf/2506.09990

- 代碼鏈接:https://github.com/ByteDance-Seed/Chain-of-Action

具身智能(Embodied AI)作為人工智能領域的前沿方向 , 旨在賦予機器人或智能體在物理世界中感知、決策和行動的能力 。 近年來 , 盡管視覺 - 語言 - 動作模型(Vision Language Action VLA)已經取得了諸多進展 , 但具身智能領域尚未迎來 「GPT 時刻」 。 越來越多的研究人員開始相信 , 僅僅增加模型規模和數據量似乎不足以創造出通用操作模型 , 如果我們想要充分釋放現有數據的潛力 , 就需要找到更有效的機器人操作建模方法 。

來自字節跳動 Seed & 阿德萊德大學的研究者追根溯源 , 對模仿學習的基本范式進行了反思 , 發現現有建模思路或許存在缺陷:經典方法如 ACT、Diffusion Policy(DP)都遵循 「前向預測」(forward-prediction)范式 。 而然這種方式不可避免地存在較大的復合誤差(compounding error) 。

在該范式下 , 策略通常被優化為基于當前觀察預測短期的下一步動作 , 而非確保最終能夠成功完成整個任務 。 雖然引入了動作分塊(action chunking)等策略來緩解復合誤差 , 但無法解決其固有的 「短視性」問題 。

基于該局限 , 研究者提出了 「動作鏈」(Chain-of-Action CoA)—— 一種基于軌跡自回歸的機器人操作策略 。 與經典范式區分 , CoA 并不直接由觀察映射到執行動作 , 而是由從最終位置反向自回歸的生成軌跡點 , 推理出可執行的動作 。 研究團隊初步發現 , 僅僅通過修改建模方式 , CoA 在與 ACT 保持相同的基本結構下 , 空間泛化能力顯著提升 。 這種建模方式為具身操作策略的建模提供了新的思路 。

動作鏈:基于軌跡自回歸建模的

機器人操作策略

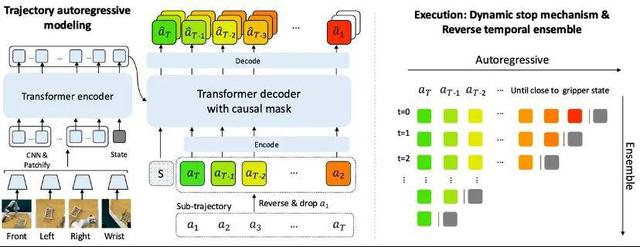

核心思想:受到思維鏈(Chain-of-Thought)的啟發 , CoA 并不直接由觀察映射到執行動作 , 而是在動作層面進行迭代式的推理 。 具體來說 , CoA 逆向的生成針對目標任務的完整軌跡 , 這個生成過程統一在一個自回歸網絡下 。 自回歸過程從 「關鍵幀動作」(keyframe action)開始 , 迭代地生成一連串完整的動作軌跡 , 直至當前的機器人夾爪的位置 。

全局到局部一致性:這種 「從后往前」 的生成方式 , 為整個動作序列提供了的 「全局 - 局部」(global-to-local)結構性約束 。 因為每個后續生成的動作都以代表最終目標的 「關鍵幀」 為條件 , 所以最后執行的動作將會被最終目標所 「錨定」 , 空間泛化能力顯著得到增強 。

統一的自回歸框架:CoA 將關鍵幀的識別和軌跡的生成統一在單一的自回歸模型中 , 實現了端到端的訓練和高效的閉環執行 , 并保持了可擴展(scalable)的潛力 。

關鍵設計

為了實現軌跡自回歸的想法 , CoA 引入了四個關鍵設計:

連續動作表征(Continuous Action Representation):離散化的動作表征會引入量化誤差 , 為保證軌跡的精細度 , CoA 采用了連續的動作表征并引入了 「潛在一致性損失」(Latent consistency loss) 。

動態停止機制(Dynamic Stopping):在連續動作空間中 , 沒有傳統的中止符(EOS token)來指示序列的結束 。 因此 , CoA 設計了一種基于距離的動態停止機制 , 實現可變長度(variable length)的軌跡預測 。

反向時間集成(Reverse Temporal Ensemble):傳統的時序集成策略基于前向時間假設 , 不適用于 CoA 的反向生成模式 。 CoA 通過反向時序集成 , 進一步提高預測的穩定性 。

多詞元預測(Multi-token Prediction MTP):動作局部依賴關系的建模可作為 「全局 - 局部」 一致性的補充 。 此設計僅在訓練階段作為正則化手段使用 , 在推理時移除 , 保證了效率 。

實驗驗證

模擬環境測試

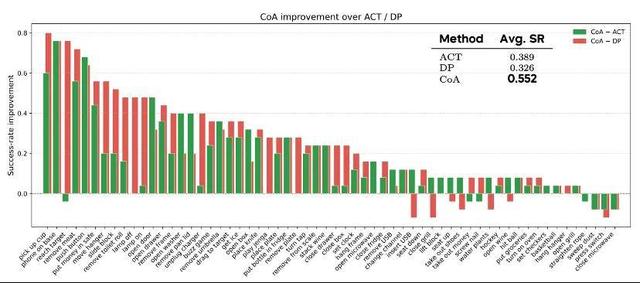

大幅超越基線:在涵蓋 60 個任務的 RLBench 大規模擬基準測試中 , CoA 的平均成功率達到了 55.2% , 顯著優于 ACT(38.9%)和 DP(32.6%) 。 相較于 ACT , CoA 在 81.7% 的任務中取得了更高的成功率 , 平均提升了 16.3% 。 相較于 DP , CoA 在 80.0% 的任務上表現更優 , 平均提升為 23.2% 。

相關性分析:所有方法的成功率都隨著物體空間分布方差的增大而下降 , 但 CoA 的下降趨勢更為平緩 , 且其性能優勢在高方差(更困難)的任務中更為明顯 。

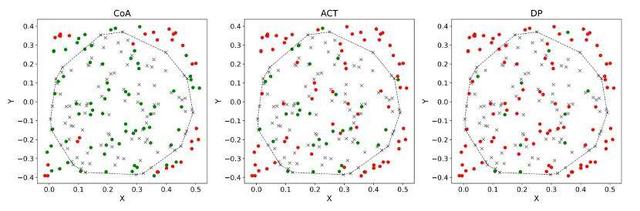

空間泛化能力分析:研究者對泛化性進行了更細致的觀察 。 以按按鈕任務為案例 , 分別測試了 「內插」(in-distribution)和 「外推」(out-of-distribution)情況下各個模型的表現 , 結果顯示 , CoA 在外推場景下成功率約為內插情況下的一半 , 但對于 ACT 和 DP , 外推任務幾乎不能完成 , 這一定程度揭示了兩種建模范式在空間泛化表現上的根本差異 。

真實世界實驗

研究者在一臺 Fetch 機器人上 , 圍繞 8 項廚房任務進行了部署和測試 。 觀察來自單個 RGB 攝像頭 , 策略以 10Hz 的頻率運行 , 每個任務測試 10 次 。 實驗結果顯示 CoA 取得了 61.3% 的平均成功率 , ACT 成功率為 46.3% , DP 的成功率 36.3% 。 這驗證了 CoA 建模范式在真實世界中的可用性 。

結論與展望

Chain-of-Action 提出了一種新穎的模仿學習范式 , 其核心是軌跡自回歸建模 。 通過從一個代表任務目標的 「關鍵幀」開始 , 逆向生成動作序列 , 該方法為軌跡施加了一個強大的 「全局 - 局部」 結構約束 , 從而有效解決累計誤差問題 , 提升機器人操作泛化性 。 全面的實驗結果證明 , 在沒有更多數據和增大模型規模的情況下 , 其在空間泛化能力相比傳統范式取得顯著提升 。 這說明一個合理的建模范式可以有效的釋放現有數據的潛力 。 CoA 有望為未來一代的 VLA 模型提供新的建模思路 。

推薦閱讀

- 學習電影《碟中諜》?十銓推出可自毀固態硬盤

- Karpathy戳破強化學習神話,首提AI復盤式進化,暴力試錯將死

- 友商紛紛跟進!小米帶火Turbo,王騰:領先的一種體現就是被模仿

- AI全景虛擬屏重塑移動辦公新范式 移動辦公該買哪款大折疊手機?

- AI裝智能升級插件,阿里安全-清華大學D-MoLE讓模型在學習中進化

- 世界模型也被潑冷水了?邢波等人揭開五大「硬傷」,提出新范式

- KAG-Thinker:結構化思考新范式,支持邏輯嚴謹的大模型復雜推理

- 小米16提前1個多月發布!4年前向蘋果學習,今年要硬剛蘋果

- 從技術革新到市場突圍 石頭科技重構洗衣機業務增長新范式

- Ilya塵封10年錄音曝光,大二入Hinton門下,竟坦言機器學習反直覺