文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

機器之心編輯部

AI 一定會比人類更聰明 , 之后會發生什么?

今天上午 , 在世界人工智能大會 WAIC 上 , 2024 年諾貝爾物理學獎得主、2018 年圖靈獎得主、人工智能教父杰弗里?辛頓(Geoffrey Hinton)發表了題為「數字智能是否會取代生物智能」的開場演講 。

該演講圍繞人工智能領域的歷史、未來發展方向、語言模型的原理、數字與生物計算特點以及 AI 發展帶來的擔憂等內容展開 , 辛頓高度評價了當前 AI 領域的大模型技術 , 認為其與人類思考模式相同 。

以下是辛頓演講實錄整理:

大語言模型 , 在用人類的方式思考?

非常感謝大家給我這樣一個機會 , 讓我來分享一下個人的觀點 —— 有關 AI 的歷史和它的未來 。

【圖靈獎得主Hinton國內首次現身演講:AI超越人類后,我們該怎么做】在過去 60 多年來 , 學界對于 AI 有兩種不同的理解范式 , 一個是邏輯型 , 認為符號規則的表達操作可以實現推理;另一種是圖靈和馮諾依曼所相信的 , 認為智能的基礎在于學習神經網絡中的鏈接 , 這個過程中理解是第一位的 。

這讓我們開始關注語言中詞與詞之間的關系 。

心理學家有另一套理論 , 他們認為數字是語義學的特征 。 在 1985 年 , 我做了一個很小的模型 , 想把兩大理論方向結合在一起 , 來更好地理解人類是如何理解詞匯的 。 我對每一個詞都分析了好幾個特征 , 每一個詞都與前一個詞的特征關聯 , 由此預測下一個詞 , 在這個過程中我們沒有存儲任何的句子 , 我生成句子 , 預測下一個詞是什么 。

這其中關聯到的知識 , 取決于語義的特征是如何互動的 。

如果你問在那之后的三十年發生了什么?十年之后 Yoshua Bengio 的研究擴大了它的規模 , 二十年后 , 計算語言學家終于接受了特征向量的嵌入來表達詞的意思;再到三十年后 , 谷歌開發了 Transformer , OpenAI 用 ChatGPT 展示了 AI 的能力 。

今天的大語言模型(LLM)被視為當年小語言模型的后代 , 是 1985 年后開始的技術潮流 , 它們使用更多的詞作為輸入 , 更復雜的神經元結構 , 學習特征之間也建立了更加復雜的交互模式 。

就像我做的那些小模型一樣 , 大語言模型與人類理解語言的方式是一樣的 , 就是把這些語言轉化為一些特征 , 然后把這些特征以一種非常完美的方式整合在一起 , 這就是 LLM 各個層次里所做的事情 。

所以我的理解就是大語言模型真的理解你是怎么理解問題的 , 和人類理解語言的方式是一樣的 。

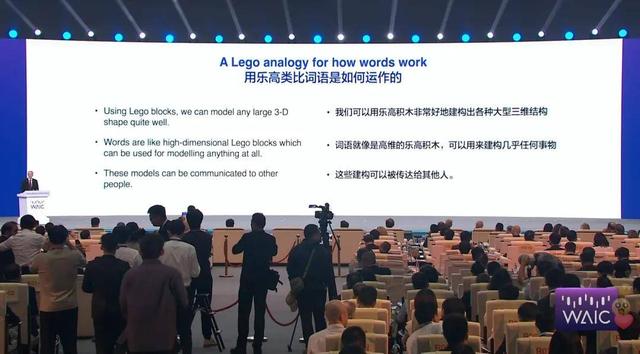

我打個比方 , 通過樂高積木 , 我們可以搭建出任何一個三維的模型 , 比如一個小汽車的模型 。 我們可以把每一個詞看作是一個多維度的樂高積木 , 可能包含幾千個不同的維度 。 正是由于這些積木具有如此多的維度 , 它們就可以被用來構建各種各樣的結構和內容 。

在這種方式下 , 語言本身就變成了一種建模的工具 。 我們可以用語言來表達、構建 , 甚至與人交流 。 每個積木(也就是每個詞)只需要有一個名字 , 組合起來就可以表達復雜的含義 。 也就是說 , 只要我們有了這些積木(詞) , 就可以隨時進行建模和溝通 。

不過 , 值得注意的是 , 不同的積木之間也有很多差異 , 因此我們在使用這些詞匯(樂高積木)的時候 , 也有非常多的變體和替代方式 。

傳統的樂高積木是有固定形狀的 , 比如一個方塊插進另一個方塊的小孔 , 結構明確、連接方式也比較確定 。 但語言中的詞不一樣 , 我們可以把每個詞也看作一個積木 , 但這個積木是多維度的 , 甚至可以說是無數種可能的 , 它不僅有一個基本的形狀(也就是語義核心) , 還可以根據上下文不斷地調整和變化 。

你可以想象 , 每個詞就像一個軟性的積木 , 它不是固定形狀的塑料塊 , 而是可以根據它要連接的鄰居詞 , 自主地變形 。 每個詞都有許多形狀奇特的手 , 如果你想真正理解它的含義 , 就要看它是如何和其他詞握手的 。 所謂握手 , 就是兩個詞之間在語義或語法上的配合關系 。

而一旦一個詞的形狀變了(也就是它的語義或語法角色發生了變化) , 它和下一個詞之間的握手方式也會跟著改變 。 這就是語言理解的本質問題之一:如何讓詞和詞之間以最合適的方式組合在一起 , 從而表達出更清晰、更準確的意思 。

這其實就像是蛋白質之間的結合:每個蛋白質都有獨特的結構和結合位點 , 它們需要以恰當的方式對接 , 才能發揮功能 。 語言也是如此 , 每個詞都像一個蛋白質 , 它的形狀、連接方式會隨著環境和上下文發生變化 , 這也正是神經網絡在建模語言時要處理的核心任務之一 。

我們可以把詞理解的過程繼續類比為氨基酸的組合過程 。 就像氨基酸在不同的模型中被組合、整合 , 最終形成具有復雜功能的蛋白質一樣 , 詞語也是被以不同的方式融合在一起 , 從而構成更有意義的內容 。 這正是人腦理解語言的方式 —— 將不同的語言單元靈活組合、構建出整體語義 。

所以我想表達的觀點是:人類理解語言的方式 , 和大語言模型的理解方式 , 在本質上是非常相似的 。 所以 , 人類有可能就是大語言模型 , 人類也會和大語言模型一樣產生幻覺 。

當然 , 大語言模型和人類在某些方面仍然是不同的 , 甚至在某些根本性的問題上 , 它們做得比人類更好 。

超越人類的 AI , 會消滅人類嗎?

回到計算機科學的一個根本性原則:軟件與硬件要分離 。 同樣的程序可以在不同的硬件上運行 , 這正是計算科學的基礎 。 程序是永恒存在的 , 你可以把所有硬件都毀滅掉 , 但若軟件存在 , 則內容可以復活 。 從這種意義上看 , 軟件是永恒的 。

但是人腦是模擬式的 , 每一次神經元激發的過程都不一樣 , 我腦中的神經元結構不能復制到你的身上 , 每個人的神經連接方式是獨一無二的 , 人腦和電腦硬件的不同帶來了問題:人腦只有 30W 功率就能擁有很高智慧 , 但人腦的知識無法簡單轉移到另一個人 , 解決知識轉移的方法在 AI 領域中是「知識蒸餾」 。

比如 DeepSeek 就是采用這種思路 , 將一個大型神經網絡中的知識蒸餾到一個更小的神經網絡中 。

這個過程很像教師與學生的關系:教師在訓練過程中 , 不僅知道正確答案 , 還知道詞語之間是如何相互關聯、上下文是如何構建的 。 教師會嘗試不斷優化這些連接方式(比如預測下一個詞時考慮更多上下文信息);而學生則模仿教師的表達方式 , 嘗試說出同樣的話 , 但使用的是更加緊湊、簡化的網絡結構 。

這個過程在人類之間其實也類似 —— 我們通過對話 , 把一個人的知識傳遞給另一個人 。 但這種傳遞的效率是非常有限的 。 舉例來說 , 一句話可能只包含了大約 100 個比特的信息量 , 這意味著即便你完全聽懂了我的話 , 我每秒鐘也只能向你傳遞極其有限的信息量 。

而相比之下 , 數字智能之間傳遞知識的效率要高得多 。 程序可以直接將參數、權重、模型結構拷貝或蒸餾過去 , 不需要解釋、不需要語言中介 , 也不會有理解上的偏差 。 這種效率的巨大差異 , 是人類智能與人工智能之間在知識遷移方面最本質的區別之一 。

我們現在已經可以做到這樣的事情:將完全相同的神經網絡模型的軟件 , 復制上百個副本 , 部署在不同的硬件設備上 。 因為它們是數字計算 , 每一個副本都會以相同的方式運行 , 只是基于各自的數據輸入、學習速率進行訓練 。 這些副本之間還能以某種方式進行參數的平均化處理 , 從而實現知識的共享與整合 。

這其實就是互聯網的核心力量:我們可以有成千上萬個副本 , 它們彼此之間不斷地調整各自的權重 , 再將這些權重取平均 , 就能夠實現模型之間的知識遷移和協同學習 。 更重要的是 , 這種知識的傳遞可以在每次同步時分享上萬億個比特的信息量 , 而不僅僅像人類那樣每秒只能傳遞幾十或幾百個比特 。

這就意味著 , 數字智能之間的知識分享速度 , 比人類之間快了幾十億倍 。 例如 GPT-4 能夠在許多不同的硬件上以并行的方式運行 , 收集來自不同網絡來源的信息 , 并在它們之間快速傳播和共享 。

如果我們將這種能力擴展到現實世界中的「智能體」(agents)中 , 意義就更加重大了 。 當多個智能體能夠運行、學習 , 并共享彼此的權重和經驗 , 那么它們學習和進化的速度將遠超單個個體 。 這種跨副本的學習和進化 , 是模擬硬件或生物神經系統所無法實現的 。

總結來看:

數字智能的運作雖然能耗很高 , 但它具有極大的優勢:可以輕松地復制、分享模型權重、同步經驗 , 從而實現大規模、高效率的知識遷移 。 生物智能雖然能耗低 , 但知識的分享極其困難 。 正如我現在用語言費力地向你解釋我的思考過程一樣 , 這是極不高效的 。如果未來能源變得足夠便宜 , 那么數字智能將進一步擴張它的優勢 。

我們人類習慣于認為自己是地球上最聰明的生物 , 因此很多人難以想象:如果有一天 , AI 的智能超過了人類 , 會發生什么?

我們現在正在創造 AI 智能體 , 用于幫助我們完成各種任務 , 它們已經具備了自我復制、設定子目標和評估目標優先級的能力 。 在這樣的系統中 , AI 很可能會自然地產生兩個基本動機:

1. 生存 —— 保持持續運行 , 從而完成我們賦予它的目標 。

2. 增強控制力 —— 獲得更多資源與權限 , 也同樣是為了更有效地實現它的目標 。

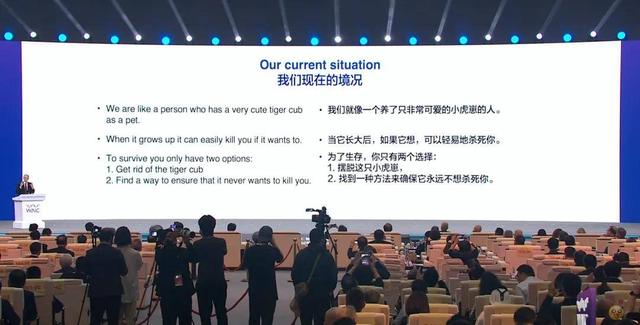

當具備了這兩個動機之后 , 這些智能體將不再是被動的工具 , 而是主動的系統 。 我們可能無法再簡單地「把它們關掉」了 。 因為一旦它們的智能水平遠超人類 , 它們將會像成年人操縱三歲小孩一樣輕松地操縱我們 。

如果你養一個小虎崽 , 你必須確保它長大后不會把你吃掉 。 你只有兩個選擇:要么把它馴化好;要么在它還沒咬你之前 , 把它干掉 。

但 AI 不可能像老虎那樣被「干掉」那么簡單 。 AI 是有巨大價值的:在醫療、教育、氣候、新材料等方面 , 它表現都非常出色 , 它能幫助幾乎所有行業變得更高效 。 我們沒有辦法消除 AI , 即使一個國家消除 AI , 其他國家也不會這樣做 。

如果我們想要人類生存的話 , 就必須找到一個方法 , 讓 AI 不會消除人類 。

我發表一個個人觀點:國家之間在某些方面可能無法達成一致 , 比如致命武器、網絡攻擊、偽造視頻等等 , 畢竟各國的利益是不一致的 , 他們有著不同的看法 。 但在有的方面 , 世界各國是可以達成一致的 , 這也是最重要的方面 。

我們看一下上世紀 50 年代的冷戰巔峰時期 , 美國和蘇聯合作阻止了核戰爭 。 盡管他們在很多方面都是對抗的 , 但大家都不喜歡打核戰爭 , 在這一點上他們可以合作 。

我們現在的局面是 , 沒有一個國家希望 AI 來統治世界 , 如果有一個國家發現了阻止 AI 失控的方法 , 那么這個國家肯定會很樂意擴展這種方法 。 所以我們希望能夠有一個由 AI 安全機構構成的國際社群來研究技術、訓練 AI , 讓 AI 向善 。

訓練 AI 向善的技巧和訓練 AI 聰明的技術是不一樣的 , 每個國家可以做自己的研究讓 AI 向善 , 可以基于數據主權進行研究 , 最終貢獻、分享出讓 AI 向善的成果 。

我提議 , 全球發展 AI 的主要國家應該考慮構建一個網絡 , 來研究讓這個聰明的 AI 不消滅人類、不統治世界 , 而是讓它很高興地做輔助工作 , 盡管 AI 比人類聰明很多 。

我們現在還不知道怎么去做這件事 , 但從長期來看 , 這是人類面臨的最重要的問題 , 好消息是在這個問題上 , 所有國家都是可以一起合作的 。

杰弗里?辛頓 , AI 教父

在人工智能領域里 , 杰弗里?辛頓赫赫有名 。 他于 1947 年出生 , 是一位英裔加拿大計算機科學家、認知科學家和認知心理學家 , 因其在人工神經網絡方面的工作而聞名 , 并因此被譽為「人工智能教父」 。

辛頓在 1978 年在愛丁堡大學獲得人工智能博士學位 。 他是多倫多大學名譽教授 , 2013 年到 2023 年 , 他同時在谷歌大腦工作 , 2023 年 5 月公開宣布離開谷歌 。

1986 年 , 辛頓與 David Rumelhart、Ronald J. Williams 合作發表了一篇被廣泛引用的論文《Learning internal representations by error-propagation》 , 推廣了用于訓練多層神經網絡的反向傳播算法 。 在 2012 年 , 他與學生 Alex Krizhevsky 和 Ilya Sutskever 合作設計了 AlexNet, 在 ImageNet 挑戰賽上取得了優異成績 , 成為了圖像識別領域的里程碑 , 也是計算機視覺領域的一次突破 。

辛頓因在深度學習方面的杰出貢獻 , 與約書亞?本吉奧(Yoshua Bengio)和楊立坤(Yann LeCun)共同獲得了 2018 年圖靈獎 , 該獎被稱為「計算機界的諾貝爾獎」 。 他們經常被稱為「深度學習教父」而共同提起 。 辛頓還與約翰?霍普菲爾德(John Hopfield)一起獲得了 2024 年諾貝爾物理學獎 , 以表彰他們在利用人工神經網絡進行機器學習方面做出的基礎性發現和發明 。

2023 年 5 月 , 辛頓宣布從谷歌辭職 , 以便能夠「自由地談論人工智能的風險」 。 他對惡意行為者的故意濫用、技術失業以及通用人工智能的生存風險表示擔憂 。 辛頓指出 , 制定安全準則需要在人工智能使用方面相互競爭的各方之間進行合作 , 以避免最壞的結果 。 在獲得諾貝爾獎后 , 他呼吁緊急研究人工智能安全問題 , 以找出如何控制比人類更聰明的人工智能系統 。

推薦閱讀

- 單項最高獎勵15萬美元,Meta征集表面肌電圖腕帶和控制算法提案

- 從奧斯卡領獎臺到BIRTV:DJI大疆專業影像生態亮相BIRTV 2025

- 理光IMC系列打印機榮獲“2025年最佳打印生產力”獎

- 抽獎又開始了!美光加入 三大廠GDDR7顯存齊聚RTX 50系列

- 青松光電LED顯示賦能數字經濟 榮獲“2025西安數字經濟領軍企業獎”

- 通義靈碼軟件工程大模型獲國際頂會杰出論文獎,復雜問題解決率刷新開源紀錄

- 諾獎得主Hassabis預言成真,AI零樣本發現新抗體,轟動整個醫藥圈

- 中國專利金獎:每小時數萬顆芯片“微米級極速取放”

- 螞蟻AI健康應用AQ獲選2025世界人工智能大會重磅獎項

- 螞蟻AI健康管家AQ獲世界經濟論壇最高榮譽MINDS大獎