文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

編輯:杜偉

【token危機解決?擴散模型數據潛力3倍于自回歸,重訓480次仍攀升】擴散語言模型(DLMs)是超強的數據學習者 。

token 危機終于要不存在了嗎?

近日 , 新加坡國立大學 AI 研究者 Jinjie Ni 及其團隊向著解決 token 危機邁出了關鍵一步 。

在當前大語言模型(LLM)的持續發展中 , 面臨的挑戰之一是可用的高質量訓練文本數據(tokens)即將枯竭 , 并成為限制模型性能持續提升的關鍵瓶頸 。 另外 , 新增的高質量數據來源少 , 獲取成本高 , 去重后更加稀缺 。 因此 , 當模型規模繼續擴大 , 所需數據量按 Scaling Laws 成倍增加時 , 就出現了「優質 token 不夠訓練」的危機 。

針對這一現象 , 該團隊從零開始預訓練了擴散語言模型(DLMs)與自回歸(AR)模型 , 其中規模最高至 80 億參數、4800 億 tokens、480 個 epoch 。

研究有以下三項重要發現:

在 token 數量受限的情況下 , DLMs 優于 AR , 并且具有超過 3 倍的數據潛力; 一個僅用 10 億 tokens 訓練的 10 億參數 DLM , 在 HellaSwag(常識推理基準) 上可達 56% , 在 MMLU(綜合多任務語言理解基準) 上可達 33% , 無任何技巧、無挑選數據; 未出現性能飽和:重復訓練次數越多 , 提升越明顯 。

此外 , 團隊還剖析了并行研究《Diffusion Beats Autoregressive in Data-Constrained Settings》中的嚴重方法論缺陷 —— 以共同提升開放評審的標準!

Jinjie Ni 在社媒 X 上詳細介紹了其團隊的研究結論、研究方法 , 接下來我們一一來看 。

結論 1:擴散語言模型(DLMs)是超強的數據學習者 。

如上所述 , 團隊從零開始預訓練了一系列 DLMs , 規模最高達 80 億參數、4800 億 tokens 。 結果提供了有力證據:在普通網頁數據上進行重復訓練時 , DLMs 在數據受限場景下無論模型規模如何 , 都優于自回歸(AR)模型 , 展現出顯著更高的潛力且未出現性能飽和 。

總體而言 , DLMs 的最終數據潛力比 AR 模型高出三倍以上 。

結論 2:重復越多 , 收獲更多 。

為了研究 DLM 訓練中 token 的全部潛力 , 團隊進行了額外實驗:將同一份 10 億 token 的數據集重復訓練 480 個 epoch , 總訓練量達到 4800 億 tokens 。 結果顯示 , 模型在 HellaSwag 上取得約 56% 的準確率 , 在 MMLU 上取得約 33% , 顯著優于 AR 的約 41% 和約 29% 。

令人驚訝的是 , 即使在如此極端的重復條件下 , 性能依然未出現飽和 , 這表明 DLMs 能夠從固定的 10 億 token 語料中提取到遠超預期的有效信息 。

「在驗證集上出現過擬合的模型 , 在下游任務上的表現卻持續提升 。 」為什么會這樣呢?

團隊可視化了多選評測中 , 真實答案與其他選項的平均負對數似然(NLL) , 以及它們之間的差值(△NLL) 。 即使在驗證集上出現「過擬合」后 , 真實答案與其他選項的 NLL 差距(△NLL)依然持續擴大 , 這表明盡管驗證損失在上升 , 模型的底層判別能力仍在不斷提升 。 這一現象在域內數據和域外數據的訓練中都同樣存在 。

雖然 DLMs 對數據重復具有較強的魯棒性 , 但在訓練足夠長的 epoch 后 , 它們同樣會發生過擬合 。 更大的唯一數據量可以延緩過擬合的出現 , 而更大的模型規模則會加速過擬合的到來 。

為什么 DLMs 是超強的數據學習者呢?原因有二 。

其一 , 如下圖所示 , 網頁文本數據并非完全因果結構!雖然用非因果方向建模會導致更高的損失 , 但它仍然是可行的 。 這意味著僅用純因果方式來建模網頁數據是一種浪費!借助擴散目標和雙向注意力 , DLMs 能夠對數據進行雙向建模 , 從網頁數據中提取到更多信息 。

其二 , DLMs 是「超密集模型」 , 它們在計算上的超高密度(每個任務需要更多的 FLOPs)直接轉化為更強的智能 。

相比之下 , AR 模型更優先考慮計算效率 , 而非數據潛力 。 它們的 Transformer 設計(包括教師強制和因果掩碼)最大化 GPU 的使用效率 , 但限制了建模能力 。 隨著計算成本下降 , 數據可得性反而成為關鍵瓶頸 —— 這正是團隊研究 DLMs 的動力所在 。

擴散目標要求在有效訓練中 , 將預訓練數據集中的每個數據點在多個掩碼比例和組合下進行損壞 , 以便更精確估計期望值 。 這進一步解釋了為什么數據重復訓練能帶來如此顯著的收益 。

巧合的是 , 一項同期研究「Diffusion Beats Autoregressive in Data-Constrained Settings」[1

也探討了類似主題 。 然而 , 團隊在細致分析后 , 揭示了其中存在的若干方法論問題 , 可能導致結論存在偏差 。

[1

地址:https://arxiv.org/abs/2507.15857

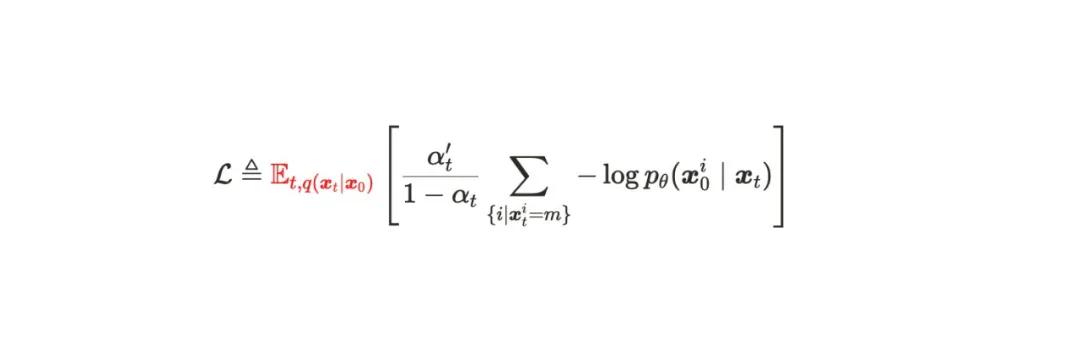

在 [1

的所有實驗中 , 研究者使用了損失函數 (1) , 但未做出明確的理論解釋 。 然而 , 這個損失函數與理論基礎更扎實、被廣泛采用的掩碼擴散語言建模損失 (2) 有顯著差異 。 從理論上可以證明損失函數 (1) 并不能忠實地表示模型似然 , 這可能會對其結論造成嚴重影響 。

團隊還注意到 , [1

在最新的 arXiv v3 版本中對原始草稿進行了修改 , 增加了一個線性時間依賴的重新加權項 。 但仍假設其所有實驗均使用了公式 (1) , 因為論文中圖 4 (b) 的損失范圍與公式 (1) 的預期表現高度吻合 。 團隊期待 [1

的代碼庫(在本文撰寫時仍為空倉庫)以及社區對相關實驗的復現 。

問題來了:驗證集損失是比較 AR 和 DLM 的好指標嗎?簡短來說:當損失函數的形式本身有問題時 , 當然不是 。 它們并不代表相同的含義;即使損失函數形式正確 , 也依然不是好指標 。

原因包括如下:

AR 測量的是精確的負似然 , 而 DLM 測量的是一個上界; 更低的損失并不意味著更強的能力 , 這一點在上文的討論中已有體現 。

此外 , [1

報告的 AR 基準測試結果距離最佳水平相差甚遠 。 換句話說 , [1

實際上是在拿一個尚未訓練到最佳狀態的 AR 檢查點 , 與一個最佳的擴散模型檢查點進行比較 。 這是不公平的 。

此外 , [1

在比較 AR 與擴散模型的過擬合趨勢時 , 為 AR 使用了更大的模型規模和更少的唯一訓練 token 數量 。 這種設置并不公平 , 因為更大的模型在訓練數據多樣性不足的情況下 , 本身就更容易更早出現過擬合 。

最后 , [1

中使用的 scaling law 公式假設驗證集損失不會下降 , 但這一假設在實際中并不成立 , 因為過擬合會導致驗證損失上升 。 這個有缺陷的假設會導致擬合效果不佳 , 并使基于其預測得出的任何結論產生偏差 。

目前 , 團隊正在用一種瘋狂的設置訓練一個大模型 , 并在之后發布完整論文 。

更多細節內容請參考博客和即將發布的論文 。

參考內容:https://x.com/NiJinjie/status/1954177095435014533

博客鏈接:

https://jinjieni.notion.site/Diffusion-Language-Models-are-Super-Data-Learners-239d8f03a866800ab196e49928c019ac

推薦閱讀

- 開源框架教AI在MCP中玩轉工具解決任務,實測效果超越GPT!

- Token成本下降,訂閱費卻飛漲,AI公司怎么了?

- 億聯網絡打造全鏈路安全視頻會議解決方案,護航企業高效辦公

- 隱藏在瀏覽器里的“指紋”,正成為新的隱私危機

- 字節發布擴散語言模型,2146tokens/s,比同規模自回歸快5.4倍

- 智啟新篇:Dynabook智慧辦公解決方案,重構未來辦公新生態

- 強化學習的兩個「大坑」,終于被兩篇ICLR論文給解決了

- 突破單token預測局限!南洋理工首次將多token預測引入微調

- 三大運營商終于出手!事關“資費亂象”問題,有望徹底解決了

- 馬斯克承諾年底讓一半美國人坐上無人出租車,網友:先解決FSD再說