文章圖片

文章圖片

文章圖片

文章圖片

機器之心編譯

作者:丁一帆

編輯:+0 , 冷貓

年初那會兒 , DeepSeek 橫空出世 , AI 圈子跟過年一樣熱鬧 。 它憑啥這么火?除了開源夠意思 , 五百多萬的訓練成本也驚艷了不少人 。

在此之后 , 模型的訓練成本越來越便宜 , 前陣子 Deep Cogito 甚至只花不到 350 萬美刀 , 就搞出了一個(自稱)能跟 o3 和 Claude 4 Opus 性能比肩的模型 。

這讓不少創業公司覺得 , 商業模式清晰了:先用「每月 20 美元」這樣的低價包月服務圈住用戶 , 賭的就是未來模型成本會像摩爾定律一樣降下來 。

但這個看似完美的劇本 , 其實是一個注定會失敗的陷阱 。 和一路走低的訓練成本相反 , AI 公司的運營成本 , 尤其是「推理」費用 , 正在坐著火箭往上竄 。

這讓 AI 公司面臨兩難抉擇:「無限訂閱」會虧死 , 「按量計費」會餓死 。TextQL 聯合創始人兼 CEO 丁一帆(Ethan Ding)的一篇博客深度剖析了 AI 公司正在面臨的此類「囚徒困境」 , 并給出了建議 。文章風趣幽默且深入淺出 , 非常值得一讀 。

博客標題:tokens are getting more expensive 博客鏈接:https://ethanding.substack.com/p/ai-subscriptions-get-short-squeezed以下是文章的詳細內容 。

即便「語言模型未來會便宜 10 倍」的預測成真 , 也無法拯救 AI 訂閱服務免于這場成本擠壓 。

想象一下你創辦了一家公司 。

你心里很清楚:消費者每月最多只愿意為產品支付 20 美元 。 沒問題 , 你想 , 這正是經典的風投操作思路 —— 以成本價運營 , 犧牲利潤換增長 。 CAC(獲客成本)、LTV (生命周期價值)那套你也都算過了 , 一切在掌控之中 。

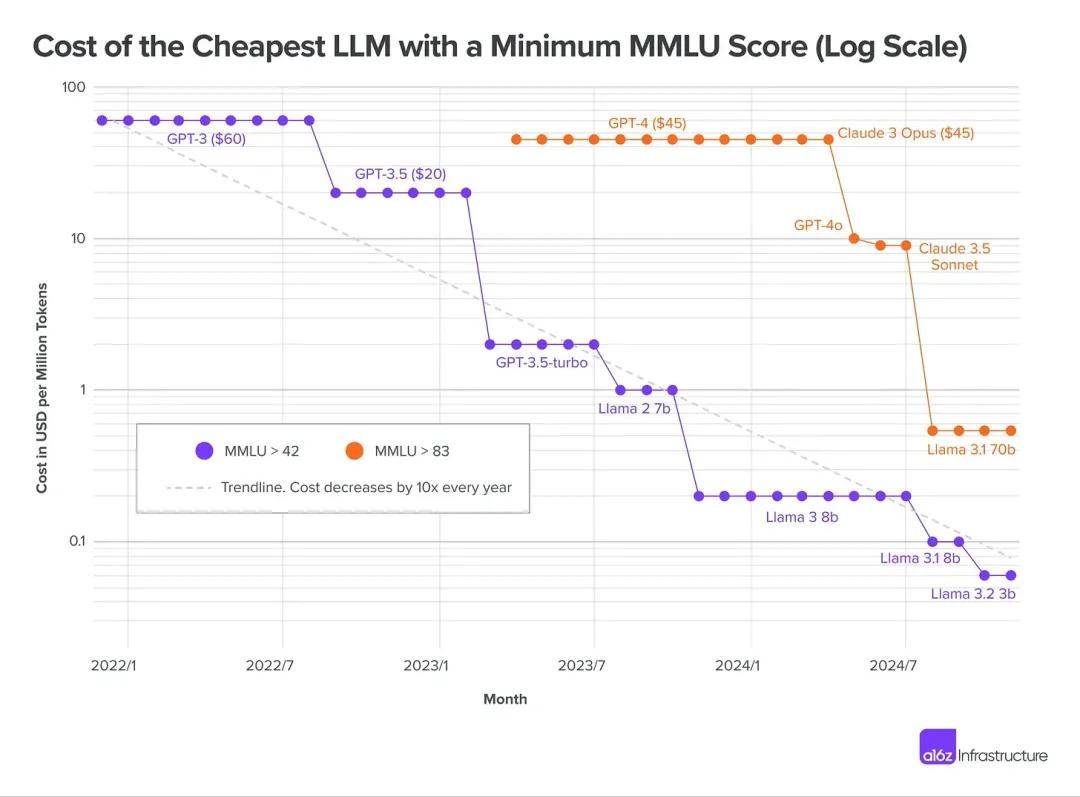

但接下來的部分才真正有意思:你看過 a16z 那張圖 —— LLM 成本每年會下降 10 倍 。

圖片來源:https://a16z.com/llmflation-llm-inference-cost/

于是你心想:現在用戶月付 20 美元 , 我剛好打平;等到明年模型成本降價 10 倍 , 利潤率一下沖到 90% , 簡直是穩賺不賠 。

虧損只是暫時的 , 盈利是必然的 。

這個邏輯簡單到 連風投助理都能聽懂:

第一年:20 美元打平 第二年:成本下降 10 倍 → 毛利率 90% 第三年:去看游艇 ?這套劇本也確實看起來合理:「LLM 推理成本每 6 個月下降 3 倍 , 我們撐一撐就好了 。 」

但現實是:18 個月過去了 , 毛利率幾乎跌到歷史最低點……

Windsurf 已經被拆賣回收了 , Claude Code 這周也不得不取消原來的 200 美元 / 月無限使用計劃 。

公司們依舊在流血 , 模型確實變便宜了 ——GPT-3.5 的推理成本比原來低了 10 倍 。 可不知怎么的 , 利潤不僅沒變好 , 反而更糟了 。

哪里不對勁?

沒人想要過期的報紙

GPT-3.5 的確比以前便宜了 10 倍 。 但它現在的吸引力 , 就像 iPhone 發布會當天你掏出個翻蓋手機 —— 誰還會想用?

每當一個新模型被發布并成為 SOTA(最先進技術) , 99% 的需求會立即轉向它 。 用戶已經默認了這種節奏 , 對他們來說 , 產品理應不斷升級 。

現在來看看現實中那些真正占據市場 99% 需求的前沿模型的定價歷史 —— 你就會發現問題所在:

注意到什么了嗎?

當 GPT-4 以每月 60 美元的價格發布時 , 大家還是一窩蜂上去了 , 哪怕前一代的 SOTA——GPT-3.5 , 便宜了整整 26 倍 。 當 Claude 3 Opus 以同樣的價格上線時 , 人們同樣紛紛遷移 , 盡管此時 GPT-4 已經降價了 。 是的 , 10 倍成本下降確實存在 , 但那通常適用于那些「就差沒跑在 Commodore 64 上」的老模型 。

這就是「成本會下降」戰略的第一個幻覺支點:

用戶只對「最強語言模型」有需求 , 僅此而已 。

而「最強模型」的價格始終差不多 , 因為那正是當前推理邊界(edge of inference)的真實成本 。

你說:「這輛車現在便宜多了!」可你指的是一輛 1995 年的本田思域 。 當然 , 它確實便宜 。 但你想買的是 2025 年的豐田凱美瑞 , 廠商指導價仍是 3 萬美元 。

當你在使用 AI —— 不管是編程、寫作、還是思考 —— 你天然會追求極致質量 。 沒人會打開 Claude 然后說:「嗯 , 我今天不如用一下比較爛的版本 , 省點公司開銷吧 。 」

我們是認知上的「貪婪動物」 , 只想要最強的大腦 。 尤其當我們在用自己的時間來做平衡的時候 。

模型的資源消耗遠超預期

你可能會說:「好吧 , 但這還在可控范圍內 , 對吧?就算一直打平也沒事嘛?」

天真的孩子 。

確實 , 每一代前沿模型的 單個 token 成本并沒有變貴 , 但有件事更糟糕的事情發生了:

它們吞掉的 token 數量 , 簡直爆炸式增長 。

以前你在 ChatGPT 里問一句話 , 它就回你一句 。 現在 , 「深度研究」模式會先花 3 分鐘做規劃 , 再用 20 分鐘瀏覽材料 , 最后還要用 5 分鐘把報告潤色一遍 。 O3 模型甚至能為了回應一句 「你好啊」 , 跑滿 20 分鐘 。

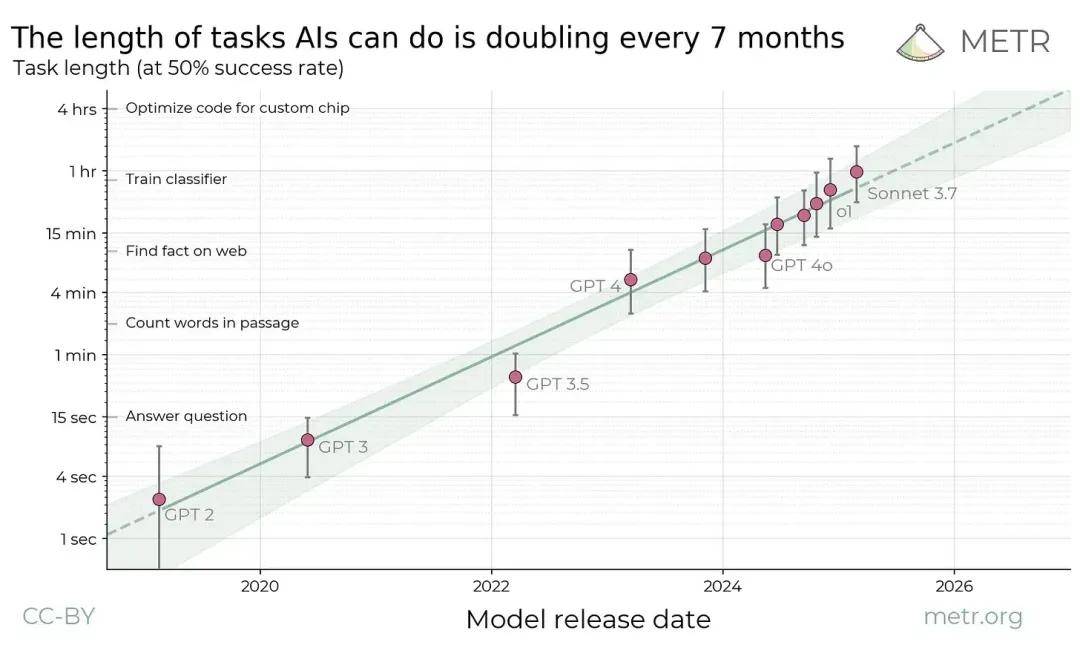

由于 強化學習(RL)和推理階段計算的爆炸式增長 , 出現了一個誰也沒預料到的現象:

AI 能完成的任務長度 , 每 6 個月翻一倍 。

以前一次調用輸出 1000 個 token , 現在輕輕松松就是 100000 個 token 。

圖片來源:https://metr.org/blog/2025-03-19-measuring-ai-ability-to-complete-long-tasks/

當你真正把這件事算清楚 , 數字會讓人抓狂 。

現在 , 一次 20 分鐘的「深度研究」調用大概花費 1 美元 。 但到 2027 年 , 我們將擁有能連續運行 24 小時、而且不會跑題的 AI agent…… 再疊加「前沿模型價格不降」的現實?

一次這樣的調用 , 就變成了 72 美元 / 天 / 用戶 。

而且別忘了 , 未來這些 agent 是可以異步并發運行多個任務的 。 一旦我們真正部署這種 24 小時不間斷運行的 agent , 我們就不會再是「發一個指令、等它回你一條消息」 。

我們會直接按批次調度:整個 AI 勞動力方陣同時并行處理問題 , 瘋狂燃燒 token , 仿佛又回到了 1999 年互聯網泡沫那年 。

重點來了 —— 我必須強調:

每月 20 美元的訂閱費 , 連用戶每天進行一次 1 美元的深度調用都撐不起 。

但我們正朝著那個方向全速狂奔 。 每一次模型能力的提升 , 帶來的并不是成本節省 , 而是:它能更有效地消耗更多算力 。

就像你造了一個更節能的發動機 , 結果你拿它去造了一輛怪獸卡車 。 沒錯 , 油耗確實更高效了 , 但你現在燒的是原來的 50 倍汽油 。

這正是那場導致 Windsurf 被強制平倉的「空頭擠壓(short squeeze)」—— 而任何采用「固定費率訂閱 + 高 token 消耗」的商業模式的初創公司 , 如今也正面臨同樣的命運 。

Anthropic 嘗試填補

成本擠壓的窟窿

Claude Code 的「無上限」套餐實驗 , 是我們所見過的、為渡過這場風暴所做的最高明的嘗試 。 他們用盡了渾身解數 , 但最終還是慘敗 。

他們的策略手冊確實非常聰明:

定價提高十倍在 Cursor 收費 20 美元 / 月時 , 他們定價 200 美元 / 月 。 在開始「出血」(虧損)前 , 留出更多的緩沖空間 。

根據負載自動伸縮模型當負載過重時 , 從 Opus (每百萬 token 75 美元) 切換到 Sonnet (每百萬 token 15 美元) 。 在讀取任務上 , 用 Haiku 進行優化 。 這就像 AWS 的自動伸縮 , 但伸縮的對象是「大腦」(模型) 。

他們幾乎可以肯定 , 是把這種行為直接構建進了模型權重之中 , 這是一種我們未來可能會更多見到的范式轉換 。

將處理任務卸載到用戶機器上當用戶的 CPU 正好閑置時 , 何必再啟動自己的沙盒環境呢?

然而 , 盡管有這些高超的工程設計 , token 的消耗量依然如超新星爆發般激增 。

圖片來源:https://www.viberank.app/

一百億個 token 。 這相當于一個月內一萬兩千五百本《戰爭與和平》的量 。

怎么做到的?即便是每次運行 10 分鐘 , 一個人如何能消耗掉一百億個 token?

事實證明 , 10 到 20 分鐘的連續運行 , 時間長得足以讓人們發現 for 循環的妙用 。 一旦你將 token 消耗與用戶在應用內的在線時長脫鉤 , 物理規律便會開始主導一切 。 給 Claude 設定一個任務 , 讓它檢查自己的工作 , 重構代碼 , 進行優化 , 然后重復此過程 , 直到公司破產 。

用戶變成了 API 編排者 , 花著 Anthropic 的錢 , 運行著 7x24 小時不間斷的代碼轉換引擎 。 從聊天到代理的演變一夜之間就完成了消耗量增加了 1000 倍 。 這是相變 , 而非漸變 。

所以 , Anthropic 取消了無限使用套餐 。 他們本可以嘗試每月收費 2000 美元 , 但他們學到的教訓不是定價不夠高 , 而是在這個新世界里 , 任何訂閱模式下都無法提供無限使用 。

在這個新世界里 , 不存在一個行得通的固定訂閱價格 。

這種(定價)數學模型已經從根本上失效了 。

所有人的囚徒困境

這讓其他所有人都陷入了進退兩難的境地 。

每家 AI 公司都知道 , 按使用量計費能救他們 。 但他們也知道 , 這同樣會殺了他們 。 當你負責任地按照每千 token 收費 0.01 美元時 , 你那有風投支持的競爭對手卻提供每月 20 美元的無限使用套餐 。

猜猜用戶會去哪里?

經典的囚徒困境:

* 所有人都按使用量計費 → 行業可持續發展

* 所有人都采用固定費率 → 陷入探底競賽

* 你按量計費 , 別人用固定費率 → 你獨自走向滅亡

* 你用固定費率 , 別人按量計費 → 你贏了(但之后還是會死)

所以 , 所有人都選擇了背叛 。

每個人都在補貼重度用戶 。 每個人都在發布曲棍球棒式的增長曲線圖 。 最終 , 每個人都會發布「重要的價格調整通知」 。

Cursor、Lovable、Replit—— 他們都算得清這筆賬 。 他們選擇了今天要增長 , 明天要利潤 , 最終走向破產 —— 但那是下一任 CEO 的問題 。

老實說?這或許是對的 。 在「圈地運動」中 , 市場份額比利潤率更重要 。 只要風投們還愿意繼續開出支票來填補單位經濟模型的窟窿……

如何避免虧損平倉?

我們真的能避開 token 成本擠壓嗎?

最近有傳言稱 Cognition 正在以 150 億美元的估值進行融資 , 而其對外公布的年經常性收入(ARR)甚至不到 1 億美元(我猜實際可能接近 5000 萬美元) 。 這與 Cursor 形成了鮮明對比 , 后者在年經常性收入達到 5 億美元、增長曲線更為陡峭的情況下 , 才獲得了 100 億美元的估值 。

Cursor 的收入是 Cognition 的八倍多 , 估值卻只有其三分之二 。 那些風投到底知道哪些我們所不知道的關于 Cognition 的內幕?它們都是編寫代碼的 AI 代理 。 難道 Cognition 已經找到了擺脫死亡螺旋的方法?

有三條出路:

1. 從第一天起就采用按使用量計費

沒有補貼 , 沒有「先拉新、后變現」 , 只有實實在在的經濟模型 。 這在理論上聽起來很棒 。但問題是 , 你能找出一個實現了爆發式增長、面向消費者的、按使用量計費的 AI 公司嗎?

消費者討厭按量計費 。 他們寧愿為無限使用多付點錢 , 也不愿收到一張意料之外的賬單 。 每一個成功的消費者訂閱服務 ——Netflix、Spotify、ChatGPT—— 都是固定費率 。 一旦你開始計量收費 , 增長就停滯了 。

2. 極高的轉換成本 ? 高利潤率

這正是 Devin 全力押注的策略 。 他們最近宣布了與 Citi 和 Goldman Sachs 的合作 , 向這兩家公司的各 40000 名軟件工程師部署 Devin 。 按每月 20 美元計算 , 這是一個千萬美元級的項目 。

但問題來了:你寧愿從 Goldman Sachs 那里獲得 1000 萬美元的年經常性收入 , 還是從專業級個人開發者那里獲得 5 億美元?

答案是顯而易見的:長達六個月的實施、合規審查、安全審計、以及地獄般的采購流程 , 意味著來自 Goldman Sachs 的收入雖然難以贏得 —— 但一旦贏得 , 客戶就幾乎不可能流失 。

只有在銀行里的那位唯一決策者將自己的聲譽押注在你身上時 , 才能拿到這些合同 —— 屆時 , 所有人都會盡其所能確保項目成功 。

這也解釋了為什么除了那些超大規模云服務商之外 , 最大的軟件公司都是向這類客戶進行銷售的「記錄系統公司」 [如 CRM / ERP / EHRs

。 他們的利潤率也都能達到 80-90% , 因為客戶越難流失 , 他們對價格就越不敏感 。

等到競爭對手出現時 , 你已經深深嵌入到對方的行政流程中 , 更換供應商需要又一個長達六個月的銷售周期 。 問題不是「你不能走」 , 而是 —— 你的 CFO 寧愿去死 , 也不想再經歷一次供應商評估 。

3. 垂直整合 ? 從基礎設施上賺錢

這就是 Replit 的玩法:將編碼代理與應用托管、數據庫管理、部署監控、日志記錄等服務捆綁在一起 。 在每個 token 上都虧錢 , 但在技術棧的每一個其他層面上為新一代開發者捕獲價值…… 看看 Replit 的垂直整合做得多深就知道了 。

圖片來源:https://x.com/mattppal/status/1932798993626771556

把 AI 當作虧本換流量的產品 , 來推動那些能與 AWS 競爭的服務的消費 。 你賣的不是推理服務 , 而是其他一切 。 推理服務本身只是營銷開支 。

這種模式的天才之處在于 , 代碼生成天然地創造了對托管服務的需求 。 每個應用都需要運行的地方 , 每個數據庫都需要管理 , 每個部署都需要監控 。 讓 OpenAI 和 Anthropic 去進行推理服務的價格歸零競賽吧 , 而你擁有了其他的一切 。

那些還在玩「不計成本、追求增長的固定費率模式」的公司呢?它們都只是行尸走肉 , 只不過它們的昂貴葬禮被安排在了今年第四季度 。

未來之路

我總是看到創始人們指望著「明年模型成本會便宜十倍!」這句話 , 就好像抓住了一根救命稻草 。 的確如此 , 但到那時 , 你的用戶對模型的期望可能會提高二十倍 。 目標正在沖刺著遠離你 。

還記得 windsurf 嗎?由于 cursor 給他們的利潤表帶來了巨大壓力 , 他們最終也未能找到擺脫困境的方法 。 即便是擁有全球最深度垂直整合應用層的 anthropic , 也無法讓固定訂閱費下的無限使用模式跑通 。

盡管「levered beta is all you need」一文的結論 —— 即先發優勢勝過聰明才智 —— 依然成立 , 但沒有計劃的「先發」也意味著你會第一個走進創業墳場 。

相關博客鏈接:https://ethanding.substack.com/p/levered-beta-is-all-you-need現在可沒有 Google 會為負毛利業務開出 24 億美元的支票了 。 當「以后」意味著你的 AWS 賬單超過了你的收入時 , 就不再有「我們以后再想辦法」這回事了 。

【Token成本下降,訂閱費卻飛漲,AI公司怎么了?】但好在 , 至少明年的模型成本會便宜十倍 。

推薦閱讀

- 蘋果學學,適馬宣布自己承擔5%額外關稅成本

- 一個模型超了DeepSeek R1、V3,參數671B,成本不到350萬美元

- 字節發布擴散語言模型,2146tokens/s,比同規模自回歸快5.4倍

- 長期主義成本管控,選AMD銳龍8700G還是英特爾酷睿14700合適?

- 蘋果美國關稅影響或已開始顯現 第三財季硬件產品銷售成本明顯增加

- 突破單token預測局限!南洋理工首次將多token預測引入微調

- AWS S3對象存儲新增矢量功能大幅降低AI存儲成本

- 如何節約打印成本 看這篇就夠了

- 在海外構建一個能夠立即商業化的AI 應用,至少需要多少IT成本?

- 解道奧賽題成本5000美元?陶哲軒警告,AI下一步要規模化的更便宜