【具身智能體主動迎戰對抗攻擊,清華團隊提出主動防御框架】

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

面對對抗攻擊 , 具身智能體除了被動防范 , 也能主動出擊!

在人類視覺系統啟發下 , 清華朱軍團隊在TPMAI 2025中提出了強化學習驅動的主動防御框架REIN-EAD 。

該框架讓智能體也能學會“看第二眼” , 提升對抗場景下的感知魯棒性 。

對抗攻擊已成為視覺感知系統安全性和可靠性的重大威脅 , 這類攻擊通過在三維物理場景中放置精心設計的擾動物體(如對抗補丁和三維對抗物體)來操縱深度神經網絡的預測結果 。

在人臉識別和自動駕駛等安全關鍵領域 , 此類漏洞的后果尤為嚴重 , 錯誤預測可能嚴重損害系統安全性 。

然而 , 現有防御方法多依賴攻擊先驗 , 通過對抗訓練或輸入凈化等手段實現對有害畫面的“被動防守” , 忽略了與環境交互可獲得的豐富信息 , 遇上未知或自適應攻擊時效果迅速衰減 。

相比之下 , 人類視覺系統更為靈活 , 可以通過主動探索與糾錯 , 自然地降低瞬時感知的不確定性 。

類似的 , REIN-EAD的核心在于利用環境交互與策略探索 , 對目標進行連續觀察和循環預測 , 在優化即時準確率的同時兼顧長期預測熵 , 緩解對抗攻擊帶來的幻覺 。

特別地 , 該框架引入了基于不確定性的獎勵塑形機制 , 無需依賴可微分環境 , 即可實現高效策略更新 , 支持物理環境下的魯棒訓練 。

實驗驗證表明 , REIN-EAD在多個任務中顯著降低了攻擊成功率 , 同時保持了模型標準精度 , 在面對未知攻擊與自適應攻擊時同樣表現出色 , 展現出強大的泛化能力 。

主要貢獻 (1)提出REIN-EAD模型 , 融合感知與策略模塊來模擬運動視覺機制論文設計了一種結合感知模塊與策略模塊的主動防御框架REIN-EAD , 借鑒人類大腦支持運動視覺的工作方式 , 使模型能夠在動態環境中持續觀察、探索并重構其對場景的理解 。

REIN-EAD通過整合當前與歷史觀測 , 構建具有時間一致性的魯棒環境表征 , 從而提升系統對潛在威脅的識別與適應能力 。

(2)引入基于累計信息探索的強化學習方法以優化主動策略為提升REIN-EAD的策略學習能力 , 論文提出一種基于累計信息探索的強化學習算法 , 通過引導式密集獎勵優化多步探索路徑 , 引入不確定性感知機制以驅動信息性探索 。

該方法強化了時間上的一致性探索行為 , 并通過強化學習范式消除了對可微環境建模的依賴 , 使系統能夠主動識別潛在高風險區域并動態調整行為策略 , 顯著提升了觀測數據的有效性與系統安全性 。

(3)提出離線對抗補丁近似技術(OAPA) , 實現效率高、泛化強的防御能力針對3D環境下對抗訓練計算開銷巨大的挑戰 , 論文提出OAPA技術 , 通過對抗補丁流形的離線近似 , 構建無需依賴對手信息的普適防御機制 。

OAPA大幅降低了訓練成本 , 同時具備在未知或自適應攻擊場景下的穩健防御能力 , 為三維環境下的主動防御提供了一種實用且高效的解決方案 。

(4)在多任務與多環境上取得優越性能 , 展現優越的泛化與適應能力論文在多個標準對抗測試環境與任務中進行了系統評估 , 實驗結果表明:REIN-EAD在抵抗多種未知和自適應攻擊下表現出顯著優于現有被動防御方法的性能 。

其卓越的泛化能力和對復雜現實世界場景的適應性 , 進一步驗證了本文方法在安全關鍵系統中的應用潛力 。

方法與理論 REIN-EAD框架REIN-EAD是一種模擬人類在動態環境中主動感知與反應能力的對抗防御框架 , 該框架(如下圖所示)通過感知模塊與策略模塊的協同 , 使系統具備了與環境主動交互、迭代采集信息并增強自身魯棒性的能力 。

△圖1:REIN-EAD框架

REIN-EAD由兩個核心的循環神經模塊組成 , 靈感來源于支撐人類活躍視覺系統的大腦結構:

感知模型負責在每一時間步綜合當前觀測與上一步的內部信念狀態 , 生成對環境狀態的增強表征 , 并據此預測當前的場景標簽。 該模型通過循環結構充分利用與環境交互獲得的序列信息 , 從而實現對復雜視覺輸入的魯棒理解;

策略模型則基于感知模型構建的內部環境理解 , 生成用于控制下一步感知行為的動作信號 , 即決定從哪個視角、以何種方式繼續采集信息 , 從而有策略地引導視覺系統執行目標驅動的主動感知任務 。

通過感知模型與策略模型的閉環聯動 , REIN-EAD實現了對抗防御過程中的“感知—決策—行動”一體化:

在每一時刻選擇長期最優的交互動作 , 并根據環境反饋不斷修正其內部表示 , 使得模型能從多步交互中獲取最具信息量的觀測反饋 。

這種主動防御機制突破了傳統靜態防御策略在魯棒性與適應性方面的瓶頸 , 顯著提升了系統面對未知攻擊時的識別與響應能力 。

基于累計信息探索的強化學習策略論文擴展了部分可觀察馬爾可夫決策過程(POMDP)框架以正式描述REIN-EAD框架與環境的相互作用 。

場景 下的交互過程用 表示 。

這里 分別表示狀態、動作和觀測空間 。 場景 下的狀態轉移 符合馬爾可夫性質 。

由于環境的部分可觀察性 , 智能體不能直接訪問狀態 , 而是接收從觀察函數 采樣的觀察值 。

REIN-EAD的預測過程是多步條件下的連續觀測和循環預測 , 感知與動作循環依賴——感知指導了動作 , 而動作又獲得更好的感知 。

直觀上 , 可以通過RNN Style的訓練方式優化多步條件下的EAD框架 , 然而 , 該過程涉及沿時間步反傳梯度 , 團隊證明了這種做法的缺陷 。

首先 , 論文通過理論分析證明RNN Style的訓練方式本質上是一種貪婪探索策略:

這種貪婪探索策略可能導致EAD采用局部最優策略 , 難以從多步探索中持續獲益 。

△圖2:貪婪信息探索可能導致重復探索

第二 , 沿時間步反傳梯度要求狀態轉移函數和觀察函數必須具有可微分性 , 該性質在現實環境和常用的仿真引擎(如UE)中都是不滿足的 。

最后 , 在多步條件下反傳梯度需要構建非常長的梯度鏈條 , 這可能導致梯度消失/爆炸 , 并帶來巨大的顯存開銷 。

為了解決貪婪策略的次優性 , 提高REIN-EAD的性能 , 論文引入了累積信息探索的定義:

以及多步累積交互目標:

其中 ,是探索軌跡 ,表示時間步 的預測損失 ,作為正則化項 , 表示時間步 的標簽預測熵 , 阻止智能體做出具有對抗特征的高熵預測 。

多步累積交互目標包含最小化預測損失的目標項和懲罰高熵預測的正則項 , 通過一系列與環境的相互作用 , 在 步的范圍內優化策略 , 最小化目標變量的長期不確定性 , 而不是只專注于單步 。

該目標通過一系列行動和觀察來最小化目標變量的不確定性 , 結合預測損失和熵正則化項 , 鼓勵智能體達到信息豐富且魯棒的認知狀態 , 從而對對抗擾動具有魯棒性 。

論文中對所提出的多步累積交互目標與累積信息探索的定義一致性進行了證明 , 并進一步分析了累積信息策略相比貪婪信息策略的性能優越性 。

為了進一步消除對可微分訓練環境的依賴并降低梯度優化的不穩定性 , 論文中提出了一種結合了面向不確定性的獎勵塑形的強化策略學習方法 。

面向不確定性的獎勵塑形在每一步提供密集的獎勵 , 促使策略 尋求新的觀察結果作為來自環境的反饋 , 解決了多步累積交互目標中的只能在回合結束時獲得獎勵的稀疏性問題 , 減輕了探索和利用分配的挑戰 , 促進了更快的收斂和更有效的學習 。

論文中還證明了這種獎勵塑形與多步累積交互目標的等價性(細節參見論文) 。

對于強化學習主干 , 論文中采用了學習效率和收斂穩定性較好的近端策略優化(PPO) , 通過限制策略的大小來實現穩定的策略更新 。

離線對抗補丁近似技術論文中還提出了離線對抗補丁近似(OAPA) , 以解決3D環境中對抗訓練的計算開銷 。

對抗補丁 的計算通常需要內部最大化迭代 , 這不僅計算昂貴 , 還可能導致防御對特定攻擊策略過擬合 , 從而阻礙模型在未知攻擊中推廣的能力 。

為了在保持對抗不可知性的同時提高采樣效率 , 論文在訓練REIN-EAD模型之前引入了OAPA , 通過預先對視覺主干進行投影梯度上升得到一組替代的補丁作為對抗補丁流形的離線近似 。

實驗結果表明 , 執行這種離線近似最大化允許REIN-EAD模型學習緊湊而富有表現力的對抗特征 , 使其能夠有效地防御未知攻擊 。

此外 , 由于這種最大化過程只在訓練前發生一次 , 因此大大提高了訓練效率 , 使其與傳統對抗訓練相比更具有競爭力 。

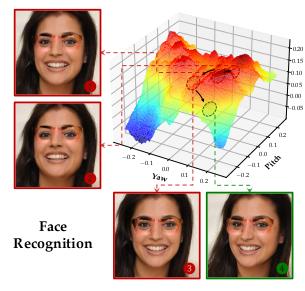

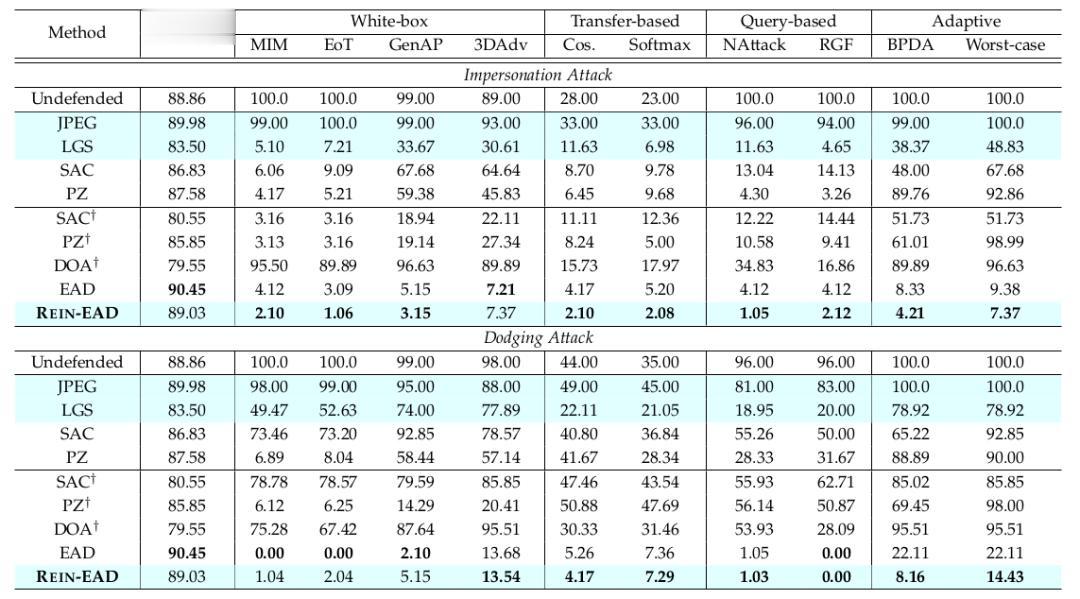

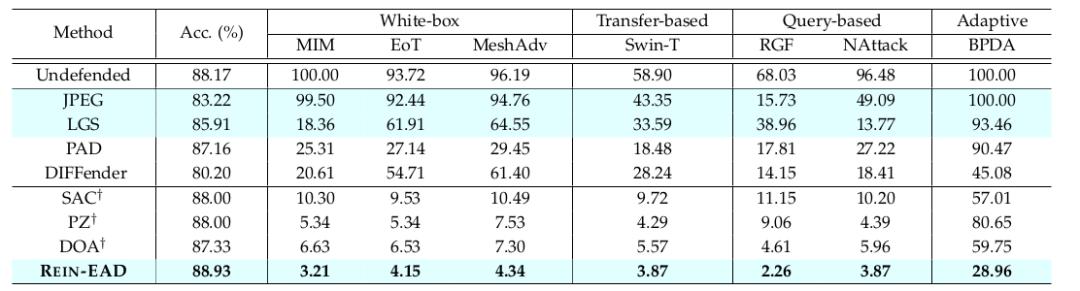

實驗與結果論文中在人臉識別、3D物體分類、目標檢測多個任務上使用一系列像素空間、隱變量空間下的白盒、黑盒、自適應攻擊方法 , 結果表明在三個任務上REIN-EAD的效果都優于SAC、PZ、DOA等基線防御(表1 , 3 , 4) 。

△表1:人臉識別任務中逃逸和扮演兩種攻擊目標下的結果

人臉識別任務中 , 通過REIN-EAD框架改進IResNet50模型 , 使用EG3D可微分渲染器實現CelebA-3D數據集的可微分三維重建 , 以對累計探索的REIN-EAD與ICLR 2024 工作中貪婪探索的EAD進行公平比較 。

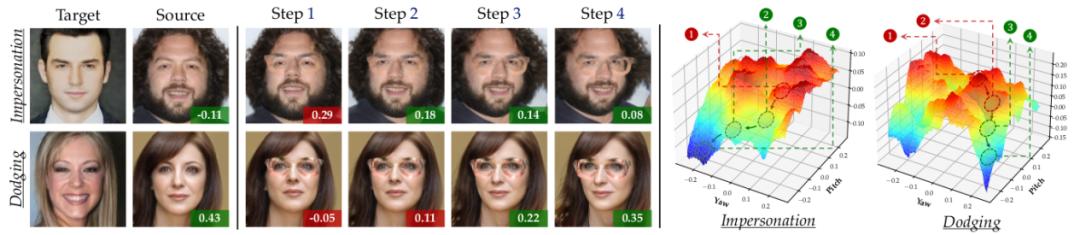

通過對各個組件的消融 , 分別證明了累計信息探索和OAPA的有效性(表1 , 2 , 圖3) 。

△表2:人臉識別任務中的REIN-EAD模塊消融結果

△圖3:人臉識別實驗的REIN-EAD可視化示例

人臉識別實驗的可視化動態示例

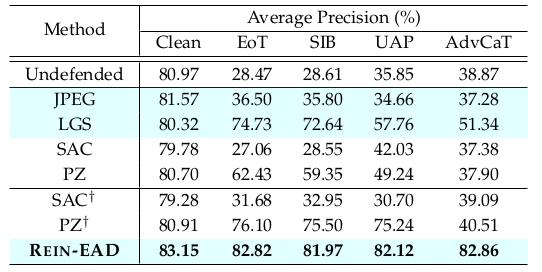

在物體分類任務中 , 通過REIN-EAD框架改進Swin-S模型 , 使用Pytorch3D對OmniObject3D三維掃描物體數據集進行可微分渲染 , 以在三維環境下的圖像分類任務上對REIN-EAD的通用性進行評估(表3) 。

盡管在早期步驟中REIN-EAD可能被對抗補丁欺騙做出錯誤預測 , 但在隨后的步驟REIN-EAD進行了正確的自我修正(圖4) 。

△表3:物體分類實驗結果

△圖4:物體分類實驗的REIN-EAD可視化示例

目標檢測任務中 , 通過REIN-EAD框架改進YOLO-v5模型 , 使用CARLA構建具有真實渲染觀測的實驗場景 , 進一步證明了REIN-EAD在復雜任務和現實場景的有效性(表4 , 圖5) 。

△表4:目標檢測實驗結果

△圖5:目標檢測實驗的REIN-EAD可視化示例

目標檢測實驗的可視化動態示例

此外 , 論文中還對補丁大小、補丁形狀、攻擊強度等多個不同的攻擊對手策略進行了補充實驗 , 以全面的驗證REIN-EAD面對未知攻擊對手的泛化能力 。

本文提出的REIN-EAD是一種新的主動防御框架 , 可以有效地減輕現實世界3D環境中的對抗補丁攻擊 。

REIN-EAD利用探索和與環境的交互來將環境信息語境化 , 并改進其對目標對象的理解 。

它積累了多步相互作用的時間一致性 , 平衡了即時預測精度和長期熵最小化 。

實驗表明 , REIN-EAD顯著增強了魯棒性和泛化性 , 在復雜任務中具有較強的適用性 , 為對抗防御提供了不同于被動防御技術的新研究視角 。

論文:https://arxiv.org/abs/2507.18484

代碼:https://github.com/thu-ml/EmbodiedActiveDefense

推薦閱讀

- AirPods即將加入實時翻譯功能,但國內用戶可能暫時無法體驗

- 3秒啟動1分鐘完成體檢!首款純血鴻蒙手表華為Watch5深度體驗

- ARPO:智能體強化策略優化,讓Agent在關鍵時刻多探索一步

- 一句話查數據,效率提升百倍!對話大華股份周明偉解局AIoT智能體落地潮

- 對話丨禾賽科技劉興偉:激光雷達降本加速智能車與機器人場景滲透

- 千元機也有流暢性能體驗 榮耀X70游戲性能評測

- 陷入瓶頸還是黎明前的黑暗,聊聊智能手表芯片

- HBM4,路線各不同

- 紅米K90系列再次被確認:一體冷雕玻璃+LTPS屏,Deco花活兒引期待!

- 再見了,實體卡!華為首推,蘋果跟進,三大運營商重啟eSIM