文章圖片

文章圖片

文章圖片

清華大學朱軍教授團隊 ,NVIDIA Deep Imagination 研究組與斯坦福 Stefano Ermon 團隊聯合提出了一種全新的擴散模型強化學習(RL)范式 ——Diffusion Negative-aware FineTuning (DiffusionNFT) 。 該方法首次突破現有 RL 對擴散模型的基本假設 , 直接在前向加噪過程(forward process)上進行優化 , 在徹底擺脫似然估計與特定采樣器依賴的同時 , 顯著提升了訓練效率與生成質量 。 文章共同一作鄭凱文和陳華玉為清華大學計算機系博士生 。

論文標題:DiffusionNFT: Online Diffusion Reinforcement with Forward Process 論文鏈接:https://arxiv.org/abs/2509.16117 代碼倉庫:https://github.com/NVlabs/DiffusionNFT

背景 | 擴散模型的 RL 困境

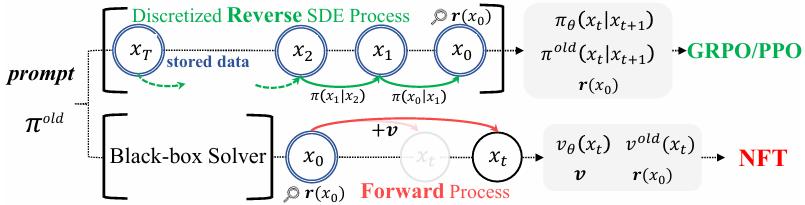

近年來 , 強化學習在大語言模型(LLMs)后訓練中的巨大成功 , 催生了人們將類似方法遷移到擴散模型的探索 。 例如 , FlowGRPO 等方法通過將擴散采樣過程離散化為多步決策問題 , 從而在反向過程上應用策略梯度優化 。 然而 , 這一思路存在多重根本性局限:

1. 似然估計困難:自回歸模型的似然可精確計算 , 而擴散模型的似然只能以高開銷近似 , 導致 RL 優化過程存在系統性偏差 。

2. 前向–反向不一致:現有方法僅在反向去噪過程中施加優化 , 沒有對擴散模型原生的前向加噪過程的一致性進行約束 , 模型在訓練后可能退化為與前向不一致的級聯高斯 。

3. 采樣器受限:需要依賴特定的一階 SDE 采樣器 , 無法充分發揮 ODE 或高階求解器在效率與質量上的優勢 。

4.CFG 依賴與復雜性:現有 RL 方案在集成無分類器引導 (CFG) 時需要在訓練中對雙模型進行優化 , 效率低下 。

因此 , 如何設計一種既能保留擴散模型原生訓練框架 , 又能高效融入強化學習信號的統一方法 , 是亟待探索的問題 。

方法 | 基于前向過程的負例感知微調

DiffusionNFT 提出了一個全新的思路:把強化學習直接作用于擴散的前向加噪過程 , 而非反向去噪軌跡 。 這一設計帶來了范式性的轉變 。

核心機制包括:

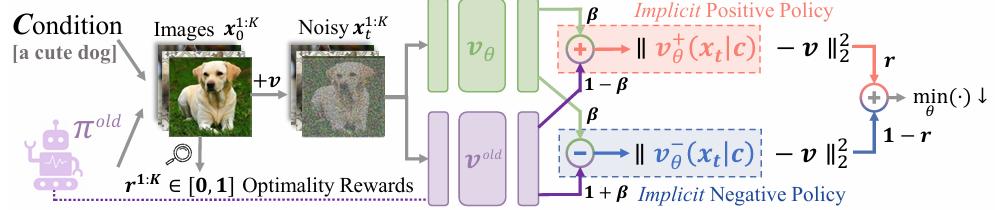

正負對比的改進方向:在采樣生成中 , 利用獎勵信號將樣本劃分為正例與負例 , 從而定義出一個隱式的 “改進方向” 。 與只使用正樣本的拒絕采樣微調(Rejection FineTuning RFT)不同 , DiffusionNFT 顯式利用負樣本信號 , 確保模型有效 “避開” 低質量區域 。

負例感知微調 (Negative-aware FineTuning NFT):通過一種巧妙的隱式參數化方式 , 從目標模型同時定義正向策略與負向策略 , 將正負分布對比轉化為單一網絡的訓練目標 , 不需額外判別器或引導模型 。

強化指導 (Reinforcement Guidance):在數學上 , DiffusionNFT 將優化目標刻畫為對舊策略分布的偏移量 ? , 這一過程與 CFG 類似 , 但不依賴雙模型結構 , 而是內生于訓練目標中 。

這樣的設計使 DiffusionNFT 同時滿足以下優勢:

1. 前向一致性:訓練目標嚴格符合擴散的 Fokker–Planck 方程 , 不破壞與前向過程的一致性 , 使得訓練后的模型仍然是良定義的擴散模型 。

2. 采樣器自由:訓練與采樣徹底解耦 , 可使用任意黑盒 ODE/SDE 求解器 , 擺脫對一階 SDE 的依賴;同時在訓練時只需存儲最終樣本與對應獎勵值 , 無需整條采樣軌跡 。

3. 似然無關:不再需要變分下界或反向軌跡似然估計 , 訓練只依賴生成圖像與獎勵 。

4.CFG-free 原生優化:直接學習到獎勵引導的生成能力 , 避免 CFG 的推理開銷 , 同時仍可兼容 CFG 進一步提升性能 。

實驗 | 高效性與生成質量

【清華、NVIDIA、斯坦福提出:基于前向過程的擴散強化學習新范式】研究團隊在多個獎勵模型上驗證了 DiffusionNFT 的有效性 。 主要結果包括:

大幅效率提升:在 GenEval 任務上 , DiffusionNFT 僅需 1k 步 即可將得分從 0.24 → 0.98 , 而 FlowGRPO 需超過 5k 步才能達到 0.95 。 整體上 , DiffusionNFT 在不同任務上表現出 3×~25× 的訓練效率優勢 。

CFG-free 場景下顯著提升:即便完全不依賴 CFG , DiffusionNFT 也能在美感、對齊度等方面顯著優于原始模型 。

多獎勵聯合優化:在 SD3.5-Medium 上同時優化 GenEval、OCR、PickScore、ClipScore、HPSv2.1 等多種獎勵 , 最終模型在所有指標上均超越原始模型 , 與只針對單一獎勵進行優化的 FlowGRPO 持平 , 并超過更大規模的 SD3.5-L 與 FLUX.1-Dev 模型 。

展望 | 向統一的生成對齊范式邁進

DiffusionNFT 的提出 , 不僅為擴散模型的強化學習提供了一個高效、簡潔且理論完備的新框架 , 也對更廣泛的生成模型對齊研究具有啟發意義 。 從語言模型到視覺生成 , DiffusionNFT 展示了負例感知 + 前向一致性普適價值 。 它打破了似然估計與反向軌跡的限制 , 建立起監督學習與強化學習之間的橋梁 。 在未來 , DiffusionNFT 有望推廣至多模態生成、視頻生成以及大模型對齊等更復雜場景 , 成為統一的生成優化范式 。

推薦閱讀

- iOS 26.1 Beta 2 七大亮點搶先看:多任務回歸、外接麥克風更強大!

- 國產CPU,成為主流!運營商已對intel、AMD說不了

- 8GB顯卡、6核心CPU:死亡倒計時!

- Insta360最新全景綜述:全景視覺的挑戰、方法與未來

- iPadOS 26正式版來了:鎖屏、文件管理、生成圖像,功能全解析!

- 清華大學集成電路學院副院長唐建石:高算力芯片,如何突破瓶頸?

- 10 月新機大爆發:小屏、中屏、大屏全都有!

- OpenAI結盟三星、SK:鎖定每月90萬片DRAM和90萬片HBM晶圓供應!

- 清華大學集成電路學院教授王志華:智能時代的中國集成電路

- CUDA內核之神、全球最強GPU程序員?OpenAI的這位幕后大神是誰