文章圖片

文章圖片

文章圖片

金磊 發自 凹非寺

量子位 | 公眾號 QbitAI

超大規模MoE模型(如DeepSeek) , 到底該怎么推理才能做到又快又穩 。

現在 , 這個問題似乎已經有了標準答案——

華為一個新項目 , 直接把推理超大規模MoE背后的架構、技術和代碼 , 統統給開源了!

這個新開源項目名叫Omni-Infer , 整體來看 , 它對于企業用戶來說是非常利好的 。

例如它可以給企業提供PD分離部署方案 , 針對QPM進行系統級優化 , 還會分享大規模商用過程中硬件使用的“方法論” 。

而且對于開發者和開源社區 , 華為這“一呼”也是起到了“百應”的效果 。

北京智源研究院副院長兼總工程師林詠華表示:

北京智源研究院一直以來致力于人工智能開源生態建設 , 很高興看到Omni-infer項目開源 , 智源團隊打造的面向多芯片的FlagScale框架也在第一時間接入了Omni-infer , 期待后續有更多生態合作 。

GitHub地址:https://github.com/FlagOpen/FlagScale/pull/630

上海人工智能實驗室系統平臺中心負責人王輝認為:

DeeLlink致力于打造最開放兼容的人工智能計算體系 , 十分期待能與Omni-infer項目攜手 , 繁榮自主軟硬件協同開源社區、拓展生態版圖 。

以及OpenI啟智社區運營中心主任余躍也給出了響應:

OpenI啟智社區堅持創新為本 , 面向未來與Omni-Infer項目一起打造基于算力網的開源共創協作生態 。

據了解 , 華為Omni-Infer社區的定位是 “加速套件+最佳實踐” , 未來提供開箱即用能力 , 支持昇騰推理集群快速部署 。

而對于這次Omni-Infer的開源 , 其實是華為兌現了一個月前在發布重磅技術報告之際所做出的承諾 。

那么接下來 , 我們就來一同深入了解一下華為的Omni-Infer 。

一個框架和一個套件從整體來看 , Omni-Infer可以拆成兩大塊來看:一個是推理框架 , 一個是推理加速套件 。

從框架角度來看 , Omni-Infer能和業界主流的開源大模型推理框架(如vLLM)完美兼容 , 就像不同品牌的零件可以組裝在同一臺機器上 。

并且據了解 , 它的功能還將不斷擴展 , 會持續為昇騰硬件平臺上的大模型推理提供更強大的支持(例如SGLang等主流開源LLM推理框架) 。

值得一提的是 , Omni-Infer是與vLLM/SGLang等等這些主流大模型推理開源框架是解耦的 , 獨立安裝 。

這就意味著用戶只需維護vLLM等的主版本即可 , 大大降低了軟件版本維護的成本 。

至于Omni-Infer的加速套件 , 若是用較為形象的比喻 , 它的“打開方式”是這樣的:

企業級的 “調度員”:它有一套智能的調度系統 , 就像交通警察指揮車輛一樣 , 能合理安排任務(xPyD調度) 。 而且支持大規模分布式部署 , 就像多個交通崗亭協同工作 , 不管任務量多大 , 都能保證最低的延遲 , 讓響應更及時 。 精準的 “負載平衡器”:對于不同長度的任務序列 , 它在預填充和解碼這兩個關鍵階段都做了優化 。 比如 , 就像快遞分揀中心針對不同大小的包裹采用不同的分揀策略 , 讓整個處理過程的吞吐量達到最大 , 同時還能保持低延遲 。 MoE模型的 “專屬搭檔”:它對混合專家(MoE)模型特別友好 , 支持EP144/EP288等多種配置 。 可以想象成一個大型的 “專家團隊” , 每個專家負責不同的任務 , 它能讓這些專家高效協作 。 智能的 “資源分配者”:具備分層非均勻冗余和近實時動態專家放置功能 。 就像在一個大型工廠里 , 根據實時的生產需求 , 動態調整各個生產線的工人分配 , 讓資源得到最充分的利用 。 注意力機制的 “強化器”:專門為LLM、MLLM和MoE等模型優化了注意力機制 。 這就好比給模型的 “注意力” 裝上了 “放大鏡” , 讓它在處理信息時更聚焦、更高效 , 提升了模型的性能和可擴展性 。 如何“食用”?在聊完Omni-Infer的特點之后 , 我們繼續來看下該如何去體驗 。

首先對于它的使用環境是有一定的要求:

硬件:目前僅支持CloudMatrix384推理卡 操作系統:Linux Python:=3.9= 3.11其次在安裝方式上 , 目前僅支持通過Docker鏡像方式進行安裝:

dockerpull swr.cn-southwest-2.myhuaweicloud.com/omni-ai/omniinfer:202506272026 【華為又開源了個大的:超大規模MoE推理秘籍】這個鏡像已預先集成所需的CANN及Torch-NPU依賴包 , 同時內置可直接運行的Omni-Infer與vLLM工具包 , 開箱即可使用 。

可以使用下面這個命令檢查是否可用:

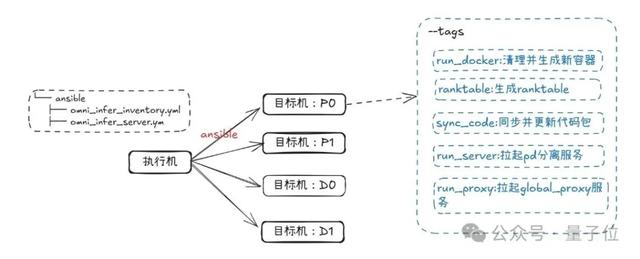

piplist | grep omni_infer以PD分離自動化部署(4機2P1D)為例 , 它的部署框架如下所示:

再接下來 , 只需文檔教程 , 僅少量代碼和步驟 , 即可完成安裝和部署:

整體來看 , 此次華為面向超大規模MoE開源的項目 , 是做到了簡單幾步就可以讓AI推理這事變得又快又穩 。

極致開源Omni-Infer除了將此前《華為昇騰服務器 DeepSeek V3/R1 推理部署最佳實踐》技術報告中的關鍵技術開源出來之外 , 也同步進行了更加專業的開源社區建設 。

首先 , 在獨立的社區倉庫中 , 將社區治理、社區會議、社區活動、生態合作、代碼規范、設計文檔等社區信息全部開放出來 , 讓開發者能夠最直接深入的參與到社區發展中 。

其次 , 參照業界主流大型開源社區的最佳實踐 , 采用開放的社區治理機制 , 通過項目管理委員會(Project Management Committee)和特別興趣小組(Special Interest Group)兩級機制 , 提供公正透明的討論與決策機制 。

再次 , 針對業界同類開源項目大多存在的“一頭熱”的“被動適配”生態合作模式問題 , Omni-Infer社區則采取了“主動適配”的社區構筑路徑 , 尤其是主動擁抱國內正在逐步成長的人工智能開源項目 , 讓生態真正實現多方共贏 。

作為長期與業界幾大主流開源基金會(Linux基金會、OpenInfra基金會、Apache基金會等)保持緊密合作關系的社區團隊 , Omni-infer剛開源的首個活動就將參與OpenInfra基金會在蘇州的Meetup , 感興趣的同學可以到現場交流 , 也順路可參加有特色的全球性開源社區的生日活動 。

最后 , 所有相關的地址放下面了 , 感興趣的小伙伴可自取哦~

技術報告及可分析代碼包:https://gitcode.com/ascend-tribe/ascend-inference-cluster

源代碼開發協作:https://gitee.com/omniai/omniinfer

社區治理、運作等內容:https://gitee.com/omniai/community

【其他托管平臺】

Github:https://github.com/omni-ai-npu/omni-infer

OpenI啟智社區:https://git.openi.org.cn/omni-ai/omni-infer

GitLink確實平臺:https://gitlink.org.cn/omni-ai/omniinfer

— 完 —

量子位 QbitAI · 頭條號

關注我們 , 第一時間獲知前沿科技動態

推薦閱讀

- 2025年最耐用的4款千元機,機身耐摔又防水,最低僅1019元

- 手機聲音小,是這個開關沒打開,打開后,聲音清晰又洪亮

- 華為流程體系拆解系列:L1-L6分層拆解邏輯

- 華為入選《時代周刊》全球100影響力企業:自主研發支撐品牌韌性

- 華為Pura80 Ultra變身專業攝像機!鐵頭3299元攝影套裝都有啥?

- 華為官方合作出品!Pura80Ultra喜提攝影套裝,價格有點小貴

- 華為小折疊殺入5K檔:Pocket 2優享版性能僅縮水5%?

- 華為放棄高利潤!頂級拍照手機突降3650元,16G+512G+雙衛星通信

- 華為Pura XT浮出水面:新專利+新形態,國產友商面臨挑戰

- 華為宣布重要決定:正式開源!