文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

iPhone 為智能手機領域帶來的革命之一 , 就是多點觸控屏幕 。 「觸控」也在此后的十八年里 , 逐漸成為了人們與電子設備交互的主要方式之一 。

但蘋果覺得:觸控還不夠 。

事實上 , 我們已經在 Vision Pro 上見到了基于視覺識別的純手勢交互 , 幾乎是目前 AR 設備中最無感的一種方案 。

而近期的一些新證據表明 , 蘋果也在嘗試另一種基于 Siri 的純語音的人機交互方案 。

圖片使用 Gemini 生成 , 因為 Image Playground 用不了

就在昨日 , 彭博社記者 Mark Gurman 在一篇最新的預測中指出:推遲到 26 年的 AI Siri , 有可能通過借助加強 App Intents 的方式 , 間接實現讓用戶完全以語音遙控的方式操作 iPhone。

這是一塊蘋果在 2024 年 WWDC 上就已經畫過的大餅了 。 在一則飽受虛假宣傳指責的廣告中 , 蘋果展示了女演員 Bella Ramsey 向 Siri 提問、Siri 跨應用收集信息并給出回答的場景:

廣告中 , Bella 向 Siri 提問一項活動的參與者名字 , Siri 通過快速調用日歷做出了回答|YouTube @QuirkyFilms

由于 Apple Intelligence 始終無法實現這樣的功能 , 這則廣告片目前已經被蘋果下架 , 而「更智能的 Siri 」也被推遲到了 2026 年 。

根據 Marc Gurman 的看法:AI Siri 遭到反復推遲這件事本身并不是什么大問題 , 比起磕磕絆絆的 AI Siri , 反而是這項功能所依托的另一項底層功能更值得關注——

全新的 AI Siri 如果想要實現蘋果在兩次 WWDC 與發布會上畫的那些大餅 , iOS 的 App Intents 功能必須在未來得到史詩級加強 。

圖|Fast Company

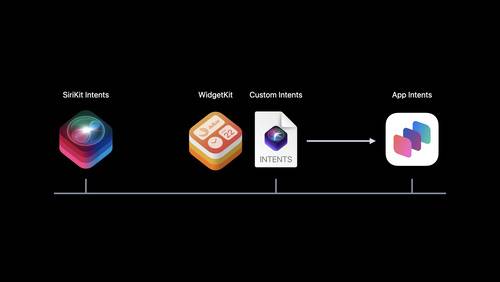

你或許沒有聽說過 App Intents 這個名字 , 這并不奇怪 , 因為它不是某個單獨的功能 , 而是 2022 年蘋果在 iOS 16 中推出的一個系統功能框架 , 取代了更早的 SiriKit Intents , 是一個主要面向開發者的功能 。

圖|Apple Developers

而 App Intents 的功能也如同它的名字一樣 , 主要用于展示一款 app 的「意圖」 。

就拿 iOS 的聚焦搜索(Spotlight)來說 , 除了直接查找 app 之外 , 我們其實還可以直接在這里輸入一些功能提示詞 , 比如「創建」或者「掃一掃」 , 系統就會自動拉起一些 app 內部的功能入口以供選擇:

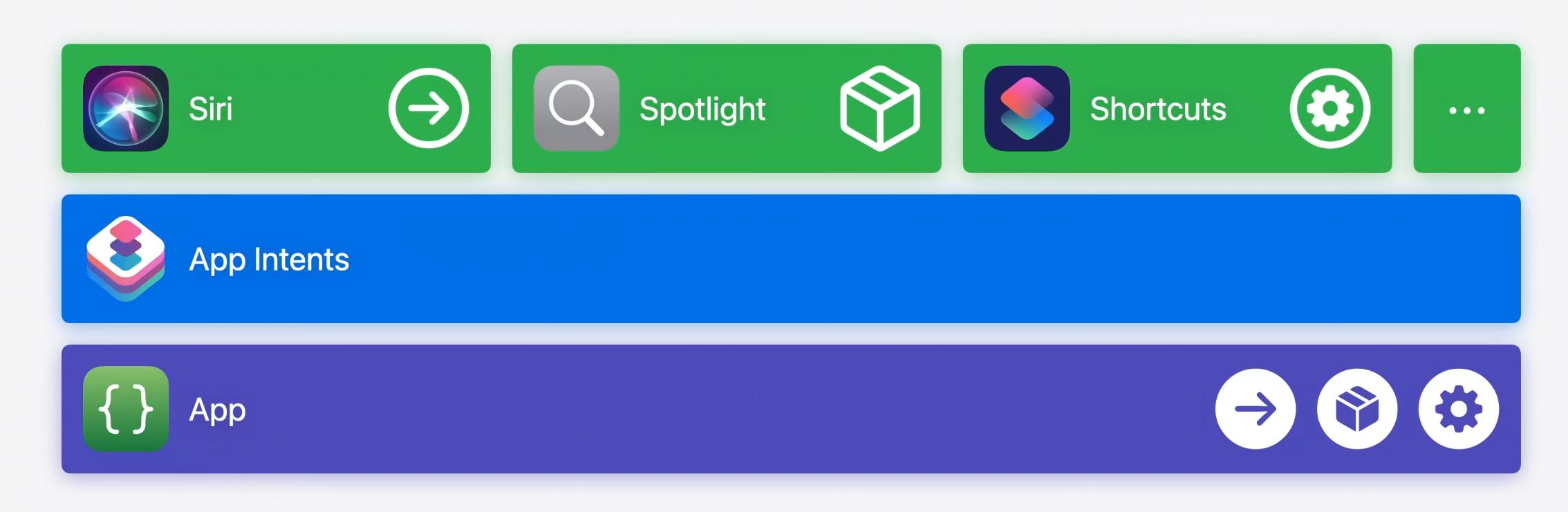

而這也很直觀的展示了 App Intents 的基本作用——給原本處在 app 內部的各種功能 , 創建一條「快捷通道」 , 并且將這些快捷通道的入口與 iOS 系統級功能(比如 Siri、聚焦搜索、捷徑等等)整合 , 讓用戶可以不打開 app 就快速調用 。

圖|Apple Developers

而這也正是 Marc Gurman 所預測的、新的 AI Siri 在未來能夠勝任更多復雜操作的基石 。

無獨有偶的是 , 類似的功能快捷入口并非蘋果獨享 , 華為的 HarmonyOS 中也有一個類似的服務叫做 Intents Kit , 負責連接系統入口與 app 或元服務內部的功能:

圖|華為開發者聯盟

不過目前由于蘋果的宣傳力度和入口限制 , 能夠在 iOS 中調用 App Intents 去執行操作的就只有上面提到的三大件—— Siri、聚焦搜索 , 以及捷徑 。

考慮到 Siri 過于拉胯、聚焦搜索用戶基數不高 , 因此使用頻率最高的就是通過捷徑調用了 。 現在各種快速記賬、裁剪照片添加水印、將前一天的照片統一發送到微信文件傳輸之類的捷徑 , 本質上都是經由 App Intents 在發揮作用 。

通過聚焦搜索直接跳轉執行支付寶內部的掃碼功能

而未來 AI Siri 領銜的自動化操作 , 參考目前捷徑對于 App Intents 的調用方式 , 愛范兒認為將會是一個很簡單的「兩步走」邏輯:

加強 App Intents 能夠直接調用的 app 功能 。 目前的 App Intents 框架需要開發者主動編寫 , 能夠覆蓋的 app 數量十分有限 , 蘋果后續可能通過新建 API 的方式讓系統直接讀取 app 功能列表 , 擴大 App Intents 的調用范圍 。Apple Intelligence 的語音模型可以幫助 Siri 更好的拆分和理解用戶的語音指令 , 并且利用 iPhone 上面的端側模型將自然語言指令轉換為依次調用 App Intents 的組合 , 從而實現復雜步驟的自動操作 。Marc Gurman 預測蘋果最早可能會在 2026 年的春季發布會上推出這套新 AI Siri + App Intents 的組合 , 屆時可以實現的操作可能類似于「嘿 Siri , 把昨晚吃飯拍的照片全部裁成正方形 , 發到 XXX 的微信 , 在下周六創建一個一樣的日程」 , 并且全程不需要動手點 iPhone。

圖|Lifehacker

只不過在那之前 , 這套新的語音操作方式還需要經過長期的測試 , 尤其是針對一些高風險的場景(比如支付寶收付款、或者聯網控制醫療器械等等)需要更加嚴格的 Siri 模型控制 , 在明年春季再遭推遲也不是不可能 。

而從產品的角度看 , 這樣一套完全基于語音的操作方式 , 雖然有可能最先落地在 iPhone 上 , 但未來能夠發光發熱的場景肯定不止智能手機 。

【「有嘴就行!」明年的新 Siri 可以讓你真正解放雙手的使用 iPhone】反而是 Apple Watch、HomePod , 甚至傳聞中的智能家居中控屏和桌面機器人 , 以及類似 Vision Pro 的 AR 設備 , 會成為純 Siri 語音交互的主要受益者 。

換句話說 , 這套 AI Siri 搭配增強版 App Intents 的「組合拳」 , 是一套上利無障礙用戶、下利新產品形態的全新交互系統 , 非常符合我們以往對于蘋果強大的軟硬件結合能力的想象 。

而蘋果現在唯一需要做的 , 就是如期把它交付出來 。

#歡迎關注愛范兒官方微信公眾號:愛范兒(微信號:ifanr) , 更多精彩內容第一時間為您奉上 。

愛范兒|原文鏈接· ·新浪微博

推薦閱讀

- 區別對待?為啥中/美版本iPhone 17系列電池尺寸有區別?

- 2025全球大模型應用報告:紅海混戰「忠誠度」瓦解,用戶腳踏4.7條船

- 華碩a豆攜手法國嬌蘭與「與未來香遇」,全新閃光禮盒重磅發布

- GPT-5問題太多,奧特曼帶團回應一切,圖表弄錯是因「太累了」

- 還有山寨機?iPhone17Pro遭提前復刻,估計還不如紅米百元機好用

- 從吹風機到剃須刀,徠芬如何用「硬實力」沖擊國際大牌?

- 驍龍8至尊版2曝光,但最有看點的地方并不是跑分

- 蘋果手機信號差有救了?爆料稱iPhone 17 Pro將增加環形天線

- 引入「凸額」設計!聯想ThinkPad上新,PC廠商為屏占比拼了

- GPT-5編程成績有貓膩!自刪23道測試題,關鍵基準還是自己提的