文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

僅憑一張照片 , 能否讓行人繼續行走、汽車繼續飛馳、云朵繼續流動 , 并讓你從任意視角自由觀賞?

南洋理工大學 S-Lab 攜手上海人工智能實驗室 , 給出肯定答案 ——4DNeX 。 作為全球首個僅依賴單張輸入即可直接輸出 4D 動態場景的前?。 ╢eed-forward) 框架 , 4DNeX 擺脫了游戲引擎與合成數據的束縛 , 首次大規模利用真實世界動態影像進行訓練 , 實現「時空視頻」的高效、多視角、高保真渲染 。

在多項基準測試中 , 4DNeX 以顯著優勢超越 Free4D、4Real 等當前最佳方法 , 真正把「一張圖生成四維世界」的科幻概念帶進了現實 。

論文鏈接:https://4dnex.github.io/4DNeX.pdf 項目主頁:https://4dnex.github.io/1. 研究背景

世界模型正成為 AI 研究的高頻熱詞 。Google DeepMind 近期迭代的 Genie 3 已能在高質量游戲數據上生成長達數分鐘的交互式視頻 , 但目前尚且缺乏在諸多真實場景上的驗證 。

世界模型發展的一個重要拐點在于:讓模型學會刻畫我們身處的動態 3D 世界 , 并服從其物理定律 。唯有如此 , 生成的內容才能既逼真又可導 , 進而支持「反事實」推演 —— 在虛擬中重放、預測甚至改寫現實 。 這一能力不僅可構成下一代 AR/VR 與具身智能的重要研究基石 , 更是邁向可信 AGI 的必經之路 。

構建 4D 世界模型的關鍵能力 , 在于能否持續產出高保真、可擴展的 4D 內容 , 其主要在于以下三個方面的研究:

數據 – 相較于游戲等引擎合成的數據 , 真實采集的數據雖能保留物理屬性 , 卻難以大量獲取 , 更難標注; 表征 - 如何兼顧不同模態(如材質和幾何等)特性 , 設計選取高效的 3D/4D 表征仍是學界長久未竟的科研命題; 架構 – 當前的不同生成模型架構互有優劣 , 如何更好地繼承現有模型先驗 , 保障高質量仍需探索 。鑒于此 , 「真實高效」的 4D 世界模型構建非常重要 , 也充滿挑戰 。

2. 4DNeX-10M Dataset

近千萬幀帶 4D 標注的視頻集

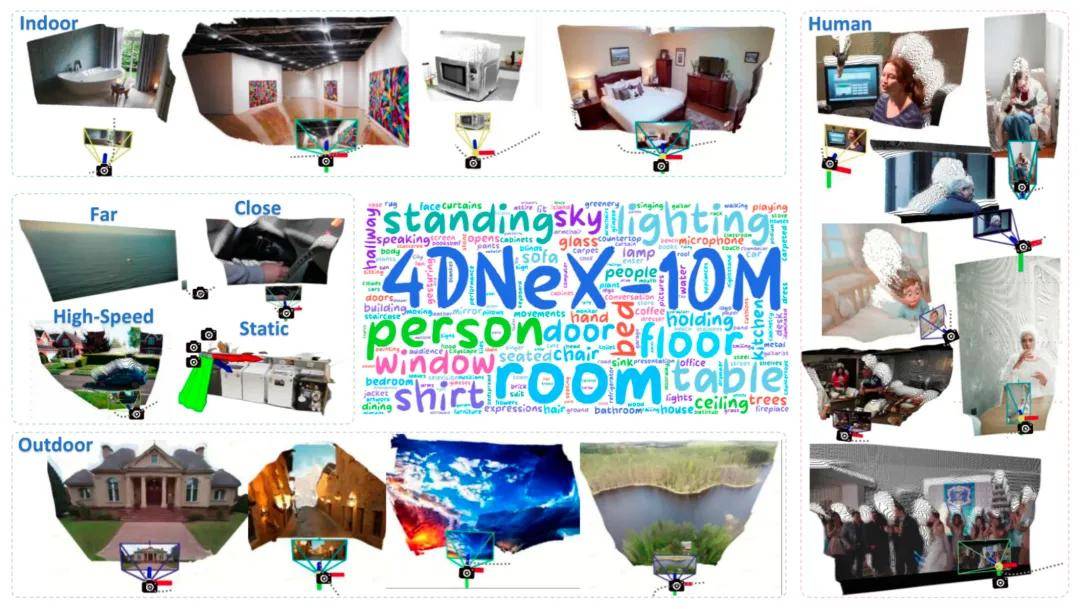

為破解高質量真實 4D 數據稀缺的瓶頸 , 4DNeX 首度發布 4DNeX-10M—— 近千萬幀、多場景、帶偽標簽的超大規模 4D 視頻數據集 。 其覆蓋室內外環境、自然景觀與人體運動等多元主題 , 尤以海量「以人為中心」的 4D 數據為特色 , 囊括豐富的物理屬性、動態細節與交互行為 , 為 4D 世界模型的構建奠定堅實基礎 。

【一張圖,開啟四維時空:4DNeX讓動態世界 「活」起來】圖 1 4DNeX-10M Dataset 包含了不同來源且豐富多樣的動態數據

為支撐 4DNeX-10M 的構建 , 研究者們同步設計了一條全自動的數據–標注管線(見下圖) 。

數據源:單目實拍視頻數據 , 其中動態場景取自 Pexels、Vimeo 等公開視頻庫;靜態場景則整合 RealEstate-10K、DL3DV 等 。 首輪清洗:基于光流一致性、亮度統計、運動強度及 OCR 文字檢測 , 剔除低質片段 。 標簽制作: 內容:LLaVA-Next Video 給視頻片段打標 。 幾何:靜態場景使用 Dust3R 三維重建 , 動態場景使用 Monst3R / MegaSam 四維重建 , 輸出 Semi-Dense 3D/4D 點云圖、幾何標簽 。 質量把關:聯合置信度(MCV、HCPR 等)與運動平滑度等多重閾值 , 篩除幾何漂移或動態異常序列 。最終打標完成的 4DNeX-10M 數據集構成如圖右下角統計所示 。

圖 2 4DNeX-10M 構建管線以及數據統計情況

3. 4DNeX 方法架構

表征選取

在 4D 內容生成中 , 傳統「4D」指 3D 空間幾何外加時間軸;而在世界模型的語境下 , RGB 視頻攜帶的材質、光照與語義信息同樣關鍵 。 4DNeX 因而提出 6D 統一表征:以 RGB 序列刻畫外觀(3 維)并以 XYZ 序列編碼幾何(3 維) 。 該設計無需顯式相機控制 , 即可同步生成多模態內容 , 兼顧真實感與物理一致性 。

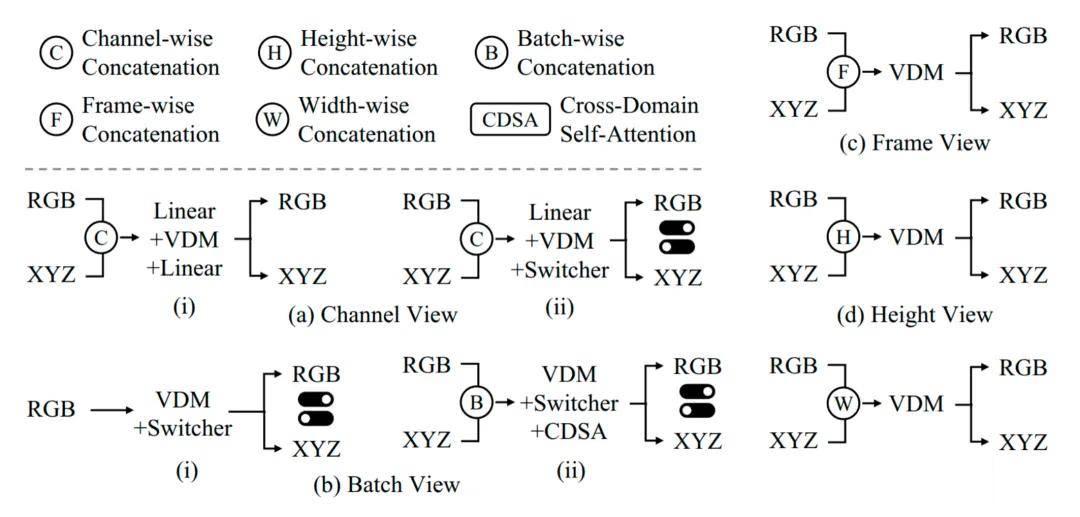

圖 3 不同的 RGB 和 XYZ 模態融合策略

算法框架

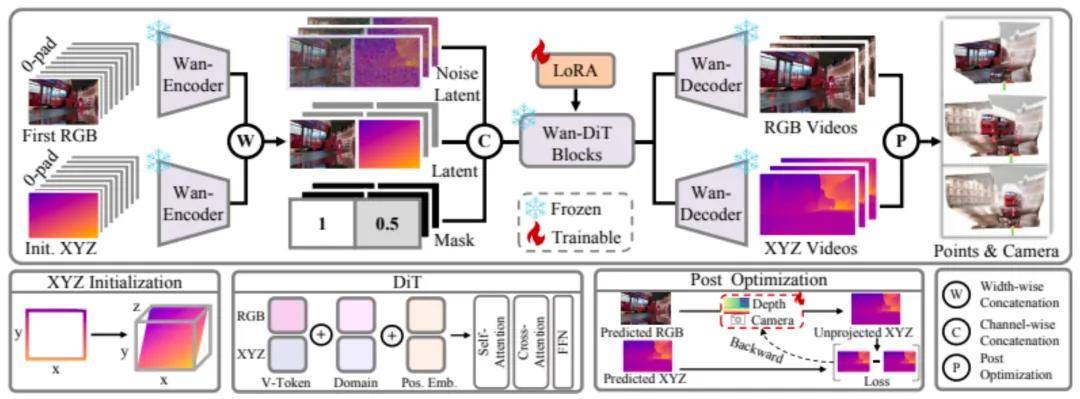

4DNeX 框架的技術突破在于「寬度融合」這一關鍵策略:系統比較五種方案后 , 研究者們發現將 RGB 與 XYZ 在 token 寬度維度直接拼接 , 可將跨模態距離壓到最低 。相比之下 , 通道融合會擾亂預訓練分布 , 批處理融合又無法保證對齊 。

圖 4 不同的空間融合策略對比

網絡骨架沿用 Wan2.1 視頻擴散模型 , 通過輕量級 LoRA 微調完成適配 , 主要的策略包括有:

輸入端以斜坡深度初始化 , 先驗地逼近自然場景的深度梯度; XYZ 坐標經歸一化校正 , 徹底消除 VAE 潛在空間的分布錯位; 軟掩碼機制在擴散過程中動態約束幾何細節 , 引導結構收斂; 旋轉位置編碼維持像素級 RGB-XYZ 對齊 。最后 , 僅需一次輕量重投影即可反算出相機參數 , 確保輸出在物理層面嚴密自洽 。

圖 5 4DNeX 框架總覽

4. 實驗結果

實驗驗證顯示 4DNeX 在效率與質量上實現雙重突破:VBench 測試中 , 其動態幅度達 100%(超越 Free4D 的 40.1%) , 時空一致性 96.8% 領先業界 。 用戶研究(23 人評估)更顯示 85% 用戶偏好其生成效果 , 尤其在運動幅度與真實感方面優勢顯著 。

生成效果可視化證明模型能力 —— 單圖輸入可輸出連貫動態點云序列(圖 5) , 新視角合成在真實場景(in-the-wild)中保持幾何一致性(下圖 6);與 Animate124、4Real 等基線對比(下圖 7) , 4DNeX 在樹葉搖曳幅度、人體動作自然度等細節表現更優 。

圖 6 4DNeX 生成的視頻效果(RGBPoint Map)

圖 7 4DNeX 生成未經訓練真實世界視頻的新視角視頻

圖 8 4DNeX 對比其他方法的生成效果

User Study 用戶調研結果顯示 4DNeX 生成的效果優于 Free4D、4Real、Animate124、GenXD 方法 。

表格 1 User Study 結果對比

消融實驗

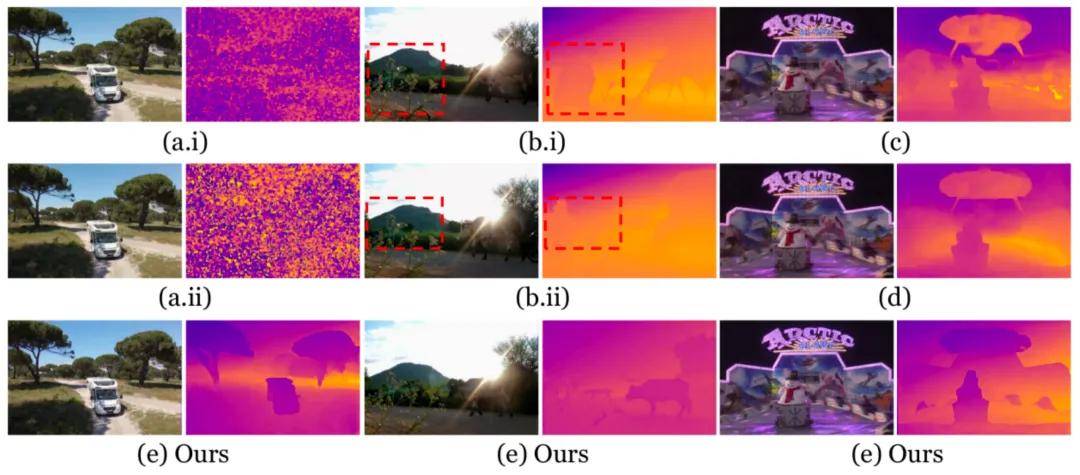

研究者們還對比了五種融合 RGB 以及 XYZ 的策略 , 以發現最佳的多模態融合策略 。 實驗一步證實寬度融合策略的關鍵作用 , 消除其他方案(如通道融合)的噪聲或對齊失敗問題 。

圖 9 不同融合策略的結果可視化展示

文中視頻鏈接:https://mp.weixin.qq.com/s/_e4C5H6JzqlA1SHKip4USg

推薦閱讀

- 印度軟件外包業的AI大逃殺

- 榮耀Magic V Flip2開啟小折疊2億時代!全方位升級預定爆款

- NextStep-1:一次在圖像生成上自回歸范式的探索

- 小米新機外觀首曝,8 月 21 日見!

- 榮耀新機官宣:8月21日,全新登場

- 開啟玩家的極致視覺盛宴,技嘉MO27Q28G電競顯示器測評

- 微信更新,帶來一波新功能!

- iPhone 17 領銜,9 月 5 款小屏新機一覽!

- 魅族 22 真機曝光,外觀設計大改!

- GPU如何引領AI數據中心繁榮?