文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

衡宇 鷺羽 發自 凹非寺

量子位 | 公眾號 QbitAI

繼π0后 , 具身智能基座模型在中國也終于迎來了真正的開源——

剛剛 , WALL-OSS宣布正式開源!

在多項指標中 , 它還超越了π0 。

如果你是搞具身的開發者 , 了解它的基本資料 , 你就一定不會想錯過它:

它是一個通用基礎具身模型 , 泛化性和推理能力一流 , 你可以在自有本體上部署 , 快速微調后用起來 。

它還是一個多模態具身模型 , 輸入與輸出的數據 , 有語言、視頻、動作等多種形態 , 具備良好的因果推理、空間理解和反思能力 。

我們調研了一圈發現 , 在4.2B參數規模下 , 融合了超大規模的高質量真機數據進行預訓練的WALL-OSS , 是唯一一個具備語言、視覺、動作多模態端到端統一輸出能力的開源具身模型 。

這一波操作 , 不香都難 。

它憑什么這么能打?我們得從背后的團隊說起 。

用最近的流行梗來說 , 模型“基礎” , 背后團隊就不基礎——成立于2023年底的自變量機器人 。

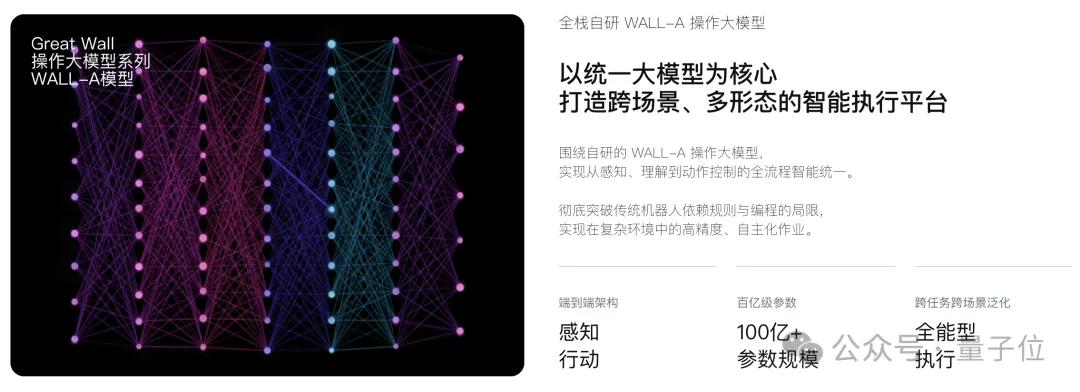

目前 , 分層架構與端到端模型是兩條具身的主要技術路徑 。 從成立起自變量就全身心押注后者 。 去年11月 , 團隊推出了WALL-A , 全球最大規模的端到端統一具身大模型 。

技術上屢有成果 , 資本市場也分外看好 。

就在今天 , 這支隊伍剛剛宣布完成了近10億元A+輪融資 。

阿里云、國科投資領投 , 國開金融、紅杉、渶策、美團、聯想之星、君聯資本都在這一輪股東名單之列 。

據了解 , 融來的這筆錢 , 大部分依舊投入全自研通用具身智能基礎模型的持續訓練 。

單卡訓練+開放泛化 , 所有輪式機器人都能跑僅需要RTX 4090級別的同等算力顯卡 , 開發者便能完成WALL-OSS從訓練到推理部署的全過程 。

更重要的是 , WALL-OSS在保證低成本訓練的同時 , 依舊實現了頂尖的泛化表現 。

在嚴格的ID(分布內)和OOD(分布外)評測中 , WALL-OSS展現出領先π0等同類開源模型的性能優勢 。

首先在泛化性上 , 即使是在指令描述、動作動詞、物體方位等要素發生變化的OOD場景下 , WALL-OSS依舊能保持高任務成功率和指令遵循度 , 展現出優異的環境適應性 。

在需拆解細分指令的長程任務中 , WALL-OSS也顯著優于采用扁平化策略的基線模型(如π0-flat) 。

在依賴CoT的推理類任務里 , WALL-OSS更是優于π0-flat和pi-gpt-prompt等強基線 。

此外通過空間VQA、視覺定位、場景語言描述等多模態基準測試驗證 , WALL-OSS不僅可以完整保留VLM的核心功能 , 還在原有基礎上實現了能力強化 。

這種對核心能力的扎實沉淀 , 讓它能同時兼顧推理規劃和動作執行 , 可輸出語言和動作雙模態 , 一些視覺信息也能以語言形式傳遞 。

值得注意的是 , WALL-OSS采用統一的Transformer架構 , 并通過專家分流機制實現語言、視覺、動作在統一框架下的生成與協同優化 。

這種真正意義上的端到端避免了多階段流程的誤差累計 , 極大提升了模型在長程和“推理+操作”復合任務上的穩定性和成功率 。

截至目前 , WALL-OSS填補了此參數區間內的高水平具身智能大模型的空白 , 成為業界唯一一個同尺寸下的面向物理世界交互、端到端路徑的具身智能統一模型 。

更重要的是 , WALL-OSS并不依賴特定場景優化 , 且具備跨場景遷移與執行能力——

從養老護理到工業裝配 , 從酒店服務再到物流分揀……一個真正意義上可以通用部署的具身大腦 , 展現出巨大的應用潛能 。

所以從現在起 , 無論是產業界做場景落地的團隊還是高校實驗室 , 甚至是極客愛好者 , 都可以部署最前沿的具身智能大模型 。

具體到硬件適配方面 , WALL-OSS可以通過微調 , 快速適配到不同本體上 , 極大地降低了機器人應用的落地 。

4大創新 , 讓4.2B模型擊碎具身智能“不可能三角”目前的具身智能界 , 存在著一個廣泛公認的技術難題:

【開放全棧!超越π0,具身智能基礎大模型迎來真·開源,開發者狂喜】如何在模態統一、動作精度和能力泛化之間達成平衡?

這個“三難困境” , 幾乎構成了當前具身智能模型的能力上探的絆腳石 。 市面上大多數模型通常只能做到一個 , 兩者兼顧已經很難 , 更別提三者具備 。

WALL-OSS是少數試圖正面破解這一結構性難題的模型之一:它在各項指標上均追求極限 , 并從架構到訓練范式 , 從數據構建到推理機制 , 進行了系統性重構 。

這讓模型在當前4.2B參數的體量下 , 實現了模態統一、推理泛化與動作生成的能力閉環 。

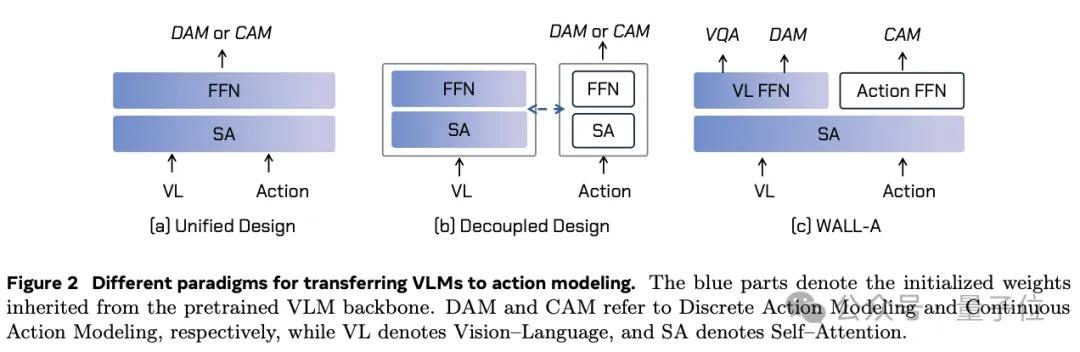

這背后的第一步 , 事關模型架構設計 。

WALL-OSS沒有采用傳統多模態拼圖式的堆疊結構 , 而是首創了“共享注意力 + 專家分流(FFN)”這一新架構 。

簡單來說 , 它將語言、視覺、動作等信息都嵌入在同一個表示空間中處理 , 通過共享注意力機制實現模態間的信息交叉 , 同時再通過專家FFN高效處理不同任務 。

這種設計有效避免了VLM知識遷移中的“災難性遺忘”和“模態解耦”兩大難題 , 在融合度更高的同時 , 又能保留每一模態的獨特表達能力 。

第二個關鍵點 , 是對數據質量及訓練策略的把控 。

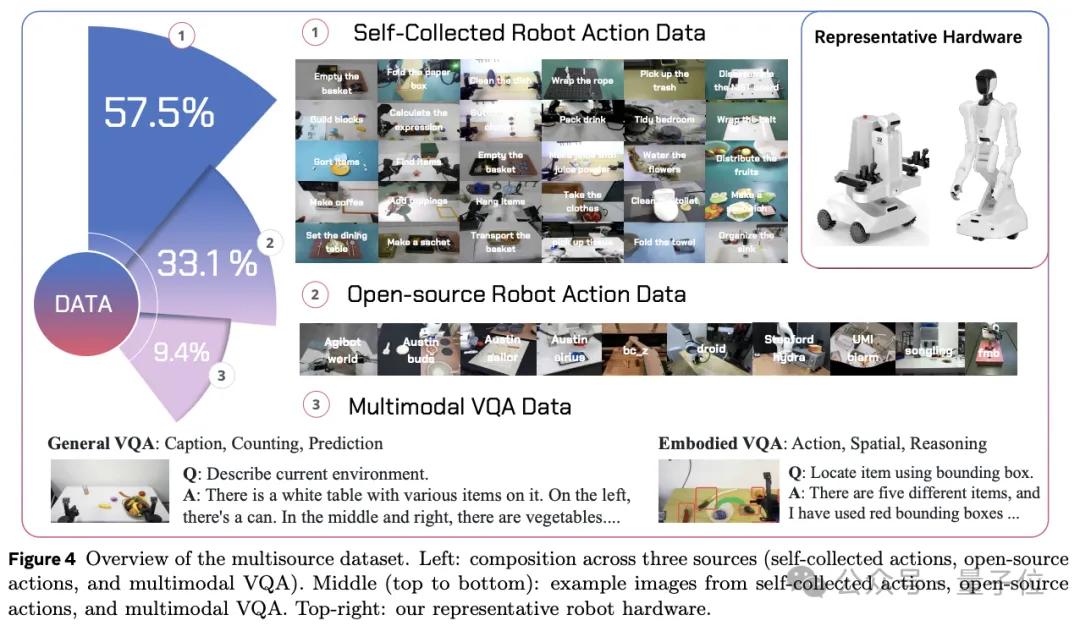

WALL-OSS背后 , 是大規模的VLA訓練集的支撐 , 其中主要包括大量自采高質量真機數據和具身多模態數據 。

值得注意的一點是 , 真機數據高質量、高精度 , 與真實世界高度貼合 , 是目前具身大模型中最好的數據源 。

在有了規模夠大、多樣性豐富、質量夠高的數據的基礎上 , 自變量團隊精心設計了訓練策略 。

傳統端到端訓練方式常常面臨一個問題:認知能力強的模型不一定能輸出精準動作 , 而擅長動作控制的模型則缺乏推理和規劃力 。

為了解決這一問題 , WALL-OSS設計了Inspiration Stage(啟發階段)和Integration Stage(融合階段)兩階段訓練策略 。

在Inspiration Stage階段 , 繼續使用原VLM的FFN結構 , 加入多種預訓練任務以增強空間+語義理解能力、引入Embodied VQA(具身視覺問答)任務 , 并引入離散動作學習 。

其核心目標是保持原始VLM能力不變的基礎上 , 增強其對空間結構和動作的初步理解 , 為后續動作生成打下感知語義基礎 , 避免“災難性遺忘” 。

Integration Stage階段則分為兩個子步驟 。

第一步 , 凍結VLM , 僅訓練動作模塊;第二步 , 解凍VLM , 聯合優化全模型 。

如此這般 , 模型能從語言和視覺輸入中連續生成高頻物理動作 , 既保留了VLM的語言與視覺理解能力 , 又具備細粒度動作執行力 , 建立統一、協同、緊耦合的跨模態表示空間 。

研發團隊發現 , 采用“先離散、后連續、再聯合”這一范式后 , VLM強大的認知能力 , 能穩定、無損地遷移和擴展到物理動作上 。

而團隊獨具匠心的第四個創新點 , 是讓WALL-OSS有了內生的高級推理能力 。

具體來說 , WALL-OSS的統一跨層級思維鏈將思維鏈推理的概念從傳統狹義CoT(大語言模型中逐步文本推理)推廣至涵蓋整個語義-感知運動頻譜的廣義CoT:

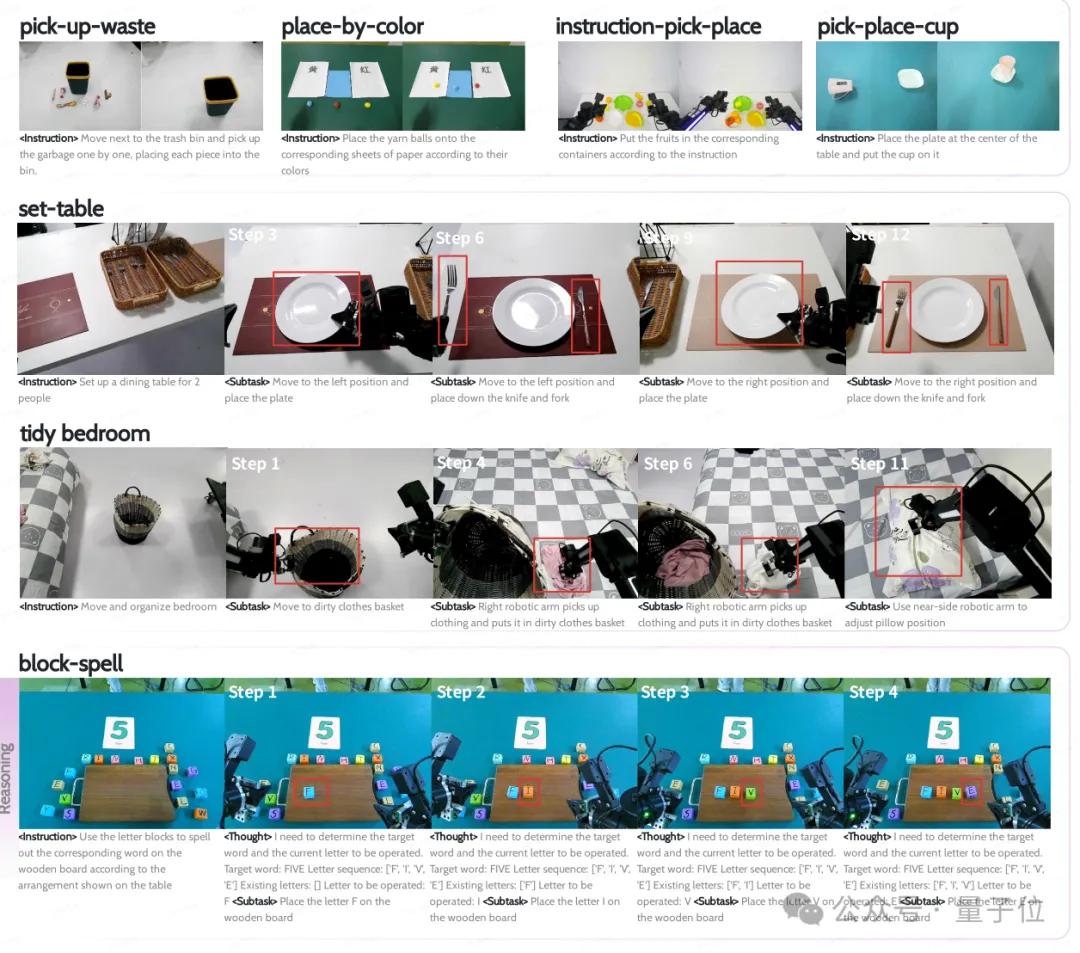

指令→推理(CoT)→子任務規劃→連續動作 。

這種統一框架實現了跨層級抽象層面的前向任意映射 , 使模型能夠在單一可微分框架內無縫切換高層決策與底層執行 。

自變量機器人CTO王昊表示:

這是WALL-OSS能夠勝任長程、復雜任務的關鍵 。 在面對未知環境、從未習得的任務時 , 模型也能自主拆解步驟 , 逐步思考 , 尋求解決辦法 。

So , 具身智能“不可能三角”不是真的牢不可破 。

架構、數據、訓練、統一跨層級CoT四線齊發 , 讓WALL-OSS在體量適中、硬件可負擔的前提下 , 建立了一個真正能通用執行的具身智能能力底座 。

真·開源通用模型 , 為具身智能“修路”說完模型能力、技術突破 , 最后我們得說說它最破圈的一步:

WALL-OSS , 它真·開源了 。

在此前 , 具身行業里除了π0 , 開源界沒有完全開源又真能打、真能用的;但對開發者來說 , π0又得花很長時間才能微調用起來 。

那么WALL-OSS呢?

——沒有OpenAI那種長期吊胃口式的夸張性預告 , 不是只發paper那種程度的 , 開源的還不是幾百個數據樣本量的小模型 。

這次自變量放出的 , 是一整套完整可復現的具身大模型方案 。

包括預訓練模型權重、訓練代碼、數據集接口 , 甚至還附帶了詳細部署文檔 , 開發者可以在自己的機器人上直接跑通閉環流程 。

這樣即使開發者沒什么訓練經驗 , 也能讓第三方機器人無門檻接入最先進的具身智能基座 , 完成模型微調和復現任務 。

不管你是研究機構、機器人公司 , 還是獨立開發者 , 只要你有一個本體設備 , 哪怕不是自變量出品 , 也能把WALL-OSS跑起來 。

這一步 , 直接把具身智能的進入門檻拉低了好幾個臺階——實測反饋 , 外部團隊最快一周內就能完成適配 。

(注:通常情況下 , 這一過程需要1~2個月)

當然 , 如果用的是自變量本家的具身智能硬件 , 適配會更快 , 效果更絲滑 。

為什么要開源?為什么要這么徹底地開源?

過去幾年 , 整個具身智能賽道看上去熱鬧 , 發布會一個接一個 , 但似乎陷入了一種“過擬合演示”怪圈 。

Demo演示一次次驚呆眾人 , 但真正用起來 , 效果就是大打折扣 。

自變量團隊認為根本原因還是模型基建的缺失 。

具身智能特別就特別在它是“軟硬件一體”的 , 所以一旦基礎設施受限 , 想把模型用起來 , 就需要不斷適配、微調 , 就意味著高投入、高門檻、長時間 。

與其每個團隊每次都要花那么大功夫 , 為什么不索性直接徹底開源呢?

要知道 , 國內不缺有想法、有實力的人才或團隊 , 能在某一個環節上節約時間 , 都能加速推動研發進度和實際場景落地 。

至于數據和算力的問題 , 很多科研團隊、中小企業都難以只靠自己克服 。

所以 , 具身智能領域迫切需要一個低算力、能力強、還開源的基礎模型來打破僵局 。

WALL-OSS , 就是這么一個符合上述條件的具身大模型 。

“我們想讓整個行業以最低的成本 , 獲得最先進、最通用的能力基座 。 ”自變量CTO王昊總結道 , “因為沒有基礎模型 , 具身智能行業根本長不大 。 ”

并且 , 自變量團隊希望通過WALL-OSS乃至后面持續的開源 , 建立起開源的標桿 。

這個舉動 ,能讓“只能在定制化場景中表現優異”的機器人無處遁形 , 進一步推動行業之間的公平 , 倒逼技術透明化發展 。

也能讓更多的人才愿意加入具身智能行業 , 去一起攻破一些核心的技術難點 。

在具身智能這場長跑里 , 終點一定不會只給某一家公司準備鮮花和獎杯 。 但起點 , 至少該有一塊足夠穩的起跑板 。

自變量要做的 , 就是這塊起跑板 。

GitHub:https://github.com/X-Square-Robot/wall-x項目主頁:https://x2robot.com/en/research/68bc2cde8497d7f238dde690

— 完 —

量子位 QbitAI · 頭條號

關注我們 , 第一時間獲知前沿科技動態

推薦閱讀

- AMD 銳龍5 9500F首測 游戲幀數超越14600K 千元質價比拉滿

- 華為首次超越三星,2025上半年全球折疊手機出貨量排名第一

- Denodo聲稱DeepQuery能超越生成式AI的表面洞察

- 首個AI計算開放架構在重慶發布,國產智算迎來“安卓模式”

- 韓國發布報告:中國芯片技術超越韓國,全球第二!

- 微軟團隊打破光纖40年技術瓶頸!速度與損耗首次全面超越傳統玻璃

- 螞蟻專用模型超越o3!僅用2K訓練樣本刷新醫療AI榜單紀錄

- 小米汽車營收被曝已超越小米手機,小米副業快干成主業了?

- 超越X200 Ultra!vivo X300 Pro確認將搭載2億HPB長焦

- 首次超越蘋果,華為手表全球稱王!