1300000000000000!谷歌每月Tokens消耗量曝光(別數了是千萬億)

文章圖片

文章圖片

文章圖片

文章圖片

1300000000000000!

1.3千萬億 , 一個令人咂舌的數字 。 這就是谷歌每月處理的Tokens用量 。

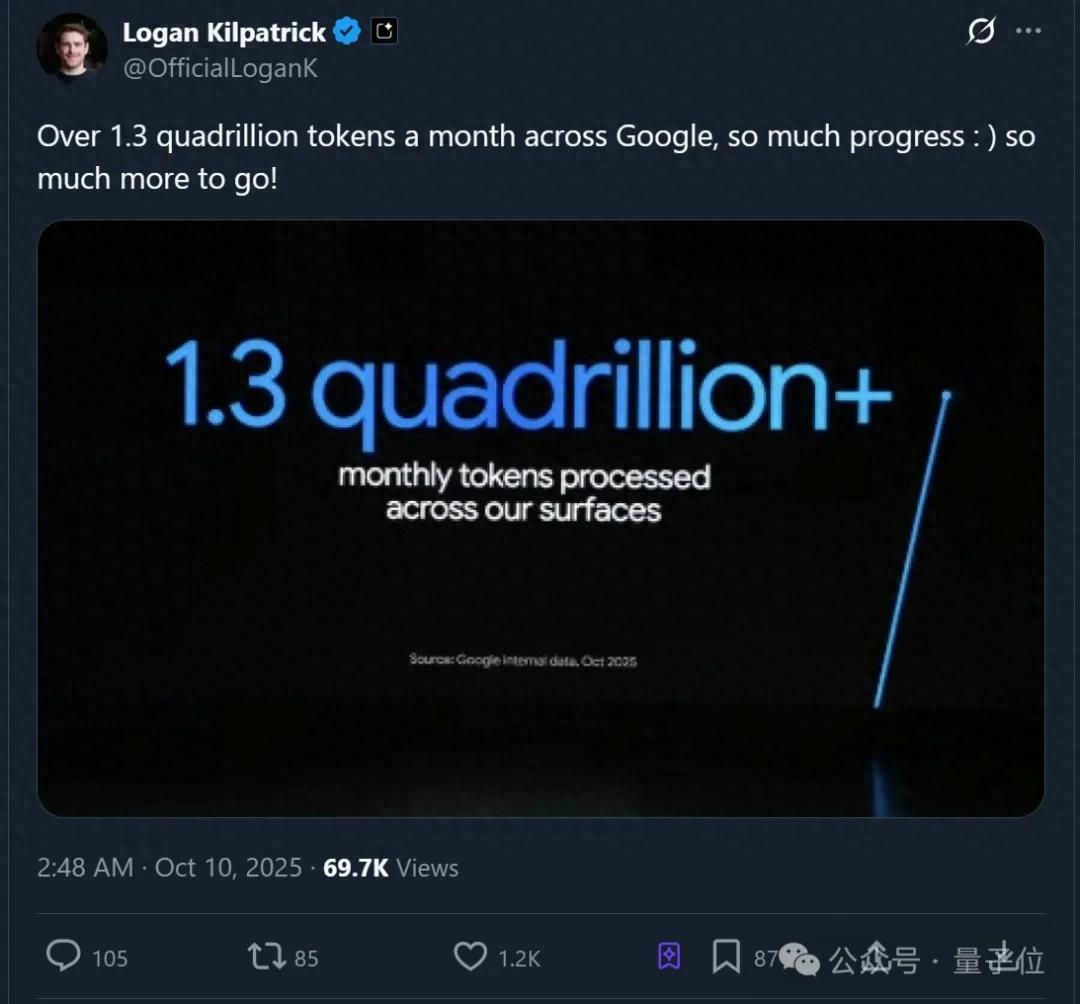

據谷歌“宣傳委員”Logan Kilpatrick透露 , 這一數據來自谷歌對旗下各平臺的內部統計 。

假如參考DeepSeek API文檔中給出的標準:

1 個英文字符 ≈ 0.3 個 Token 1 個中文字符 ≈ 0.6 個 Token那么在中文世界里 , 1.3千萬億Tokens約2.17千萬億漢字 。 換算成對話量 , 一本《紅樓夢》的字數在70-80萬左右 , 相當于一個月內所有人和谷歌AI聊了近30億本《紅樓夢》的內容 。

更可怕的是 , 假如按照谷歌最近幾個月的增速來看 , 這個數字再往下恐怕……

5月份 , 月均處理480萬億個; 7月份 , 月均處理980萬億個; 10月份 , 月均處理1.3千萬億個 。而且需要注意的是 , 不止谷歌看重“Tokens消耗量”這一指標 , OpenAI最近也首次公布了30家Tokens消耗破萬億的“大金主” 。

所以 , 為什么這個指標重要?它背后又意味著什么?

咱們接著看——

今年已連續暴漲 , 扛起千萬億大旗以谷歌為例 , 它在這個指標上取得的最新成績無疑是谷歌AI實力的具象化體現 。

根據谷歌CEO皮猜在今年I/O大會上公布的一張圖 , 一年前谷歌月均處理的Tokens數量才9.7萬億 , 如今卻已突破千萬億級大關 。

并且 , 從大會結束到現在 , 根據Logan Kilpatrick(真實身份為谷歌AI Studio負責人)提供的內部數據 , 谷歌每月處理的Tokens用量還在連續暴漲 , 且暫未看到任何放緩跡象 。

單看谷歌可能沒感覺 , 那橫向對比來看看呢?

根據艾倫AI研究所研究員Nathan Lambert撰寫的一篇博客 , 目前國內外主要大廠的Tokens用量如下:

先說微軟 。 根據微軟今年公布的三季度財報 , CEO納德拉曾表示:

本季度我們處理了超過100萬億個Tokens , 同比增長5倍 , 其中僅上個月就創下了50萬億個Tokens的記錄 。

據此分析 , 微軟的Tokens處理能力還遠夠不上千萬億級別 。 而且你別忘了 , 微軟早期就與OpenAI有過合作(負責托管OpenAI模型) , 起步比谷歌更早 。

而現在 , 谷歌卻在這一指標上將微軟甩在了身后 。

此外 , 像OpenAI、國內的字節跳動、百度等公司 , 文章指出目前這些公司均達到了日均萬億Tokens的處理量級 。

不過這里要插一句 , 在剛剛過去的開發者日上 , OpenAI公布其API調用量為每分鐘60億Tokens , 這串數字換算成月度總量是260萬億Tokens 。

當然這還只是API的部分 , 如果加上Tokens消耗量更大的ChatGPT訂閱業務 , 這一數字還會更大 , 但具體是多少目前則缺少官方數據 。

整體而言 , 僅按公開可查的確切數據來看 , 谷歌在“千萬億”這一級確實是獨一檔的存在 。

【1300000000000000!谷歌每月Tokens消耗量曝光(別數了是千萬億)】當然 , Tokens用量還只是谷歌AI實力的冰山一隅 。

幾乎同一時間 , 谷歌云還公布了一組最新數據 , 里面除了提到1.3千萬億這個數字 , 還表示:

超過1300萬開發者使用谷歌模型進行開發; Gemini模型目前已生成2.3億個視頻和130億張圖像; 使用谷歌AI概覽的用戶達到20億; 65%的客戶已經在使用谷歌的AI產品 。

Anyway , 即使拋開數據不談 , 想必大家也對谷歌AI今年的崛起之勢感受頗為明顯 。

別的不說 , 傳說中的Gemini 3應該快了(坊間傳聞原計劃于10月9日上線 , 截至發稿前未正式官宣) 。

Tokens消耗量已成新的競爭指標說完谷歌 , 最后回到“Tokens消耗量”這個指標本身 。

為什么要看Tokens消耗量?

實際上 , Token作為單位能衡量的東西很多 , 包括預訓練語料規模、上下文長度、推理長度……甚至是商業價值 。

模型預訓練用了多少Token語料 , 代表了它的基礎知識儲備含量 。

模型能夠理解多少Token的輸入和輸出 , 反映了它的理解能力 。

此外 , Token還是大模型推理算力的計量單位 。 比如底層芯片廠商如今都會通過“每秒生成Token的數量”來證明自家產品的硬件能力 。 甚至如果有的模型參數未公開 , 也能通過它的Token生成速度來倒推模型規模(在相同硬件上即可推算) 。

當然更重要的是 , Token也成為大模型API的定價單位 。 一旦使用平臺的Token數量越多 , 廠商能夠獲得的商業價值以及行業影響力自然也越多 。

值得一提的是 , 今年年初 , 行業圍繞Tokens消耗量還誕生了一條新的價值紅線——不看融資估值獨角獸 , 看10億Tokens日均消耗 。

作為“入門級”檢驗標準 , 10億Tokens日均消耗背后意味著:

第一 , 它代表大模型應用落地新趨勢 , 企業擁抱大模型紅利 , 要朝著這一數字前進 。

第二 , 它成為大模型應用落地新階段的門檻 , AI業務真正跑通了嗎?需求真實存在嗎?都可以此為參考系找回答 。

第三 , 日均10億Tokens消耗也只是大模型落地“入門級水準” , 單客戶百萬億、千萬億Tokens消耗是更值得期待的星辰大海 。

而如今 , 遠超日均10億Tokens消耗 , 谷歌已經為所有玩家樹立了新的標桿 。

不知道下一個“千萬億玩家”又會是誰呢?

— 完 —

量子位 QbitAI

關注我們 , 第一時間獲知前沿科技動態

推薦閱讀

- 剛剛,清華物理傳奇Yao Shunyu,跳槽谷歌DeepMind!

- 谷歌大神出手,免費發布《智能體設計模式》,AI Agent開發終極秘籍

- 1億簽約金搶AI大神?谷歌AI元老勸退全網:別再讀博了

- 谷歌Pixel 11或搭載聯發科M90基帶,帶來通信提升

- OpenAI推出智能購物系統挑戰谷歌亞馬遜

- OpenAI結盟三星、SK:鎖定每月90萬片DRAM和90萬片HBM晶圓供應!

- 谷歌智能家居新品發布,Gemini AI再升級

- 韓國如何用本土AI技術挑戰OpenAI和谷歌

- 谷歌Veo 3論文竟無一作者來自美國!揭秘零樣本「看懂」世界

- 小米17在唯品會開啟首發,每月只需三百多元?