經典ReLU回歸!重大缺陷「死亡ReLU問題」已被解決

文章圖片

文章圖片

文章圖片

文章圖片

文章圖片

機器之心報道

機器之心編輯部

【經典ReLU回歸!重大缺陷「死亡ReLU問題」已被解決】不用換模型、不用堆參數 , 靠 SUGAR 模型性能大增!

在深度學習領域中 , 對激活函數的探討已成為一個獨立的研究方向 。 例如 GELU、SELU 和 SiLU 等函數憑借其平滑梯度與卓越的收斂特性 , 已成為熱門選擇 。

盡管這一趨勢盛行 , 經典 ReLU 函數仍因其簡潔性、固有稀疏性及其他優勢拓撲特性而廣受青睞 。

然而 ReLU 單元易陷入所謂的「死亡 ReLU 問題」 ,一旦某個神經元在訓練中輸出恒為 0 , 其梯度也為 0 , 無法再恢復 。這一現象最終制約了其整體效能 , 也是 ReLU 網絡的重大缺陷 。

正是死亡 ReLU 問題催生了大量改進的線性單元函數 , 包括但不限于:LeakyReLU、PReLU、GELU、SELU、SiLU/Swish 以及 ELU 。 這些函數通過為負預激活值引入非零激活 , 提供了不同的權衡 。

本文 , 來自德國呂貝克大學等機構的研究者引入了一種新穎的方法:SUGAR(Surrogate Gradient for ReLU) , 在不犧牲 ReLU 優勢的情況下解決了 ReLU 的局限性 。 即前向傳播仍使用標準 ReLU(保持其稀疏性和簡單性) , 反向傳播時替換 ReLU 的導數為一個非零、連續的替代梯度函數(surrogate gradient) 。

這樣可以讓 ReLU 在保持原始前向行為的同時 , 避免梯度為零的問題 , 從而復活死神經元 。

基于此 , 本文還設計了兩種新型替代梯度函數:B-SiLU(Bounded SiLU)、 NeLU(Negative slope Linear Unit) , 可以無縫集成到各種模型中 。

本研究的進一步貢獻如下:

- 本文對 VGG-16 和 ResNet-18 進行了全面的實驗 , 表明 SUGAR 顯著增強了這兩種架構的泛化能力 。

- 本文在 Swin Transformer 和 Conv2NeXt 等現代架構上對 SUGAR 進行了評估 , 展示了其適應性和有效性 。

- 對 VGG-16 層激活的深入分析表明 , 當應用 SUGAR 時 , 激活分布發生了明顯的變化 , 為其在緩解消亡 ReLU 問題中的作用提供了直觀證據 , 同時促進了更稀疏的表示 。

SUGAR 方法易于實現 , 并在前向傳播中始終采用 ReLU 激活函數 。 與所提出的 B-SiLU 替代函數結合使用時 , VGG-16 在 CIFAR-10 和 CIFAR-100 數據集上的測試準確率分別提升了 10 個百分點和 16 個百分點 , 而 ResNet-18 與未使用 SUGAR 的最佳模型相比 , 分別提升了 9 個百分點和 7 個百分點 。

- 論文標題: The Resurrection of the ReLU

- 論文鏈接:https://arxiv.org/pdf/2505.22074

SUGAR 介紹

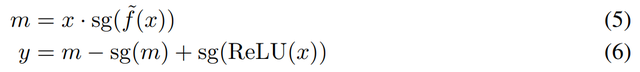

本文提出的方法將 FGI ( Forward gradient injection )應用于具有平滑替代函數的 ReLU 網絡中 。 在 SUGAR 框架下 ,FGI 可以表示為:

該公式實現了梯度注入 , 并確保即使對于負激活也能進行梯度傳播 。 具體來說 , 利用 [34

中的乘法技巧 , 替代梯度函數的直接注入如下:

替代函數的選擇具有靈活性 , 可兼容當前最先進的各類激活函數 , 例如 ELU、GELU、SiLU、SELU 以及 Leaky ReLU(見圖 8) 。

關鍵區別在于 , 與 ReLU 不同 , 這些候選替代函數均具有一個共同特征:對負輸入(x < 0)能產生非零梯度 。 雖然這些函數為負激活提供了梯度流通路徑 , 但前向傳播及后續損失計算仍嚴格依賴 x > 0 時的激活輸出 。

在初步研究中 , 本文意識到需要調整當前的激活函數以適應 SUGAR 的特定用途 。 因此 , 接下來本文提出了兩個與這些設置良好匹配的新替代函數 。

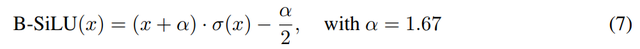

B-SiLU:引入了一種名為 B-SiLU(Bounded Sigmoid Linear Unit) 的新型激活函數 , 它結合了自門控特性和可調下限參數 。 從數學上講 , 該函數可以表示為:

B-SiLU 激活函數的導數為:

圖 8 中可視化了 B-SiLU 及其導數 。

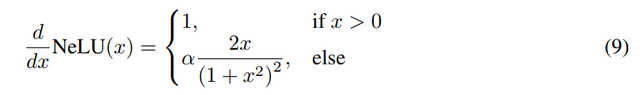

NeLU:本文進一步引入了 NeLU(Negative slope Linear Unit) , 作為 ReLU 的平滑導數替代品 。

最終的梯度如圖 1 所示 。

實驗

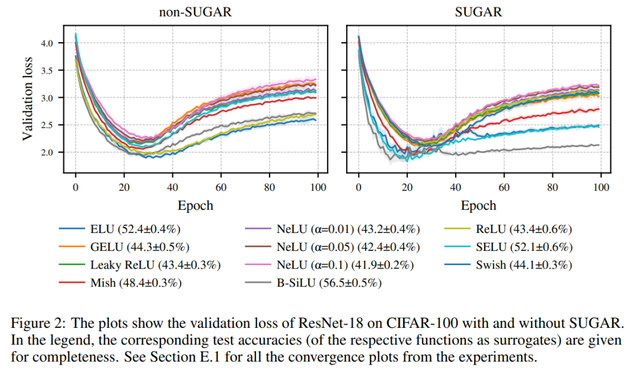

總體而言 , 與 ReLU 基線相比 , SUGAR 結合 ELU、SELU 以及特別是 B-SiLU 獲得了最大的提升 , 而 LeakyReLU 和 NeLU 則始終表現不佳(見圖 2) 。 在 CIFAR-10 數據集上使用 ResNet-18 作為骨干網絡時 , B-SiLU 的性能從 76.76% 提升到 86.42% , 得益于 SUGAR 。 VGG-16 也表現出類似的效果:B-SiLU 將測試精度提高了近 10 個百分點(從 78.50% 提升到 88.35%) 。

在 CIFAR-100 數據集上 , SUGAR 結合 B-SiLU 的優勢更加明顯:ResNet-18 的準確率從 48.99% 躍升至 56.51% , VGG-16 的準確率從 48.73% 提升至 64.47%(見圖 3) 。 同樣 , Leaky ReLU 和 NeLU 僅顯示出微小的甚至是負的提升(例如 ResNet-18 上的 43.67% → 43.41%) 。

總的來說 , B-SiLU 在不同架構和數據集上均優于其他替代激活函數 , ELU 和 SELU 能夠提供可靠的改進 , 而在這種設置下 , SUGAR 從 Leaky ReLU 和 NeLU 中并未獲得有意義的益處 。

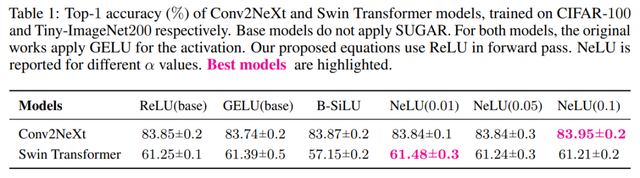

當應用于 Conv2NeXt 時 , 如表 1 所示 , SUGAR 在前向和反向傳播過程中均始終優于使用 GELU 的基礎模型 。

了解更多內容 , 請參考原論文 。

推薦閱讀

- 華為Mate80系列全面曝光:直屏回歸+風冷散熱,年度旗艦蓄勢待發

- 雙尺寸已確定,mini版待定,OPPO Find X9系列在路上回歸直屏設計

- 王自如回歸后首次直播:回應欠錢原因 自己絕對不會帶貨

- 華為Mate 80取消曲面屏,直屏全系回歸,影像系統也有新突破

- 定了?華為Pura80系列6月10日上海發布!麒麟芯片全面回歸

- 華為nova 14官宣發布,麒麟芯片回歸、鴻蒙電腦首秀

- 一加15曝光:回歸直屏 2K曲屏時代終結

- 阿里CEO吳泳銘內網發帖:回歸初心,重新創業

- 999不到,小米死敵回歸,但這外觀花粉都傻眼了

- 回歸6.79英寸LCD屏幕設計,這款酷派百元機,國產處理器足夠用