文章圖片

文章圖片

文章圖片

henry 發自 凹非寺

量子位 | 公眾號 QbitAI

一波未平 , 一波又起 。

英偉達Triton推理服務器 , 被安全研究機構Wiz Research曝光了一組高危漏洞鏈 。

這組漏洞可以被組合利用 , 實現遠程代碼執行(RCE) , 攻擊者可以讀取或篡改共享內存中的數據 , 操縱模型輸出 , 控制整個推理后端的行為 。

可能造成的后果包括模型被盜、數據泄露、響應操縱 , 乃至系統失控 。

【英偉達推理服務器被曝高危漏洞,云端AI模型被攻擊直接裸奔】目前 , 英偉達已經發布補丁 , 但所有25.07版本之前的系統都處于裸奔狀態 , 用戶需要將Triton Inference Server更新到最新版本 。

一處漏洞 , 牽一發而動全身這次的漏洞鏈危害有多大呢?

據Wiz表示 , 該漏洞鏈可能允許未經身份驗證的遠程攻擊者控制英偉達Triton推理服務器 , 進而可能導致以下一連串的嚴重后果:

首先 , 是模型被盜(Model Theft) , 攻擊者可以通過精確定位共享內存區域 , 竊取專用且昂貴的人工智能模型 。

其次 , 是數據泄露(Data Breach) , 一旦控制了模型運行時的內存 , 攻擊者就能實時讀取模型輸入輸出 , 截取模型處理過程中涉及的敏感數據(例如用戶信息或財務數據) 。

再往后 , 是響應被操縱(Response Manipulation) , 攻擊者不僅能讀 , 還能寫 。 他們可以操縱AI模型的輸出 , 使其產生錯誤、有偏見或惡意的回應 。

最后 , 是橫向移動(Pivoting)導致的系統失控 , 攻擊者利用已經被攻陷的服務器 , 作為跳板 , 進一步攻擊該組織網絡內的其他系統 。

可以說 , 一個Triton漏洞就足以摧毀一個AI平臺的四大支柱:模型、數據、輸出、系統 。

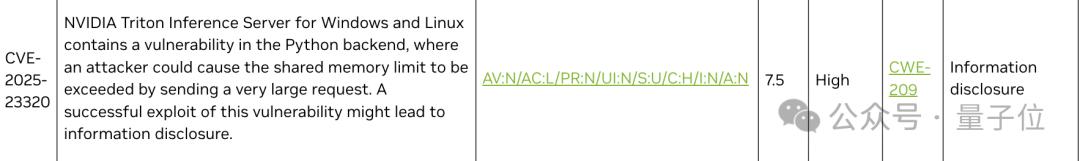

什么漏洞 , 居然這么危險?這次的漏洞鏈由三個漏洞組成:

CVE-2025-23320:當攻擊者發送一個超大請求超出共享內存限制時 , 會觸發異常 , 返回的錯誤信息會暴露后端內部IPC(進程間通信)共享內存區的唯一標識符(key) 。

CVE-2025-23319:利用上述標識符 , 攻擊者可執行越界寫入(out-of-bounds write) 。

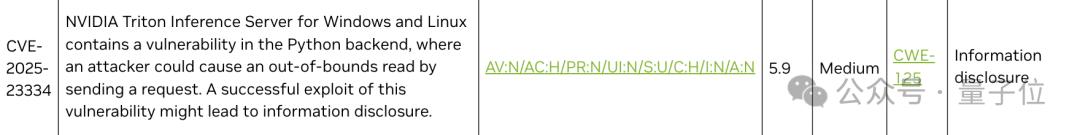

CVE-2025-23334:利用標識符可實現越界讀(out-of-bounds read) 。

這三個漏洞環環相扣 , 構成了完整的攻擊鏈條:

首先 , 攻擊者借助CVE-2025-23320的錯誤信息泄露漏洞 , 獲取Triton Python后端內部共享內存的唯一標識符 。

當掌握了這個標識符后 , 攻擊者便可利用CVE-2025-23319和CVE-2025-23334兩個漏洞 , 對該共享內存區域進行越界寫入和越界讀取操作 。

具體來說 , 攻擊者通過濫用共享內存API , 不受限制地讀寫后端內部的內存數據結構 。

最后 , 在獲得對后端共享內存的讀寫權限后 , 攻擊者能夠干擾服務器正常行為 , 進而實現對服務器的完全控制 。

可能的攻擊方式包括但不限于:

– 破壞后端共享內存中的數據結構 , 尤其是包含指針的結構(如 MemoryShm、SendMessageBase) , 從而實現越界讀寫 。

– 偽造和操控 IPC 消息隊列中的消息 , 造成本地內存破壞或邏輯漏洞利用 。

從最初的信息泄露 , 升級至全面的系統入侵 , 這一“完美”的的攻擊路徑在很大程度上就和Triton的架構有關 。

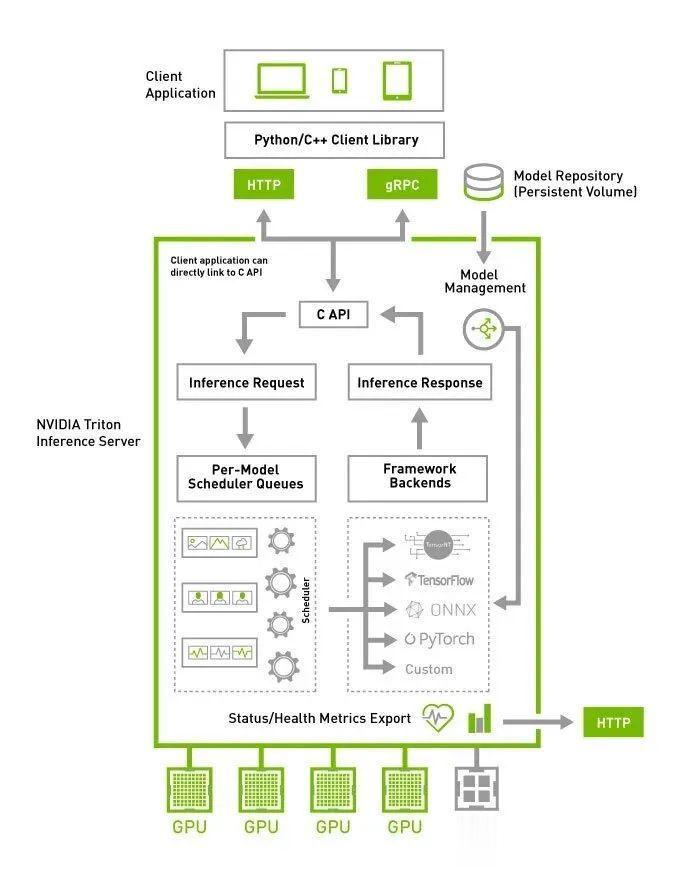

通用是一把雙刃劍雖然這次漏洞集中在Triton的Python后端 , 但“Python后端”并不是專供Python框架調用的 。

英偉達的Triton是一個通用的推理平臺 , 它設計的目的是幫助開發者簡化AI模型在各種框架(比如 PyTorch、TensorFlow、ONNX)上的部署和運行 。

為了實現這一點 , Triton采用了模塊化的后端架構 , 每個后端負責執行對應框架的模型 。

當一個推理請求到來時 , Triton會自動識別模型所屬的框架 , 并將請求發送給對應的后端執行 。

然而 , 在推理的不同階段 , 即便模型主要運行在某個后端(比如PyTorch后端) , 也可能會在內部調用Python后端完成某些任務 。

換句話說 , 哪怕主模型在TensorFlow或PyTorch上運行 , 但只要流程中包含定制環節 , Python后端就有可能被調入執行 。

所以 , Python后端并不僅僅服務于Python框架的模型 , 而是被更廣泛地用在Triton的推理流程中 , 這也使得它成為一個潛在的安全薄弱點 , 影響范圍更大 。

此外 , Triton Python后端的核心邏輯是用C++實現的 ,

當有推理請求到來時 , 這個C++組件會與一個單獨的“stub”(存根)進程通信 , 后者負責加載并執行具體的模型代碼 。

為了讓C++邏輯和stub進程之間順利交流 , Python后端采用了復雜的進程間通信(IPC)機制 , 用于推理數據傳輸和內部操作協調 。

這個IPC基于命名共享內存(通常是/dev/shm路徑下的共享內存區域) , 每個共享內存區都有唯一的系統路徑標識符 , 也就是我們上面說到的標識符key 。

這樣的設計可以實現高速的數據交換 , 但也帶來了一個關鍵的安全隱患:共享內存名稱的安全性和隱私保護非常重要 , 一旦名稱泄露 , 就可能被攻擊者利用 。

綜上 , 通用平臺正因為靈活 , 反而卻成為了安全命門 , 即所謂一處漏洞 , 牽一發而動全身 。

幸運的是 , 雖然漏洞鏈殺傷力巨大 , 但目前還只停留在實驗室里 , 尚未被發現用于實際攻擊 。

在接到Wiz Research的報告后 , 英偉達也是火速修復了這三個漏洞 , 并發布了更新后的Triton Inference Server 25.07版本 。

只能說 , 漏洞這種事 , 還是被自己人先發現更安心 。

參考鏈接:[1

https://www.theregister.com/2025/08/05/nvidia_triton_bug_chain/[2

https://www.wiz.io/blog/nvidia-triton-cve-2025-23319-vuln-chain-to-ai-server[3

https://thehackernews.com/2025/08/nvidia-triton-bugs-let-unauthenticated.html

— 完 —

量子位 QbitAI · 頭條號簽約

關注我們 , 第一時間獲知前沿科技動態

推薦閱讀

- 英偉達回應了,沒有后門、沒有終止開關、沒有監控軟件

- 財報前夜看AMD,與英偉達的差距在縮小嗎?

- 美企在裝睡,但黃仁勛很清醒:華為AI芯片,遲早會取代英偉達

- 黃仁勛罕見翻車,英偉達桌面CPU出師不利,生態是最大掣肘

- 英睿達P510評測:PCIe5.0時代的主流親民之選

- 新加坡團隊:強化學習使小模型推理媲美GPT-4

- 卡內基梅隆大學:AI推理新突破讓機器如偵探破案

- 23.6億美元!英偉達拿下亞洲AI基建大單,太能賺錢了

- AI推理時代來臨,云天勵飛攜“算力積木”架構破解國產化難題

- 稀土換來了木馬計劃?英偉達芯片被爆藏后門,央媒的提醒該重視了